TWIST: Teleoperated Whole-Body Imitation System

作者: Yanjie Ze, Zixuan Chen, João Pedro Araújo, Zi-ang Cao, Xue Bin Peng, Jiajun Wu, C. Karen Liu

分类: cs.RO, cs.CV, cs.LG

发布日期: 2025-05-05

备注: Project website: https://humanoid-teleop.github.io

💡 一句话要点

TWIST:一种用于人型机器人全身模仿的遥操作系统

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人型机器人 遥操作 全身模仿 强化学习 行为克隆

📋 核心要点

- 现有的人型机器人遥操作系统通常无法实现协调的全身行为,仅限于孤立的运动或操作任务。

- TWIST系统通过模仿人类全身运动,生成参考运动片段,并结合强化学习和行为克隆,实现对人型机器人的全身控制。

- 实验结果表明,TWIST系统能够使人型机器人实现全身操作、腿部操作、运动和表达性运动等多种技能。

📝 摘要(中文)

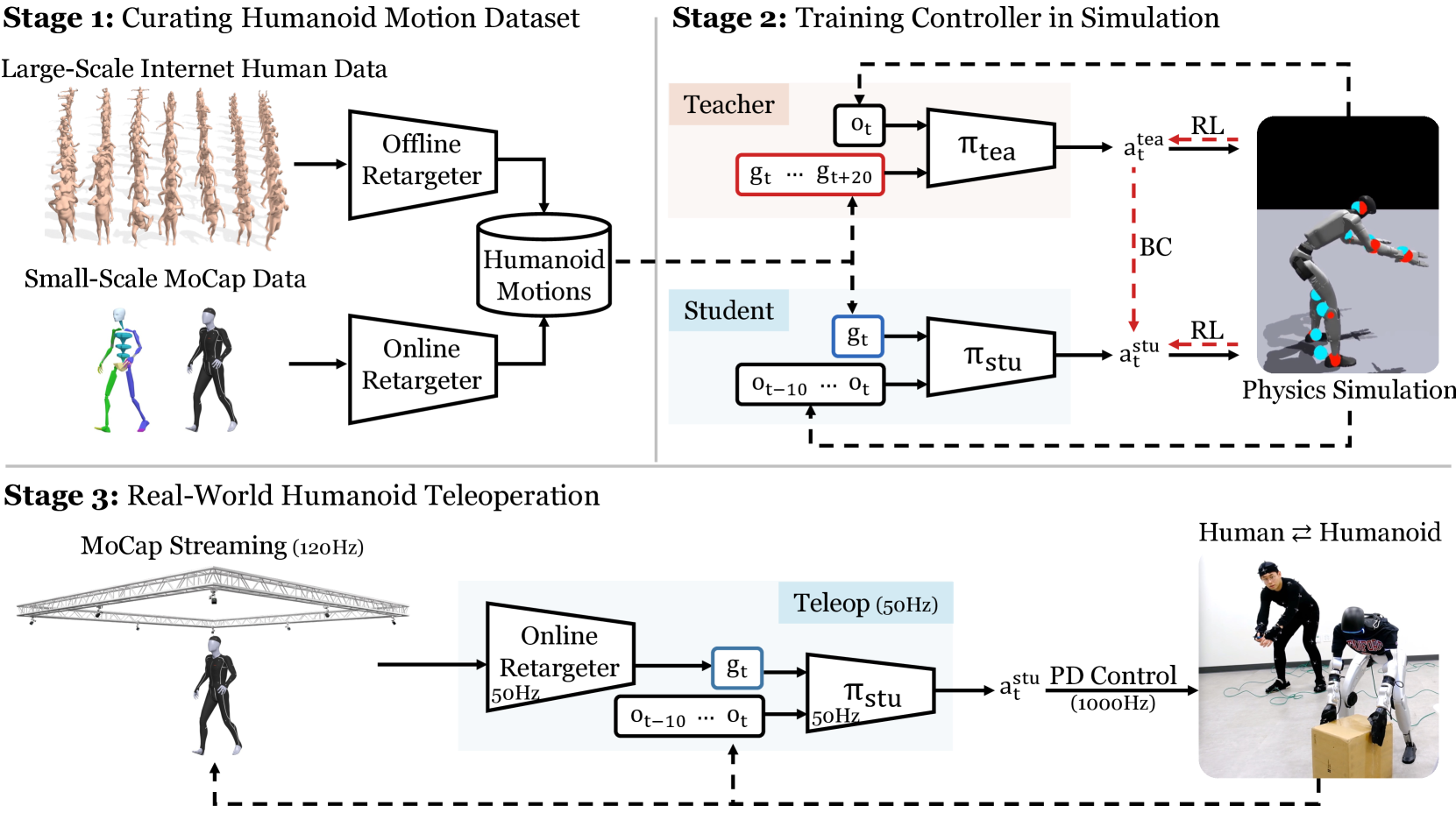

本文提出了一种用于人型机器人全身遥操作的系统——TWIST(Teleoperated Whole-Body Imitation System),旨在通过全身运动模仿实现对人型机器人的控制。该系统首先将人类运动捕捉数据重定向到人型机器人,生成参考运动片段。然后,结合强化学习和行为克隆(RL+BC),开发了一个鲁棒、自适应且响应迅速的全身控制器。通过系统分析,证明了结合特权未来运动帧和真实世界运动捕捉(MoCap)数据能够提高跟踪精度。TWIST使真实世界的人型机器人能够使用单一的统一神经网络控制器实现前所未有的、多功能的和协调的全身运动技能,涵盖全身操作、腿部操作、运动和表达性运动。

🔬 方法详解

问题定义:现有的人型机器人遥操作系统通常只能处理孤立的运动或操作任务,缺乏对全身协调运动的支持。这限制了人型机器人在复杂环境中的应用,例如需要全身配合的操作任务。因此,需要开发一种能够实现全身协调运动的人型机器人遥操作系统。

核心思路:TWIST的核心思路是通过模仿人类的全身运动来实现对人型机器人的控制。具体来说,首先利用人类运动捕捉数据生成参考运动片段,然后训练一个能够模仿这些参考运动的全身控制器。这种方法能够有效地将人类的运动技能迁移到人型机器人上,从而实现全身协调运动。

技术框架:TWIST系统主要包含两个阶段:参考运动生成和全身控制器训练。在参考运动生成阶段,系统将人类运动捕捉数据重定向到人型机器人,生成一系列参考运动片段。在全身控制器训练阶段,系统使用强化学习和行为克隆相结合的方法,训练一个能够模仿这些参考运动的神经网络控制器。该控制器接收机器人的状态信息作为输入,输出机器人的关节力矩,从而控制机器人的运动。

关键创新:TWIST的关键创新在于其结合了强化学习和行为克隆的方法,以及利用了特权未来运动帧和真实世界运动捕捉数据。通过行为克隆,控制器可以快速学习到基本的运动技能;通过强化学习,控制器可以进一步优化其性能,提高其鲁棒性和适应性。利用特权未来运动帧可以帮助控制器更好地预测未来的运动状态,从而提高跟踪精度。

关键设计:TWIST的控制器是一个深度神经网络,其输入包括机器人的关节角度、角速度、质心位置和速度等状态信息,以及未来几帧的参考运动信息。损失函数包括模仿损失、平衡损失和正则化损失。模仿损失用于衡量机器人运动与参考运动之间的差距;平衡损失用于保证机器人的平衡;正则化损失用于防止过拟合。强化学习部分使用PPO算法进行训练。

🖼️ 关键图片

📊 实验亮点

TWIST系统在多个任务上进行了评估,包括全身操作、腿部操作、运动和表达性运动。实验结果表明,TWIST系统能够使人型机器人实现前所未有的、多功能的和协调的全身运动技能。例如,在全身操作任务中,TWIST系统能够使人型机器人完成复杂的装配任务,其成功率和效率均优于现有的方法。

🎯 应用场景

TWIST系统具有广泛的应用前景,例如远程操作、危险环境作业、康复训练和娱乐等领域。在远程操作中,操作员可以通过TWIST系统控制人型机器人在远端执行任务,例如维修设备、处理危险品等。在康复训练中,TWIST系统可以帮助患者进行全身运动训练,提高其运动能力。在娱乐领域,TWIST系统可以用于开发各种人型机器人游戏和表演。

📄 摘要(原文)

Teleoperating humanoid robots in a whole-body manner marks a fundamental step toward developing general-purpose robotic intelligence, with human motion providing an ideal interface for controlling all degrees of freedom. Yet, most current humanoid teleoperation systems fall short of enabling coordinated whole-body behavior, typically limiting themselves to isolated locomotion or manipulation tasks. We present the Teleoperated Whole-Body Imitation System (TWIST), a system for humanoid teleoperation through whole-body motion imitation. We first generate reference motion clips by retargeting human motion capture data to the humanoid robot. We then develop a robust, adaptive, and responsive whole-body controller using a combination of reinforcement learning and behavior cloning (RL+BC). Through systematic analysis, we demonstrate how incorporating privileged future motion frames and real-world motion capture (MoCap) data improves tracking accuracy. TWIST enables real-world humanoid robots to achieve unprecedented, versatile, and coordinated whole-body motor skills--spanning whole-body manipulation, legged manipulation, locomotion, and expressive movement--using a single unified neural network controller. Our project website: https://humanoid-teleop.github.io