Point Cloud Recombination: Systematic Real Data Augmentation Using Robotic Targets for LiDAR Perception Validation

作者: Hubert Padusinski, Christian Steinhauser, Christian Scherl, Julian Gaal, Jacob Langner

分类: cs.RO, cs.CV, eess.IV

发布日期: 2025-05-05 (更新: 2025-09-03)

备注: Pre-print for IEEE IAVVC 2025

💡 一句话要点

提出点云重组方法,利用机器人目标进行LiDAR感知验证的系统性真实数据增强。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 点云增强 LiDAR感知 机器人 数据增强 目标检测 自动驾驶 三维重建

📋 核心要点

- 现有LiDAR感知验证方法在真实感和可控性之间存在矛盾,真实数据缺乏控制,仿真数据缺乏真实传感器特性。

- 提出点云重组方法,将受控环境下的物理目标点云与真实场景点云融合,实现可控且真实的增强。

- 实验表明,重组场景与真实传感器输出匹配良好,可用于有针对性的测试、故障分析和系统安全性提升。

📝 摘要(中文)

由于真实环境条件的多变性,验证智能移动系统在开放世界应用中基于LiDAR的感知仍然是一个挑战。虚拟仿真允许在受控条件下生成任意场景,但缺乏物理传感器特性,如强度响应或材料相关效应。相比之下,真实世界数据提供了真实的传感器特性,但对影响因素的控制较少,阻碍了充分的验证。现有方法通过在场景之间转移对象来增强真实世界点云数据,但这些方法没有考虑验证,并且由于依赖经验数据,在可控性方面仍然有限。我们通过提出点云重组来解决这些限制,该方法通过集成从受控实验室环境中测量的物理目标对象获取的点云,系统地增强捕获的点云场景。因此,能够创建大量且多样化的、可重复的、物理上精确的测试场景,这些场景具有现象感知的遮挡和注册的3D网格。使用Ouster OS1-128 Rev7传感器,我们展示了用具有不同服装和姿势的人形目标增强真实世界的城市和乡村场景,以实现可重复的定位。我们表明,重组的场景与真实的传感器输出非常匹配,从而能够进行有针对性的测试、可扩展的故障分析和提高系统安全性。通过提供受控但传感器真实的数据,我们的方法能够对特定传感器及其算法的局限性得出可信的结论,例如,目标检测。

🔬 方法详解

问题定义:论文旨在解决LiDAR感知系统验证中真实数据和仿真数据各自的局限性问题。真实数据虽然具有真实的传感器特性,但难以控制场景中的各种因素,不利于系统性的验证和故障分析。而仿真数据虽然可以精确控制场景,但缺乏真实的传感器特性,例如强度响应和材料依赖效应,导致验证结果与实际情况存在偏差。现有基于真实数据增强的方法,例如直接将对象从一个场景复制到另一个场景,缺乏对增强过程的控制,并且依赖于经验数据,难以保证增强数据的质量和多样性。

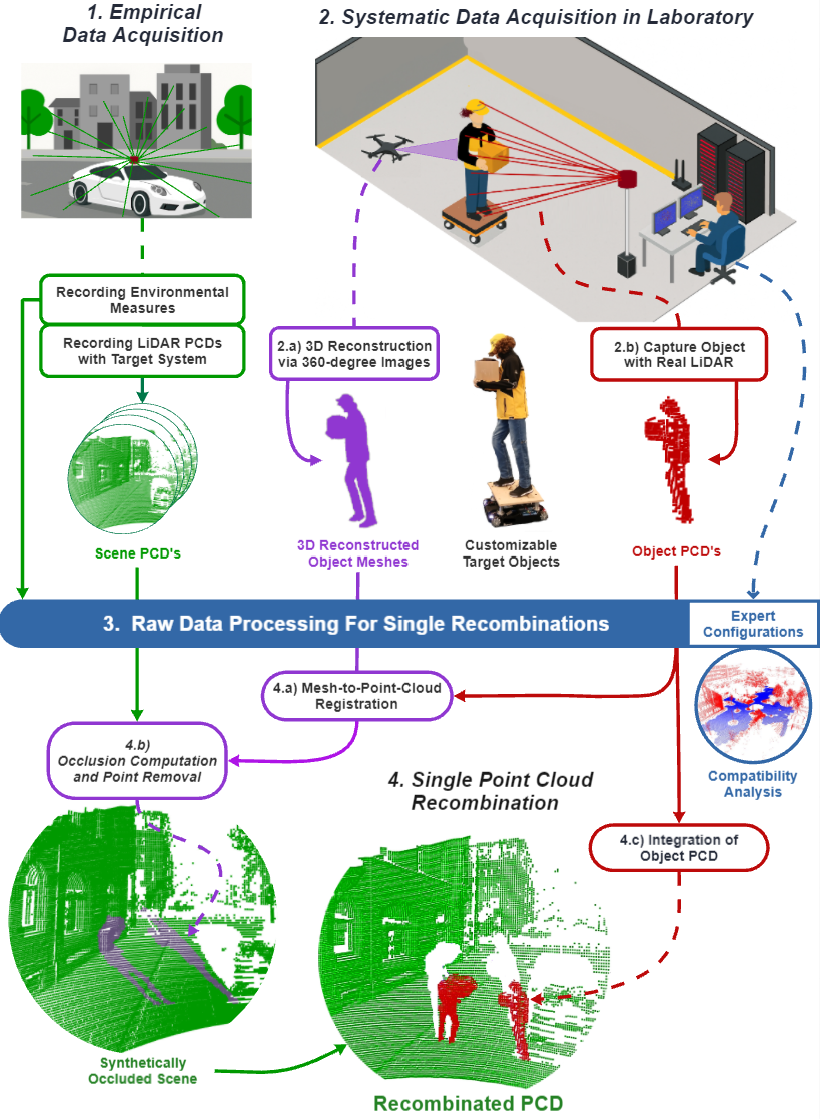

核心思路:论文的核心思路是将受控实验室环境中获取的物理目标对象的点云数据,与真实场景中获取的点云数据进行融合,从而生成既具有真实传感器特性,又具有可控场景因素的增强数据。通过在受控环境中精确测量目标对象,可以获得高质量的点云数据,并可以精确控制目标对象的位置、姿态和材质等属性。然后,将这些目标对象点云数据插入到真实场景的点云数据中,从而生成新的增强场景。

技术框架:点云重组方法主要包含以下几个阶段:1) 目标对象点云获取:在受控实验室环境中,使用LiDAR传感器扫描物理目标对象,获取高质量的点云数据。2) 目标对象点云处理:对目标对象点云数据进行预处理,例如去噪、滤波和分割等,提取出目标对象的几何信息和表面属性。3) 真实场景点云获取:使用LiDAR传感器扫描真实场景,获取真实场景的点云数据。4) 点云重组:将目标对象点云数据插入到真实场景的点云数据中,生成新的增强场景。在插入过程中,需要考虑目标对象与场景之间的遮挡关系,并对目标对象点云数据进行变换,使其与场景中的坐标系对齐。5) 数据后处理:对重组后的点云数据进行后处理,例如平滑和融合等,以提高数据的质量和真实感。

关键创新:该方法最重要的创新点在于,它将受控环境下的物理目标对象点云数据与真实场景点云数据进行融合,从而生成既具有真实传感器特性,又具有可控场景因素的增强数据。与现有方法相比,该方法具有更高的可控性和真实性,可以用于系统性的LiDAR感知系统验证和故障分析。此外,该方法还考虑了目标对象与场景之间的遮挡关系,从而生成更加真实的增强场景。

关键设计:论文中没有详细描述关键的参数设置、损失函数或网络结构等技术细节,因为该方法主要关注于数据增强的流程和框架,而不是特定的算法或模型。然而,在点云重组过程中,需要仔细考虑目标对象与场景之间的遮挡关系,并选择合适的点云配准算法,以确保目标对象点云数据与场景中的坐标系对齐。此外,还需要根据具体的应用场景,选择合适的点云数据后处理方法,以提高数据的质量和真实感。

🖼️ 关键图片

📊 实验亮点

论文使用Ouster OS1-128 Rev7传感器,在真实世界的城市和乡村场景中,通过添加具有不同服装和姿势的人形目标,验证了点云重组方法的可行性。实验结果表明,重组后的场景与真实的传感器输出非常匹配,能够实现可重复的定位。这表明该方法可以有效地生成具有真实传感器特性的增强数据,并可用于有针对性的测试、可扩展的故障分析和提高系统安全性。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、智能安防等领域,用于提升LiDAR感知系统的鲁棒性和安全性。通过生成大量可控且真实的增强数据,可以更有效地训练和验证LiDAR感知算法,例如目标检测、语义分割和三维重建等。此外,该方法还可以用于评估不同LiDAR传感器的性能,并发现其潜在的局限性,从而为LiDAR传感器的设计和选择提供指导。

📄 摘要(原文)

The validation of LiDAR-based perception of intelligent mobile systems operating in open-world applications remains a challenge due to the variability of real environmental conditions. Virtual simulations allow the generation of arbitrary scenes under controlled conditions but lack physical sensor characteristics, such as intensity responses or material-dependent effects. In contrast, real-world data offers true sensor realism but provides less control over influencing factors, hindering sufficient validation. Existing approaches address this problem with augmentation of real-world point cloud data by transferring objects between scenes. However, these methods do not consider validation and remain limited in controllability because they rely on empirical data. We solve these limitations by proposing Point Cloud Recombination, which systematically augments captured point cloud scenes by integrating point clouds acquired from physical target objects measured in controlled laboratory environments. Thus enabling the creation of vast amounts and varieties of repeatable, physically accurate test scenes with respect to phenomena-aware occlusions with registered 3D meshes. Using the Ouster OS1-128 Rev7 sensor, we demonstrate the augmentation of real-world urban and rural scenes with humanoid targets featuring varied clothing and poses, for repeatable positioning. We show that the recombined scenes closely match real sensor outputs, enabling targeted testing, scalable failure analysis, and improved system safety. By providing controlled yet sensor-realistic data, our method enables trustworthy conclusions about the limitations of specific sensors in compound with their algorithms, e.g., object detection.