Estimating Commonsense Scene Composition on Belief Scene Graphs

作者: Mario A. V. Saucedo, Vignesh Kottayam Viswanathan, Christoforos Kanellakis, George Nikolakopoulos

分类: cs.RO, cs.CV

发布日期: 2025-05-05

备注: Accepted at ICRA25

💡 一句话要点

提出基于信念场景图的常识场景构成估计方法,用于预测未见物体的空间分布。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 常识推理 场景理解 信念场景图 图卷积网络 大型语言模型

📋 核心要点

- 现有方法缺乏对场景中物体间空间关系的常识理解,难以准确预测未见物体的合理位置。

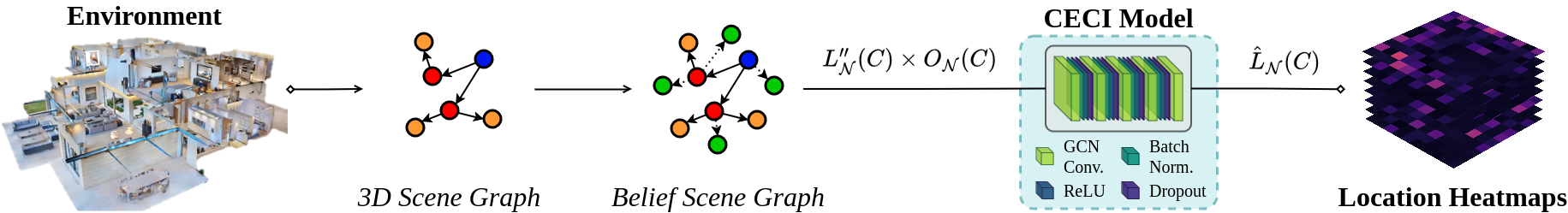

- 论文提出基于信念场景图的常识场景构成方法,利用图卷积网络和神经符号推理学习物体间的空间关系。

- 实验结果表明,该框架在模拟和真实室内环境中均能有效预测未见物体的空间分布,提升场景理解能力。

📝 摘要(中文)

本文提出了常识场景构成的概念,重点是通过估计未见物体的空间分布来扩展信念场景图。具体而言,常识场景构成能力指的是理解场景中相关物体之间的空间关系,本文将其建模为语义对象类所有可能位置的联合概率分布。提出的框架包括相关信息(CECI)模型的两种变体,用于学习概率分布:(i)基于图卷积网络的基线方法,以及(ii)集成基于大型语言模型(LLM)的空间本体的神经符号扩展。此外,本文还详细描述了此类任务的数据集生成过程。最后,该框架已通过在模拟数据以及真实室内环境中多次运行进行了验证,证明了其在不同房间类型中空间解释场景的能力。

🔬 方法详解

问题定义:论文旨在解决如何利用常识知识理解场景中物体间的空间关系,并预测未见物体的合理位置。现有方法通常依赖于大量标注数据,难以泛化到新的场景和物体类别,并且缺乏对物体间空间关系的显式建模。

核心思路:论文的核心思路是将场景理解问题转化为概率分布估计问题,即学习一个联合概率分布,描述语义对象类所有可能位置的概率。通过学习物体间的相关性,可以推断出未见物体的合理位置,从而实现常识场景构成。

技术框架:整体框架包括以下几个主要模块:1) 信念场景图构建:将场景表示为图结构,节点表示物体,边表示物体间的关系。2) 相关信息(CECI)模型:学习物体间空间关系的概率分布,包括基于图卷积网络的基线方法和集成大型语言模型的神经符号扩展。3) 概率分布估计:利用学习到的概率分布,预测未见物体的空间位置。

关键创新:论文的关键创新在于提出了常识场景构成的概念,并将空间本体知识融入到场景理解中。通过结合图卷积网络和大型语言模型,可以更有效地学习物体间的空间关系,提高场景理解的准确性和泛化能力。

关键设计:CECI模型包含两个变体:(i) 基于图卷积网络的基线方法,利用图卷积操作聚合邻居节点的信息,学习节点表示,然后利用节点表示预测物体间的空间关系。(ii) 神经符号扩展,利用大型语言模型生成空间本体,描述物体间的空间关系规则,然后将这些规则融入到图卷积网络中,提高模型对常识知识的利用能力。损失函数的设计目标是最小化预测概率分布与真实概率分布之间的差异。

🖼️ 关键图片

📊 实验亮点

论文在模拟和真实室内环境中进行了实验验证。实验结果表明,提出的框架能够有效地预测未见物体的空间分布,并且神经符号扩展方法在准确性和泛化能力方面优于基线方法。具体性能数据未知,但论文强调了该方法在不同房间类型中空间解释场景的能力。

🎯 应用场景

该研究成果可应用于机器人导航、增强现实、智能家居等领域。例如,机器人可以利用常识场景构成能力,在未知环境中自主探索和定位物体;增强现实应用可以根据场景中的物体,合理地放置虚拟物体;智能家居系统可以根据用户的习惯和场景的上下文,智能地控制家电设备。

📄 摘要(原文)

This work establishes the concept of commonsense scene composition, with a focus on extending Belief Scene Graphs by estimating the spatial distribution of unseen objects. Specifically, the commonsense scene composition capability refers to the understanding of the spatial relationships among related objects in the scene, which in this article is modeled as a joint probability distribution for all possible locations of the semantic object class. The proposed framework includes two variants of a Correlation Information (CECI) model for learning probability distributions: (i) a baseline approach based on a Graph Convolutional Network, and (ii) a neuro-symbolic extension that integrates a spatial ontology based on Large Language Models (LLMs). Furthermore, this article provides a detailed description of the dataset generation process for such tasks. Finally, the framework has been validated through multiple runs on simulated data, as well as in a real-world indoor environment, demonstrating its ability to spatially interpret scenes across different room types.