Interleave-VLA: Enhancing Robot Manipulation with Interleaved Image-Text Instructions

作者: Cunxin Fan, Xiaosong Jia, Yihang Sun, Yixiao Wang, Jianglan Wei, Ziyang Gong, Xiangyu Zhao, Masayoshi Tomizuka, Xue Yang, Junchi Yan, Mingyu Ding

分类: cs.RO

发布日期: 2025-05-04 (更新: 2025-10-08)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

Interleave-VLA:利用交错图像-文本指令增强机器人操作能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 视觉语言动作 交错指令 零样本学习 具身智能

📋 核心要点

- 现有机器人方法依赖纯文本指令,难以泛化到未见场景,限制了人机交互的灵活性。

- Interleave-VLA通过交错图像-文本输入提供更丰富、更少偏差的上下文,提升机器人处理新任务的能力。

- 实验表明,Interleave-VLA在零样本泛化方面表现出色,尤其是在处理未见物体时,性能提升显著。

📝 摘要(中文)

本文提出了一种新的机器人学习范式Interleave-VLA,它能够理解交错的图像-文本指令,并在物理世界中直接生成连续的动作序列。Interleave-VLA提供了一种自然、灵活且与模型无关的范式,通过最小的修改扩展了最先进的视觉-语言-动作(VLA)模型,同时实现了强大的零样本泛化能力。Interleave-VLA还包括一个自动管道,可以将Open X-Embodiment中的文本指令转换为交错的图像-文本指令,从而生成一个包含21万个episode的大规模真实世界交错具身数据集。在模拟和真实世界中的综合评估表明,Interleave-VLA具有两个主要优点:(1)与仅文本输入基线相比,对未见物体的领域外泛化能力提高了2倍;(2)以零样本方式支持灵活的任务界面和多样化的指令,例如手绘草图。Interleave-VLA强大的零样本能力归功于指令图像的使用,它有效地减轻了幻觉问题,以及包含来自互联网的异构多模态数据集,为可扩展性提供了潜力。

🔬 方法详解

问题定义:现有机器人操作方法主要依赖于文本指令,这种方式在面对未知的环境和物体时泛化能力较弱。纯文本指令容易产生歧义,并且缺乏视觉信息,导致机器人难以准确理解用户的意图,尤其是在复杂的操作任务中。此外,现有方法在人机交互方面不够灵活,难以支持多样化的指令形式,例如草图或手势等。

核心思路:Interleave-VLA的核心思路是利用交错的图像-文本指令作为输入,为机器人提供更丰富、更直观的上下文信息。图像可以补充文本指令中缺失的视觉信息,减少歧义,并帮助机器人更好地理解用户的意图。通过将图像和文本指令交错排列,Interleave-VLA可以更好地捕捉任务的动态变化,并生成更准确的动作序列。这种方法旨在提高机器人在未知环境中的泛化能力,并支持更灵活的人机交互。

技术框架:Interleave-VLA建立在现有的视觉-语言-动作(VLA)模型之上,通过最小的修改即可实现。其主要流程包括:(1) 将文本指令通过自动管道转换为交错的图像-文本指令;(2) 将交错指令输入到VLA模型中;(3) VLA模型根据交错指令生成连续的动作序列;(4) 机器人执行生成的动作序列。该框架还包含一个大规模的真实世界交错具身数据集,用于训练和评估模型。

关键创新:Interleave-VLA最重要的技术创新点在于引入了交错的图像-文本指令作为机器人操作的输入。与传统的纯文本指令相比,交错指令可以提供更丰富、更直观的上下文信息,从而提高机器人的泛化能力和人机交互的灵活性。此外,Interleave-VLA还提出了一个自动管道,可以将文本指令转换为交错的图像-文本指令,从而方便地生成大规模的训练数据。

关键设计:Interleave-VLA的关键设计包括:(1) 使用预训练的视觉-语言模型来编码图像和文本信息;(2) 设计合适的网络结构来融合图像和文本特征;(3) 使用强化学习或模仿学习来训练VLA模型;(4) 设计合适的奖励函数或损失函数来优化模型的性能。论文中提到使用了Open X-Embodiment数据集,并构建了包含21万个episode的大规模真实世界交错具身数据集。

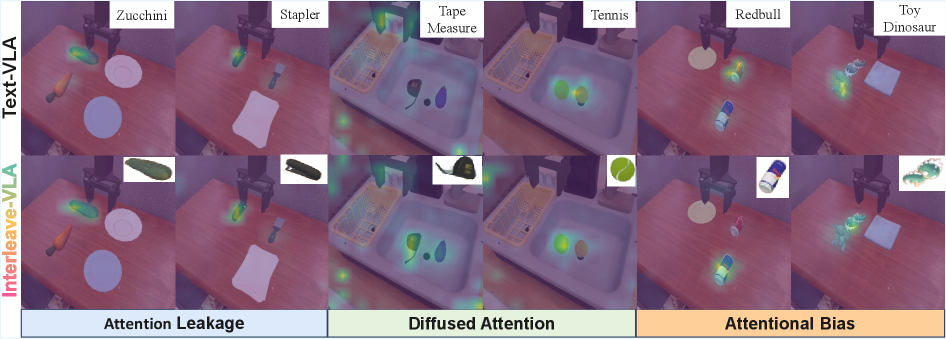

🖼️ 关键图片

📊 实验亮点

Interleave-VLA在模拟和真实世界中进行了全面的评估。实验结果表明,与仅文本输入基线相比,Interleave-VLA对未见物体的领域外泛化能力提高了2倍。此外,Interleave-VLA还支持灵活的任务界面和多样化的指令,例如手绘草图,展示了其强大的零样本泛化能力。这些结果表明,Interleave-VLA是一种有效的机器人学习范式,可以显著提高机器人的操作能力。

🎯 应用场景

Interleave-VLA具有广泛的应用前景,例如家庭服务机器人、工业自动化、医疗辅助机器人等。它可以帮助机器人在复杂的环境中执行各种任务,例如物品抓取、装配、清洁等。通过支持灵活的指令形式,Interleave-VLA可以实现更自然、更直观的人机交互,从而提高机器人的易用性和实用性。未来,Interleave-VLA有望成为通用机器人操作系统的关键组成部分。

📄 摘要(原文)

The rise of foundation models paves the way for generalist robot policies in the physical world. Existing methods relying on text-only instructions often struggle to generalize to unseen scenarios. We argue that interleaved image-text inputs offer richer and less biased context and enable robots to better handle unseen tasks with more versatile human-robot interaction. Building on this insight, Interleave-VLA, the first robot learning paradigm capable of comprehending interleaved image-text instructions and directly generating continuous action sequences in the physical world, is introduced. It offers a natural, flexible, and model-agnostic paradigm that extends state-of-the-art vision-language-action (VLA) models with minimal modifications while achieving strong zero-shot generalization. Interleave-VLA also includes an automatic pipeline that converts text instructions from Open X-Embodiment into interleaved image-text instructions, resulting in a large-scale real-world interleaved embodied dataset with 210k episodes. Comprehensive evaluation in simulation and the real world shows that Interleave-VLA offers two major benefits: (1) improves out-of-domain generalization to unseen objects by 2x compared to text input baselines, (2) supports flexible task interfaces and diverse instructions in a zero-shot manner, such as hand-drawn sketches. We attribute Interleave-VLA's strong zero-shot capability to the use of instruction images, which effectively mitigate hallucinations, and the inclusion of heterogeneous multimodal datasets, enriched with Internet-sourced images, offering potential for scalability. More information is available at https://interleave-vla.github.io/Interleave-VLA-Anonymous/