KineDex: Learning Tactile-Informed Visuomotor Policies via Kinesthetic Teaching for Dexterous Manipulation

作者: Di Zhang, Chengbo Yuan, Chuan Wen, Hai Zhang, Junqiao Zhao, Yang Gao

分类: cs.RO

发布日期: 2025-05-04

💡 一句话要点

KineDex:通过动觉示教学习触觉感知的灵巧操作策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 灵巧操作 触觉感知 动觉示教 视觉运动策略 力控制

📋 核心要点

- 接触密集型灵巧操作任务需要精确的力控制,现有遥操作方法缺乏实时触觉反馈,难以获取高质量触觉数据。

- KineDex提出一种手把手的动觉示教范式,将操作者的运动直接传递到灵巧手,实现物理基础的触觉数据收集。

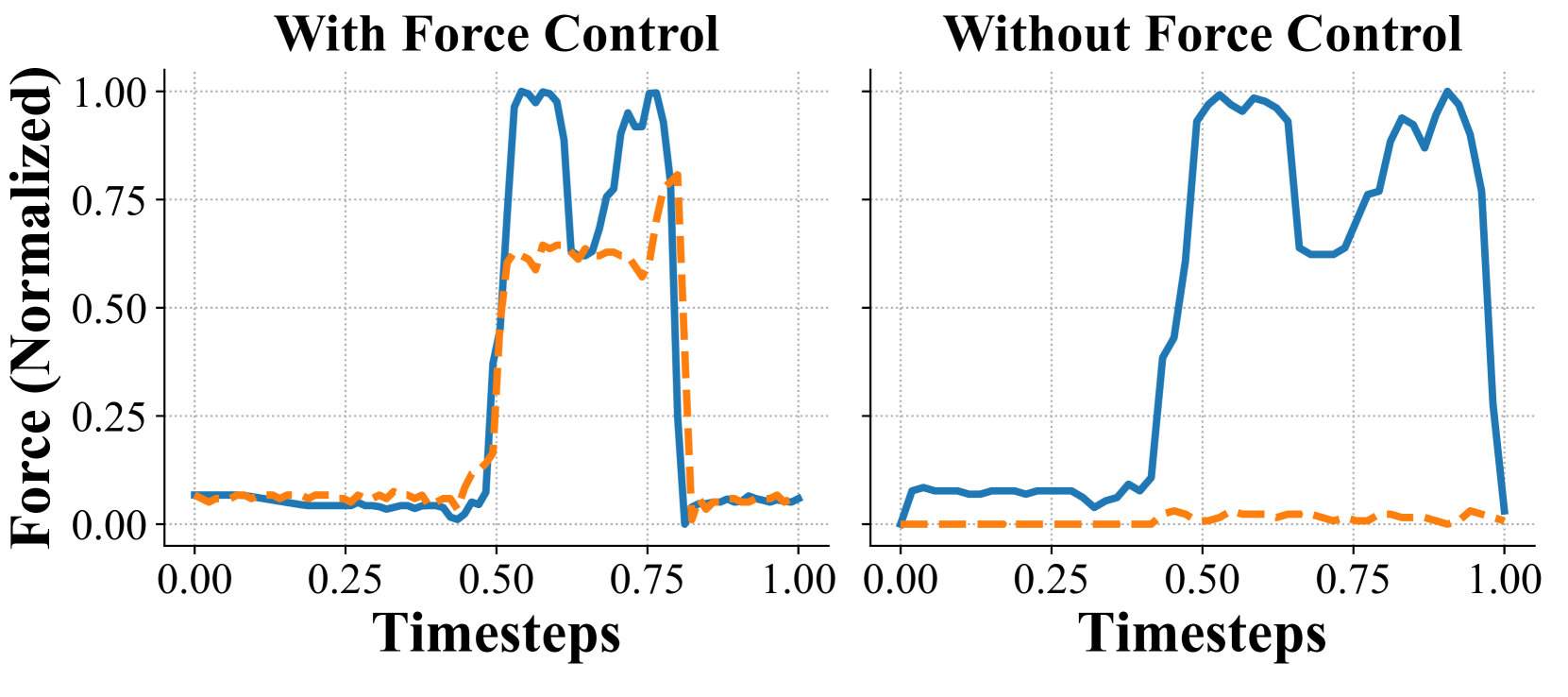

- 实验表明,KineDex在接触密集型任务中成功率达74.4%,相比无力控制提升57.7%,数据收集效率是遥操作的两倍。

📝 摘要(中文)

对于灵巧操作而言,特别是那些需要精确力控制和物理交互的接触密集型任务,收集富含细粒度触觉信息的演示至关重要。现有方法主要集中在遥操作或基于视频的重定向,但它们常常受到运动学不匹配和缺乏实时触觉反馈的困扰,阻碍了高保真触觉数据的获取。为了缓解这个问题,我们提出了KineDex,一种手把手的动觉示教范式,其中操作者的运动直接传递到灵巧手,从而能够收集具有精确触觉反馈的物理基础演示。为了解决人手造成的遮挡,我们应用图像修复技术来预处理视觉观察。基于这些演示,我们使用触觉增强的输入来训练视觉运动策略,并在部署期间实施力控制,以实现精确的接触密集型操作。我们在一系列具有挑战性的接触密集型操作任务上评估了KineDex,包括特别困难的场景,例如将牙膏挤到牙刷上,这需要精确的多指协调和稳定的力调节。在这些任务中,KineDex实现了平均74.4%的成功率,比没有力控制的变体提高了57.7%。与遥操作的比较实验和用户研究进一步验证了KineDex在数据收集效率和可操作性方面的优势。具体而言,KineDex在两个不同难度的任务中收集数据的速度是遥操作的两倍多,同时保持了接近100%的成功率,而遥操作的成功率低于50%。

🔬 方法详解

问题定义:论文旨在解决接触密集型灵巧操作任务中,难以获取高质量触觉数据的问题。现有遥操作方法存在运动学不匹配和缺乏实时触觉反馈的痛点,导致策略学习效果不佳。

核心思路:论文的核心思路是通过动觉示教,即手把手地引导机器人完成任务,直接将操作者的运动传递给灵巧手,从而获得具有精确触觉反馈的演示数据。这种方式能够避免运动学不匹配,并提供实时的触觉信息,为后续策略学习提供高质量的数据基础。

技术框架:KineDex的技术框架主要包含三个阶段:1)数据收集阶段:通过手把手的动觉示教,记录灵巧手的运动轨迹和触觉传感器数据,并使用图像修复技术处理视觉遮挡问题。2)策略学习阶段:利用收集到的数据,训练一个视觉运动策略,该策略以视觉输入和触觉输入为输入,输出灵巧手的控制指令。3)部署阶段:在实际任务中,使用训练好的策略控制灵巧手完成操作,并结合力控制算法,实现精确的接触密集型操作。

关键创新:KineDex的关键创新在于提出了一种基于动觉示教的触觉数据收集方法。与传统的遥操作或视频重定向方法相比,KineDex能够直接获取物理基础的、具有精确触觉反馈的演示数据,从而避免了运动学不匹配和触觉信息缺失的问题。此外,论文还结合了图像修复技术和力控制算法,进一步提高了系统的性能。

关键设计:在数据收集阶段,论文使用了手把手的动觉示教方式,并记录了灵巧手的运动轨迹和触觉传感器数据。为了解决人手造成的视觉遮挡问题,论文采用了图像修复技术,例如Contextual Attention机制,来填充被遮挡的区域。在策略学习阶段,论文使用了触觉增强的输入,即将触觉传感器数据与视觉输入相结合,作为策略网络的输入。在部署阶段,论文结合了力控制算法,例如阻抗控制,来精确控制灵巧手与环境的交互力。

🖼️ 关键图片

📊 实验亮点

KineDex在接触密集型操作任务中表现出色,平均成功率达到74.4%,相比于没有力控制的变体提升了57.7%。与遥操作相比,KineDex的数据收集速度快两倍以上,同时保持了接近100%的成功率,而遥操作的成功率低于50%。这些结果表明,KineDex在数据收集效率和操作性能方面具有显著优势。

🎯 应用场景

KineDex技术可应用于各种需要精细操作和力控制的场景,如医疗手术、精密装配、食品加工等。通过动觉示教,可以快速训练机器人完成复杂任务,降低开发成本,提高生产效率。该研究为机器人灵巧操作领域提供了新的思路,有望推动机器人技术在更多领域的应用。

📄 摘要(原文)

Collecting demonstrations enriched with fine-grained tactile information is critical for dexterous manipulation, particularly in contact-rich tasks that require precise force control and physical interaction. While prior works primarily focus on teleoperation or video-based retargeting, they often suffer from kinematic mismatches and the absence of real-time tactile feedback, hindering the acquisition of high-fidelity tactile data. To mitigate this issue, we propose KineDex, a hand-over-hand kinesthetic teaching paradigm in which the operator's motion is directly transferred to the dexterous hand, enabling the collection of physically grounded demonstrations enriched with accurate tactile feedback. To resolve occlusions from human hand, we apply inpainting technique to preprocess the visual observations. Based on these demonstrations, we then train a visuomotor policy using tactile-augmented inputs and implement force control during deployment for precise contact-rich manipulation. We evaluate KineDex on a suite of challenging contact-rich manipulation tasks, including particularly difficult scenarios such as squeezing toothpaste onto a toothbrush, which require precise multi-finger coordination and stable force regulation. Across these tasks, KineDex achieves an average success rate of 74.4%, representing a 57.7% improvement over the variant without force control. Comparative experiments with teleoperation and user studies further validate the advantages of KineDex in data collection efficiency and operability. Specifically, KineDex collects data over twice as fast as teleoperation across two tasks of varying difficulty, while maintaining a near-100% success rate, compared to under 50% for teleoperation.