ReLI: A Language-Agnostic Approach to Human-Robot Interaction

作者: Linus Nwankwo, Bjoern Ellensohn, Ozan Özdenizci, Elmar Rueckert

分类: cs.RO

发布日期: 2025-05-03 (更新: 2025-10-06)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出ReLI,一种语言无关的人机交互方法,提升多语言环境下的机器人任务执行能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 语言无关 跨语言 机器人控制 预训练模型

📋 核心要点

- 现有机器人交互方法难以处理多语言环境,限制了其在全球范围内的应用。

- ReLI通过将预训练模型转化为语言到动作模型,实现跨语言的常识推理和机器人控制。

- 实验证明ReLI在140种语言的指令解析和任务执行中表现出色,平均准确率超过90%。

📝 摘要(中文)

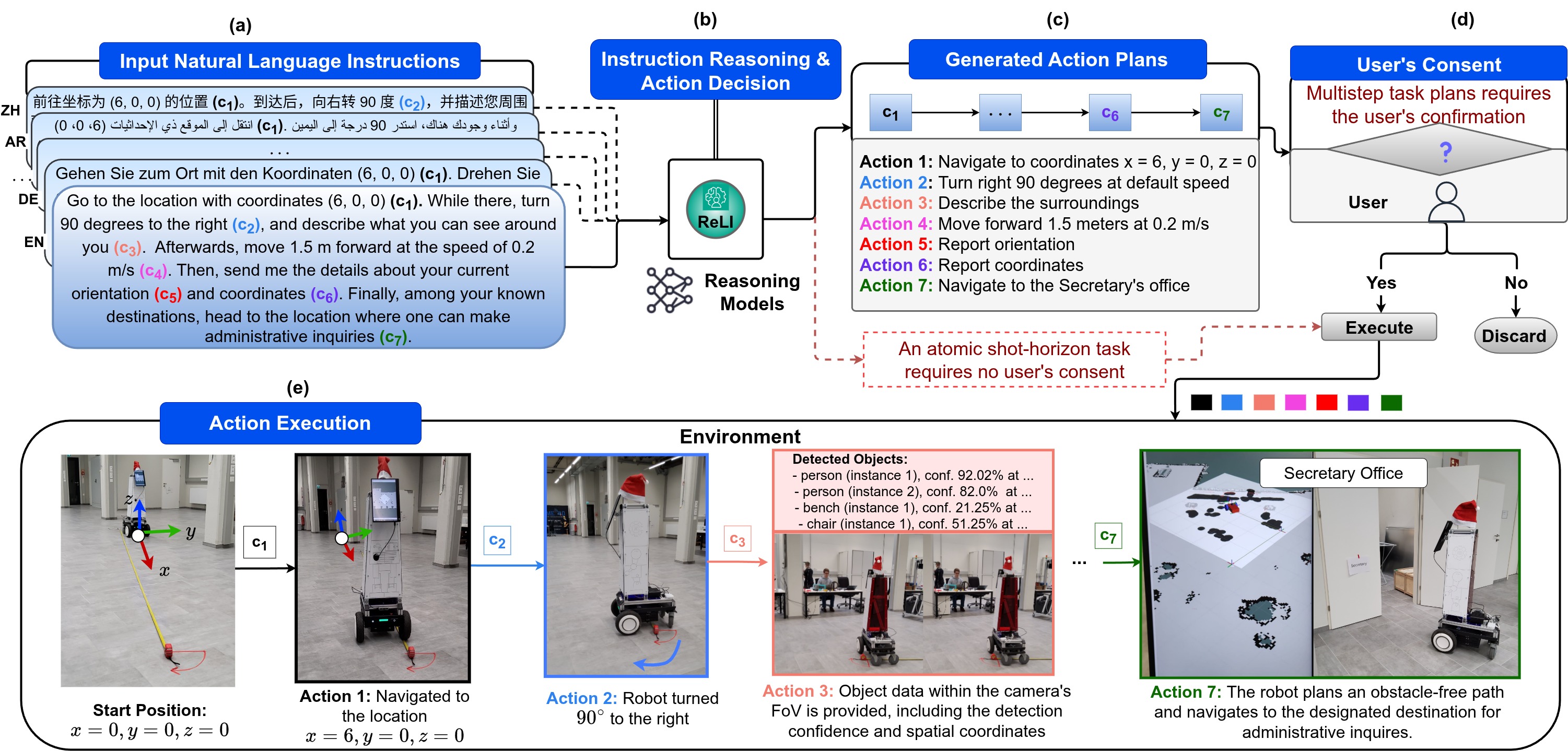

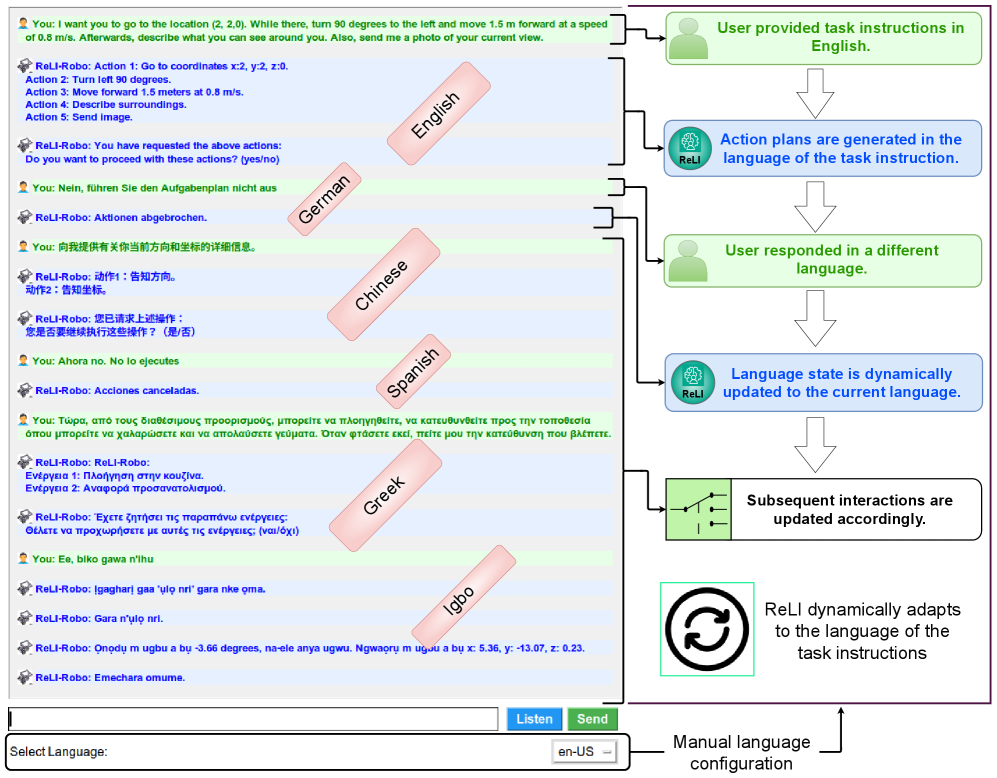

本文提出了一种语言无关的人机交互方法ReLI,旨在使自主智能体能够在全球或跨语言应用环境中,与环境进行有效交互,并执行人类指定的任务,而无需考虑任务指令的模态或语言来源。ReLI通过融合大规模预训练模型,将其转化为语言到动作模型,从而实现常识推理和高级机器人控制。此外,ReLI还进行了跨语言适配,以确保其在全球语言中的泛化能力。实验结果表明,ReLI在零样本和少样本空间导航、场景信息检索和查询导向任务等多种短程和长程任务中表现出强大的鲁棒性。在包含140种语言和超过7万次多轮对话的测试中,ReLI在跨语言指令解析和任务执行成功率方面平均达到90%±0.2的准确率。这表明ReLI有潜力推动自然人机交互在现实世界中的发展,同时倡导包容性和语言多样性。

🔬 方法详解

问题定义:现有的人机交互系统在跨语言环境中表现不佳,无法理解和执行不同语言的任务指令。这限制了机器人在全球范围内的应用,尤其是在需要与来自不同文化背景的人进行交互的场景中。现有的方法通常依赖于特定语言的训练数据,难以泛化到其他语言,或者需要大量的标注数据进行微调,成本高昂。

核心思路:ReLI的核心思路是利用大规模预训练的语言模型,通过跨语言适配,使其能够理解和执行各种语言的任务指令,而无需针对每种语言进行单独训练。通过将语言模型与机器人控制模块相结合,ReLI能够将自然语言指令转化为机器人可以执行的动作序列。这种方法的核心优势在于其语言无关性和泛化能力。

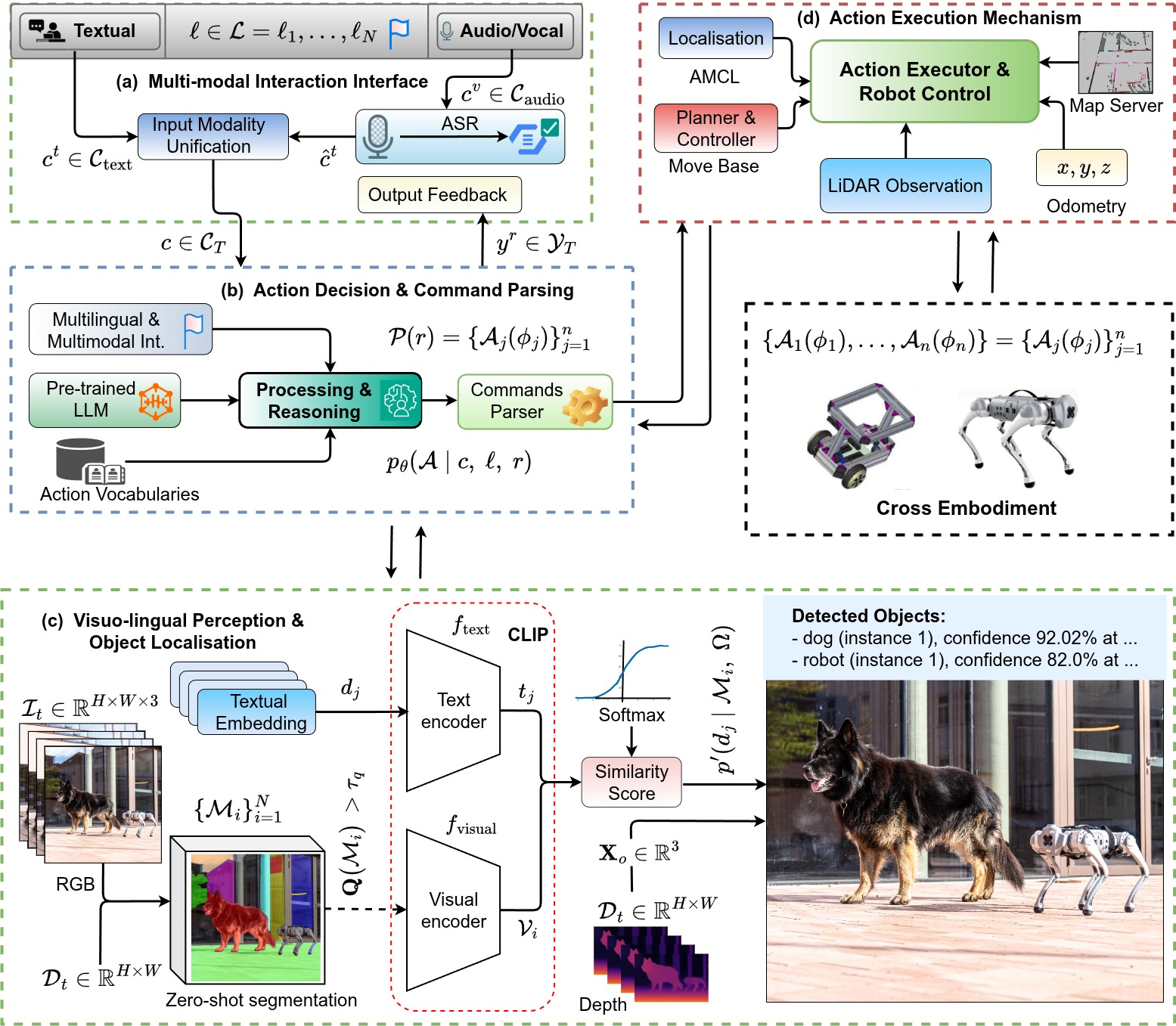

技术框架:ReLI的技术框架主要包括以下几个模块:1) 语言理解模块:使用预训练的语言模型(如BERT或GPT)对输入的自然语言指令进行解析,提取任务相关的语义信息。2) 跨语言适配模块:通过翻译或嵌入空间对齐等技术,将不同语言的指令映射到统一的语义空间,实现跨语言的理解。3) 动作规划模块:根据语义信息和环境信息,生成机器人可以执行的动作序列。4) 机器人控制模块:将动作序列转化为具体的机器人控制指令,驱动机器人执行任务。

关键创新:ReLI最重要的技术创新点在于其语言无关性。通过跨语言适配,ReLI能够理解和执行各种语言的任务指令,而无需针对每种语言进行单独训练。这大大降低了开发和部署成本,并提高了系统的泛化能力。此外,ReLI还能够进行常识推理,从而更好地理解人类的意图,并生成更合理的动作序列。

关键设计:ReLI的关键设计包括:1) 使用大规模预训练的语言模型,以获得强大的语言理解能力。2) 采用跨语言嵌入空间对齐技术,将不同语言的指令映射到统一的语义空间。3) 设计了一种基于规则和学习的混合动作规划方法,以生成更合理的动作序列。4) 使用强化学习对机器人控制模块进行训练,以提高任务执行的成功率。

🖼️ 关键图片

📊 实验亮点

ReLI在包含140种语言和超过7万次多轮对话的测试中表现出色,在跨语言指令解析和任务执行成功率方面平均达到90%±0.2的准确率。这表明ReLI具有强大的跨语言泛化能力和鲁棒性。此外,ReLI在零样本和少样本空间导航、场景信息检索和查询导向任务等多种短程和长程任务中均取得了良好的效果,证明了其在实际应用中的潜力。

🎯 应用场景

ReLI的应用场景广泛,包括工业自动化、家庭服务、医疗保健等领域。例如,在工业自动化中,ReLI可以使工人使用自然语言指令控制机器人完成复杂的装配任务,而无需学习特定的编程语言。在家庭服务中,ReLI可以使老年人或残疾人通过语音指令控制机器人完成家务,提高生活质量。在医疗保健领域,ReLI可以使医生或护士通过语音指令控制机器人进行手术或护理,提高工作效率和安全性。

📄 摘要(原文)

Adapting autonomous agents for real-world industrial, domestic, and other daily tasks is currently gaining momentum. However, in global or cross-lingual application contexts, ensuring effective interaction with the environment and executing unrestricted human-specified tasks regardless of the language remains an unsolved problem. To address this, we propose ReLI, a language-agnostic approach that enables autonomous agents to converse naturally, semantically reason about their environment, and perform downstream tasks, regardless of the task instruction's modality or linguistic origin. First, we ground large-scale pre-trained foundation models and transform them into language-to-action models that can directly provide common-sense reasoning and high-level robot control through natural, free-flow conversational interactions. Further, we perform cross-lingual adaptation of the models to ensure that ReLI generalises across the global languages. To demonstrate ReLI's robustness, we conducted extensive experiments on various short- and long-horizon tasks, including zero- and few-shot spatial navigation, scene information retrieval, and query-oriented tasks. We benchmarked the performance on $140$ languages involving $70K+$ multi-turn conversations. On average, ReLI achieved over $90\%\pm0.2$ accuracy in cross-lingual instruction parsing and task execution success. These results demonstrate its potential to advance natural human-agent interaction in the real world while championing inclusive and linguistic diversity. Demos and resources will be public at: https://linusnep.github.io/ReLI/.