DeCo: Task Decomposition and Skill Composition for Zero-Shot Generalization in Long-Horizon 3D Manipulation

作者: Zixuan Chen, Junhui Yin, Yangtao Chen, Jing Huo, Pinzhuo Tian, Jieqi Shi, Yiwen Hou, Yinchuan Li, Yang Gao

分类: cs.RO

发布日期: 2025-05-01

💡 一句话要点

DeCo:通过任务分解与技能组合实现长时程3D操作中的零样本泛化

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 任务分解 技能组合 零样本泛化 长时程操作 模仿学习 视觉-语言模型 3D操作

📋 核心要点

- 现有语言条件多任务模仿学习模型在处理新的长时程3D操作任务时,泛化能力不足,面临显著挑战。

- DeCo框架通过将任务分解为原子技能,并利用视觉-语言模型进行技能检索和动态调度,实现零样本泛化。

- 实验表明,DeCo显著提升了现有模仿学习模型在模拟和真实环境中的成功率,尤其是在组合任务上。

📝 摘要(中文)

本文提出DeCo(任务分解与技能组合),一个与模型无关的框架,旨在增强多任务模仿学习(IL)模型在新的、组合的、长时程3D操作任务中的零样本泛化能力。DeCo首先基于机械臂与物体之间的物理交互将IL演示分解为一组模块化的原子任务,并构建原子训练数据集,使模型能够在模仿学习期间学习各种可重用的原子技能。在推理时,DeCo利用视觉-语言模型(VLM)解析新长时程任务的高级指令,检索相关的原子技能,并动态调度它们的执行;一个空间感知技能链模块确保顺序技能之间平滑、无碰撞的过渡。在DeCoBench(一个专门用于评估多任务IL模型在组合长时程3D操作中零样本泛化的基准)上评估了DeCo。在三个代表性的多任务IL模型(RVT-2、3DDA和ARP)上,DeCo在12个新的组合任务上分别实现了66.67%、21.53%和57.92%的成功率提升。此外,在真实世界的实验中,一个仅在6个原子任务上训练的DeCo增强模型成功完成了9个新的长时程任务,与基础多任务IL模型相比,平均成功率提高了53.33%。

🔬 方法详解

问题定义:论文旨在解决语言条件多任务模仿学习模型在长时程3D操作任务中零样本泛化能力不足的问题。现有方法难以处理新的、组合的任务,因为它们通常缺乏对任务结构的理解和对原子操作的建模。

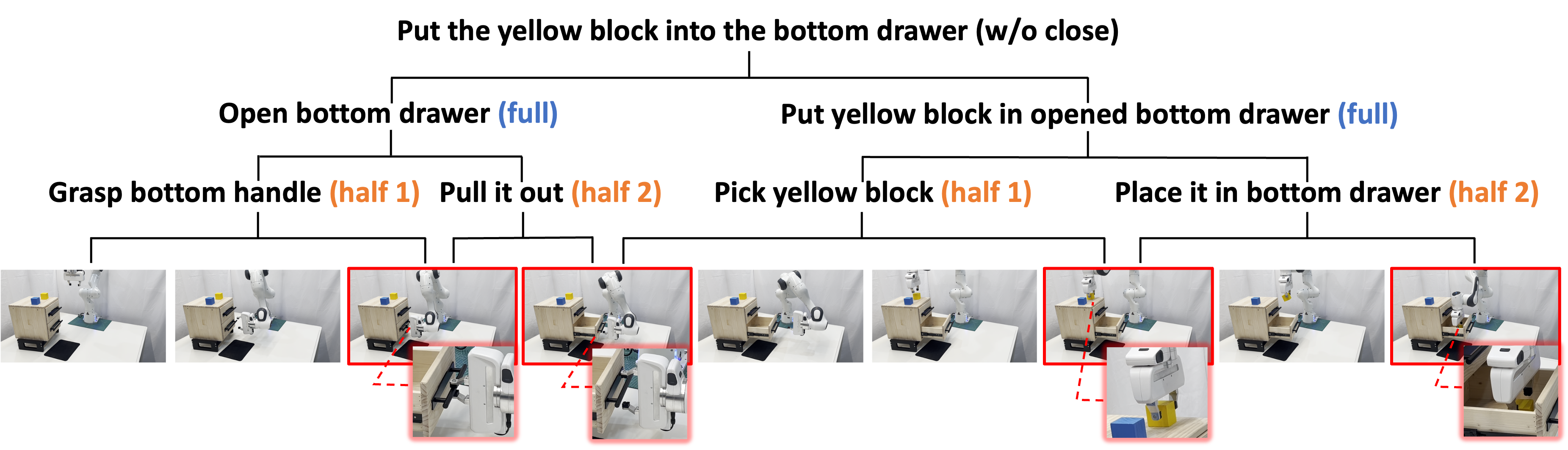

核心思路:论文的核心思路是将复杂的长时程任务分解为一系列可重用的原子技能,并利用视觉-语言模型理解任务指令,从而动态地组合这些技能以完成新任务。这种分解和组合的方式使得模型能够更好地泛化到未见过的任务。

技术框架:DeCo框架包含三个主要模块:1) 任务分解模块:将模仿学习的演示数据分解为原子任务,构建原子训练数据集。2) 技能检索与调度模块:利用视觉-语言模型解析高级指令,检索相关的原子技能,并动态地安排它们的执行顺序。3) 空间感知技能链模块:确保顺序技能之间平滑、无碰撞的过渡。

关键创新:DeCo的关键创新在于其任务分解和技能组合的策略,以及利用视觉-语言模型进行技能检索和调度的能力。与传统的端到端模仿学习方法不同,DeCo能够显式地建模原子操作,并根据任务指令动态地组合这些操作,从而提高了泛化能力。

关键设计:任务分解基于机械臂与物体之间的物理交互。技能检索与调度模块使用预训练的视觉-语言模型(VLM)来理解任务指令,并根据指令的语义信息检索相关的原子技能。空间感知技能链模块通过优化机械臂的运动轨迹,确保技能之间的平滑过渡,避免碰撞。

🖼️ 关键图片

📊 实验亮点

DeCo在DeCoBench基准测试中,显著提升了RVT-2、3DDA和ARP等模型的性能,成功率分别提高了66.67%、21.53%和57.92%。在真实世界的实验中,仅在6个原子任务上训练的DeCo增强模型,成功完成了9个新的长时程任务,平均成功率提高了53.33%。这些结果表明DeCo具有很强的泛化能力和实用价值。

🎯 应用场景

DeCo框架具有广泛的应用前景,例如在机器人自动化、智能制造、家庭服务机器人等领域。它可以用于训练机器人执行复杂的装配、操作和导航任务,尤其是在需要处理多种不同任务和环境的情况下。该研究有助于提升机器人的智能化水平和适应性,使其能够更好地服务于人类。

📄 摘要(原文)

Generalizing language-conditioned multi-task imitation learning (IL) models to novel long-horizon 3D manipulation tasks remains a significant challenge. To address this, we propose DeCo (Task Decomposition and Skill Composition), a model-agnostic framework compatible with various multi-task IL models, designed to enhance their zero-shot generalization to novel, compositional, long-horizon 3D manipulation tasks. DeCo first decomposes IL demonstrations into a set of modular atomic tasks based on the physical interaction between the gripper and objects, and constructs an atomic training dataset that enables models to learn a diverse set of reusable atomic skills during imitation learning. At inference time, DeCo leverages a vision-language model (VLM) to parse high-level instructions for novel long-horizon tasks, retrieve the relevant atomic skills, and dynamically schedule their execution; a spatially-aware skill-chaining module then ensures smooth, collision-free transitions between sequential skills. We evaluate DeCo in simulation using DeCoBench, a benchmark specifically designed to assess zero-shot generalization of multi-task IL models in compositional long-horizon 3D manipulation. Across three representative multi-task IL models (RVT-2, 3DDA, and ARP), DeCo achieves success rate improvements of 66.67%, 21.53%, and 57.92%, respectively, on 12 novel compositional tasks. Moreover, in real-world experiments, a DeCo-enhanced model trained on only 6 atomic tasks successfully completes 9 novel long-horizon tasks, yielding an average success rate improvement of 53.33% over the base multi-task IL model. Video demonstrations are available at: https://deco226.github.io.