Dexonomy: Synthesizing All Dexterous Grasp Types in a Grasp Taxonomy

作者: Jiayi Chen, Yubin Ke, Lin Peng, He Wang

分类: cs.RO, cs.CV

发布日期: 2025-04-26 (更新: 2025-09-03)

备注: Accepted by Robotics: Science and Systems (RSS 2025)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

Dexonomy:合成抓取分类法中所有灵巧抓取类型,解决数据匮乏问题。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 灵巧抓取 抓取合成 机器人操作 数据集生成 接触感知控制

📋 核心要点

- 现有自动抓取合成方法通常局限于特定抓取类型或物体类别,难以扩展到大规模数据集,阻碍了通用灵巧抓取的学习。

- 该论文提出一种两阶段抓取合成流程,首先优化物体适应手模板,然后局部优化手适应物体,从而生成高质量的抓取数据。

- 实验表明,该方法优于现有基线,并构建了一个包含31种抓取类型、10.7k个物体和9.5M个抓取的数据库,真实世界抓取成功率达82.3%。

📝 摘要(中文)

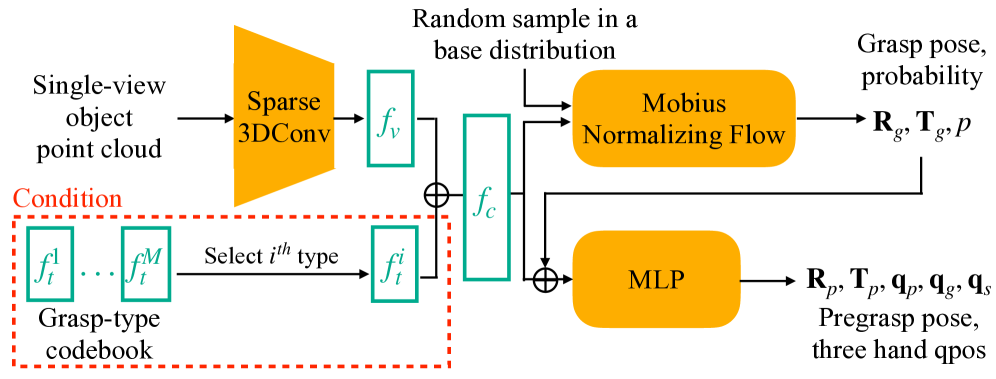

本文提出了一种高效的流程,能够为任何抓取类型、物体和关节手合成具有丰富接触、无穿透且物理上合理的抓取。该流程从每个人手和抓取类型的单个人工标注模板开始,分两个阶段解决复杂的合成问题:首先优化物体以适应手模板,然后在仿真中局部细化手以适应物体。为了验证合成的抓取,引入了一种接触感知控制策略,允许手在每个接触点对物体施加适当的力。这些经过验证的抓取也可以用作新的抓取模板,以促进未来的合成。实验表明,该方法在仿真中显著优于以前的类型无关抓取合成基线。使用该算法,构建了一个包含10.7k个物体和9.5M个抓取的数据库,涵盖GRASP分类法中的31种抓取类型。最后,训练了一个类型条件生成模型,该模型成功地从单视角物体点云执行所需的抓取类型,在真实世界实验中实现了82.3%的成功率。

🔬 方法详解

问题定义:现有的抓取合成方法通常只能处理特定的抓取类型或物体类别,难以扩展到大规模、多样化的数据集。这限制了机器人学习通用灵巧抓取的能力。因此,需要一种能够为各种物体和抓取类型自动生成高质量抓取数据的有效方法。

核心思路:该论文的核心思路是从少量人工标注的抓取模板出发,通过优化物体和手部的姿态,使其相互适应,从而合成大量的抓取数据。这种方法利用了人工标注的先验知识,并结合了物理仿真,保证了合成抓取的合理性和可行性。

技术框架:该方法包含两个主要阶段:1) 物体适应手模板:首先,固定手部的姿态,优化物体的位姿,使其尽可能地与手部接触,并满足一定的约束条件。2) 手部局部优化:然后,固定物体的位姿,局部调整手部的关节角度,进一步优化抓取的质量,例如增加接触面积、减小穿透等。为了验证抓取的质量,还引入了一个接触感知控制策略,模拟手部对物体施加力,检查抓取的稳定性。

关键创新:该方法最重要的创新点在于其能够从少量人工标注的模板出发,自动生成大量高质量、多样化的抓取数据,覆盖了GRASP分类法中的多种抓取类型。这与以往的抓取合成方法只关注特定类型或物体不同,大大提高了数据的通用性和可用性。

关键设计:在物体适应手模板阶段,使用优化算法最小化物体与手部之间的距离,并施加避免穿透的约束。在手部局部优化阶段,使用强化学习或梯度下降等方法,调整手部的关节角度,最大化抓取的质量指标,例如接触面积、力闭合性等。接触感知控制策略使用力/位混合控制,根据接触点的法向力调整手部的关节力矩。

🖼️ 关键图片

📊 实验亮点

该论文构建了一个包含10.7k个物体和9.5M个抓取的数据库,涵盖GRASP分类法中的31种抓取类型。在仿真实验中,该方法显著优于之前的类型无关抓取合成基线。在真实世界实验中,使用该方法训练的类型条件生成模型,从单视角物体点云执行所需抓取类型的成功率达到了82.3%。

🎯 应用场景

该研究成果可广泛应用于机器人灵巧操作领域,例如工业自动化、家庭服务机器人等。通过使用该方法生成的大规模抓取数据集,可以训练更鲁棒、更通用的抓取模型,提高机器人在复杂环境中的操作能力。此外,该方法还可以用于设计新的灵巧手和抓取策略。

📄 摘要(原文)

Generalizable dexterous grasping with suitable grasp types is a fundamental skill for intelligent robots. Developing such skills requires a large-scale and high-quality dataset that covers numerous grasp types (i.e., at least those categorized by the GRASP taxonomy), but collecting such data is extremely challenging. Existing automatic grasp synthesis methods are often limited to specific grasp types or object categories, hindering scalability. This work proposes an efficient pipeline capable of synthesizing contact-rich, penetration-free, and physically plausible grasps for any grasp type, object, and articulated hand. Starting from a single human-annotated template for each hand and grasp type, our pipeline tackles the complicated synthesis problem with two stages: optimize the object to fit the hand template first, and then locally refine the hand to fit the object in simulation. To validate the synthesized grasps, we introduce a contact-aware control strategy that allows the hand to apply the appropriate force at each contact point to the object. Those validated grasps can also be used as new grasp templates to facilitate future synthesis. Experiments show that our method significantly outperforms previous type-unaware grasp synthesis baselines in simulation. Using our algorithm, we construct a dataset containing 10.7k objects and 9.5M grasps, covering 31 grasp types in the GRASP taxonomy. Finally, we train a type-conditional generative model that successfully performs the desired grasp type from single-view object point clouds, achieving an 82.3% success rate in real-world experiments. Project page: https://pku-epic.github.io/Dexonomy.