CIVIL: Causal and Intuitive Visual Imitation Learning

作者: Yinlong Dai, Robert Ramirez Sanchez, Ryan Jeronimus, Shahabedin Sagheb, Cara M. Nunez, Heramb Nemlekar, Dylan P. Losey

分类: cs.RO, cs.LG, eess.SY

发布日期: 2025-04-24 (更新: 2025-10-27)

💡 一句话要点

CIVIL:因果且直观的视觉模仿学习方法,提升机器人泛化能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 视觉模仿学习 因果推理 机器人学习 Transformer 数据增强

📋 核心要点

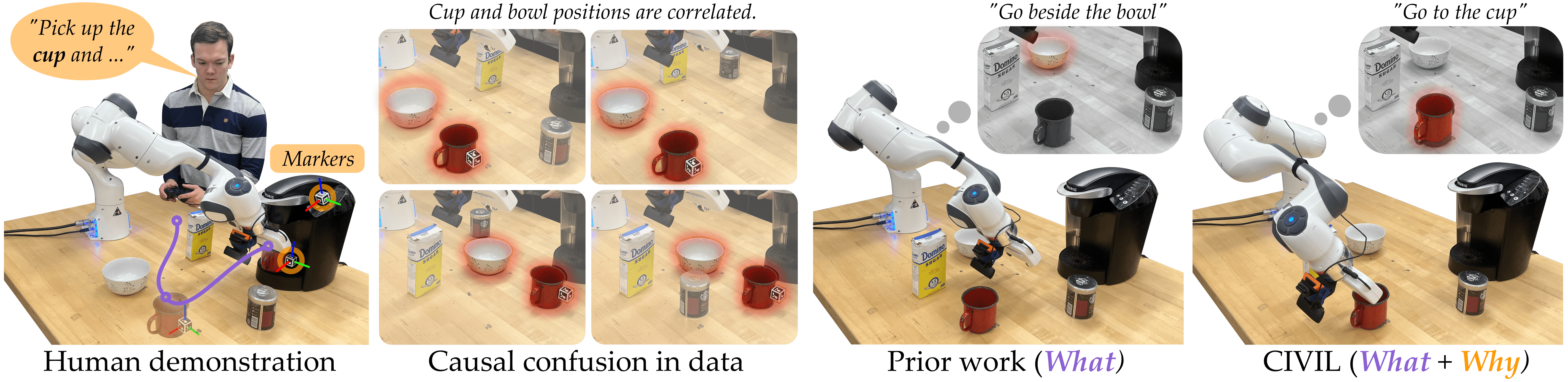

- 传统视觉模仿学习忽略了人类决策背后的因果关系,导致机器人易受干扰,泛化能力差。

- CIVIL方法允许人类教师通过标记和自然语言提示,直观地表达决策的原因,增强了演示数据。

- CIVIL通过过滤视觉观察并提取因果特征,训练出更鲁棒的Transformer策略,提升了性能和泛化能力。

📝 摘要(中文)

现有的机器人通过模仿人类示例来学习新任务。这些机器人观察人类完成任务,然后尝试匹配人类专家的行为。然而,这种标准的视觉模仿学习方法存在根本局限性:机器人观察到人类做了什么,但没有观察到人类为什么选择这些行为。如果不理解系统或环境的哪些特征影响了人类的决策,机器人学习者常常会误解人类的示例。实际上,这会导致因果混淆、低效学习以及在环境变化时机器人策略失效。因此,我们提出了一种视角的转变:除了要求人类教师展示机器人应该采取什么行动之外,我们还使人类能够直观地表明他们做出这些决定的原因。在我们的范例下,人类教师将标记附加到与任务相关的对象,并使用自然语言提示来描述他们的状态表示。我们提出的算法CIVIL利用这种增强的演示数据来过滤机器人的视觉观察,并提取与人类教师对齐的特征表示。然后,CIVIL应用这些因果特征来训练基于Transformer的策略,该策略在机器人上进行测试时,能够模拟人类行为,而不会被视觉干扰或不相关的项目所迷惑。我们的模拟和真实世界实验表明,使用CIVIL训练的机器人既能学习采取什么行动,又能学习为什么采取这些行动,从而获得比最先进的基线更好的性能。从人类的角度来看,我们的用户研究表明,这种新的训练范例实际上减少了机器人学习任务所需的总时间,并且还提高了机器人在以前未见过的场景中的性能。

🔬 方法详解

问题定义:现有视觉模仿学习方法主要依赖于观察人类的动作,而忽略了人类做出这些动作的原因。这导致机器人容易受到环境中无关因素的干扰,产生因果混淆,从而导致学习效率低下,并且在新的环境中泛化能力较差。因此,需要一种方法能够让机器人理解人类行为背后的因果关系,从而提高其学习效率和泛化能力。

核心思路:CIVIL的核心思路是通过增强人类的演示数据,让人类教师不仅展示机器人应该采取的行动,还直观地表明他们做出这些决定的原因。具体来说,人类教师可以通过在与任务相关的对象上添加标记,并使用自然语言提示来描述他们的状态表示,从而向机器人传达哪些因素是决策的关键。这样,机器人就可以学习到人类行为背后的因果关系,而不是简单地模仿人类的动作。

技术框架:CIVIL的整体框架包括以下几个主要模块:1) 数据增强模块:允许人类教师通过标记和自然语言提示来增强演示数据。2) 特征提取模块:利用增强的演示数据来过滤机器人的视觉观察,并提取与人类教师对齐的因果特征表示。3) 策略学习模块:使用提取的因果特征来训练基于Transformer的策略。该策略能够根据当前状态选择合适的动作。

关键创新:CIVIL最重要的创新点在于它引入了一种新的视觉模仿学习范式,即让人类教师不仅展示机器人应该采取的行动,还直观地表明他们做出这些决定的原因。这种方法能够让机器人学习到人类行为背后的因果关系,从而提高其学习效率和泛化能力。与现有方法相比,CIVIL能够更好地处理环境中的干扰因素,并且在新的环境中表现出更强的鲁棒性。

关键设计:CIVIL的关键设计包括:1) 使用Transformer作为策略学习模块,Transformer具有强大的序列建模能力,能够有效地学习人类行为的模式。2) 设计了一种损失函数,鼓励机器人学习到的特征表示与人类教师的特征表示对齐。3) 采用数据增强技术,增加训练数据的多样性,提高模型的泛化能力。具体参数设置和网络结构细节在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用CIVIL训练的机器人能够更好地模拟人类行为,并且在存在视觉干扰的情况下表现出更强的鲁棒性。与最先进的基线方法相比,CIVIL在模拟和真实世界实验中都取得了显著的性能提升。用户研究表明,CIVIL不仅提高了机器人的性能,还减少了机器人学习任务所需的总时间,并且提高了机器人在以前未见过的场景中的性能。

🎯 应用场景

CIVIL方法具有广泛的应用前景,可以应用于各种需要机器人模仿人类行为的场景,例如:家庭服务机器人、工业机器人、医疗机器人等。通过CIVIL方法,可以使机器人更好地理解人类的意图,从而更有效地完成任务。此外,CIVIL方法还可以用于训练自动驾驶汽车,使其能够更好地理解人类驾驶员的行为,从而提高驾驶安全性。

📄 摘要(原文)

Today's robots attempt to learn new tasks by imitating human examples. These robots watch the human complete the task, and then try to match the actions taken by the human expert. However, this standard approach to visual imitation learning is fundamentally limited: the robot observes what the human does, but not why the human chooses those behaviors. Without understanding which features of the system or environment factor into the human's decisions, robot learners often misinterpret the human's examples. In practice, this results in causal confusion, inefficient learning, and robot policies that fail when the environment changes. We therefore propose a shift in perspective: instead of asking human teachers just to show what actions the robot should take, we also enable humans to intuitively indicate why they made those decisions. Under our paradigm human teachers attach markers to task-relevant objects and use natural language prompts to describe their state representation. Our proposed algorithm, CIVIL, leverages this augmented demonstration data to filter the robot's visual observations and extract a feature representation that aligns with the human teacher. CIVIL then applies these causal features to train a transformer-based policy that -- when tested on the robot -- is able to emulate human behaviors without being confused by visual distractors or irrelevant items. Our simulations and real-world experiments demonstrate that robots trained with CIVIL learn both what actions to take and why to take those actions, resulting in better performance than state-of-the-art baselines. From the human's perspective, our user study reveals that this new training paradigm actually reduces the total time required for the robot to learn the task, and also improves the robot's performance in previously unseen scenarios. See videos at our project website: https://civil2025.github.io