Unreal Robotics Lab: A High-Fidelity Robotics Simulator with Advanced Physics and Rendering

作者: Jonathan Embley-Riches, Jianwei Liu, Simon Julier, Dimitrios Kanoulas

分类: cs.RO, cs.CV, cs.GR, cs.LG

发布日期: 2025-04-19 (更新: 2025-11-23)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出Unreal Robotics Lab,融合虚幻引擎与MuJoCo,实现高保真机器人仿真。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人仿真 虚幻引擎 MuJoCo 高保真渲染 物理仿真 视觉导航 SLAM

📋 核心要点

- 现有机器人仿真难以兼顾逼真的渲染效果和精确的物理建模,限制了感知算法的测试。

- URL框架融合虚幻引擎的渲染能力和MuJoCo的物理引擎,旨在提供高保真、高性能的仿真环境。

- 实验验证了URL框架在视觉导航和SLAM等任务中的有效性,并支持复杂环境效果的模拟。

📝 摘要(中文)

本文提出了一种新的仿真框架Unreal Robotics Lab (URL),它集成了虚幻引擎的先进渲染能力和MuJoCo的高精度物理仿真。该方法在保持精确物理交互的同时,实现了逼真的机器人感知,从而促进了基于视觉的机器人应用的基准测试和数据集生成。该系统支持复杂的环境效果,如烟雾、火焰和水动力学,这对于评估机器人在不利条件下的性能至关重要。我们在框架内对视觉导航和SLAM方法进行了基准测试,证明了其在受控但多样化的场景中测试真实世界鲁棒性的效用。通过弥合物理精度和照片级渲染之间的差距,我们的框架为推进机器人研究和sim-to-real迁移提供了一个强大的工具。我们的开源框架可在https://unrealroboticslab.github.io/上获取。

🔬 方法详解

问题定义:机器人研究需要高保真仿真环境,以便安全有效地测试感知、控制和导航算法。然而,现有仿真器通常难以同时实现逼真的渲染效果和精确的物理建模。这限制了基于视觉的机器人算法的开发和测试,尤其是在复杂和动态的环境中。现有方法的痛点在于,要么物理精度不足,要么渲染效果不佳,难以满足实际应用的需求。

核心思路:URL的核心思路是将虚幻引擎的强大渲染能力与MuJoCo的高精度物理引擎相结合,从而创建一个既能提供逼真视觉效果,又能保证物理交互准确性的仿真环境。通过这种方式,可以更有效地开发和测试基于视觉的机器人算法,并促进sim-to-real的迁移。

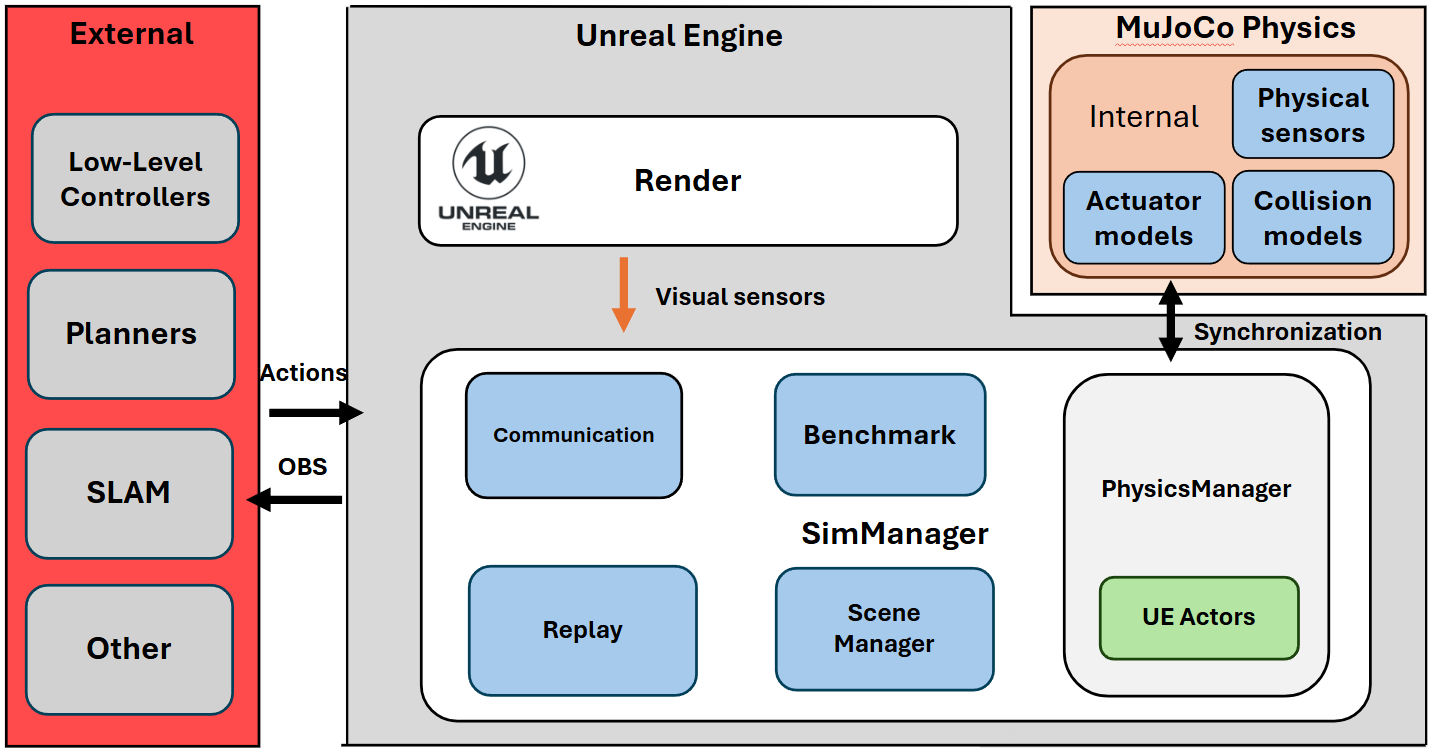

技术框架:URL框架主要包含两个核心模块:虚幻引擎(Unreal Engine)和MuJoCo物理引擎。虚幻引擎负责渲染逼真的场景和视觉效果,包括光照、纹理、阴影以及复杂的环境效果(如烟雾、火焰和水动力学)。MuJoCo负责模拟机器人的物理运动和环境交互,保证物理仿真的准确性和实时性。这两个模块通过特定的接口进行通信,实现数据同步和信息交换。整体流程包括场景初始化、机器人控制、物理仿真、渲染以及数据采集等步骤。

关键创新:URL最重要的技术创新点在于将虚幻引擎的渲染能力与MuJoCo的物理引擎进行了深度集成,从而在机器人仿真领域实现了高保真度的突破。与现有方法相比,URL不仅提供了更逼真的视觉效果,而且保证了物理交互的准确性,从而更真实地模拟了现实世界的环境和机器人行为。

关键设计:URL的关键设计包括:1) 虚幻引擎的渲染设置,例如光照模型、材质属性和后期处理效果,以实现逼真的视觉效果;2) MuJoCo的物理参数设置,例如摩擦系数、碰撞模型和关节约束,以保证物理仿真的准确性;3) 虚幻引擎和MuJoCo之间的数据同步机制,以确保视觉信息和物理状态的一致性;4) 支持复杂环境效果的模拟,例如烟雾、火焰和水动力学,以评估机器人在不利条件下的性能。

🖼️ 关键图片

📊 实验亮点

论文通过在URL框架中对视觉导航和SLAM方法进行基准测试,验证了其有效性。实验结果表明,URL能够提供足够逼真的视觉信息和准确的物理交互,从而有效地评估机器人在复杂环境中的性能。该框架支持模拟各种环境效果,如烟雾、火焰和水动力学,为评估机器人在不利条件下的鲁棒性提供了可能。

🎯 应用场景

URL框架可广泛应用于机器人感知、控制和导航算法的开发与测试,尤其适用于需要高保真视觉信息的场景,如自动驾驶、无人机巡检、灾难救援等。该框架能够生成大规模、多样化的训练数据集,促进深度学习模型的训练和优化。此外,URL还可用于评估机器人在复杂和动态环境中的鲁棒性,为实际部署提供可靠的保障。

📄 摘要(原文)

High-fidelity simulation is essential for robotics research, enabling safe and efficient testing of perception, control, and navigation algorithms. However, achieving both photorealistic rendering and accurate physics modeling remains a challenge. This paper presents a novel simulation framework, the Unreal Robotics Lab (URL), that integrates the advanced rendering capabilities of the Unreal Engine with MuJoCo's high-precision physics simulation. Our approach enables realistic robotic perception while maintaining accurate physical interactions, facilitating benchmarking and dataset generation for vision-based robotics applications. The system supports complex environmental effects, such as smoke, fire, and water dynamics, which are critical to evaluating robotic performance under adverse conditions. We benchmark visual navigation and SLAM methods within our framework, demonstrating its utility for testing real-world robustness in controlled yet diverse scenarios. By bridging the gap between physics accuracy and photorealistic rendering, our framework provides a powerful tool for advancing robotics research and sim-to-real transfer. Our open-source framework is available at https://unrealroboticslab.github.io/.