SLAM&Render: A Benchmark for the Intersection Between Neural Rendering, Gaussian Splatting and SLAM

作者: Samuel Cerezo, Gaetano Meli, Tomás Berriel Martins, Kirill Safronov, Javier Civera

分类: cs.RO, cs.CV

发布日期: 2025-04-18 (更新: 2026-01-09)

备注: 9 pages, 8 figures, submitted to The International Journal of Robotics Research (IJRR)

💡 一句话要点

SLAM&Render:用于神经渲染、高斯溅射和SLAM交叉研究的基准数据集

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: SLAM 神经渲染 高斯溅射 基准数据集 机器人 RGB-D IMU 位姿估计

📋 核心要点

- 现有数据集难以满足神经渲染和SLAM交叉领域的需求,缺乏序列操作、多模态数据和视角/光照泛化等挑战。

- SLAM&Render数据集利用机器人手臂精确控制传感器运动,提供时间同步的RGB-D图像、IMU数据、机器人运动学数据和ground-truth位姿。

- 实验结果验证了SLAM&Render数据集作为神经渲染、高斯溅射和SLAM交叉领域基准的有效性。

📝 摘要(中文)

本文提出了SLAM&Render,一个用于评估神经辐射场(NeRF)和高斯溅射等方法在SLAM中应用的基准数据集。现有数据集缺乏SLAM的序列操作、多模态特性以及神经渲染的视角泛化和光照泛化等挑战。此外,现有数据通常由手持设备、无人机或移动机器人采集,难以精确复现传感器运动。SLAM&Render数据集使用机器人手臂记录,包含40个时间同步的RGB-D图像序列、IMU读数、机器人运动学数据和ground-truth位姿。该数据集包含五个场景,涵盖消费级和工业级物体,以及四种可控光照条件,并提供独立的训练和测试轨迹。所有序列都是静态的,具有不同程度的物体重排和遮挡。实验结果表明,SLAM&Render是一个适用于新兴研究领域的基准。

🔬 方法详解

问题定义:现有数据集在评估神经渲染方法(如NeRF和高斯溅射)在SLAM中的应用时存在不足。它们通常缺乏SLAM固有的序列操作特性,以及多模态传感器数据。同时,神经渲染方法需要良好的视角泛化和光照泛化能力,而现有数据集在这方面也存在局限性。此外,传感器运动的精确复现也是一个挑战,因为许多数据集是由手持设备或移动平台采集的。

核心思路:为了解决上述问题,本文提出了SLAM&Render数据集,该数据集使用机器人手臂精确控制传感器运动,从而提供高质量的ground-truth位姿和可重复的实验条件。通过提供时间同步的RGB-D图像、IMU数据和机器人运动学数据,该数据集能够更好地模拟SLAM系统的实际运行环境,并促进神经渲染方法在SLAM中的应用。

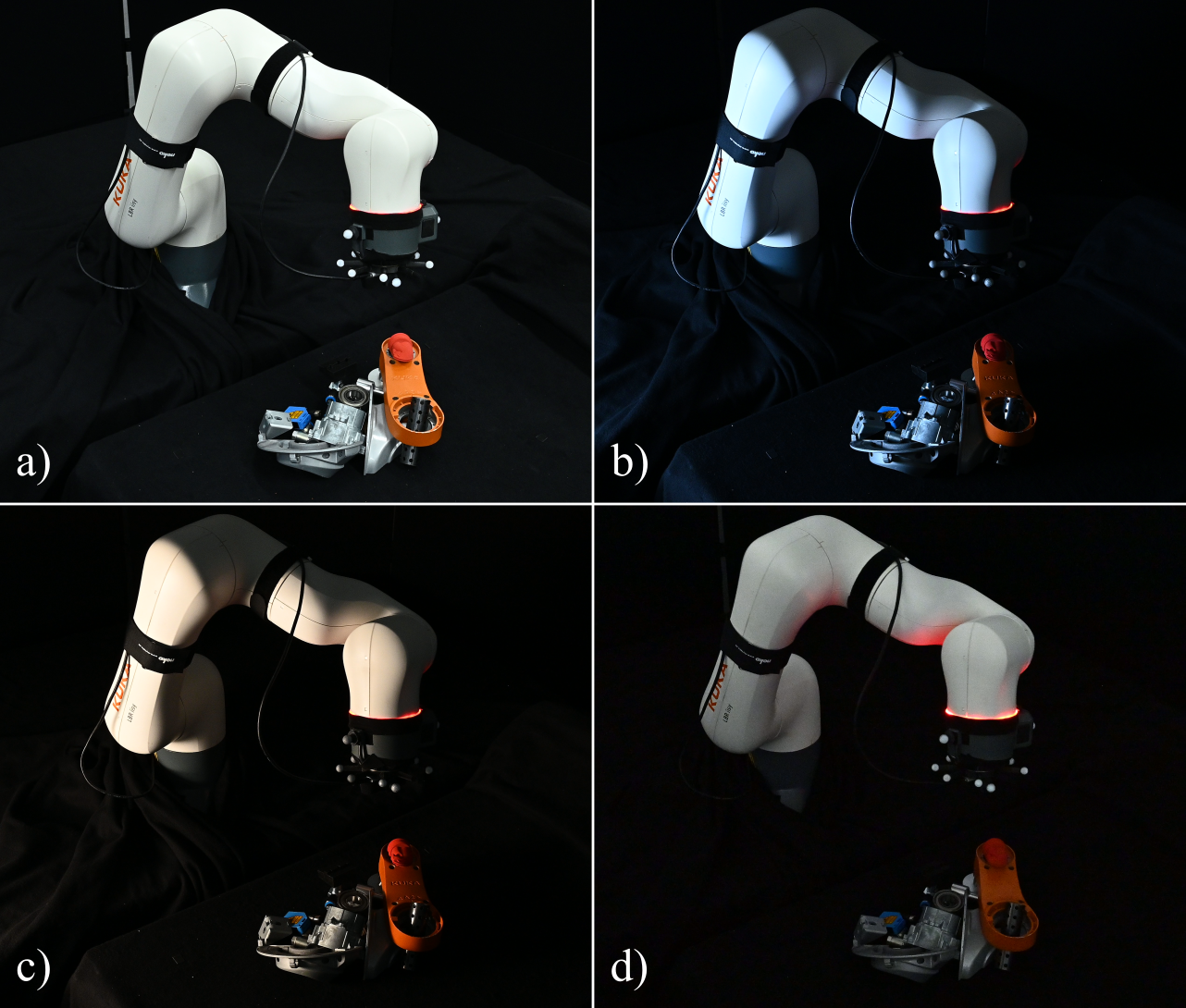

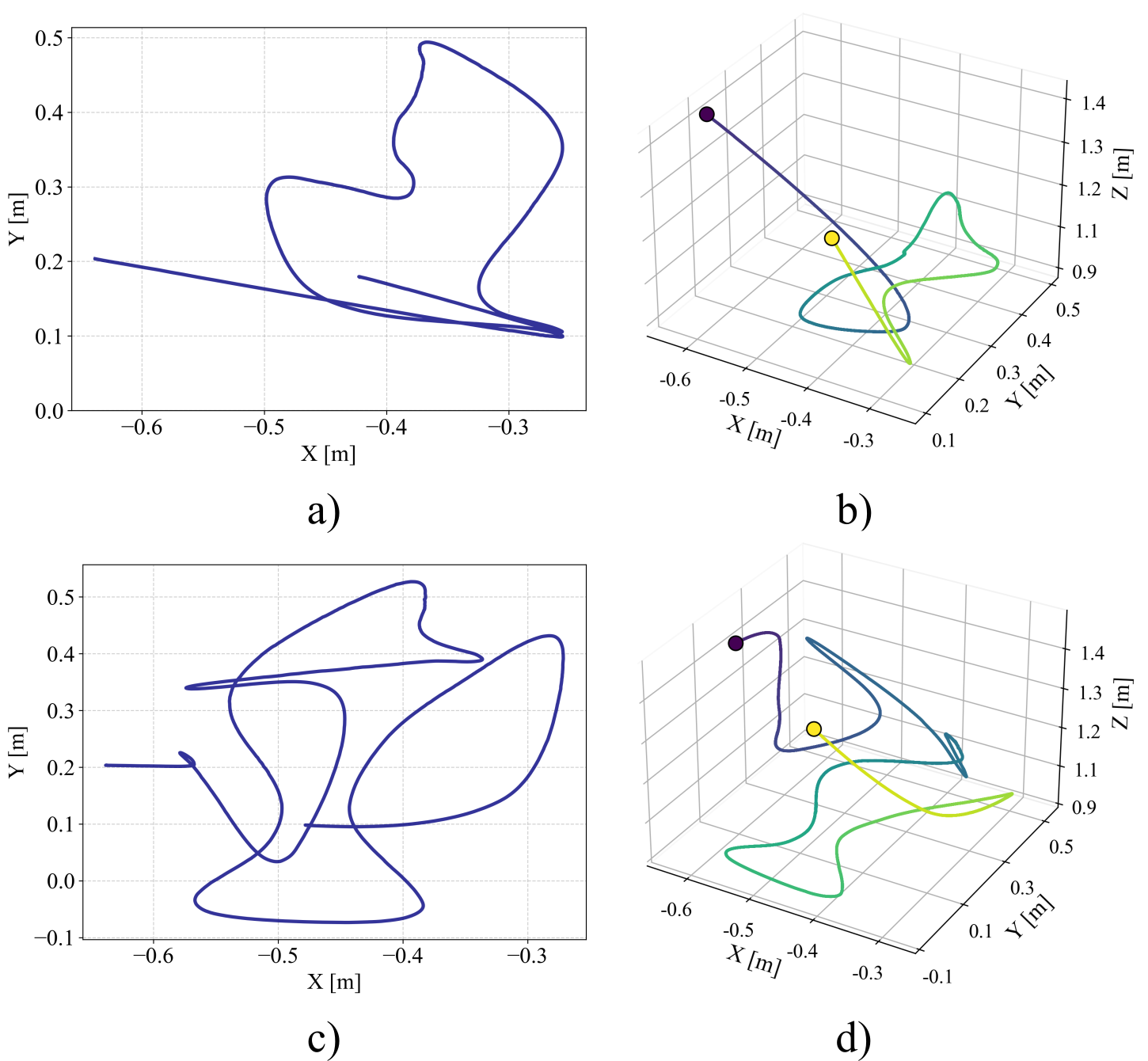

技术框架:SLAM&Render数据集的构建流程主要包括以下几个步骤:1)设计包含消费级和工业级物体的场景;2)使用机器人手臂沿预定轨迹移动RGB-D相机和IMU传感器;3)记录时间同步的RGB-D图像、IMU读数和机器人运动学数据;4)使用运动捕捉系统获取ground-truth位姿;5)提供独立的训练和测试轨迹,以及不同光照条件下的数据。

关键创新:SLAM&Render数据集的关键创新在于其使用机器人手臂精确控制传感器运动,从而提供高质量的ground-truth位姿和可重复的实验条件。此外,该数据集还提供了时间同步的RGB-D图像、IMU数据和机器人运动学数据,这使得研究人员能够更好地评估神经渲染方法在SLAM系统中的性能。与现有数据集相比,SLAM&Render数据集更具挑战性,也更贴近实际应用场景。

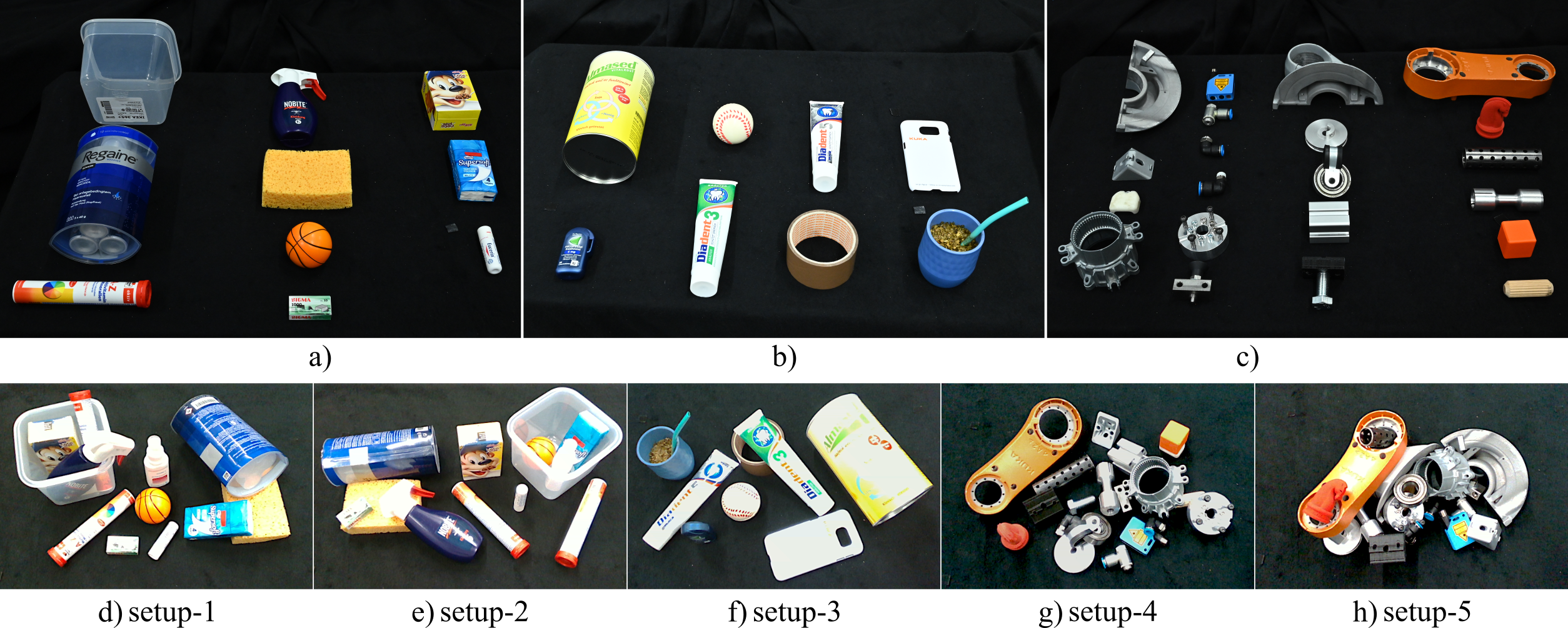

关键设计:SLAM&Render数据集包含五个场景,涵盖消费级和工业级物体,以及四种可控光照条件。每个场景都包含独立的训练和测试轨迹,以及不同程度的物体重排和遮挡。数据集提供了时间同步的RGB-D图像(分辨率未知)、IMU读数(频率未知)、机器人运动学数据(频率未知)和ground-truth位姿(频率未知)。数据集的规模(序列长度、图像数量等)未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SLAM&Render数据集能够有效评估神经渲染方法在SLAM系统中的性能。作者使用多个基线方法进行了实验,验证了该数据集的挑战性和实用性。具体的性能数据和提升幅度在论文中给出,但摘要中未明确提及。

🎯 应用场景

SLAM&Render数据集可用于评估和改进神经渲染方法在SLAM系统中的性能,例如在机器人导航、增强现实和虚拟现实等领域。该数据集能够促进神经渲染和SLAM技术的融合,从而提高SLAM系统的鲁棒性和精度,并为机器人提供更丰富的环境感知能力。此外,该数据集还可以用于评估SLAM算法在机器人应用中的性能。

📄 摘要(原文)

Models and methods originally developed for Novel View Synthesis and Scene Rendering, such as Neural Radiance Fields (NeRF) and Gaussian Splatting, are increasingly being adopted as representations in Simultaneous Localization and Mapping (SLAM). However, existing datasets fail to include the specific challenges of both fields, such as sequential operations and, in many settings, multi-modality in SLAM or generalization across viewpoints and illumination conditions in neural rendering. Additionally, the data are often collected using sensors which are handheld or mounted on drones or mobile robots, which complicates the accurate reproduction of sensor motions. To bridge these gaps, we introduce SLAM&Render, a novel dataset designed to benchmark methods in the intersection between SLAM, Novel View Rendering and Gaussian Splatting. Recorded with a robot manipulator, it uniquely includes 40 sequences with time-synchronized RGB-D images, IMU readings, robot kinematic data, and ground-truth pose streams. By releasing robot kinematic data, the dataset also enables the assessment of recent integrations of SLAM paradigms within robotic applications. The dataset features five setups with consumer and industrial objects under four controlled lighting conditions, each with separate training and test trajectories. All sequences are static with different levels of object rearrangements and occlusions. Our experimental results, obtained with several baselines from the literature, validate SLAM&Render as a relevant benchmark for this emerging research area.