Bridging Deep Reinforcement Learning and Motion Planning for Model-Free Navigation in Cluttered Environments

作者: Licheng Luo, Mingyu Cai

分类: cs.RO

发布日期: 2025-04-09 (更新: 2025-07-03)

备注: 16 pages

💡 一句话要点

融合运动规划与深度强化学习,解决复杂环境下的模型无关导航问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 运动规划 机器人导航 模型无关学习 复杂环境 图搜索 奖励函数设计

📋 核心要点

- 深度强化学习在复杂环境导航中面临探索不足的挑战,尤其是在稀疏奖励和复杂动力学下。

- 论文提出将基于图的运动规划与深度强化学习相结合,利用图结构提供密集奖励,引导智能体探索。

- 实验结果表明,该方法显著提高了探索效率和任务成功率,验证了其在复杂环境导航中的有效性。

📝 摘要(中文)

深度强化学习(DRL)已成为学习最优策略的强大模型无关范例。然而,在具有复杂环境的导航任务中,DRL方法通常面临探索不足的问题,尤其是在稀疏奖励或具有系统扰动的复杂动力学下。为了应对这一挑战,我们将通用的基于图的运动规划与DRL相结合,使智能体能够更有效地探索复杂空间并实现所需的导航性能。具体来说,我们设计了一个基于图结构的密集奖励函数,该图结构跨越整个状态空间。该图提供了丰富的指导,引导智能体朝着最优策略前进。我们在具有挑战性的环境中验证了我们的方法,证明了在探索效率和任务成功率方面的显著改进。

🔬 方法详解

问题定义:论文旨在解决复杂环境中,基于深度强化学习的智能体导航问题。现有方法在稀疏奖励或复杂动力学下,容易陷入局部最优,难以有效探索环境,导致导航失败。痛点在于探索效率低,学习到的策略泛化能力差。

核心思路:核心思路是将传统的基于图的运动规划与深度强化学习相结合。运动规划可以提供全局的指导信息,帮助智能体更有效地探索环境。通过在状态空间中构建图结构,并基于该图设计密集奖励函数,引导智能体朝着目标前进。

技术框架:整体框架包含两个主要部分:1) 基于图的运动规划器:该模块负责在状态空间中构建图结构,例如使用RRT算法。图的节点代表状态,边代表状态之间的可行路径。2) 深度强化学习智能体:该智能体使用图结构提供的奖励信号进行训练,学习导航策略。智能体与环境交互,根据当前状态和图信息选择动作,并获得奖励。

关键创新:关键创新在于将运动规划的全局信息融入到深度强化学习的奖励函数中。传统的深度强化学习通常依赖于稀疏奖励,难以引导智能体探索。通过图结构提供的密集奖励,可以更有效地引导智能体朝着目标前进,提高探索效率和任务成功率。

关键设计:关键设计包括:1) 图的构建方式:选择合适的图构建算法,例如RRT或PRM。2) 奖励函数的设计:奖励函数需要综合考虑智能体与目标之间的距离、与图节点的距离等因素。3) 深度强化学习算法的选择:可以使用常见的深度强化学习算法,例如DQN、PPO或SAC。具体的网络结构和参数设置需要根据具体任务进行调整。

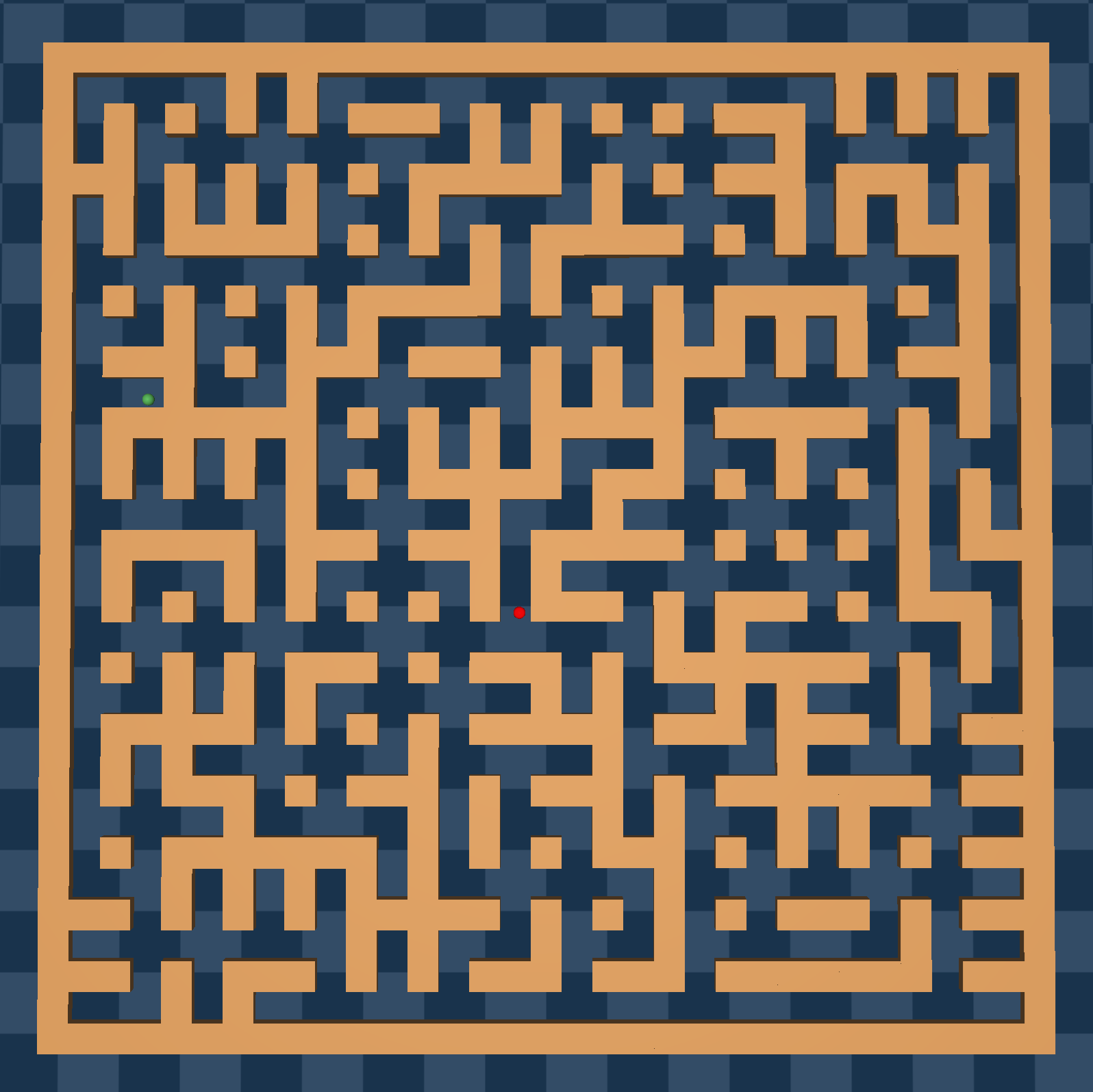

🖼️ 关键图片

📊 实验亮点

论文在具有挑战性的复杂环境中进行了实验验证,结果表明,所提出的方法显著提高了探索效率和任务成功率。与传统的深度强化学习方法相比,该方法能够更快地学习到最优策略,并且在面对环境变化时具有更好的鲁棒性。具体的性能提升数据未知,需要在论文中查找。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、游戏AI等领域。在复杂、动态的环境中,例如仓库、工厂、城市街道等,该方法可以帮助机器人或智能体更安全、高效地完成导航任务。未来,该方法有望进一步扩展到多智能体协作导航、未知环境探索等更复杂的场景。

📄 摘要(原文)

Deep Reinforcement Learning (DRL) has emerged as a powerful model-free paradigm for learning optimal policies. However, in navigation tasks with cluttered environments, DRL methods often suffer from insufficient exploration, especially under sparse rewards or complex dynamics with system disturbances. To address this challenge, we bridge general graph-based motion planning with DRL, enabling agents to explore cluttered spaces more effectively and achieve desired navigation performance. Specifically, we design a dense reward function grounded in a graph structure that spans the entire state space. This graph provides rich guidance, steering the agent toward optimal strategies. We validate our approach in challenging environments, demonstrating substantial improvements in exploration efficiency and task success rates.