Exploring Adversarial Obstacle Attacks in Search-based Path Planning for Autonomous Mobile Robots

作者: Adrian Szvoren, Jianwei Liu, Dimitrios Kanoulas, Nilufer Tuptuk

分类: cs.RO

发布日期: 2025-04-08 (更新: 2025-12-08)

期刊: 2025 IEEE International Conference on Robotics and Automation (ICRA), Atlanta, GA, USA, 2025, pp. 14843-14849

DOI: 10.1109/ICRA55743.2025.11128179

💡 一句话要点

研究A*算法在自主移动机器人路径规划中对抗性障碍攻击的脆弱性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 路径规划 A*算法 对抗性攻击 自主移动机器人 鲁棒性评估

📋 核心要点

- A*算法是自主移动机器人路径规划的关键,但其在对抗性环境下的鲁棒性面临挑战。

- 通过引入恶意障碍物,攻击者旨在干扰A*算法,迫使机器人选择次优路径,从而延迟到达时间。

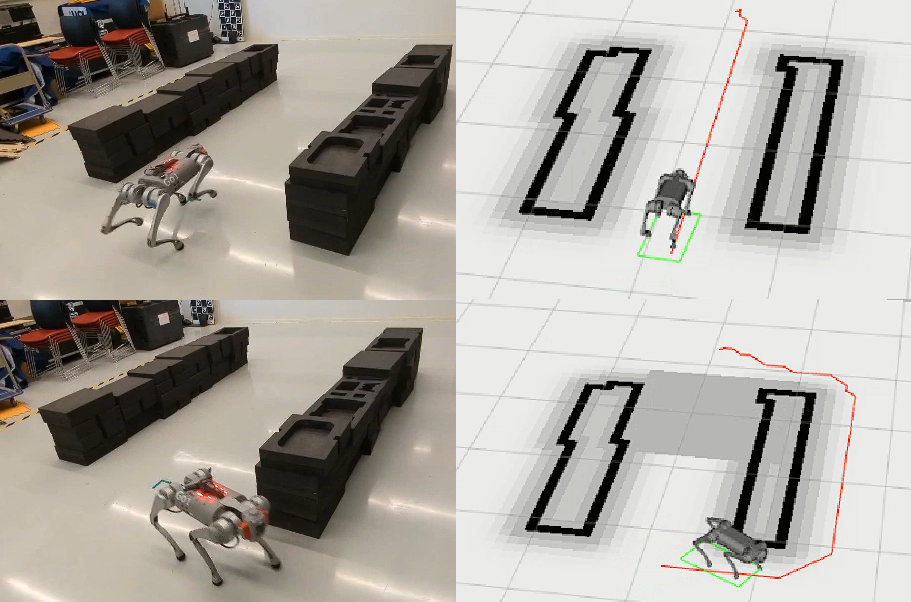

- 实验表明,对抗性攻击在仿真和真实环境中均能有效延迟机器人,尤其是在受限环境中。

📝 摘要(中文)

本文研究了基于搜索的A*算法在自主移动机器人路径规划中,面对对抗性障碍攻击时的鲁棒性。对抗者的目标是通过在机器人原始路径上引入障碍物,延迟机器人到达目的地的时间。我们开发了恶意软件来执行攻击,并通过在Gazebo中使用TurtleBot进行仿真以及在Unitree Go1机器人上进行真实部署的实验来评估其影响。在仿真中,攻击导致平均36%的延迟,最显著的延迟发生在机器人被迫采取更长替代路径的情况下。在真实实验中,延迟更为明显,所有攻击都成功地重新规划了机器人的路径并造成了可衡量的中断。这些结果表明,算法的鲁棒性不仅是其设计的属性,而且受到运行环境的显著影响。例如,在隧道等受限环境中,由于替代路线的可用性有限,延迟最大化。

🔬 方法详解

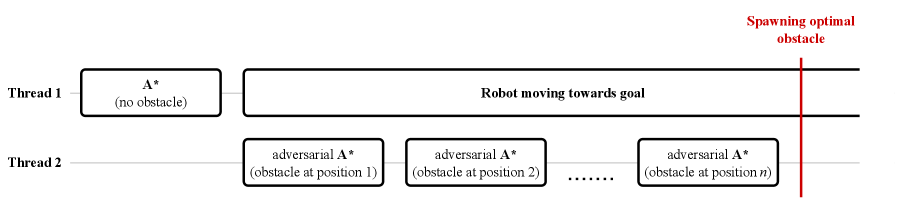

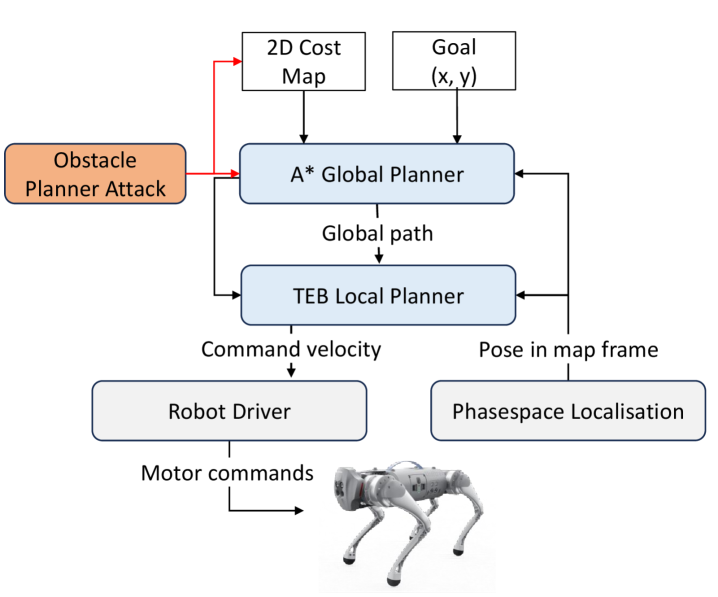

问题定义:论文研究的问题是自主移动机器人在路径规划过程中,如何应对恶意攻击者通过放置障碍物来干扰A算法,从而延迟机器人到达目标点的时间。现有A算法在设计时通常假设环境是静态和可信的,缺乏对潜在对抗性攻击的考虑,因此容易受到攻击,导致效率降低甚至任务失败。

核心思路:论文的核心思路是通过模拟对抗性障碍物攻击,评估A算法在不同环境下的鲁棒性。通过分析攻击成功时的场景特征,揭示A算法的脆弱性,为后续开发更具鲁棒性的路径规划算法提供依据。核心在于量化攻击对路径规划的影响,并分析环境因素在其中的作用。

技术框架:该研究的技术框架主要包括以下几个部分:1) A路径规划算法的实现;2) 恶意障碍物放置策略的开发,即模拟攻击者;3) 在Gazebo仿真环境和真实机器人平台上进行实验;4) 收集实验数据,包括路径长度、到达时间、延迟等;5) 分析数据,评估A算法的鲁棒性,并识别关键影响因素。

关键创新:该研究的关键创新在于将对抗性攻击的概念引入到自主移动机器人的路径规划领域,并系统地评估了A算法在面对此类攻击时的性能。以往的研究主要关注算法本身的优化,而忽略了外部环境的潜在威胁。通过实验验证了A算法在对抗性环境下的脆弱性,为后续研究提供了新的视角。

关键设计:在实验设计方面,论文考虑了不同的环境因素,例如隧道等受限环境,以及不同的机器人平台,包括TurtleBot和Unitree Go1。恶意障碍物的放置策略可能包括随机放置、沿原始路径放置等。延迟的计算方式是实际到达时间与无攻击情况下的到达时间之差。仿真环境的参数设置,例如机器人速度、传感器范围等,也会影响实验结果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在仿真环境中,对抗性攻击导致平均36%的延迟。在真实环境中,所有攻击都成功地重新规划了机器人的路径并造成了可衡量的中断。尤其是在隧道等受限环境中,由于替代路线的可用性有限,延迟最大化。这些数据直观地展示了A*算法在面对对抗性攻击时的脆弱性,并强调了环境因素对算法鲁棒性的重要影响。

🎯 应用场景

该研究成果可应用于提升自主移动机器人在复杂和潜在恶意环境中的安全性。例如,在安防巡逻、物流配送等场景中,机器人可能面临人为干扰或恶意攻击。通过了解A*算法的脆弱性,可以开发更鲁棒的路径规划算法,提高机器人在这些场景中的可靠性和效率。未来的研究可以探索基于对抗训练的路径规划算法,提高机器人对恶意攻击的防御能力。

📄 摘要(原文)

Path planning algorithms, such as the search-based A, are a critical component of autonomous mobile robotics, enabling robots to navigate from a starting point to a destination efficiently and safely. We investigated the resilience of the A algorithm in the face of potential adversarial interventions known as obstacle attacks. The adversary's goal is to delay the robot's timely arrival at its destination by introducing obstacles along its original path. We developed malicious software to execute the attacks and conducted experiments to assess their impact, both in simulation using TurtleBot in Gazebo and in real-world deployment with the Unitree Go1 robot. In simulation, the attacks resulted in an average delay of 36\%, with the most significant delays occurring in scenarios where the robot was forced to take substantially longer alternative paths. In real-world experiments, the delays were even more pronounced, with all attacks successfully rerouting the robot and causing measurable disruptions. These results highlight that the algorithm's robustness is not solely an attribute of its design but is significantly influenced by the operational environment. For example, in constrained environments like tunnels, the delays were maximized due to the limited availability of alternative routes.