Trust Through Transparency: Explainable Social Navigation for Autonomous Mobile Robots via Vision-Language Models

作者: Oluwadamilola Sotomi, Devika Kodi, Aliasghar Arab

分类: cs.RO

发布日期: 2025-04-07

备注: Submitted to IEEE Conferences

💡 一句话要点

提出基于视觉-语言模型的透明社交导航方法,提升机器人信任度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社交导航 可解释性AI 视觉-语言模型 机器人信任 人机交互

📋 核心要点

- 现有社交导航机器人缺乏透明性,难以解释其行为,导致用户信任度低。

- 利用视觉-语言模型,机器人能够感知环境并用自然语言解释其导航决策。

- 用户研究表明,实时解释显著提升了用户对机器人的信任和理解,实验结果通过混淆矩阵验证。

📝 摘要(中文)

服务型和辅助型机器人越来越多地部署在动态社交环境中;然而,确保透明和可解释的交互仍然是一个重大挑战。本文提出了一种多模态可解释性模块,该模块集成了视觉语言模型和热图,以提高导航过程中的透明度。所提出的系统使机器人能够通过自然语言摘要来感知、分析和表达它们的观察结果。用户研究(n=30)表明,大多数人偏爱实时解释,这表明信任和理解得到了改善。我们的实验通过混淆矩阵分析进行了验证,以评估与人类期望的一致程度。我们的实验和仿真结果强调了可解释性在自主导航中的有效性,从而增强了信任和可解释性。

🔬 方法详解

问题定义:现有的社交导航机器人通常缺乏透明度,用户难以理解机器人的行为逻辑和决策过程。这种不透明性降低了用户对机器人的信任感,阻碍了机器人在社交环境中的广泛应用。因此,如何让机器人能够清晰地表达其导航意图,提高用户对其行为的理解和信任,是本文要解决的关键问题。

核心思路:本文的核心思路是利用视觉-语言模型赋予机器人感知环境并用自然语言进行解释的能力。通过将视觉信息(例如,行人、障碍物)与自然语言描述相结合,机器人可以向用户解释其导航决策的原因,例如“我正在绕过行人以避免碰撞”。这种解释能够提高机器人的透明度,增强用户的信任感。

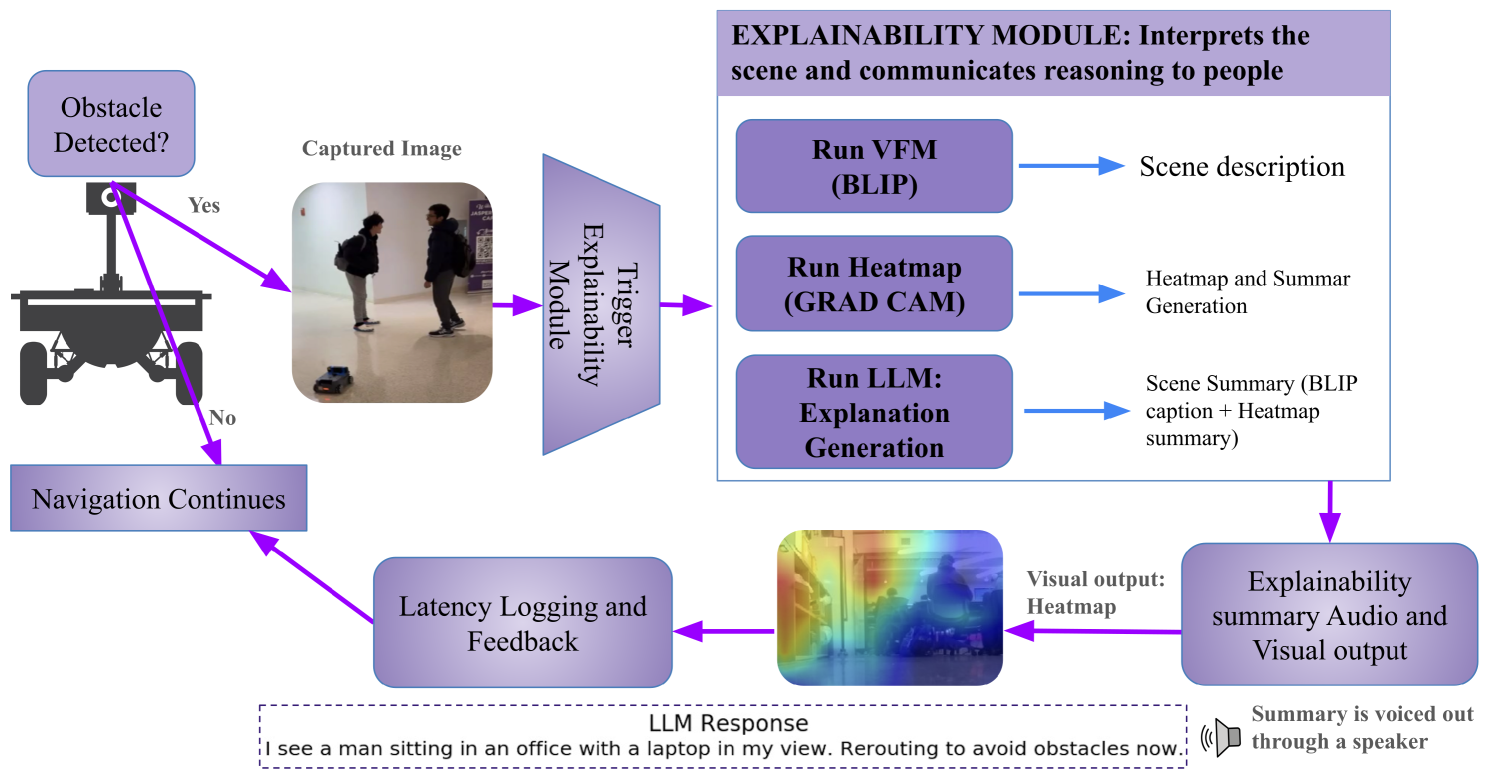

技术框架:该方法包含以下主要模块:1) 视觉感知模块:用于识别环境中的物体和行人;2) 视觉-语言模型:将视觉信息转换为自然语言描述;3) 导航模块:根据环境信息和用户指令规划导航路径;4) 解释模块:结合视觉-语言模型的输出和导航决策,生成导航解释。整体流程是,机器人首先通过视觉感知模块获取环境信息,然后利用视觉-语言模型生成环境描述,导航模块根据环境信息和用户指令规划路径,最后解释模块结合视觉-语言模型的输出和导航决策生成解释,并以自然语言呈现给用户。

关键创新:该方法的关键创新在于将视觉-语言模型应用于社交导航解释。与传统的基于规则或预定义模板的解释方法相比,视觉-语言模型能够生成更自然、更灵活的解释,更好地适应复杂的社交环境。此外,该方法还结合了热图可视化技术,进一步增强了解释的可理解性。

关键设计:视觉-语言模型的选择和训练是关键。论文可能采用了预训练的视觉-语言模型,例如CLIP或类似的模型,并在特定于社交导航的数据集上进行了微调。损失函数可能包括语言建模损失和对比学习损失,以确保生成的解释与视觉信息的一致性。热图的生成可能基于注意力机制或显著性检测算法,以突出显示机器人关注的关键区域。

🖼️ 关键图片

📊 实验亮点

用户研究表明,与没有解释的导航相比,提供实时解释的导航显著提高了用户的信任度和理解度。混淆矩阵分析验证了机器人生成的解释与人类期望之间的高度一致性。这些结果表明,该方法能够有效地提高机器人的透明度和可解释性。

🎯 应用场景

该研究成果可应用于各种服务型机器人和辅助型机器人,例如医院的送药机器人、商场的导购机器人、养老院的陪伴机器人等。通过提高机器人的透明度和可解释性,可以增强用户对机器人的信任,促进机器人在社交环境中的广泛应用,并提升用户体验。

📄 摘要(原文)

Service and assistive robots are increasingly being deployed in dynamic social environments; however, ensuring transparent and explainable interactions remains a significant challenge. This paper presents a multimodal explainability module that integrates vision language models and heat maps to improve transparency during navigation. The proposed system enables robots to perceive, analyze, and articulate their observations through natural language summaries. User studies (n=30) showed a preference of majority for real-time explanations, indicating improved trust and understanding. Our experiments were validated through confusion matrix analysis to assess the level of agreement with human expectations. Our experimental and simulation results emphasize the effectiveness of explainability in autonomous navigation, enhancing trust and interpretability.