Dexterous Manipulation through Imitation Learning: A Survey

作者: Shan An, Ziyu Meng, Chao Tang, Yuning Zhou, Tengyu Liu, Fangqiang Ding, Shufang Zhang, Yao Mu, Ran Song, Wei Zhang, Zeng-Guang Hou, Hong Zhang

分类: cs.RO, cs.LG

发布日期: 2025-04-04 (更新: 2025-12-17)

备注: 32pages, 6 figures, 9 tables

💡 一句话要点

综述:基于模仿学习的灵巧操作研究进展与挑战

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 灵巧操作 模仿学习 机器人 策略学习 行为克隆

📋 核心要点

- 灵巧操作面临高维度和复杂接触动力学挑战,传统模型方法难以泛化,强化学习则需要大量训练数据和奖励设计。

- 模仿学习通过从专家演示中学习,避免了显式建模和大规模试错,能够直接获取灵巧操作技能。

- 该综述全面介绍了基于模仿学习的灵巧操作方法,分析了最新进展和关键挑战,并探讨了未来研究方向。

📝 摘要(中文)

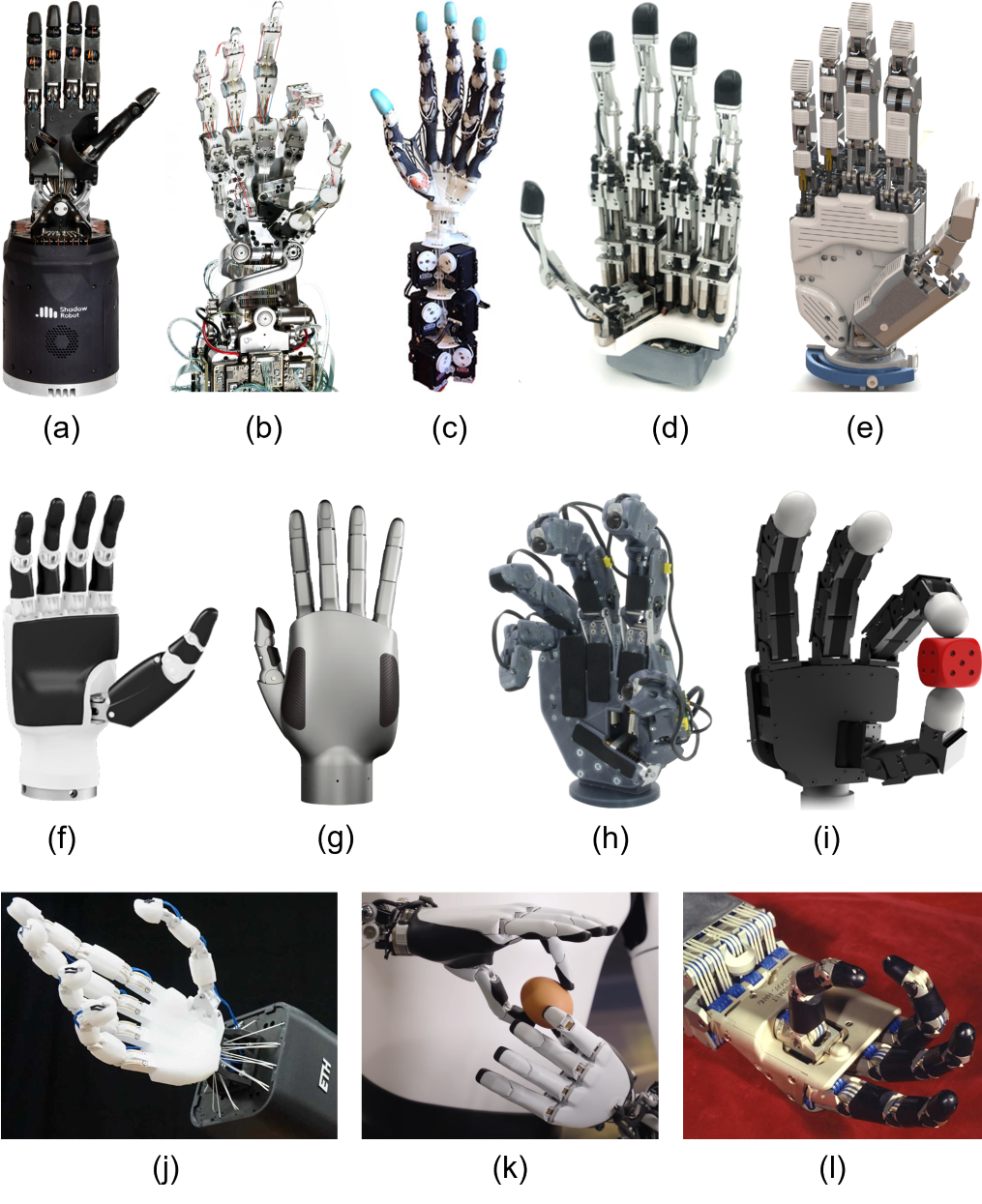

灵巧操作是指机器人手或多指末端执行器通过精确协调的手指运动和自适应的力调节来熟练地控制、重定向和操作物体的能力,它实现了类似于人类手部灵巧性的复杂交互。随着机器人和机器学习的最新进展,对这些系统在复杂和非结构化环境中运行的需求日益增长。传统的基于模型的方法由于灵巧操作的高维度和复杂的接触动力学,难以在任务和对象变化中泛化。虽然诸如强化学习(RL)之类的无模型方法显示出希望,但它们需要大量的训练、大规模的交互数据以及精心设计的奖励才能实现稳定性和有效性。模仿学习(IL)提供了一种替代方案,允许机器人直接从专家演示中获取灵巧的操作技能,捕获细粒度的协调和接触动力学,同时绕过显式建模和大规模试错的需要。本综述概述了基于模仿学习的灵巧操作方法,详细介绍了最新进展,并解决了该领域的关键挑战。此外,它还探讨了增强IL驱动的灵巧操作的潜在研究方向。我们的目标是为研究人员和从业人员提供对这个快速发展领域的全面介绍。

🔬 方法详解

问题定义:灵巧操作旨在使机器人具备像人手一样灵活、精确地操控物体的能力。现有方法,特别是基于模型的方法,难以处理高维度状态空间和复杂的接触动力学,导致泛化能力不足。而强化学习虽然有潜力,但需要大量的训练数据和精心设计的奖励函数,训练成本高昂且难以保证稳定性。

核心思路:模仿学习(Imitation Learning, IL)的核心思想是从专家演示中学习策略,使机器人能够模仿专家的行为。通过学习专家轨迹,机器人可以直接获取灵巧操作的技能,而无需显式地建模环境或设计复杂的奖励函数。这种方法能够有效地处理高维度和复杂的动力学问题。

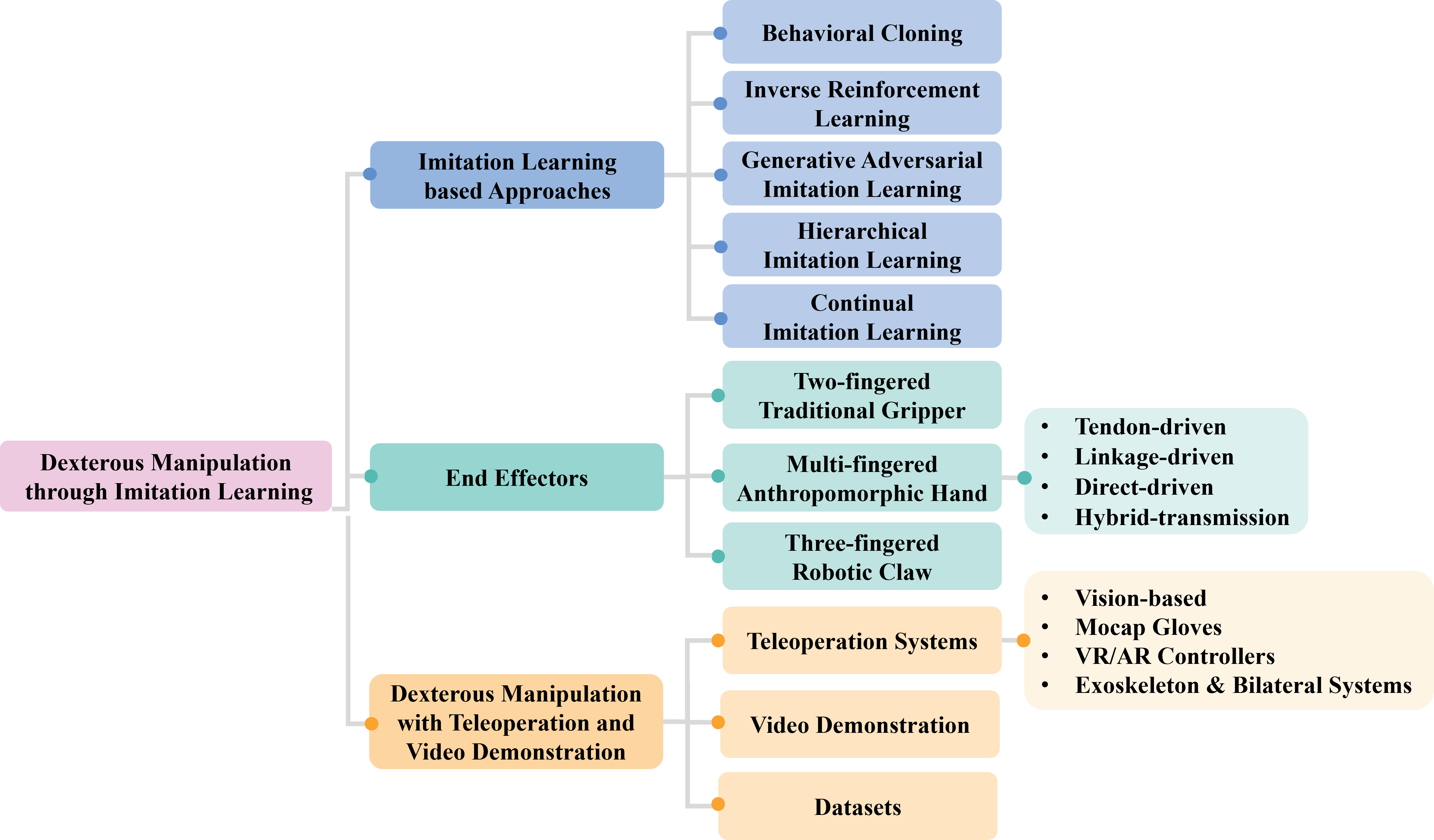

技术框架:基于模仿学习的灵巧操作通常包含以下几个主要阶段:1)数据收集:通过人工示教、运动捕捉或其他方式获取专家演示数据。2)策略学习:利用模仿学习算法(如行为克隆、逆强化学习等)从演示数据中学习策略。3)策略执行:将学习到的策略部署到机器人上,使其能够执行灵巧操作任务。4)策略优化(可选):通过强化学习或其他方法对学习到的策略进行微调,以提高性能。

关键创新:该综述的关键创新在于系统性地整理和分析了基于模仿学习的灵巧操作方法,并指出了该领域面临的关键挑战和未来研究方向。与以往的综述相比,该综述更加关注模仿学习在灵巧操作中的应用,并对各种模仿学习算法进行了详细的比较和分析。

关键设计:不同的模仿学习算法在设计上有所不同。例如,行为克隆直接将专家演示数据作为训练数据,训练一个策略网络来预测动作。逆强化学习则首先从演示数据中推断奖励函数,然后利用强化学习算法来学习策略。在网络结构方面,常用的包括多层感知机、循环神经网络和图神经网络等。损失函数通常包括行为克隆的交叉熵损失或均方误差损失,以及逆强化学习中的奖励函数损失。

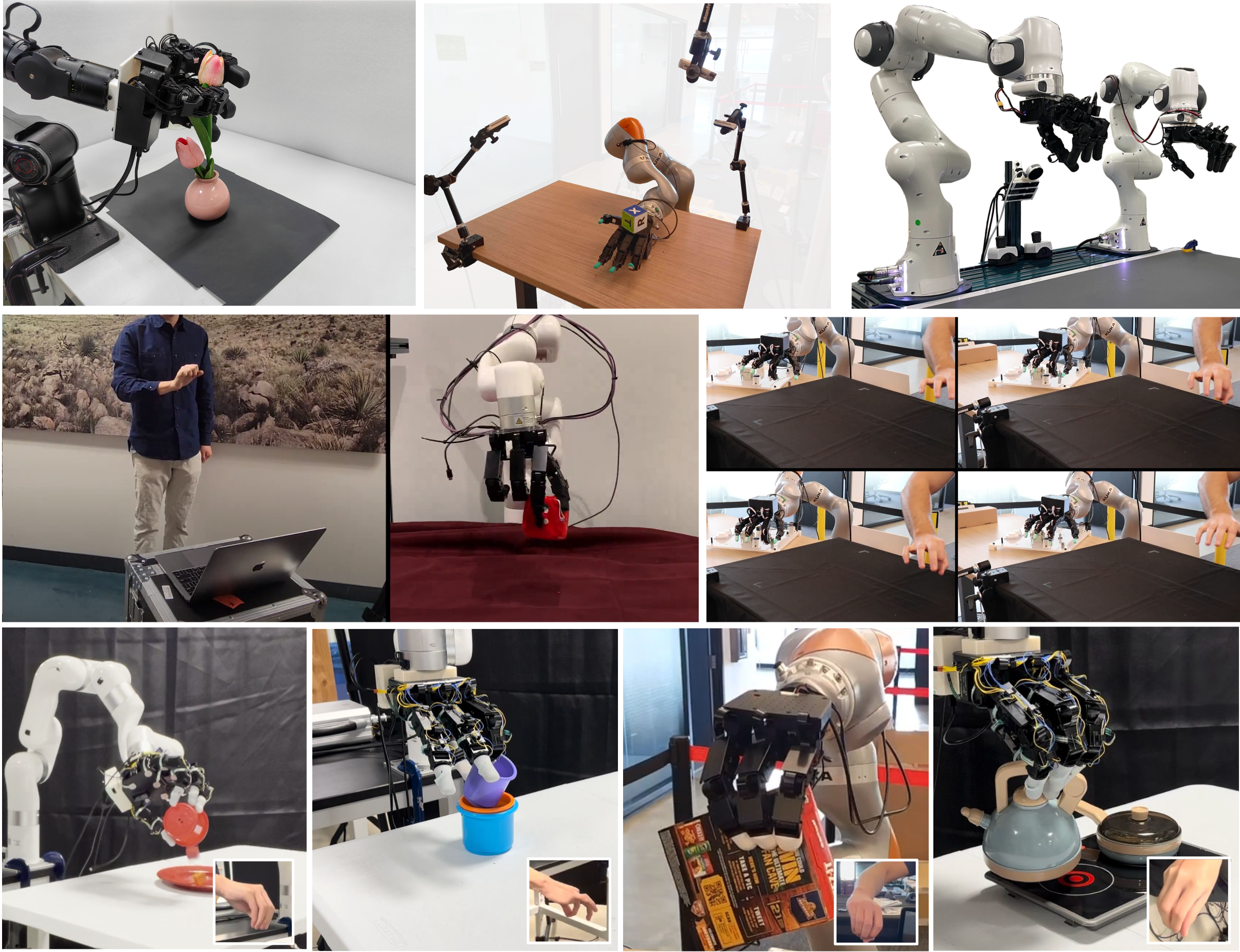

🖼️ 关键图片

📊 实验亮点

该综述总结了近年来基于模仿学习的灵巧操作研究进展,涵盖了多种模仿学习算法和应用场景。虽然没有提供具体的实验数据,但它系统地分析了各种方法的优缺点,并指出了未来研究的重点方向,例如如何提高模仿学习的泛化能力、如何处理噪声数据、如何设计更有效的奖励函数等。

🎯 应用场景

该研究具有广泛的应用前景,包括工业自动化、医疗手术、家庭服务等领域。例如,在工业自动化中,灵巧操作机器人可以用于装配、包装等任务;在医疗手术中,可以辅助医生进行微创手术;在家庭服务中,可以帮助人们完成各种日常任务。该研究的进展将推动机器人技术的发展,提高机器人的智能化水平,使其能够更好地服务于人类。

📄 摘要(原文)

Dexterous manipulation, which refers to the ability of a robotic hand or multi-fingered end-effector to skillfully control, reorient, and manipulate objects through precise, coordinated finger movements and adaptive force modulation, enables complex interactions similar to human hand dexterity. With recent advances in robotics and machine learning, there is a growing demand for these systems to operate in complex and unstructured environments. Traditional model-based approaches struggle to generalize across tasks and object variations due to the high dimensionality and complex contact dynamics of dexterous manipulation. Although model-free methods such as reinforcement learning (RL) show promise, they require extensive training, large-scale interaction data, and carefully designed rewards for stability and effectiveness. Imitation learning (IL) offers an alternative by allowing robots to acquire dexterous manipulation skills directly from expert demonstrations, capturing fine-grained coordination and contact dynamics while bypassing the need for explicit modeling and large-scale trial-and-error. This survey provides an overview of dexterous manipulation methods based on imitation learning, details recent advances, and addresses key challenges in the field. Additionally, it explores potential research directions to enhance IL-driven dexterous manipulation. Our goal is to offer researchers and practitioners a comprehensive introduction to this rapidly evolving domain.