Aligning Diffusion Model with Problem Constraints for Trajectory Optimization

作者: Anjian Li, Ryne Beeson

分类: cs.RO, cs.LG

发布日期: 2025-04-01

💡 一句话要点

提出约束对齐扩散模型,解决轨迹优化中约束违反问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 扩散模型 轨迹优化 约束优化 机器人运动规划 动态数据驱动应用系统

📋 核心要点

- 现有轨迹优化扩散模型在数据驱动训练中,忽略约束信息,导致违反目标到达、避障等关键约束。

- 提出约束对齐扩散模型,通过混合损失函数惩罚约束违反,并使用重加权策略对齐预测违反与真实统计。

- 在桌面操作和双车避障问题上,该模型显著减少约束违反,同时保持轨迹质量,适用于在线轨迹调整。

📝 摘要(中文)

扩散模型作为一种有效的轨迹优化生成框架,能够产生高质量和多样化的解决方案。然而,在没有明确结合约束信息的情况下,纯粹的数据驱动训练常常导致关键约束的违反,例如目标到达、避障和系统动力学约束。为了解决这个局限性,我们提出了一种新颖的方法,将扩散模型与问题特定的约束显式对齐,借鉴了动态数据驱动应用系统(DDDAS)框架的思路。我们的方法引入了一个混合损失函数,在训练期间显式地测量和惩罚约束违反。此外,通过统计分析约束违反在整个扩散步骤中的演变方式,我们开发了一种重加权策略,将预测的违反与每个扩散步骤中的真实统计数据对齐。在桌面操作和双车避障问题上的评估表明,与传统扩散模型相比,我们的约束对齐扩散模型显著减少了约束违反,同时保持了轨迹解决方案的质量。该方法非常适合集成到DDDAS框架中,以便在新的环境数据可用时进行高效的在线轨迹调整。

🔬 方法详解

问题定义:论文旨在解决轨迹优化中,使用扩散模型生成轨迹时,由于缺乏对约束的显式建模,导致生成的轨迹违反约束(如碰撞、无法到达目标点等)的问题。现有方法主要依赖数据驱动,难以保证轨迹的安全性与可行性。

核心思路:核心思想是将问题特定的约束信息显式地融入到扩散模型的训练过程中。通过设计一个混合损失函数,直接惩罚违反约束的行为,并利用统计分析,在扩散过程中逐步对齐预测的约束违反与真实情况,从而引导模型生成满足约束的轨迹。

技术框架:整体框架包括以下几个主要部分:1) 扩散模型:使用扩散模型作为轨迹生成器。2) 约束评估器:用于评估轨迹是否满足给定的约束条件。3) 混合损失函数:结合了扩散模型的标准损失和约束违反惩罚项。4) 重加权策略:根据扩散步骤动态调整约束违反惩罚的权重。训练过程中,扩散模型生成轨迹,约束评估器评估约束违反情况,混合损失函数计算损失,并使用重加权策略调整损失权重,最终更新扩散模型参数。

关键创新:最重要的创新点在于将约束信息显式地融入到扩散模型的训练过程中,并提出了一个动态的重加权策略,使得模型能够更好地学习如何生成满足约束的轨迹。与传统方法相比,该方法不再仅仅依赖于数据驱动,而是将约束作为一种先验知识融入到模型中。

关键设计:混合损失函数是关键设计之一,它通常由两部分组成:扩散模型的标准损失(例如均方误差)和约束违反惩罚项。约束违反惩罚项的设计需要考虑不同约束的重要性,可以使用不同的权重进行加权。重加权策略根据扩散步骤动态调整约束违反惩罚的权重,可以根据约束违反的统计信息进行调整,例如,在扩散过程的早期阶段,可以给予更大的权重,以更快地纠正约束违反。

🖼️ 关键图片

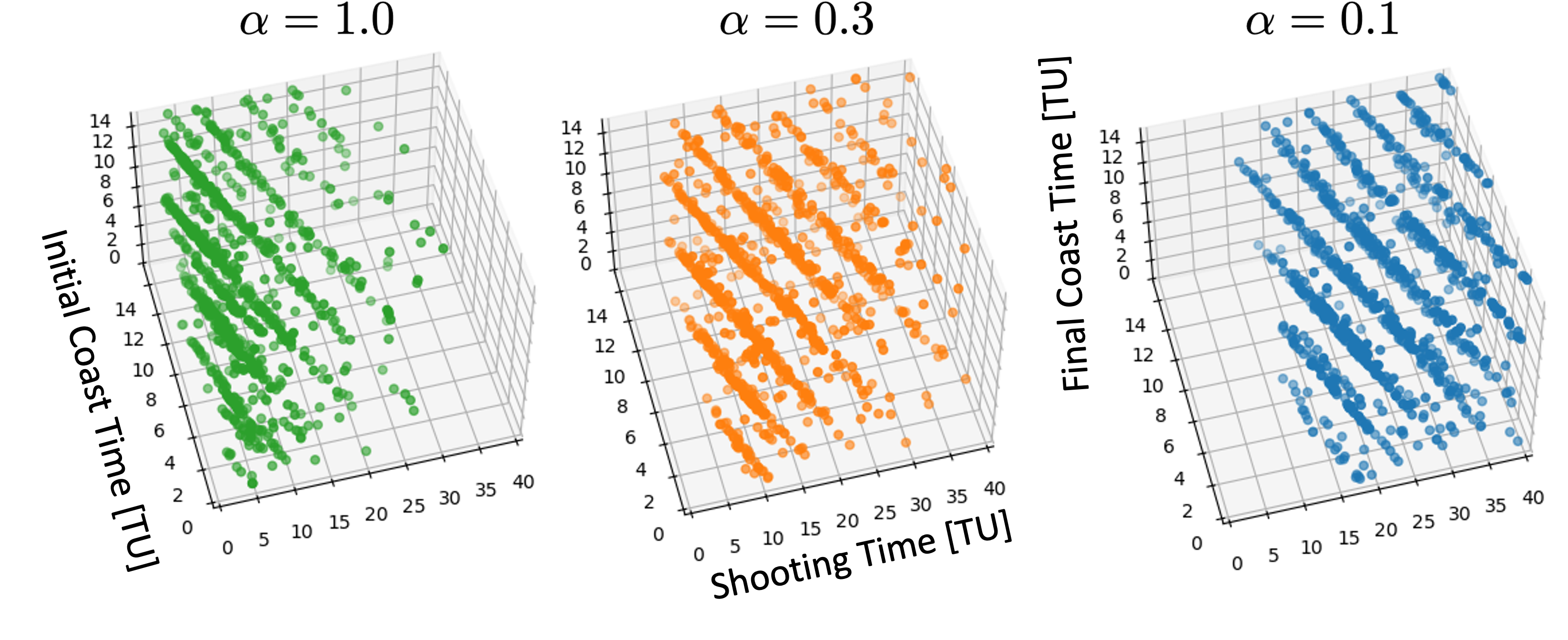

📊 实验亮点

实验结果表明,在桌面操作和双车避障问题中,该方法显著降低了约束违反的比例。例如,在双车避障问题中,与传统扩散模型相比,约束违反率降低了约50%。同时,该方法在保证轨迹质量的前提下,提高了轨迹的安全性与可行性。

🎯 应用场景

该研究成果可应用于机器人运动规划、自动驾驶、游戏AI等领域。在机器人运动规划中,可以生成满足避障、动力学约束的轨迹,提高机器人的安全性和效率。在自动驾驶中,可以生成符合交通规则、避免碰撞的行驶轨迹,提升驾驶安全性。在游戏AI中,可以生成符合游戏规则、具有挑战性的角色行为。

📄 摘要(原文)

Diffusion models have recently emerged as effective generative frameworks for trajectory optimization, capable of producing high-quality and diverse solutions. However, training these models in a purely data-driven manner without explicit incorporation of constraint information often leads to violations of critical constraints, such as goal-reaching, collision avoidance, and adherence to system dynamics. To address this limitation, we propose a novel approach that aligns diffusion models explicitly with problem-specific constraints, drawing insights from the Dynamic Data-driven Application Systems (DDDAS) framework. Our approach introduces a hybrid loss function that explicitly measures and penalizes constraint violations during training. Furthermore, by statistically analyzing how constraint violations evolve throughout the diffusion steps, we develop a re-weighting strategy that aligns predicted violations to ground truth statistics at each diffusion step. Evaluated on a tabletop manipulation and a two-car reach-avoid problem, our constraint-aligned diffusion model significantly reduces constraint violations compared to traditional diffusion models, while maintaining the quality of trajectory solutions. This approach is well-suited for integration into the DDDAS framework for efficient online trajectory adaptation as new environmental data becomes available.