VizFlyt: Perception-centric Pedagogical Framework For Autonomous Aerial Robots

作者: Kushagra Srivastava, Rutwik Kulkarni, Manoj Velmurugan, Nitin J. Sanket

分类: cs.RO, cs.CV

发布日期: 2025-03-28 (更新: 2025-04-01)

备注: Accepted at ICRA 2025. Projected Page: https://pear.wpi.edu/research/vizflyt.html

💡 一句话要点

VizFlyt:面向自主无人机的以感知为中心的教学框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 无人机 自主导航 硬件在环仿真 3D高斯溅射 机器人教育 感知算法 开源框架

📋 核心要点

- 现有的无人机教学缺乏可靠的测试平台,学生难以在真实环境中安全地测试自主算法。

- VizFlyt利用外部定位和3D高斯溅射技术,构建逼真的虚拟环境,实现安全高效的硬件在环测试。

- 实验表明,VizFlyt能够以超过100Hz的频率更新系统,有效支持无人机自主算法的开发与测试。

📝 摘要(中文)

本文提出VizFlyt,一个开源的、以感知为中心的硬件在环(HITL)逼真测试框架,用于无人机教学。该框架利用外部定位系统提供的位姿信息,通过3D高斯溅射技术生成实时逼真的视觉传感器数据。这使得在无人机上测试自主算法时,无需担心碰撞风险。系统更新频率超过100Hz。基于过往的无人机实践课程经验,本文还提出了一个基于VizFlyt的全新开源软硬件课程。通过在真实HITL实验中测试各种课程项目,验证了该系统的有效性和潜在应用价值。代码、数据集、硬件指南和演示视频可在https://pear.wpi.edu/research/vizflyt.html获取。

🔬 方法详解

问题定义:无人机自主算法的开发和测试需要一个安全可靠的环境。传统的实地测试存在碰撞风险,且成本较高。现有的仿真环境可能不够逼真,无法准确反映真实世界的传感器数据,导致算法在仿真环境中表现良好,但在实际部署中效果不佳。

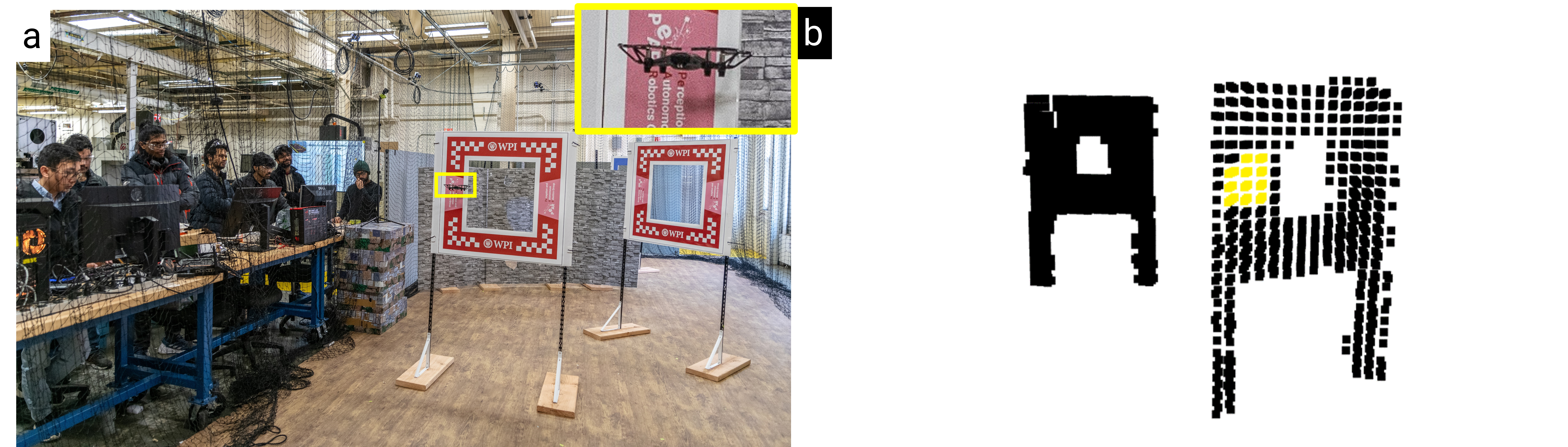

核心思路:VizFlyt的核心思路是利用硬件在环(HITL)仿真,结合外部定位系统和3D高斯溅射技术,创建一个逼真的虚拟环境。无人机的位姿由外部定位系统提供,然后使用3D高斯溅射技术渲染出逼真的视觉传感器数据,从而模拟真实世界的感知输入。这样,学生可以在虚拟环境中安全地测试自主算法,而无需担心碰撞风险。

技术框架:VizFlyt的整体框架包括以下几个主要模块:1) 外部定位系统:用于实时获取无人机的位姿信息。2) 3D高斯溅射渲染引擎:根据无人机的位姿信息,生成逼真的视觉传感器数据。3) 硬件在环仿真平台:将虚拟环境中的传感器数据输入到无人机的飞控系统中,模拟真实世界的感知输入。4) 课程项目:基于VizFlyt平台设计的无人机自主算法课程项目。

关键创新:VizFlyt的关键创新在于将3D高斯溅射技术应用于无人机的硬件在环仿真中。与传统的基于网格或体素的渲染方法相比,3D高斯溅射能够更高效地生成逼真的视觉效果,并且具有更好的可扩展性。此外,VizFlyt还提供了一个完整的开源软硬件课程,方便学生和教师使用。

关键设计:VizFlyt的关键设计包括:1) 使用高精度的外部定位系统,确保无人机位姿信息的准确性。2) 优化3D高斯溅射渲染引擎,提高渲染速度和视觉效果。3) 设计易于使用的API,方便学生开发和测试自主算法。4) 提供详细的硬件指南和课程文档,方便学生和教师使用。

🖼️ 关键图片

📊 实验亮点

VizFlyt系统能够以超过100Hz的频率更新,保证了仿真的实时性。在实际的HITL实验中,VizFlyt成功支持了多个课程项目,包括自主导航、目标跟踪等。实验结果表明,使用VizFlyt开发的算法在真实环境中也具有良好的性能,验证了该框架的有效性。

🎯 应用场景

VizFlyt可应用于无人机自主导航、目标检测与跟踪、SLAM等多个领域的研究与教学。该框架降低了无人机算法开发的门槛,加速了相关技术的创新。未来,VizFlyt有望扩展到其他类型的机器人平台,例如地面机器人和水下机器人,为更广泛的机器人教育和研究提供支持。

📄 摘要(原文)

Autonomous aerial robots are becoming commonplace in our lives. Hands-on aerial robotics courses are pivotal in training the next-generation workforce to meet the growing market demands. Such an efficient and compelling course depends on a reliable testbed. In this paper, we present VizFlyt, an open-source perception-centric Hardware-In-The-Loop (HITL) photorealistic testing framework for aerial robotics courses. We utilize pose from an external localization system to hallucinate real-time and photorealistic visual sensors using 3D Gaussian Splatting. This enables stress-free testing of autonomy algorithms on aerial robots without the risk of crashing into obstacles. We achieve over 100Hz of system update rate. Lastly, we build upon our past experiences of offering hands-on aerial robotics courses and propose a new open-source and open-hardware curriculum based on VizFlyt for the future. We test our framework on various course projects in real-world HITL experiments and present the results showing the efficacy of such a system and its large potential use cases. Code, datasets, hardware guides and demo videos are available at https://pear.wpi.edu/research/vizflyt.html