Reinforcement Learning for Adaptive Planner Parameter Tuning: A Perspective on Hierarchical Architecture

作者: Lu Wangtao, Wei Yufei, Xu Jiadong, Jia Wenhao, Li Liang, Xiong Rong, Wang Yue

分类: cs.RO

发布日期: 2025-03-24

💡 一句话要点

提出基于强化学习的分层架构自适应调整规划器参数,提升机器人导航性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 参数调整 分层架构 机器人导航 自主系统

📋 核心要点

- 现有参数调整方法在复杂受限环境中表现出潜力,但缺乏结构化方法,性能提升受限。

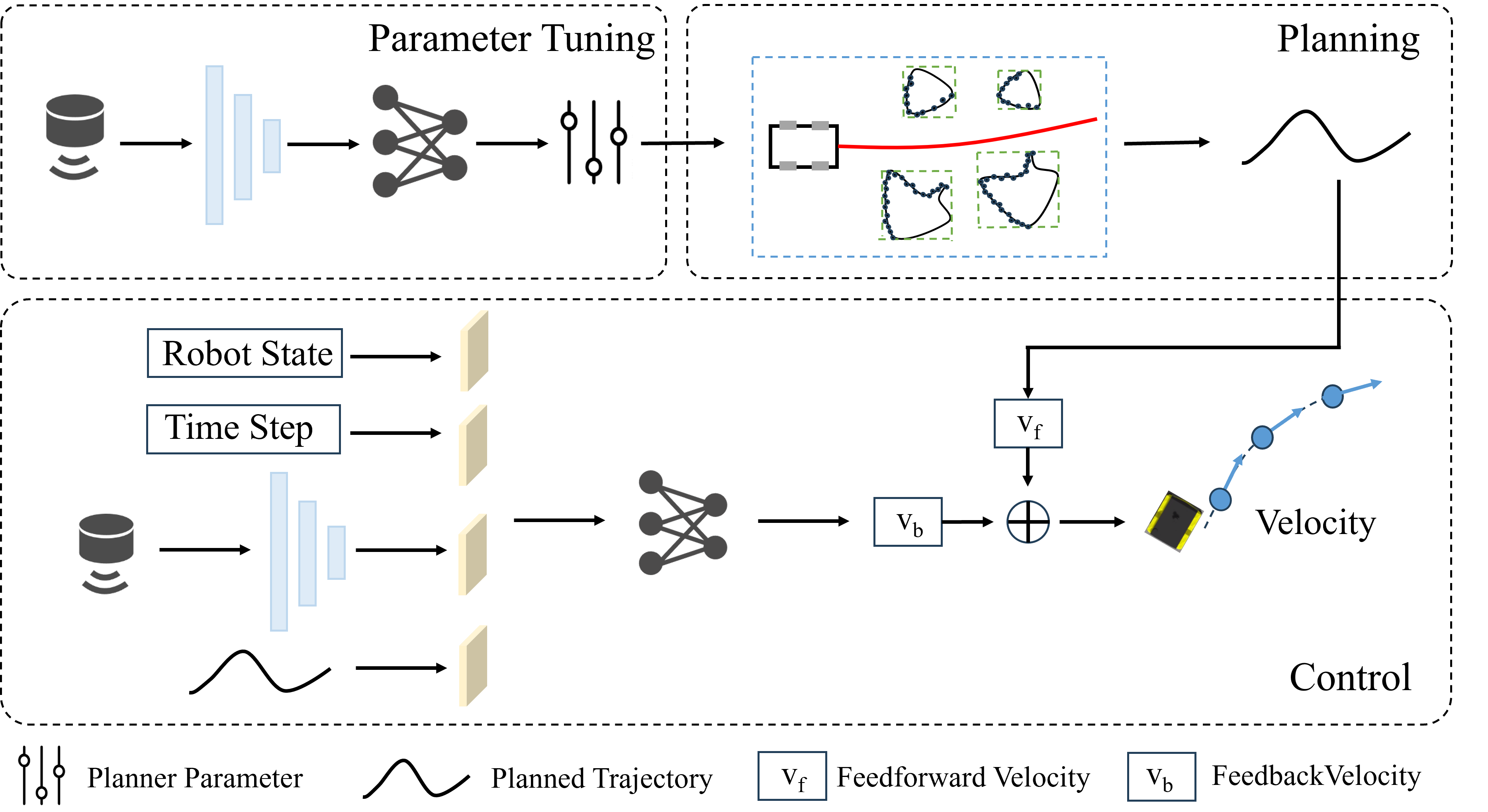

- 论文提出分层强化学习架构,实现低频参数调整、中频规划和高频控制的协同优化。

- 实验表明,该方法超越现有参数调整方法,并在BARN挑战赛中获得第一名。

📝 摘要(中文)

本文提出了一种基于强化学习的分层架构,用于规划算法的自适应参数调整。该架构将参数调整、规划和控制分层,分别以低频率、中频率和高频率运行。通过迭代训练,上层参数调整和下层控制能够同时得到优化。在模拟和真实环境中的实验结果表明,该方法优于现有的参数调整方法。此外,该方法在自主机器人导航基准测试(BARN)挑战赛中获得了第一名。

🔬 方法详解

问题定义:现有规划算法的参数调整方法虽然取得了一定的成功,但仍然依赖于人工经验或简单的自动化搜索。这些方法难以适应复杂多变的环境,并且缺乏一种结构化的方式来同时优化参数调整策略和底层控制策略。因此,如何设计一种能够自适应调整规划器参数,并在复杂环境中实现高性能导航的算法,是一个亟待解决的问题。

核心思路:本文的核心思路是引入分层强化学习架构,将参数调整、规划和控制解耦,并分别以不同的频率运行。通过这种分层结构,上层参数调整策略可以指导下层规划和控制策略的学习,而下层策略的反馈也可以帮助上层策略更好地调整参数。这种协同优化能够有效地提升整体性能。

技术框架:该方法采用三层架构:1) 低频参数调整层:使用强化学习算法,根据环境状态和历史表现,调整规划器的参数。2) 中频规划层:利用调整后的参数,进行路径规划,生成导航轨迹。3) 高频控制层:根据规划的轨迹,控制机器人运动。这三层通过迭代训练进行协同优化。

关键创新:该方法最重要的创新点在于提出了分层强化学习架构,将参数调整、规划和控制解耦,并分别以不同的频率运行。这种分层结构使得上层参数调整策略可以指导下层规划和控制策略的学习,而下层策略的反馈也可以帮助上层策略更好地调整参数。这种协同优化能够有效地提升整体性能,并且具有更好的泛化能力。

关键设计:参数调整层使用强化学习算法(具体算法未知),状态空间包括环境信息和历史表现,动作空间为规划器参数的调整量。奖励函数的设计需要综合考虑导航的效率、安全性以及平滑性。规划层采用现有的路径规划算法(具体算法未知),控制层也采用现有的控制算法(具体算法未知)。关键在于如何设计合适的奖励函数,以及如何平衡各层之间的优化目标。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在模拟和真实环境中均优于现有的参数调整方法。特别是在BARN挑战赛中,该方法获得了第一名,证明了其在复杂环境下的优越性能。具体的性能提升数据未知,但结果表明该方法具有显著的优势。

🎯 应用场景

该研究成果可应用于各种需要自主导航的机器人系统,例如自动驾驶汽车、无人机、仓储机器人等。通过自适应地调整规划器参数,机器人可以在复杂多变的环境中实现更高效、更安全的导航。该方法还可以扩展到其他需要参数调整的算法中,具有广泛的应用前景。

📄 摘要(原文)

Automatic parameter tuning methods for planning algorithms, which integrate pipeline approaches with learning-based techniques, are regarded as promising due to their stability and capability to handle highly constrained environments. While existing parameter tuning methods have demonstrated considerable success, further performance improvements require a more structured approach. In this paper, we propose a hierarchical architecture for reinforcement learning-based parameter tuning. The architecture introduces a hierarchical structure with low-frequency parameter tuning, mid-frequency planning, and high-frequency control, enabling concurrent enhancement of both upper-layer parameter tuning and lower-layer control through iterative training. Experimental evaluations in both simulated and real-world environments show that our method surpasses existing parameter tuning approaches. Furthermore, our approach achieves first place in the Benchmark for Autonomous Robot Navigation (BARN) Challenge.