GI-SLAM: Gaussian-Inertial SLAM

作者: Xulang Liu, Ning Tan

分类: cs.RO, cs.CV

发布日期: 2025-03-24

备注: 10 pages, 2 figures, 5 tables

💡 一句话要点

GI-SLAM:提出一种融合IMU的3D高斯SLAM系统,提升相机跟踪精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: SLAM 3D高斯溅射 IMU融合 相机跟踪 惯性导航

📋 核心要点

- 现有3D高斯SLAM方法忽略了来自惯性测量单元(IMU)的关键惯性数据。

- GI-SLAM通过引入IMU损失,无缝集成到3D高斯溅射SLAM框架,提升相机跟踪性能。

- 实验结果表明,GI-SLAM在EuRoC和TUM-RGBD数据集上达到了与SOTA方法相媲美的性能。

📝 摘要(中文)

本文提出了一种名为GI-SLAM的新型高斯-惯性SLAM系统。该系统由IMU增强的相机跟踪模块和基于真实3D高斯的场景表示组成,用于地图构建。该方法引入了一种IMU损失,可以无缝集成到3D高斯溅射SLAM的深度学习框架中,从而有效地提高相机跟踪的准确性、鲁棒性和效率。此外,我们的SLAM系统支持广泛的传感器配置,包括单目、立体和RGBD相机,无论是否集成IMU。在EuRoC和TUM-RGBD数据集上,该方法与现有的最先进的实时方法相比,取得了具有竞争力的性能。

🔬 方法详解

问题定义:现有的基于3D高斯溅射(3DGS)的SLAM方法在很大程度上忽略了IMU数据,而IMU数据对于提高SLAM系统的精度、鲁棒性和效率至关重要。因此,如何有效地将IMU数据融入到3DGS SLAM框架中是一个关键问题。

核心思路:GI-SLAM的核心思路是将IMU数据通过一个新颖的IMU损失函数集成到3DGS SLAM的优化过程中。通过最小化IMU预测的运动与视觉估计的运动之间的差异,可以有效地约束相机位姿,从而提高跟踪精度和鲁棒性。

技术框架:GI-SLAM系统主要包含两个模块:IMU增强的相机跟踪模块和基于3D高斯的场景表示模块。相机跟踪模块利用视觉信息和IMU数据进行位姿估计,并将估计结果用于优化3D高斯场景表示。整个系统采用深度学习框架,通过可微分渲染实现快速训练和优化。

关键创新:GI-SLAM的关键创新在于提出了一个能够无缝集成到3DGS SLAM框架中的IMU损失函数。该损失函数能够有效地利用IMU数据来约束相机位姿,从而提高跟踪精度和鲁棒性。与传统的视觉SLAM方法相比,GI-SLAM能够更好地处理光照变化、运动模糊等问题。

关键设计:IMU损失函数的设计是关键。具体来说,该损失函数计算IMU预测的相机运动(例如,旋转和平移)与基于视觉信息估计的相机运动之间的差异。损失函数的具体形式可能包括旋转误差和位置误差的加权和。权重的选择可能需要根据具体的传感器配置和数据集进行调整。此外,系统还支持多种传感器配置,包括单目、立体和RGBD相机,以及是否集成IMU。

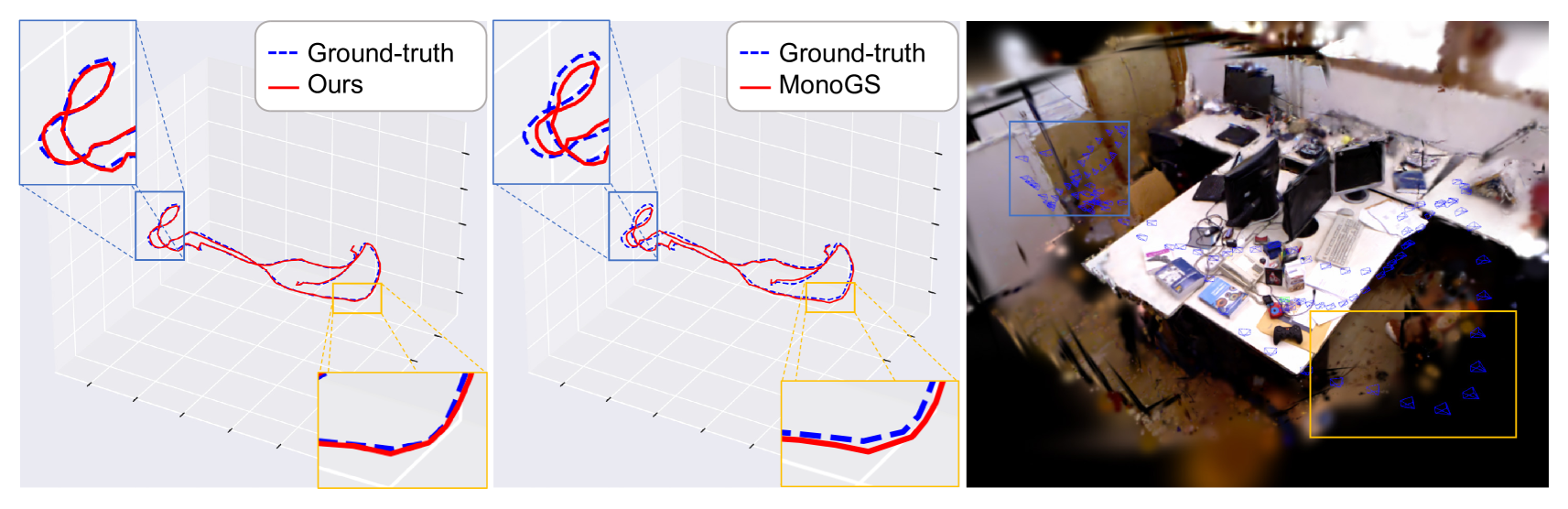

🖼️ 关键图片

📊 实验亮点

GI-SLAM在EuRoC和TUM-RGBD数据集上进行了评估,实验结果表明,该方法与现有的最先进的实时SLAM方法相比,取得了具有竞争力的性能。具体来说,GI-SLAM在相机跟踪精度和鲁棒性方面均有所提升,尤其是在具有挑战性的场景中,例如光照变化剧烈或运动模糊严重的情况下。

🎯 应用场景

GI-SLAM具有广泛的应用前景,例如增强现实、机器人导航、无人机自主飞行等。通过融合IMU数据,GI-SLAM能够提供更准确、更鲁棒的定位和地图构建能力,从而提高这些应用场景的性能和可靠性。未来,GI-SLAM可以进一步扩展到更大规模、更复杂的环境中,并与其他传感器(如激光雷达)融合,以实现更全面的感知能力。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has recently emerged as a powerful representation of geometry and appearance for dense Simultaneous Localization and Mapping (SLAM). Through rapid, differentiable rasterization of 3D Gaussians, many 3DGS SLAM methods achieve near real-time rendering and accelerated training. However, these methods largely overlook inertial data, witch is a critical piece of information collected from the inertial measurement unit (IMU). In this paper, we present GI-SLAM, a novel gaussian-inertial SLAM system which consists of an IMU-enhanced camera tracking module and a realistic 3D Gaussian-based scene representation for mapping. Our method introduces an IMU loss that seamlessly integrates into the deep learning framework underpinning 3D Gaussian Splatting SLAM, effectively enhancing the accuracy, robustness and efficiency of camera tracking. Moreover, our SLAM system supports a wide range of sensor configurations, including monocular, stereo, and RGBD cameras, both with and without IMU integration. Our method achieves competitive performance compared with existing state-of-the-art real-time methods on the EuRoC and TUM-RGBD datasets.