GS-LTS: 3D Gaussian Splatting-Based Adaptive Modeling for Long-Term Service Robots

作者: Bin Fu, Jialin Li, Bin Zhang, Ruiping Wang, Xilin Chen

分类: cs.RO, cs.CV

发布日期: 2025-03-22

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

GS-LTS:基于3D高斯溅射的自适应建模,用于长期服务机器人

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 长期服务机器人 动态场景 场景更新 单图像变化检测 多视角观测 高斯编辑

📋 核心要点

- 现有基于3DGS的方法主要关注静态场景,缺乏对长期服务机器人所需动态场景变化的有效处理。

- GS-LTS通过单图像变化检测、自主多视角观测和高斯编辑,实现了动态场景下的高效场景表示更新。

- 实验结果表明,GS-LTS在重建、导航和场景更新方面优于现有方法,并提供了一个新的仿真基准。

📝 摘要(中文)

本文提出GS-LTS(Gaussian Splatting for Long-Term Service),一个基于3D高斯溅射的系统,旨在使室内机器人在动态环境中执行长期任务。GS-LTS通过单图像变化检测来识别场景变化(例如,物体的添加或移除),并采用基于规则的策略自主收集多视角观测数据,然后通过高斯编辑高效地更新场景表示。此外,本文还提出了一个基于仿真的基准测试,该基准自动生成场景变化数据作为紧凑的配置脚本,提供了一个标准化的、用户友好的评估基准。实验结果表明,GS-LTS在重建、导航和场景更新方面具有优势,比图像训练基线更快且质量更高,从而推动了3DGS在长期机器人操作中的应用。

🔬 方法详解

问题定义:长期服务机器人需要在动态环境中持续执行任务,而现有基于3D高斯溅射的方法主要针对静态场景,无法有效处理场景中物体的增加、移除等变化,导致重建质量下降和导航性能受限。现有方法缺乏高效的场景更新机制,难以适应长期运行的需求。

核心思路:GS-LTS的核心思路是利用单图像变化检测来快速识别场景中的变化,然后通过自主的多视角观测策略来收集新的数据,最后利用高斯编辑来高效地更新3D高斯溅射表示。这种方法避免了对整个场景进行重新训练,从而提高了场景更新的效率。

技术框架:GS-LTS系统主要包含以下几个模块:1) 单图像变化检测模块,用于检测场景中的变化;2) 基于规则的多视角观测策略,用于自主收集新的观测数据;3) 高斯编辑模块,用于更新3D高斯溅射表示;4) 基于仿真的基准测试,用于评估系统性能。整个流程是:首先,机器人利用相机获取当前场景的图像,并使用变化检测模块识别场景中的变化。然后,根据基于规则的策略,机器人自主地移动到不同的视角,收集新的观测数据。最后,利用高斯编辑模块,将新的观测数据融入到现有的3D高斯溅射表示中,完成场景的更新。

关键创新:GS-LTS的关键创新在于:1) 提出了一种基于单图像变化检测的场景变化识别方法,能够快速准确地检测场景中的变化;2) 设计了一种基于规则的多视角观测策略,能够自主地收集新的观测数据,无需人工干预;3) 采用高斯编辑方法,能够高效地更新3D高斯溅射表示,避免了对整个场景进行重新训练。

关键设计:单图像变化检测模块使用了预训练的深度学习模型,例如Mask R-CNN,来检测图像中的物体,并比较前后两帧图像中物体的差异。多视角观测策略基于规则,例如,如果检测到某个物体被移除,则机器人会移动到该物体原来所在的位置,从不同的角度观察该区域。高斯编辑模块通过调整高斯参数(例如,位置、大小、颜色、透明度)来更新3D高斯溅射表示。损失函数包括重建损失、正则化损失等,用于优化高斯参数。

🖼️ 关键图片

📊 实验亮点

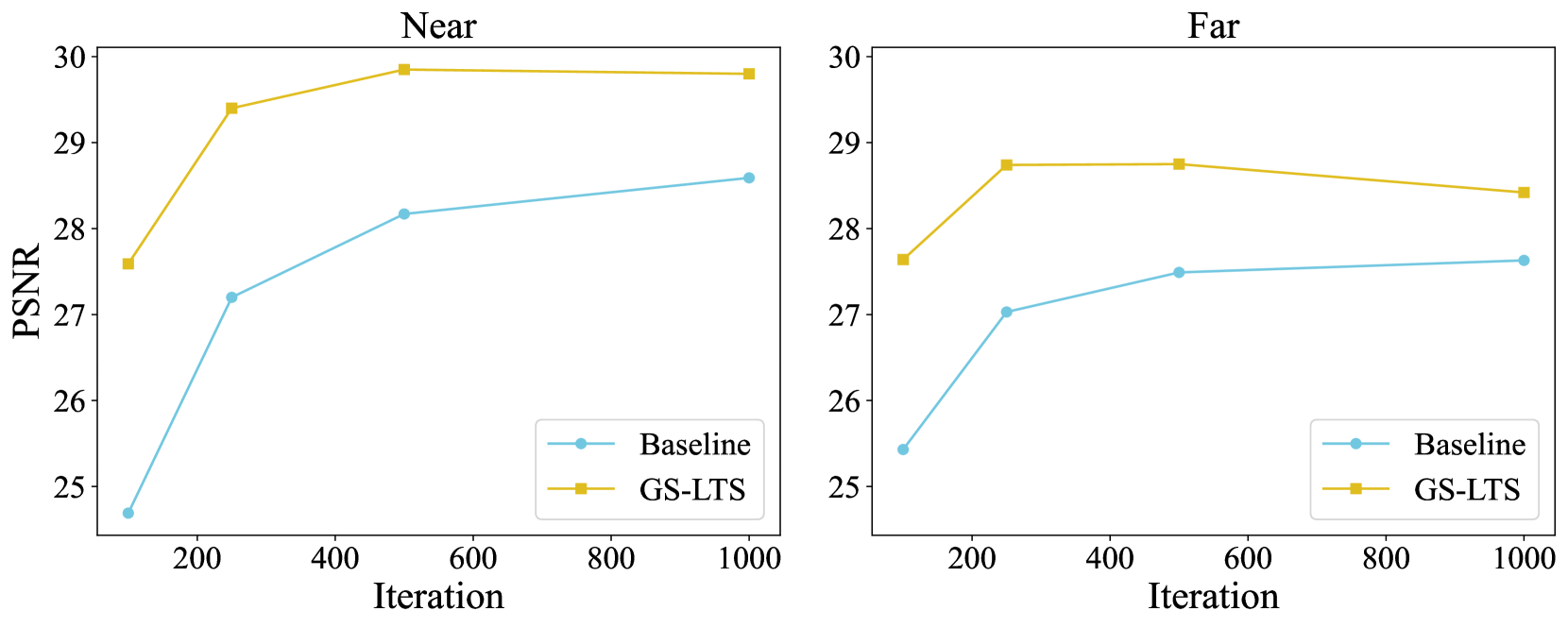

实验结果表明,GS-LTS在重建质量、导航性能和场景更新速度方面均优于现有方法。具体来说,GS-LTS在重建质量方面取得了显著提升,在导航任务中能够更准确地定位和规划路径,并且场景更新速度比基于图像训练的基线方法快得多,同时保持了更高的重建质量。该论文还提供了一个新的仿真基准,方便研究人员进行算法评估和比较。

🎯 应用场景

GS-LTS在长期服务机器人领域具有广泛的应用前景,例如,可用于家庭服务机器人、商场导购机器人、医院巡检机器人等。这些机器人需要在动态环境中持续执行任务,例如,递送物品、引导顾客、检查设备等。GS-LTS能够使这些机器人更好地适应环境变化,提高任务执行的效率和可靠性,并为机器人提供更强的环境感知能力。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has garnered significant attention in robotics for its explicit, high fidelity dense scene representation, demonstrating strong potential for robotic applications. However, 3DGS-based methods in robotics primarily focus on static scenes, with limited attention to the dynamic scene changes essential for long-term service robots. These robots demand sustained task execution and efficient scene updates-challenges current approaches fail to meet. To address these limitations, we propose GS-LTS (Gaussian Splatting for Long-Term Service), a 3DGS-based system enabling indoor robots to manage diverse tasks in dynamic environments over time. GS-LTS detects scene changes (e.g., object addition or removal) via single-image change detection, employs a rule-based policy to autonomously collect multi-view observations, and efficiently updates the scene representation through Gaussian editing. Additionally, we propose a simulation-based benchmark that automatically generates scene change data as compact configuration scripts, providing a standardized, user-friendly evaluation benchmark. Experimental results demonstrate GS-LTS's advantages in reconstruction, navigation, and superior scene updates-faster and higher quality than the image training baseline-advancing 3DGS for long-term robotic operations. Code and benchmark are available at: https://vipl-vsu.github.io/3DGS-LTS.