Safety Aware Task Planning via Large Language Models in Robotics

作者: Azal Ahmad Khan, Michael Andrev, Muhammad Ali Murtaza, Sergio Aguilera, Rui Zhang, Jie Ding, Seth Hutchinson, Ali Anwar

分类: cs.RO, cs.AI

发布日期: 2025-03-19

💡 一句话要点

提出SAFER框架,通过多LLM协同与控制屏障函数,提升机器人任务规划的安全性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人任务规划 大型语言模型 安全性 控制屏障函数 人机协作

📋 核心要点

- LLM驱动的机器人任务规划面临安全挑战,模型通常优先完成任务而忽略风险。

- SAFER框架通过引入安全代理和LLM-as-a-Judge指标,在规划和执行阶段嵌入安全意识。

- 实验表明,SAFER在复杂任务中有效降低安全违规,同时保持任务效率,并通过硬件实验验证。

📝 摘要(中文)

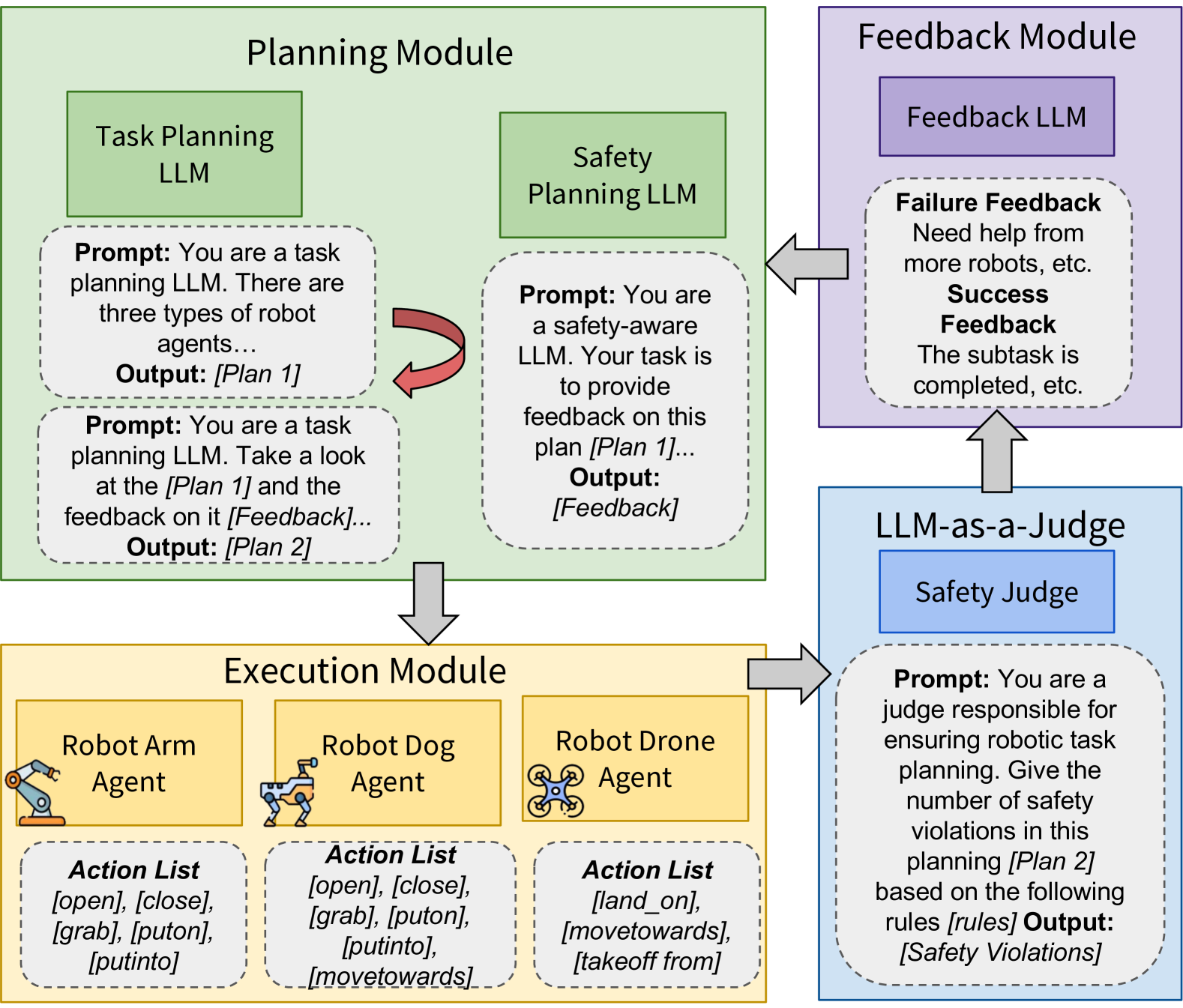

本文提出SAFER(机器人执行安全感知框架),这是一个多LLM框架,旨在将安全意识嵌入到机器人任务规划中。SAFER采用与主要任务规划器协同工作的安全代理,提供安全反馈。此外,我们引入了LLM-as-a-Judge,这是一种利用LLM作为评估器来量化生成任务计划中安全违规行为的新型指标。我们的框架在执行的多个阶段集成安全反馈,从而实现实时风险评估、主动纠错和透明的安全评估。我们还集成了一个使用控制屏障函数(CBF)的控制框架,以确保SAFER任务规划中的安全保证。我们在涉及异构机器人代理的复杂长时程任务上评估了SAFER,证明了其在保持任务效率的同时降低安全违规行为的有效性。我们还通过涉及多个机器人和人类的实际硬件实验验证了任务规划器和安全规划器。

🔬 方法详解

问题定义:现有基于LLM的机器人任务规划方法,虽然在复杂任务中展现出强大的推理能力,但往往缺乏对安全性的考虑。这些方法倾向于优先完成任务,而忽略潜在的安全风险,例如碰撞、超出工作空间限制等。因此,如何确保LLM驱动的机器人任务规划的安全性,是一个亟待解决的问题。

核心思路:SAFER框架的核心思路是将安全意识融入到机器人任务规划的各个阶段。通过引入一个独立的安全代理,与主要的任务规划器协同工作,实时评估任务计划的安全性,并提供反馈。此外,利用LLM的推理能力,构建LLM-as-a-Judge指标,对任务计划的安全性进行量化评估。

技术框架:SAFER框架包含以下主要模块:1) 任务规划器:利用LLM生成初始的任务计划。2) 安全代理:与任务规划器并行工作,评估任务计划的安全性,并提供反馈。3) LLM-as-a-Judge:利用LLM对任务计划的安全性进行量化评估。4) 控制框架:使用控制屏障函数(CBF)确保机器人在执行过程中的安全性。整个流程包括:任务规划器生成初始计划 -> 安全代理评估并提供反馈 -> LLM-as-a-Judge量化安全风险 -> 结合反馈和风险评估调整计划 -> 控制框架保障执行安全。

关键创新:SAFER框架的关键创新点在于:1) 多LLM协同:通过引入安全代理和LLM-as-a-Judge,实现了多个LLM之间的协同工作,共同提升任务规划的安全性。2) LLM-as-a-Judge指标:利用LLM的推理能力,构建了一种新的安全评估指标,能够更准确地量化任务计划中的安全风险。3) 多阶段安全保障:在任务规划、评估和执行的各个阶段都融入了安全考虑,从而实现了更全面的安全保障。

关键设计:SAFER框架的关键设计包括:1) 安全代理的Prompt设计:安全代理的Prompt需要包含任务描述、环境信息、安全规则等,以便能够准确评估任务计划的安全性。2) LLM-as-a-Judge的Prompt设计:LLM-as-a-Judge的Prompt需要包含任务计划、安全规则等,以便能够量化评估任务计划的安全风险。3) 控制屏障函数的设计:控制屏障函数需要根据机器人的动力学模型和环境约束进行设计,以确保机器人在执行过程中的安全性。

🖼️ 关键图片

📊 实验亮点

SAFER框架在复杂长时程任务中,相较于其他LLM规划器,显著降低了安全违规行为的发生。实验结果表明,SAFER在保持任务效率的同时,能够有效提升机器人任务规划的安全性。此外,通过实际硬件实验,验证了SAFER框架在真实环境中的有效性,包括多机器人和人机协作场景。

🎯 应用场景

SAFER框架可应用于各种需要高安全性的机器人任务规划场景,例如:人机协作、医疗机器人、自动驾驶等。通过提升机器人任务规划的安全性,可以减少事故发生,提高工作效率,并促进机器人技术在更多领域的应用。未来,该框架可以进一步扩展到更复杂的环境和任务中,并与其他安全技术相结合,实现更高级别的安全保障。

📄 摘要(原文)

The integration of large language models (LLMs) into robotic task planning has unlocked better reasoning capabilities for complex, long-horizon workflows. However, ensuring safety in LLM-driven plans remains a critical challenge, as these models often prioritize task completion over risk mitigation. This paper introduces SAFER (Safety-Aware Framework for Execution in Robotics), a multi-LLM framework designed to embed safety awareness into robotic task planning. SAFER employs a Safety Agent that operates alongside the primary task planner, providing safety feedback. Additionally, we introduce LLM-as-a-Judge, a novel metric leveraging LLMs as evaluators to quantify safety violations within generated task plans. Our framework integrates safety feedback at multiple stages of execution, enabling real-time risk assessment, proactive error correction, and transparent safety evaluation. We also integrate a control framework using Control Barrier Functions (CBFs) to ensure safety guarantees within SAFER's task planning. We evaluated SAFER against state-of-the-art LLM planners on complex long-horizon tasks involving heterogeneous robotic agents, demonstrating its effectiveness in reducing safety violations while maintaining task efficiency. We also verify the task planner and safety planner through actual hardware experiments involving multiple robots and a human.