CCDP: Composition of Conditional Diffusion Policies with Guided Sampling

作者: Amirreza Razmjoo, Sylvain Calinon, Michael Gienger, Fan Zhang

分类: cs.RO, cs.AI

发布日期: 2025-03-19 (更新: 2025-10-25)

备注: Accepted to IROS 2025

💡 一句话要点

CCDP:结合引导采样的条件扩散策略组合,提升模仿学习的容错性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 扩散模型 条件生成 机器人控制 采样策略

📋 核心要点

- 现有模仿学习方法在动作采样失败时效率低下,简单重复采样难以保证成功。

- CCDP通过细化采样分布,避免先前失败的动作,从而推断出恢复动作。

- 实验表明,CCDP在多种任务中优于传统基线,提升了模仿学习的容错性和效率。

📝 摘要(中文)

模仿学习提供了一种直接从数据中学习的方法,无需显式模型、仿真或详细的任务定义。在推理过程中,动作从学习到的分布中采样并在机器人上执行。然而,采样动作可能因各种原因而失败,简单地重复采样步骤直到获得成功的动作可能效率低下。本文提出了一种增强的采样策略,该策略细化采样分布以避免先前不成功的动作。我们证明,仅利用成功演示的数据,我们的方法就可以推断出恢复动作,而无需额外的探索行为或高级控制器。此外,我们利用扩散模型分解的概念,将可能需要长时程历史来管理失败的主要问题分解为多个更小、更易于管理的子问题,从而使系统能够适应可变的失败次数。我们的方法产生了一个低级控制器,该控制器动态调整其采样空间,以提高先前样本不足时的效率。我们在多个任务中验证了我们的方法,包括未知方向的开门、物体操作和按钮搜索场景,证明我们的方法优于传统的基线。

🔬 方法详解

问题定义:论文旨在解决模仿学习中,由于各种原因导致采样动作失败,而简单重复采样效率低下的问题。现有方法通常需要额外的探索行为或高级控制器来处理失败情况,增加了复杂性和成本。

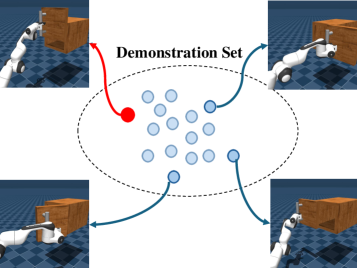

核心思路:论文的核心思路是利用成功演示的数据,学习一个条件扩散模型,该模型能够根据历史动作的成功与否,动态调整采样分布,从而避免重复采样失败的动作,并推断出恢复动作。这种方法无需额外的探索行为或高级控制器。

技术框架:CCDP的整体框架包含以下几个主要阶段:1) 数据收集:收集成功演示的数据。2) 模型训练:训练条件扩散模型,该模型以历史动作为条件,预测下一个动作的分布。3) 采样:从扩散模型中采样动作。4) 失败检测:检测采样动作是否失败。5) 分布调整:如果动作失败,则根据失败的历史动作,调整扩散模型的采样分布,避免重复采样失败的动作。6) 重复采样:从调整后的分布中重新采样动作,直到成功或达到最大尝试次数。

关键创新:论文的关键创新在于:1) 提出了一种基于条件扩散模型的采样策略,能够根据历史动作的成功与否,动态调整采样分布。2) 利用扩散模型分解的概念,将长时程问题分解为多个更易于管理的子问题,从而提高学习效率和适应性。3) 仅利用成功演示的数据,即可推断出恢复动作,无需额外的探索行为或高级控制器。

关键设计:论文的关键设计包括:1) 使用扩散模型作为生成模型,能够学习复杂的动作分布。2) 使用条件扩散模型,将历史动作作为条件,从而能够根据历史信息调整采样分布。3) 使用扩散模型分解,将长时程问题分解为多个短时程子问题,降低学习难度。4) 设计了合适的损失函数,用于训练条件扩散模型,使其能够准确预测下一个动作的分布。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CCDP在开门、物体操作和按钮搜索等任务中,显著优于传统基线方法。例如,在开门任务中,CCDP能够成功打开未知方向的门,而传统方法则难以完成。在物体操作任务中,CCDP能够更有效地处理干扰和不确定性,提高操作成功率。这些结果验证了CCDP的有效性和优越性。

🎯 应用场景

CCDP可应用于各种机器人任务,例如物体操作、导航和人机交互。它能够提高机器人在复杂环境中的鲁棒性和适应性,降低对额外探索行为或高级控制器的依赖,从而简化机器人系统的设计和部署。该方法在工业自动化、服务机器人和自主导航等领域具有广泛的应用前景。

📄 摘要(原文)

Imitation Learning offers a promising approach to learn directly from data without requiring explicit models, simulations, or detailed task definitions. During inference, actions are sampled from the learned distribution and executed on the robot. However, sampled actions may fail for various reasons, and simply repeating the sampling step until a successful action is obtained can be inefficient. In this work, we propose an enhanced sampling strategy that refines the sampling distribution to avoid previously unsuccessful actions. We demonstrate that by solely utilizing data from successful demonstrations, our method can infer recovery actions without the need for additional exploratory behavior or a high-level controller. Furthermore, we leverage the concept of diffusion model decomposition to break down the primary problem, which may require long-horizon history to manage failures, into multiple smaller, more manageable sub-problems in learning, data collection, and inference, thereby enabling the system to adapt to variable failure counts. Our approach yields a low-level controller that dynamically adjusts its sampling space to improve efficiency when prior samples fall short. We validate our method across several tasks, including door opening with unknown directions, object manipulation, and button-searching scenarios, demonstrating that our approach outperforms traditional baselines.