HAD-Gen: Human-like and Diverse Driving Behavior Modeling for Controllable Scenario Generation

作者: Cheng Wang, Lingxin Kong, Massimiliano Tamborski, Stefano V. Albrecht

分类: cs.RO, cs.AI, cs.MA

发布日期: 2025-03-19

DOI: 10.1016/j.aap.2025.108270

🔗 代码/项目: GITHUB

💡 一句话要点

HAD-Gen:提出类人且多样化的驾驶行为建模方法,用于可控场景生成。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自动驾驶 场景生成 驾驶行为建模 逆强化学习 多智能体强化学习

📋 核心要点

- 现有确定性和模仿学习驾驶模型难以捕捉类人驾驶行为的多样性,限制了自动驾驶汽车的验证。

- HAD-Gen框架通过聚类驾驶风格、逆强化学习奖励函数和多智能体强化学习,模拟多样化类人驾驶行为。

- 实验结果表明,HAD-Gen在目标到达率上优于现有方法20%以上,展示了强大的泛化能力。

📝 摘要(中文)

基于仿真的测试已成为验证和确认自动驾驶汽车(AVs)的重要工具。然而,现有的方法,如确定性驾驶员模型和基于模仿学习的驾驶员模型,难以捕捉类人驾驶行为的多样性。针对这些挑战,我们提出了HAD-Gen,一个通用的现实交通场景生成框架,可以模拟多样化的类人驾驶行为。该框架首先根据安全特征将车辆轨迹数据聚类成不同的驾驶风格。然后,它在每个聚类上采用最大熵逆强化学习,以学习对应于每种驾驶风格的奖励函数。利用这些奖励函数,该方法集成了离线强化学习预训练和多智能体强化学习算法,以获得通用且鲁棒的驾驶策略。多角度仿真结果表明,我们提出的场景生成框架可以模拟具有强大泛化能力的多样化、类人驾驶行为。在泛化测试中,该框架实现了90.96%的目标到达率、2.08%的越野率和6.91%的碰撞率,在目标到达性能方面优于现有方法20%以上。源代码已发布在https://github.com/RoboSafe-Lab/Sim4AD。

🔬 方法详解

问题定义:论文旨在解决自动驾驶仿真测试中,现有驾驶员模型无法有效模拟类人驾驶行为多样性的问题。确定性模型过于刻板,而模仿学习模型泛化能力不足,难以应对复杂交通场景,导致仿真测试不够真实和全面。

核心思路:论文的核心思路是将驾驶行为分解为不同的驾驶风格,并为每种风格学习对应的奖励函数。通过逆强化学习从真实驾驶数据中提取奖励函数,然后利用强化学习训练具有特定驾驶风格的智能体。这种方法能够更好地捕捉人类驾驶行为的差异性,并提高模型的泛化能力。

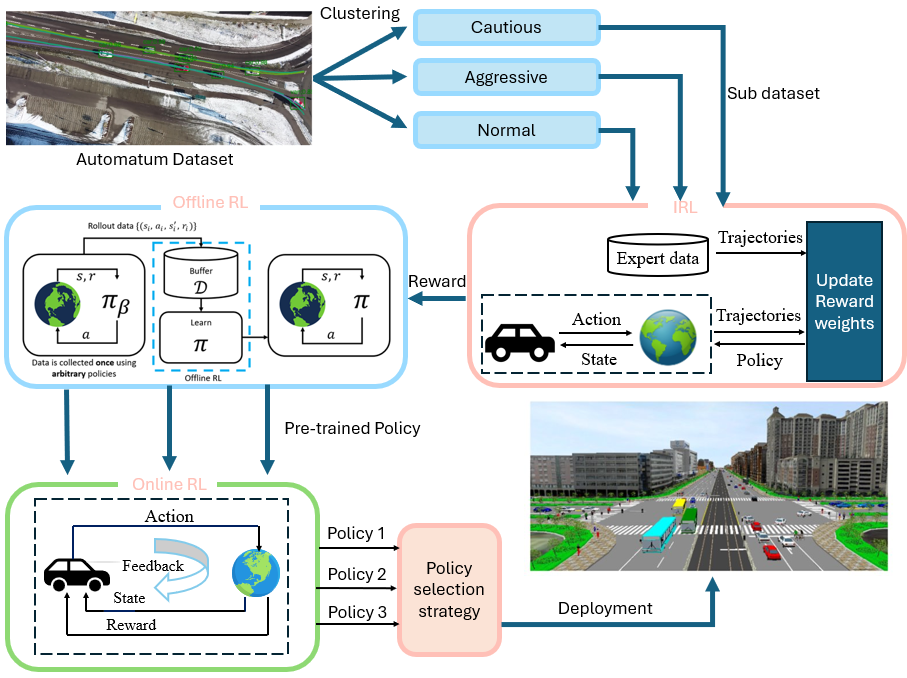

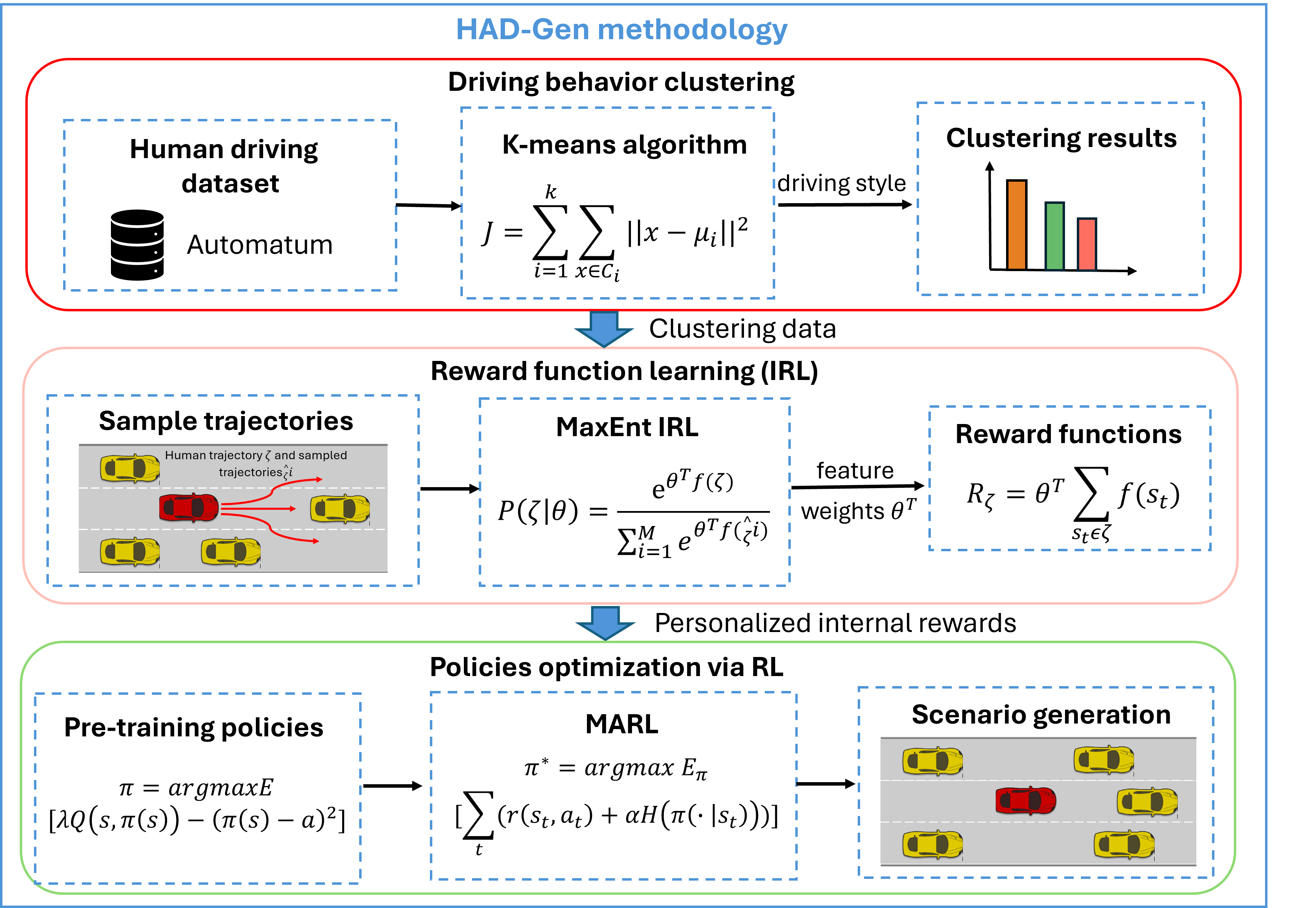

技术框架:HAD-Gen框架包含以下主要模块:1) 驾驶风格聚类:利用安全特征对车辆轨迹数据进行聚类,将驾驶行为划分为不同的风格。2) 逆强化学习:对每个驾驶风格的聚类数据,使用最大熵逆强化学习算法学习对应的奖励函数。3) 强化学习训练:利用学习到的奖励函数,结合离线强化学习预训练和多智能体强化学习算法,训练具有特定驾驶风格的驾驶策略。4) 场景生成:通过控制不同驾驶风格的智能体,生成多样化的交通场景。

关键创新:该论文的关键创新在于将驾驶行为建模问题转化为驾驶风格识别和奖励函数学习问题。通过聚类和逆强化学习,能够从真实数据中提取出不同驾驶风格的特征,并用于训练具有特定风格的驾驶策略。这种方法比传统的确定性模型和模仿学习模型更具灵活性和泛化能力。

关键设计:在驾驶风格聚类阶段,论文使用了基于安全特征的聚类方法,例如与周围车辆的距离、速度差等。在逆强化学习阶段,采用了最大熵逆强化学习算法,以学习更加鲁棒的奖励函数。在强化学习训练阶段,结合了离线强化学习预训练和多智能体强化学习算法,以提高训练效率和策略的泛化能力。具体的参数设置和网络结构在论文中有详细描述,但摘要中未提及具体数值。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HAD-Gen框架在泛化测试中实现了90.96%的目标到达率,2.08%的越野率和6.91%的碰撞率。与现有方法相比,HAD-Gen在目标到达性能方面提高了20%以上,证明了其在模拟多样化类人驾驶行为方面的有效性和优越性。这些数据表明,该框架能够生成更真实、更具挑战性的交通场景。

🎯 应用场景

HAD-Gen框架可应用于自动驾驶汽车的仿真测试、验证和评估。通过生成多样化的交通场景,可以更全面地测试自动驾驶系统的性能和安全性。此外,该框架还可以用于训练自动驾驶算法,提高其在复杂交通环境中的适应能力。该研究有助于推动自动驾驶技术的安全可靠发展。

📄 摘要(原文)

Simulation-based testing has emerged as an essential tool for verifying and validating autonomous vehicles (AVs). However, contemporary methodologies, such as deterministic and imitation learning-based driver models, struggle to capture the variability of human-like driving behavior. Given these challenges, we propose HAD-Gen, a general framework for realistic traffic scenario generation that simulates diverse human-like driving behaviors. The framework first clusters the vehicle trajectory data into different driving styles according to safety features. It then employs maximum entropy inverse reinforcement learning on each of the clusters to learn the reward function corresponding to each driving style. Using these reward functions, the method integrates offline reinforcement learning pre-training and multi-agent reinforcement learning algorithms to obtain general and robust driving policies. Multi-perspective simulation results show that our proposed scenario generation framework can simulate diverse, human-like driving behaviors with strong generalization capability. The proposed framework achieves a 90.96% goal-reaching rate, an off-road rate of 2.08%, and a collision rate of 6.91% in the generalization test, outperforming prior approaches by over 20% in goal-reaching performance. The source code is released at https://github.com/RoboSafe-Lab/Sim4AD.