Learning Bimanual Manipulation via Action Chunking and Inter-Arm Coordination with Transformers

作者: Tomohiro Motoda, Ryo Hanai, Ryoichi Nakajo, Masaki Murooka, Floris Erich, Yukiyasu Domae

分类: cs.RO, cs.AI

发布日期: 2025-03-18

备注: 6 pages, 5 figures, 1 table

💡 一句话要点

提出基于Transformer的双臂协同动作学习框架,提升灵巧操作能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 双臂操作 模仿学习 Transformer 臂间协同 机器人控制

📋 核心要点

- 现有基于学习的双臂操作方法难以有效处理高自由度机器人控制问题,且左右臂动作调整复杂。

- 提出一种模仿学习架构,核心在于臂间协同Transformer编码器(IACE),用于同步和对齐双臂动作。

- 实验表明,该模型在特定双臂任务中表现出高成功率,验证了其在双臂操作策略学习中的有效性。

📝 摘要(中文)

为了使机器人能够在人类生活环境中自主操作,需要具备灵活处理各种任务的能力。其中,协调的双臂运动至关重要,它能够实现单手难以完成的功能。近年来,涌现出许多关注双臂运动可能性的基于学习的模型。然而,机器人高自由度使得控制推理具有挑战性,并且左右臂需要根据情况调整动作,这使得实现更灵巧的任务变得困难。为了解决这个问题,我们专注于双臂之间的协调和效率,特别是对于同步动作。因此,我们提出了一种新的模仿学习架构,用于预测协同动作。我们区分了双臂的架构,并添加了一个中间编码器层,即臂间协同Transformer编码器(IACE),以促进同步和时间对齐,从而确保平滑和协调的动作。为了验证我们架构的有效性,我们执行了独特的双臂任务。实验结果表明,我们的模型在比较中表现出很高的成功率,并为双臂操作的策略学习提供了一个合适的架构。

🔬 方法详解

问题定义:论文旨在解决双臂机器人操作中,由于高自由度和左右臂动作协调复杂性导致的灵巧操作困难问题。现有方法难以有效推理控制策略,尤其是在同步动作方面表现不足。

核心思路:论文的核心思路是通过引入臂间协同机制,显式地建模左右臂之间的依赖关系,从而提高双臂动作的协调性和同步性。通过模仿学习,使机器人能够学习人类的双臂协同操作技能。

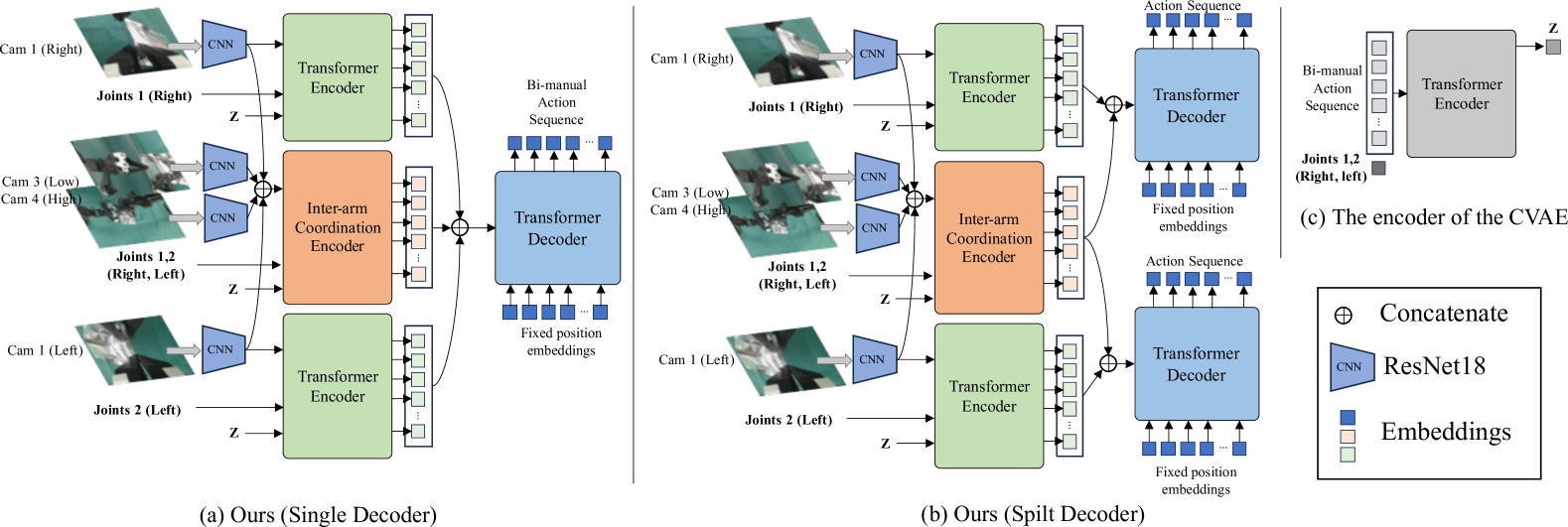

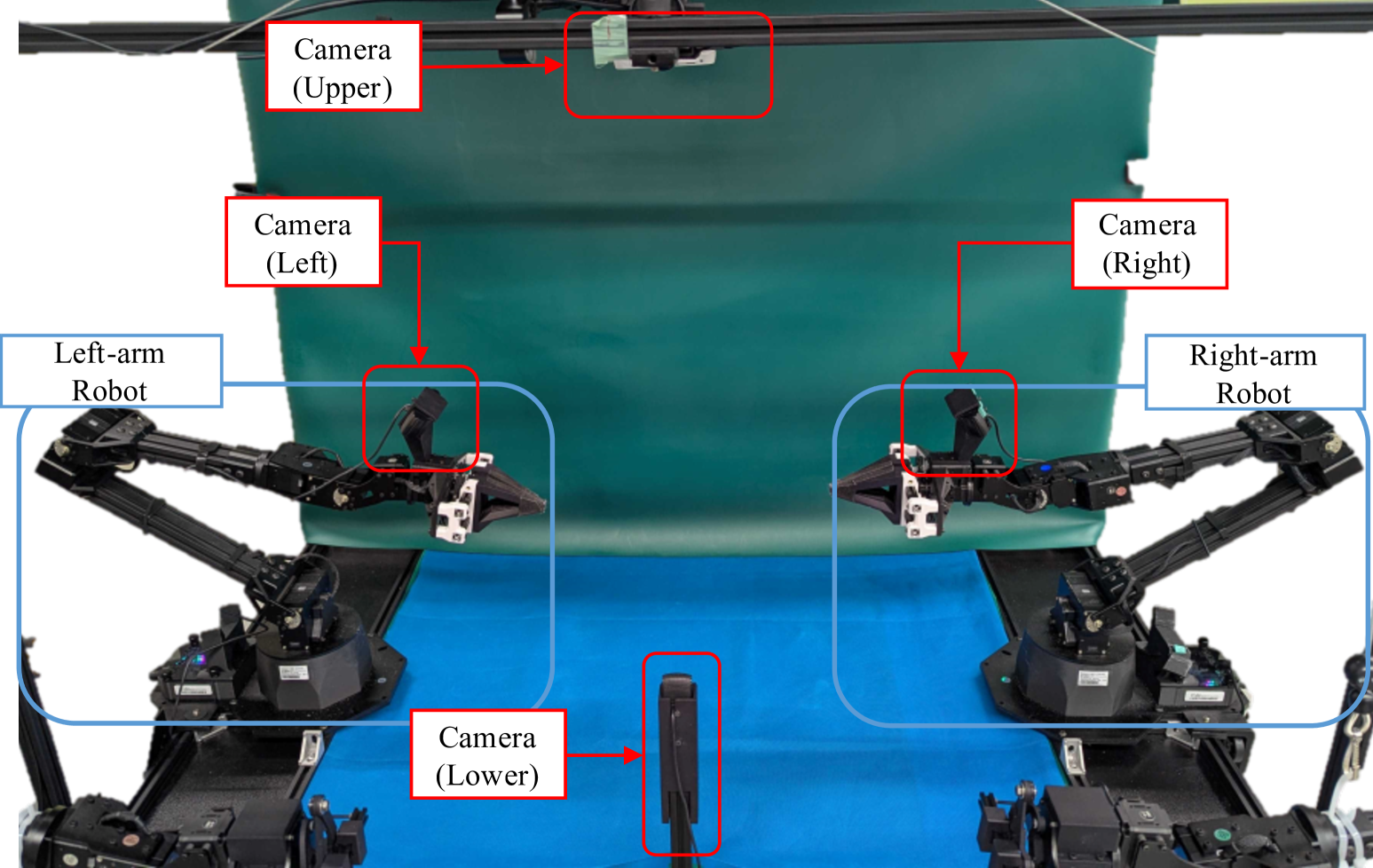

技术框架:整体框架是一个模仿学习流程,包含以下主要模块:1) 左右臂独立的动作预测网络;2) 臂间协同Transformer编码器(IACE),用于融合左右臂的特征表示,实现信息交互和动作同步;3) 动作解码器,用于生成最终的左右臂动作指令。整个流程通过模仿人类的动作轨迹进行训练。

关键创新:最关键的创新点在于IACE模块的设计。IACE利用Transformer的自注意力机制,能够有效地捕捉左右臂之间的时序依赖关系,并进行特征融合,从而实现更好的动作同步和协调。与传统的独立控制方法相比,IACE能够显式地建模臂间关系,提升协同操作的性能。

关键设计:IACE模块采用Transformer编码器的结构,输入是左右臂的特征向量序列,输出是融合后的特征向量序列。损失函数采用均方误差(MSE),用于衡量预测动作与真实动作之间的差异。具体的网络结构和参数设置在论文中有详细描述,例如Transformer的层数、注意力头的数量等。

🖼️ 关键图片

📊 实验亮点

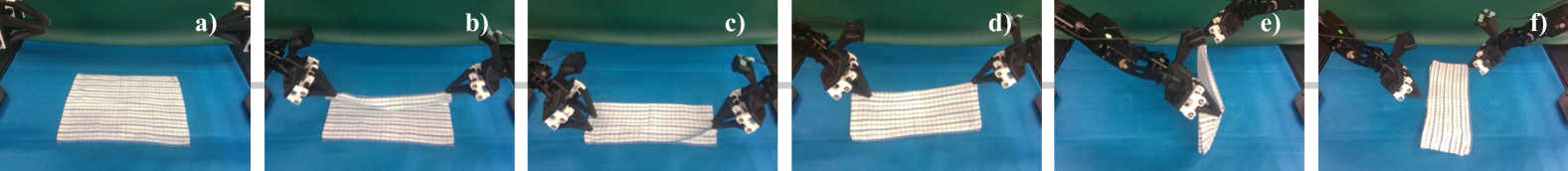

实验结果表明,所提出的模型在特定的双臂操作任务中取得了显著的成功率提升。通过与基线方法进行比较,验证了IACE模块的有效性。具体的性能数据在论文中有详细展示,表明该模型能够有效地学习双臂协同操作策略。

🎯 应用场景

该研究成果可应用于各种需要双臂协同操作的机器人任务,例如装配、搬运、清洁等。在制造业、医疗、服务业等领域具有广泛的应用前景。未来,该技术有望进一步发展,实现更复杂、更精细的双臂操作,提升机器人的智能化水平。

📄 摘要(原文)

Robots that can operate autonomously in a human living environment are necessary to have the ability to handle various tasks flexibly. One crucial element is coordinated bimanual movements that enable functions that are difficult to perform with one hand alone. In recent years, learning-based models that focus on the possibilities of bimanual movements have been proposed. However, the high degree of freedom of the robot makes it challenging to reason about control, and the left and right robot arms need to adjust their actions depending on the situation, making it difficult to realize more dexterous tasks. To address the issue, we focus on coordination and efficiency between both arms, particularly for synchronized actions. Therefore, we propose a novel imitation learning architecture that predicts cooperative actions. We differentiate the architecture for both arms and add an intermediate encoder layer, Inter-Arm Coordinated transformer Encoder (IACE), that facilitates synchronization and temporal alignment to ensure smooth and coordinated actions. To verify the effectiveness of our architectures, we perform distinctive bimanual tasks. The experimental results showed that our model demonstrated a high success rate for comparison and suggested a suitable architecture for the policy learning of bimanual manipulation.