Multimodal Sensing and Machine Learning to Compare Printed and Verbal Assembly Instructions Delivered by a Social Robot

作者: Ruchik Mishra, Laksita Prasanna, Adair Adair, Dan O Popa

分类: cs.HC, cs.RO

发布日期: 2025-03-15 (更新: 2025-06-01)

备注: Accepted to IEEE CASE 2025

💡 一句话要点

利用多模态感知与机器学习比较社交机器人提供的印刷版和口头装配指导

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 生理信号 认知负荷 多模态感知 机器学习

📋 核心要点

- 现有方法在评估人机协作装配任务中,缺乏对不同指令传递方式(纸质vs.机器人)对工人认知负荷影响的深入量化分析。

- 论文核心思想是利用多模态生理信号(BVP和EDA)结合机器学习模型,量化分析不同指令传递方式下工人的认知负荷。

- 实验结果表明,基于CNN的多模态生理信号分析方法在区分纸质和机器人指令方面优于LSTM,且能更准确预测工人的任务负荷。

📝 摘要(中文)

本文比较了使用印刷版和机器人提供的指令向工人传达的手动装配任务。通过实验研究中收集的生理信号(血容量脉搏(BVP)和皮肤电活动(EDA))进行比较。此外,我们还收集了参与者使用NASA任务负荷指数(TLX)调查的反馈。更进一步,我们将收集的生理信号映射到参与者对NASA TLX的反馈,以预测他们的工作负荷。对于这两个分类问题,我们比较了卷积神经网络(CNN)和长短期记忆(LSTM)模型的性能。结果表明,对于我们基于CNN的方法,使用多模态数据(BVP和EDA)比仅使用BVP(约高8.38%)和EDA(约高20.49%)效果更好。我们基于LSTM的模型在使用多模态数据时也获得了更好的结果(比仅使用BVP高约8.38%,比仅使用EDA高约6.70%)。总体而言,CNN在基于生理信号对纸质指令与机器人指令进行分类时,比LSTM表现更好,提升了7.72%。与基于LSTM的模型相比,基于CNN的模型能够在训练几分钟内给出更好的分类结果(在NASA TLX的所有响应中平均高出约17.83%)。

🔬 方法详解

问题定义:论文旨在解决如何有效评估在手动装配任务中,由社交机器人提供的口头指令与传统纸质指令对工人认知负荷的影响。现有方法通常依赖主观问卷调查,缺乏客观生理指标的量化分析,难以准确评估不同指令方式的优劣。

核心思路:论文的核心思路是利用多模态生理信号(BVP和EDA)作为客观指标,结合机器学习模型,建立生理信号与认知负荷之间的映射关系。通过分析不同指令方式下工人的生理信号差异,从而量化评估其认知负荷水平。这种方法旨在提供一种更客观、更准确的评估人机协作效果的手段。

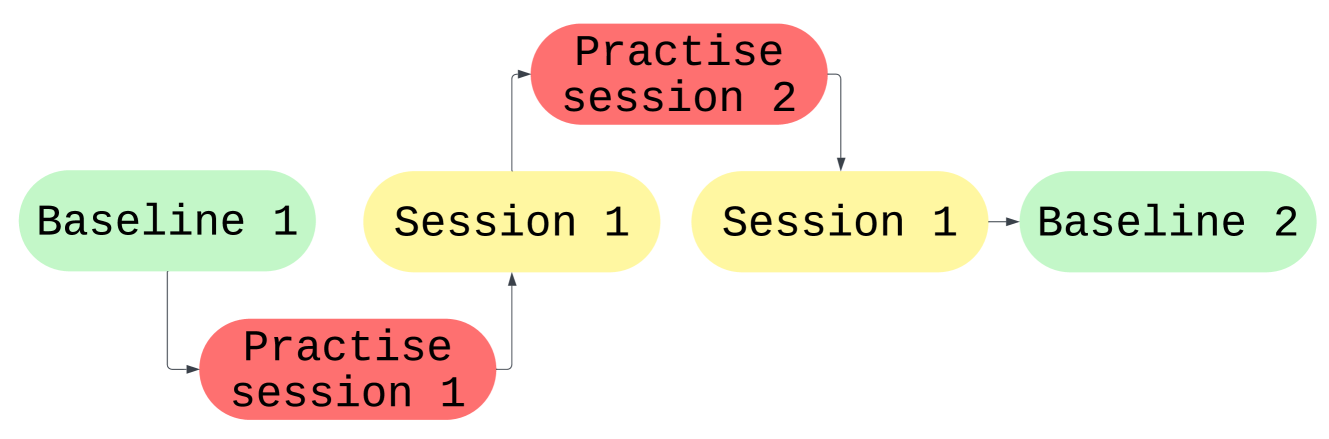

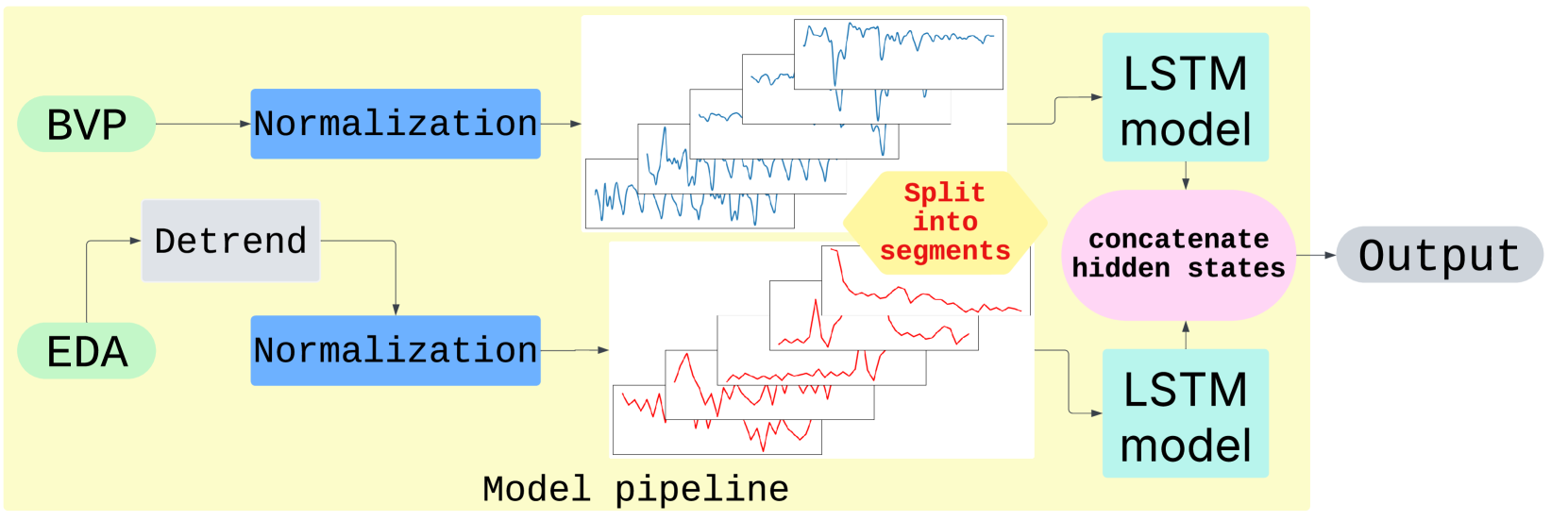

技术框架:整体框架包括数据采集、预处理、特征提取和模型训练四个主要阶段。首先,通过传感器采集工人在执行装配任务时的BVP和EDA信号。然后,对生理信号进行预处理,包括滤波、降噪等。接着,提取生理信号的特征,例如时域和频域特征。最后,使用CNN和LSTM模型,将提取的特征映射到NASA TLX问卷的得分,从而预测工人的认知负荷。

关键创新:论文的关键创新在于将多模态生理信号与机器学习相结合,用于评估不同指令传递方式对工人认知负荷的影响。与传统的主观评估方法相比,该方法更加客观、准确。此外,论文还比较了CNN和LSTM模型在生理信号分类和认知负荷预测方面的性能,为后续研究提供了参考。

关键设计:论文中,CNN模型采用多层卷积和池化操作提取生理信号的特征,LSTM模型则利用循环结构处理时序数据。损失函数采用交叉熵损失函数,优化器采用Adam优化器。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于CNN的多模态数据(BVP和EDA)分析方法在区分纸质和机器人指令方面优于仅使用BVP(提升约8.38%)或EDA(提升约20.49%)。CNN模型在生理信号分类方面优于LSTM模型,提升了7.72%。CNN模型在预测NASA TLX得分方面也表现更好,平均提升约17.83%。

🎯 应用场景

该研究成果可应用于人机协作装配、远程指导、康复训练等领域。通过实时监测工人的生理信号,可以动态调整指令传递方式,优化人机交互体验,提高工作效率和安全性。未来,该技术有望应用于更广泛的人机交互场景,例如智能家居、虚拟现实等。

📄 摘要(原文)

In this paper, we compare a manual assembly task communicated to workers using both printed and robot-delivered instructions. The comparison was made using physiological signals (blood volume pulse (BVP) and electrodermal activity (EDA)) collected from individuals during an experimental study. In addition, we also collected responses of individuals using the NASA Task Load Index (TLX) survey. Furthermore, we mapped the collected physiological signals to the responses of participants for NASA TLX to predict their workload. For both the classification problems, we compare the performance of Convolutional Neural Networks (CNNs) and Long-Short-Term Memory (LSTM) models. Results show that for our CNN-based approach using multimodal data (both BVP and EDA) gave better results than using just BVP (approx. 8.38% more) and EDA (approx 20.49% more). Our LSTM-based model too had better results when we used multimodal data (approx 8.38% more than just BVP and 6.70% more than just EDA). Overall, CNNs performed better than LSTMs for classifying physiologies for paper vs robot-based instruction by 7.72%. The CNN-based model was able to give better classification results (approximately 17.83% more on an average across all responses of the NASA TLX) within a few minutes of training compared to the LSTM-based models.