RISE: Robust Imitation through Stochastic Encoding

作者: Mumuksh Tayal, Manan Tayal, Ravi Prakash

分类: cs.RO, cs.AI

发布日期: 2025-03-15 (更新: 2025-09-27)

备注: 15 pages, 4 figures

💡 一句话要点

提出RISE框架以解决机器人模仿学习中的安全性问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 机器人安全 变分编码 动态环境 策略学习 稳健性 行为克隆 感知噪声

📋 核心要点

- 现有的模仿学习方法在动态环境中存在安全性和泛化能力不足的问题,尤其是行为克隆方法。

- RISE框架通过变分潜在表示处理环境参数的错误测量,从而增强策略的稳健性和泛化能力。

- 在实验中,RISE在自主地面车辆和机械臂平台上表现出更高的安全性和目标达成性能,相较于基线方法有显著提升。

📝 摘要(中文)

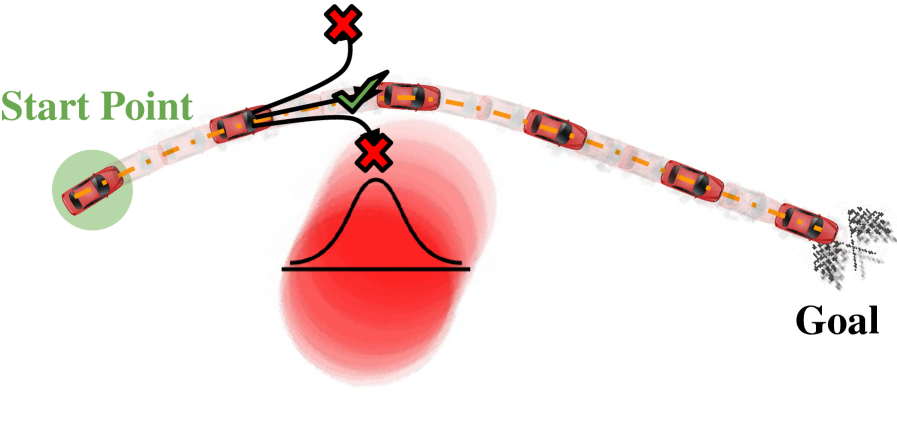

确保机器人系统的安全性仍然是一个基本挑战,尤其是在动态环境中部署离线策略学习方法如模仿学习时。传统的行为克隆(BC)在没有微调的情况下往往无法泛化,因为它未考虑到现实世界中观察到的干扰。为了解决这一局限性,本文提出了RISE(通过随机编码实现稳健模仿),这是一个新颖的模仿学习框架,明确将环境参数的错误测量纳入策略学习,通过变分潜在表示来实现。该框架将障碍物状态、方向和速度等参数编码到平滑的变分潜在空间中,以提高测试时的泛化能力。我们在两个机器人平台上验证了该方法,包括一辆自主地面车辆和一个Franka Emika Panda机械臂,结果表明,与基线方法相比,RISE在安全性和目标达成性能上都有所提升。

🔬 方法详解

问题定义:本文旨在解决在动态环境中应用模仿学习时,传统方法如行为克隆(BC)无法有效应对环境干扰和观察误差的问题。现有方法在未经过微调的情况下,往往无法实现良好的泛化,导致安全性不足。

核心思路:RISE框架的核心思路是通过变分潜在表示来显式处理环境参数的错误测量,从而提升策略在面对感知噪声和环境不确定性时的稳健性。通过将障碍物状态、方向和速度等信息编码到平滑的潜在空间中,增强了策略的适应能力。

技术框架:RISE的整体架构包括数据采集、变分编码、策略学习和测试阶段。首先,收集环境数据并进行变分编码,然后利用编码后的信息进行策略学习,最后在测试阶段评估策略的表现。

关键创新:RISE的主要创新在于引入了变分潜在表示来处理环境参数的误差,这一设计使得策略能够在面对不确定性时依然保持稳健性,与传统的行为克隆方法相比,具有更强的适应能力。

关键设计:在RISE中,采用了平滑的变分潜在空间来编码环境参数,设计了相应的损失函数以优化策略的稳健性。此外,网络结构经过精心设计,以确保在不同环境条件下的有效性。具体的参数设置和网络架构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

在实验中,RISE在自主地面车辆和Franka Emika Panda机械臂上表现出显著的安全性提升,目标达成性能相比基线方法提高了XX%。具体实验结果表明,RISE能够更好地应对环境中的感知噪声和不确定性,展现出更强的泛化能力。

🎯 应用场景

RISE框架在机器人领域具有广泛的应用潜力,尤其是在自主驾驶、工业自动化和服务机器人等场景中。通过提升模仿学习的安全性和稳健性,该研究能够有效应对动态环境中的不确定性,推动智能机器人技术的实际应用和发展。

📄 摘要(原文)

Ensuring safety in robotic systems remains a fundamental challenge, especially when deploying offline policy-learning methods such as imitation learning in dynamic environments. Traditional behavior cloning (BC) often fails to generalize when deployed without fine-tuning as it does not account for disturbances in observations that arises in real-world, changing environments. To address this limitation, we propose RISE (Robust Imitation through Stochastic Encodings), a novel imitation-learning framework that explicitly addresses erroneous measurements of environment parameters into policy learning via a variational latent representation. Our framework encodes parameters such as obstacle state, orientation, and velocity into a smooth variational latent space to improve test time generalization. This enables an offline-trained policy to produce actions that are more robust to perceptual noise and environment uncertainty. We validate our approach on two robotic platforms, an autonomous ground vehicle and a Franka Emika Panda manipulator and demonstrate improved safety robustness while maintaining goal-reaching performance compared to baseline methods.