GS-SDF: LiDAR-Augmented Gaussian Splatting and Neural SDF for Geometrically Consistent Rendering and Reconstruction

作者: Jianheng Liu, Yunfei Wan, Bowen Wang, Chunran Zheng, Jiarong Lin, Fu Zhang

分类: cs.RO, cs.CV

发布日期: 2025-03-13 (更新: 2025-07-29)

备注: 8 pages, IROS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

GS-SDF:利用激光雷达增强的高斯溅射和神经SDF,实现几何一致的渲染与重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 神经SDF 激光雷达 三维重建 几何一致性 自动驾驶 机器人

📋 核心要点

- 现有高斯溅射方法在机器人应用中,由于数据稀疏和图元离散,难以保证几何一致性,尤其是在复杂环境中。

- 该论文提出了一种统一的激光雷达-视觉系统,结合高斯溅射和神经符号距离场(SDF),利用激光雷达数据引导几何重建。

- 实验结果表明,该方法在重建精度和渲染质量上优于现有方法,尤其是在几何一致性方面有显著提升。

📝 摘要(中文)

数字孪生是自动驾驶和具身人工智能发展的基石。然而,实现高精细度的表面重建和高保真度的渲染仍然是一个挑战。高斯溅射提供了高效的逼真渲染,但由于机器人应用中碎片化的图元和稀疏的观测数据,它在几何一致性方面存在困难。现有的依赖于渲染约束的正则化方法在复杂环境中通常会失效。此外,有效地将稀疏激光雷达数据与高斯溅射集成仍然具有挑战性。我们提出了一个统一的激光雷达-视觉系统,该系统将高斯溅射与神经符号距离场协同作用。精确的激光雷达点云使训练后的神经符号距离场能够提供流形几何场。这促使我们提供基于SDF的高斯初始化,用于物理上合理的图元放置,以及全面的几何正则化,以实现几何一致的渲染和重建。实验表明,在不同的轨迹上,重建精度和渲染质量都得到了提高。为了使社区受益,代码已在https://github.com/hku-mars/GS-SDF上发布。

🔬 方法详解

问题定义:现有基于高斯溅射的三维重建方法在机器人应用场景中,面临几何一致性问题。由于观测数据稀疏以及高斯图元的离散性,重建结果容易出现漂浮、空洞等几何错误。现有的正则化方法,如基于渲染的约束,在复杂场景下效果不佳。此外,如何有效融合稀疏的激光雷达数据以提升重建质量也是一个挑战。

核心思路:该论文的核心思路是利用激光雷达数据训练一个神经符号距离场(SDF),从而提供一个准确的流形几何先验。然后,利用这个SDF来指导高斯图元的初始化和优化,从而实现几何一致的渲染和重建。通过SDF提供的几何信息,可以有效地约束高斯图元的分布,避免出现几何错误。

技术框架:该方法主要包含以下几个阶段:1) 利用激光雷达点云训练一个神经SDF,该SDF能够准确地表示场景的几何形状。2) 基于SDF进行高斯图元的初始化,将高斯图元放置在SDF表面附近,并根据SDF的梯度信息设置高斯图元的朝向。3) 利用渲染损失和几何正则化损失对高斯图元进行优化,其中几何正则化损失基于SDF,用于约束高斯图元的形状和位置,保证几何一致性。

关键创新:该论文的关键创新在于将激光雷达数据、神经SDF和高斯溅射有效地结合起来,利用SDF提供的几何先验来指导高斯图元的初始化和优化。与现有方法相比,该方法能够更好地利用激光雷达数据,并有效地解决高斯溅射的几何一致性问题。此外,基于SDF的几何正则化损失也是一个重要的创新点,它能够有效地约束高斯图元的形状和位置。

关键设计:在SDF训练方面,使用了标准的MLP网络结构,并采用Eikonal损失进行正则化。在高斯图元初始化方面,将高斯图元放置在SDF零水平集附近,并根据SDF的梯度方向设置高斯图元的朝向。在几何正则化方面,设计了基于SDF的距离损失和法向一致性损失,用于约束高斯图元的形状和位置。损失函数的权重需要根据具体场景进行调整。

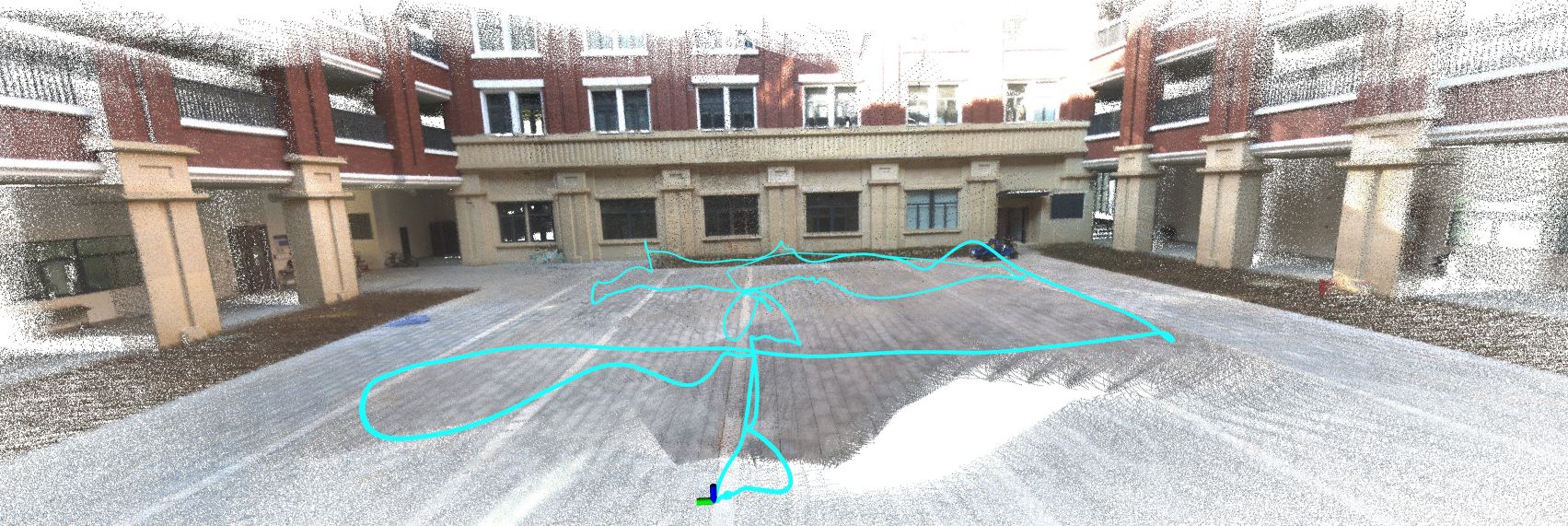

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在重建精度和渲染质量上均优于现有方法。与仅使用视觉信息的高斯溅射方法相比,该方法能够显著提高重建的几何一致性,减少漂浮和空洞等几何错误。在多个数据集上进行了评估,结果表明该方法能够有效地利用激光雷达数据,并实现高精度的三维重建。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、虚拟现实、增强现实等领域。通过高精度、几何一致的三维重建,可以为自动驾驶系统提供更可靠的环境感知,提升机器人导航的安全性,并为虚拟现实和增强现实应用提供更逼真的场景体验。该方法在数字孪生构建方面具有重要价值。

📄 摘要(原文)

Digital twins are fundamental to the development of autonomous driving and embodied artificial intelligence. However, achieving high-granularity surface reconstruction and high-fidelity rendering remains a challenge. Gaussian splatting offers efficient photorealistic rendering but struggles with geometric inconsistencies due to fragmented primitives and sparse observational data in robotics applications. Existing regularization methods, which rely on render-derived constraints, often fail in complex environments. Moreover, effectively integrating sparse LiDAR data with Gaussian splatting remains challenging. We propose a unified LiDAR-visual system that synergizes Gaussian splatting with a neural signed distance field. The accurate LiDAR point clouds enable a trained neural signed distance field to offer a manifold geometry field. This motivates us to offer an SDF-based Gaussian initialization for physically grounded primitive placement and a comprehensive geometric regularization for geometrically consistent rendering and reconstruction. Experiments demonstrate superior reconstruction accuracy and rendering quality across diverse trajectories. To benefit the community, the codes are released at https://github.com/hku-mars/GS-SDF.