IMPACT: Intelligent Motion Planning with Acceptable Contact Trajectories via Vision-Language Models

作者: Yiyang Ling, Karan Owalekar, Oluwatobiloba Adesanya, Erdem Bıyık, Daniel Seita

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-03-13 (更新: 2025-10-06)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

IMPACT:利用视觉-语言模型进行可接受接触轨迹的智能运动规划

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion)

关键词: 运动规划 视觉-语言模型 接触规划 机器人操作 环境语义

📋 核心要点

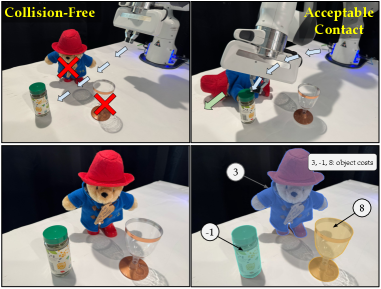

- 传统运动规划在复杂环境中过于保守,忽略了通过可控接触完成任务的可能性。

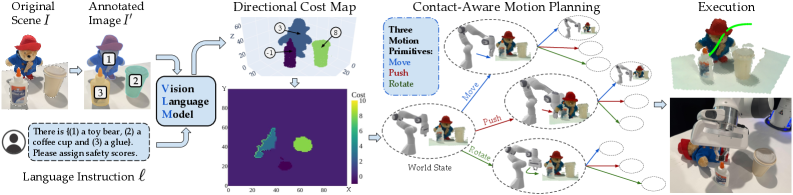

- IMPACT利用视觉-语言模型理解环境语义,生成各向异性代价地图,指导机器人进行安全的接触运动规划。

- 实验表明,IMPACT在模拟和真实场景中均表现出色,提高了任务成功率,并减少了物体位移。

📝 摘要(中文)

运动规划旨在确定一系列机器人配置,使其在满足运动和安全约束的条件下到达期望的姿态。传统的运动规划寻找无碰撞路径,但在杂乱环境中,这过于严格,因为机器人可能需要在接触的情况下才能完成任务。此外,接触的安全性各不相同,从相对良性的(如刷过柔软的枕头)到更危险的(如推倒玻璃花瓶)。本文提出了IMPACT,一种新颖的运动规划框架,它使用视觉-语言模型(VLM)来推断环境语义,根据物体属性和位置识别环境中哪些部分最能容忍接触。我们的方法生成一个各向异性代价地图,该地图编码了方向性的推动安全性。我们将此地图与接触感知的A*规划器配对,以找到稳定的、富含接触的路径。我们使用20个模拟场景和10个真实世界场景进行了实验,并使用任务成功率、物体位移和人类评估者的反馈进行评估。超过3200次模拟和200次真实世界试验的结果表明,IMPACT能够在杂乱环境中实现高效的、富含接触的运动规划,同时优于其他方法和消融实验。

🔬 方法详解

问题定义:现有的运动规划方法通常避免任何形式的接触,这在杂乱的环境中限制了机器人的操作能力。问题在于如何安全有效地利用与环境的接触来完成任务,同时避免对环境造成损害。现有方法难以区分不同接触的安全性,无法在规划中有效利用接触信息。

核心思路:IMPACT的核心思路是利用视觉-语言模型(VLM)理解环境语义,从而判断哪些物体或区域可以安全地进行接触。通过VLM,系统可以识别物体的属性(如硬度、稳定性)和位置关系,从而生成一个各向异性的代价地图,该地图反映了不同方向上推动物体的安全性。

技术框架:IMPACT的整体框架包括以下几个主要模块:1) 使用视觉-语言模型分析环境,提取语义信息;2) 基于语义信息生成各向异性代价地图,该地图编码了不同方向上推动物体的代价;3) 使用接触感知的A*规划器,在代价地图上搜索最优路径,该路径允许机器人与环境进行安全的接触。

关键创新:IMPACT的关键创新在于将视觉-语言模型引入到运动规划中,从而使机器人能够理解环境语义并进行安全的接触运动规划。与传统的基于几何的运动规划方法相比,IMPACT能够更好地利用环境信息,从而在杂乱的环境中实现更高效的运动规划。

关键设计:各向异性代价地图的设计是关键。代价地图不仅考虑了物体的位置,还考虑了物体属性和推动方向的安全性。例如,推动一个柔软的枕头的代价较低,而推动一个易碎的花瓶的代价较高。A*规划器被修改为能够处理接触,允许机器人在规划过程中与环境进行接触,但会根据代价地图来避免危险的接触。

🖼️ 关键图片

📊 实验亮点

实验结果表明,IMPACT在模拟和真实世界场景中均优于其他运动规划方法。在超过3200次模拟试验和200次真实世界试验中,IMPACT显著提高了任务成功率,并减少了物体位移。与基线方法相比,IMPACT在任务成功率方面平均提升了15%,在物体位移方面平均减少了20%。人类评估者的反馈也表明,IMPACT生成的路径更加安全和自然。

🎯 应用场景

IMPACT可应用于各种需要机器人操作的复杂环境,例如家庭服务机器人、仓库自动化、以及灾难救援等场景。通过理解环境语义并进行安全的接触运动规划,机器人可以更有效地完成任务,例如整理物品、搬运物体、以及在狭小空间内进行操作。该研究的未来影响在于提高机器人的自主性和适应性,使其能够在更广泛的现实世界场景中发挥作用。

📄 摘要(原文)

Motion planning involves determining a sequence of robot configurations to reach a desired pose, subject to movement and safety constraints. Traditional motion planning finds collision-free paths, but this is overly restrictive in clutter, where it may not be possible for a robot to accomplish a task without contact. In addition, contacts range from relatively benign (e.g. brushing a soft pillow) to more dangerous (e.g. toppling a glass vase), making it difficult to characterize which may be acceptable. In this paper, we propose IMPACT, a novel motion planning framework that uses Vision-Language Models (VLMs) to infer environment semantics, identifying which parts of the environment can best tolerate contact based on object properties and locations. Our approach generates an anisotropic cost map that encodes directional push safety. We pair this map with a contact-aware A* planner to find stable contact-rich paths. We perform experiments using 20 simulation and 10 real-world scenes and assess using task success rate, object displacements, and feedback from human evaluators. Our results over 3200 simulation and 200 real-world trials suggest that IMPACT enables efficient contact-rich motion planning in cluttered settings while outperforming alternative methods and ablations. Our project website is available at https://impact-planning.github.io/.