Adaptive Anomaly Recovery for Telemanipulation: A Diffusion Model Approach to Vision-Based Tracking

作者: Haoyang Wang, Haoran Guo, Lingfeng Tao, Zhengxiong Li

分类: cs.RO, cs.CV

发布日期: 2025-03-11 (更新: 2026-01-07)

备注: This work has been submitted to the IEEE for possible publication

💡 一句话要点

提出DET框架,利用扩散模型进行遥操作中的视觉异常恢复,提升系统鲁棒性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 遥操作 视觉跟踪 异常恢复 扩散模型 帧差检测 视频重建 机器人控制

📋 核心要点

- 基于视觉的遥操作跟踪易受遮挡、光照等异常影响,传统方法难以有效处理高维视觉数据的信息损失问题。

- DET框架利用扩散模型重建异常视频片段,结合帧差检测技术识别异常,从而提升遥操作在复杂视觉环境下的鲁棒性。

- 实验结果表明,DET在不同遮挡情况下,相比传统插值方法,RMSE显著降低,验证了其在异常恢复方面的有效性。

📝 摘要(中文)

灵巧遥操作依赖于对操作者命令的连续稳定跟踪,以确保操作的鲁棒性。基于视觉的跟踪方法应用广泛,但由于遮挡、光照不足和视线丢失等异常情况,其稳定性较低。传统的滤波、回归和插值方法通常用于补偿角度和位置等显式信息。这些方法仅限于低维数据,并且与原始高维图像和视频数据相比,通常会导致信息丢失。扩散模型在视频重建和生成方面取得了显著成功,但尚未在机器人连续控制任务中得到充分探索。本文提出了扩散增强遥操作(DET)框架,该框架结合了帧差检测(FDD)技术来识别和分割视频流中的异常。这些异常片段在使用扩散模型重建后被替换,从而确保在具有挑战性的视觉条件下实现鲁棒的遥操作性能。在各种异常场景中验证了该方法,并将其与基线方法进行了比较。实验表明,对于不同的遮挡持续时间,DET与三次样条插值相比,平均RMSE降低了17.2%,与基于FFT的插值相比,平均RMSE降低了51.1%。

🔬 方法详解

问题定义:论文旨在解决遥操作中,由于视觉跟踪受到异常情况(如遮挡、光照变化等)干扰,导致系统性能下降的问题。现有方法,如滤波、回归和插值,主要处理低维数据,无法有效利用高维图像信息进行异常恢复,导致信息损失。

核心思路:论文的核心思路是利用扩散模型强大的视频重建能力,对检测到的异常视频片段进行修复,从而保持遥操作系统的稳定性和鲁棒性。通过将扩散模型应用于高维视觉数据,可以更有效地恢复因异常而丢失的信息。

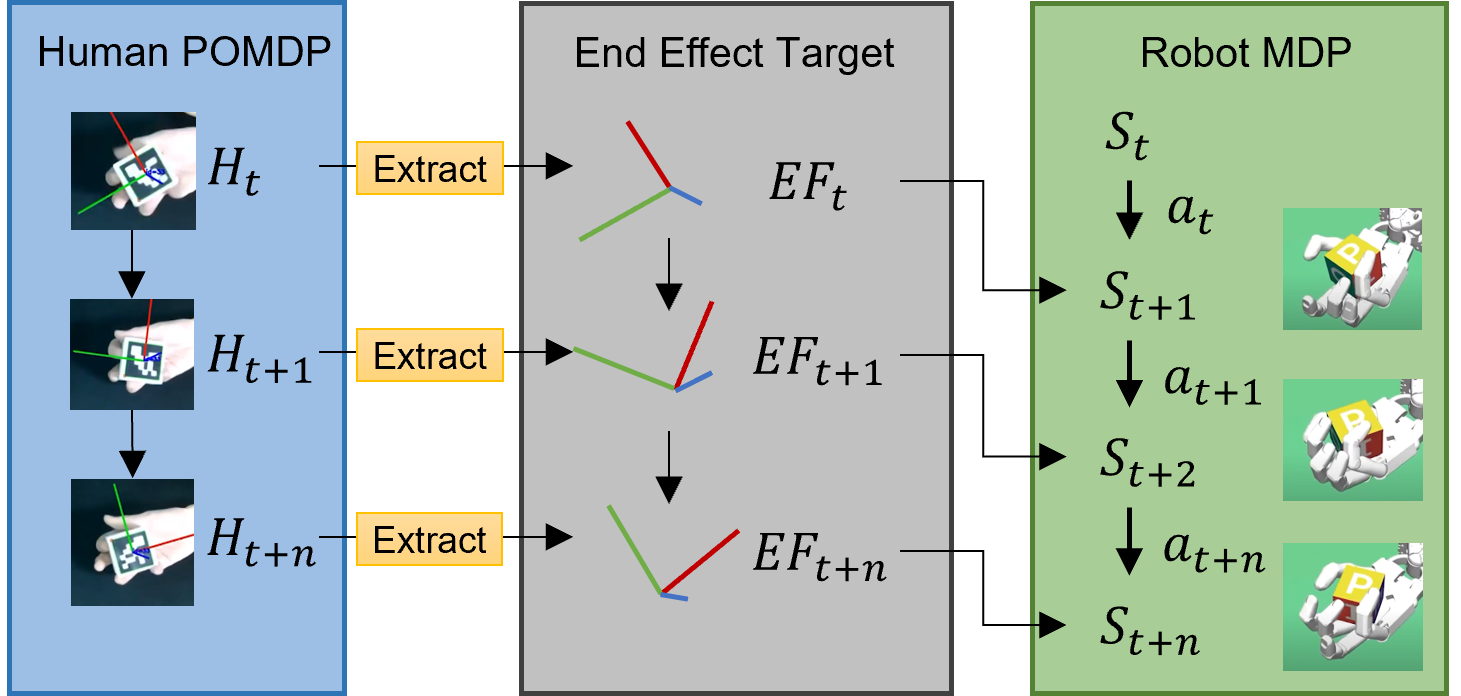

技术框架:DET框架主要包含两个核心模块:帧差检测(FDD)模块和扩散模型重建模块。首先,FDD模块用于检测视频流中的异常帧,并将其分割出来。然后,扩散模型对这些异常片段进行重建,生成修复后的视频片段。最后,将重建后的片段替换原始视频中的异常片段,从而得到完整的、无异常干扰的视频流,用于遥操作控制。

关键创新:该论文的关键创新在于将扩散模型应用于遥操作的视觉异常恢复任务。与传统方法相比,扩散模型能够处理高维视觉数据,并生成高质量的重建结果。此外,结合FDD模块,可以有效地定位和分割异常片段,从而提高重建效率和准确性。

关键设计:论文中可能涉及的关键设计包括:扩散模型的具体结构(例如,U-Net结构)、训练数据集的选择和预处理、FDD模块的阈值设定、以及如何将重建后的视频片段无缝地集成到遥操作控制系统中。具体的损失函数和参数设置在论文中应该有详细描述,但根据摘要无法得知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DET框架在各种异常场景下均表现出优异的性能。与传统的三次样条插值方法相比,DET的平均RMSE降低了17.2%;与基于FFT的插值方法相比,平均RMSE降低了51.1%。这些数据表明,DET框架能够有效地恢复因视觉异常而丢失的信息,显著提升遥操作系统的性能。

🎯 应用场景

该研究成果可应用于各种需要远程操作的场景,例如:深海探测、太空探索、危险环境下的作业(如核电站维护、灾难救援)以及医疗手术等。通过提高遥操作系统的鲁棒性和稳定性,可以降低操作风险,提高工作效率,并扩展遥操作技术的应用范围。未来,该技术有望与增强现实等技术结合,进一步提升操作体验和安全性。

📄 摘要(原文)

Dexterous telemanipulation critically relies on the continuous and stable tracking of the human operator's commands to ensure robust operation. Vison-based tracking methods are widely used but have low stability due to anomalies such as occlusions, inadequate lighting, and loss of sight. Traditional filtering, regression, and interpolation methods are commonly used to compensate for explicit information such as angles and positions. These approaches are restricted to low-dimensional data and often result in information loss compared to the original high-dimensional image and video data. Recent advances in diffusion-based approaches, which can operate on high-dimensional data, have achieved remarkable success in video reconstruction and generation. However, these methods have not been fully explored in continuous control tasks in robotics. This work introduces the Diffusion-Enhanced Telemanipulation (DET) framework, which incorporates the Frame-Difference Detection (FDD) technique to identify and segment anomalies in video streams. These anomalous clips are replaced after reconstruction using diffusion models, ensuring robust telemanipulation performance under challenging visual conditions. We validated this approach in various anomaly scenarios and compared it with the baseline methods. Experiments show that DET achieves an average RMSE reduction of 17.2% compared to the cubic spline and 51.1% compared to FFT-based interpolation for different occlusion durations.