Instruction-Augmented Long-Horizon Planning: Embedding Grounding Mechanisms in Embodied Mobile Manipulation

作者: Fangyuan Wang, Shipeng Lyu, Peng Zhou, Anqing Duan, Guodong Guo, David Navarro-Alarcon

分类: cs.RO, cs.AI

发布日期: 2025-03-11

备注: 17 pages, 11 figures

期刊: AAAI 2025

💡 一句话要点

提出指令增强的长程规划系统,解决具身移动操作中LLM规划器的环境理解不足问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长程规划 移动操作 大型语言模型 具身智能 机器人 PDDL 指令增强 环境感知

📋 核心要点

- 现有基于LLM的规划器依赖人工提供的文本表示或提示工程,缺乏对环境的定量理解,例如操作可行性。

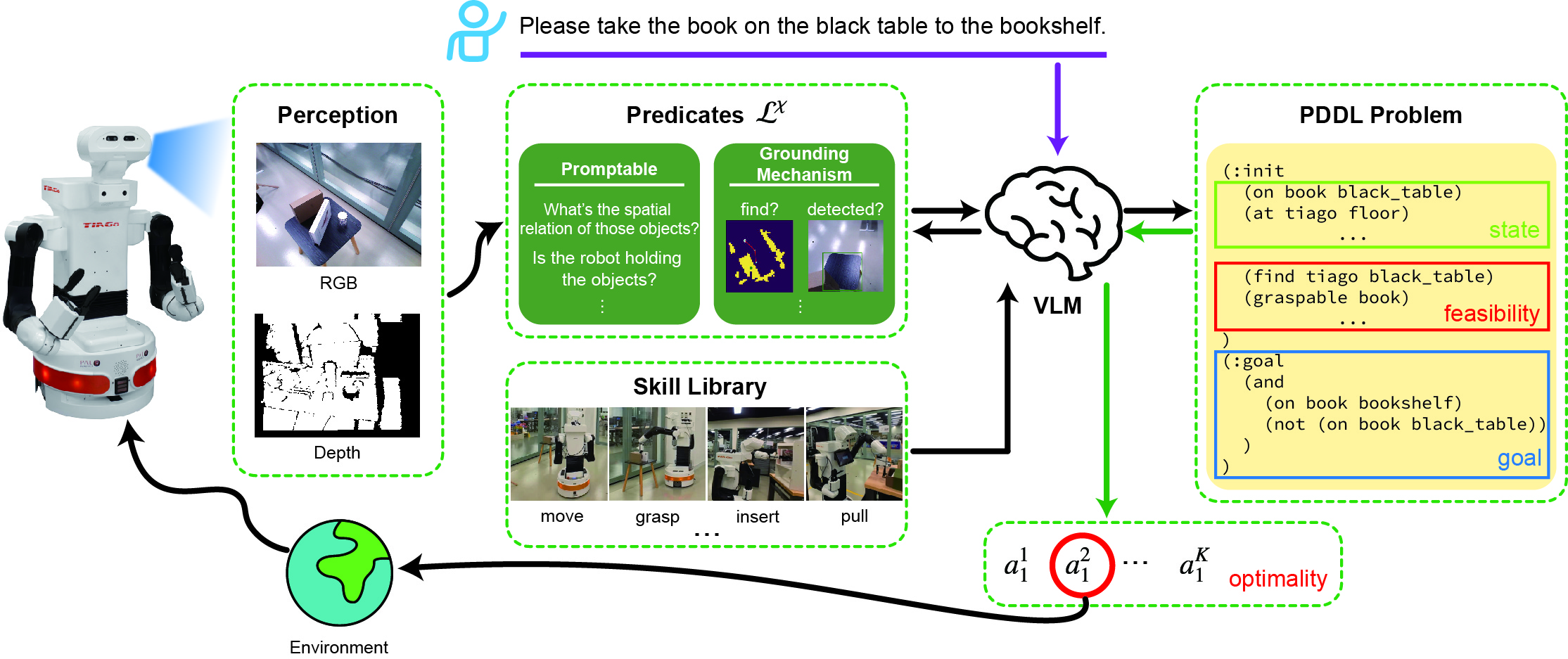

- IALP系统通过grounding机制增强用户指令到PDDL问题中,结合LLM的抽象推理能力和实时传感器反馈,生成可行动作。

- 实验表明,IALP在包含七种操作技能的长程任务中成功率超过80%,提升了机器人在非结构化环境中的自主性。

📝 摘要(中文)

本文提出了一种指令增强的长程规划(IALP)系统,旨在解决人形机器人在真实环境中进行基于具身感知和理解能力的长程移动操作规划这一长期挑战。该系统利用大型语言模型(LLM)生成可行且最优的动作,并基于实时传感器反馈,包括对环境的grounded知识,进行闭环交互。与以往工作不同,IALP通过利用LLM的抽象推理能力和grounding机制,将用户指令增强到PDDL问题中。在包含七种不同操作技能的各种真实长程任务中,实验结果表明IALP系统能够高效地解决这些任务,平均成功率超过80%。该方法可作为高级规划器,通过利用多模态传感器输入,使机器人在非结构化环境中具有高度自主性。

🔬 方法详解

问题定义:论文旨在解决人形机器人在真实环境中进行长程移动操作规划的问题。现有基于LLM的规划器主要依赖于人工提供的文本描述或者复杂的prompt工程,缺乏对环境的定量理解能力,例如判断物体是否可以被操作,以及如何操作。这限制了机器人在复杂、非结构化环境中自主完成任务的能力。

核心思路:论文的核心思路是将用户指令与环境的grounded知识相结合,增强传统的PDDL(Planning Domain Definition Language)问题描述。通过这种方式,LLM可以利用其抽象推理能力,结合从传感器获取的实时环境信息,生成更可行、更优化的动作序列。这种方法旨在弥合LLM的抽象规划能力与机器人对物理环境的感知和操作能力之间的差距。

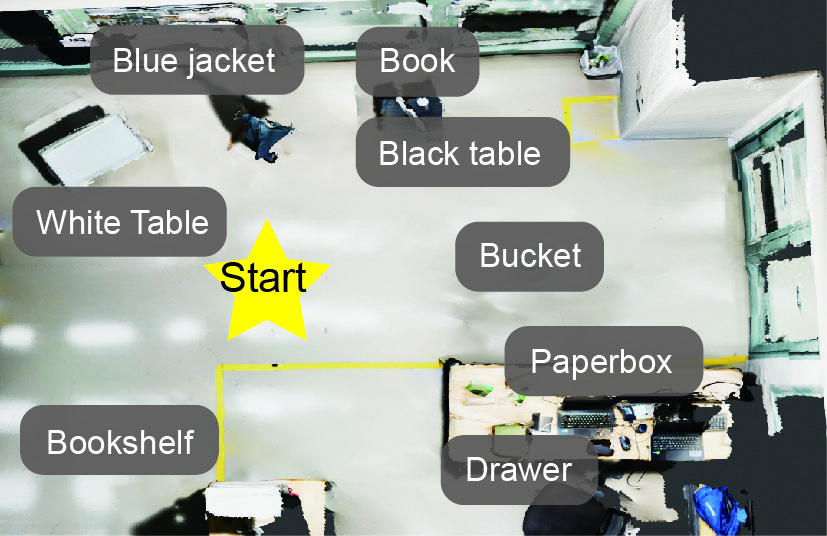

技术框架:IALP系统的整体框架包含以下几个主要模块:1) 感知模块:利用多模态传感器(例如摄像头、深度传感器)获取环境信息,并提取相关的物体属性和空间关系。2) 指令解析模块:解析用户提供的自然语言指令,提取任务目标和约束。3) PDDL问题生成模块:将解析后的指令和感知到的环境信息转化为PDDL问题描述,其中包含了增强的grounded知识。4) LLM规划模块:利用LLM对PDDL问题进行推理,生成动作序列。5) 动作执行模块:将LLM生成的动作序列转化为机器人可执行的控制指令,并控制机器人执行动作。6) 闭环反馈模块:在动作执行过程中,实时监测环境变化,并将反馈信息传递给LLM规划模块,进行动态调整。

关键创新:IALP系统的关键创新在于将用户指令和环境的grounded知识融入到PDDL问题中。这种方法使得LLM能够更好地理解任务目标和环境约束,从而生成更可行、更优化的动作序列。与传统的基于LLM的规划器相比,IALP系统不需要人工提供详细的环境描述,而是通过传感器实时获取环境信息,并将其转化为LLM可以理解的形式。

关键设计:论文中没有详细描述关键的参数设置、损失函数、网络结构等技术细节。但是,可以推断,感知模块可能使用了深度学习模型进行物体识别和姿态估计。LLM规划模块可能使用了prompt工程来引导LLM生成符合要求的动作序列。PDDL问题生成模块需要设计合适的规则,将感知到的环境信息转化为PDDL谓词和动作描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,IALP系统在包含七种不同操作技能的真实长程任务中,平均成功率超过80%。这表明IALP系统能够有效地解决复杂环境下的长程移动操作规划问题。与未采用grounding机制的基线方法相比,IALP系统在成功率和规划效率方面均有显著提升。具体的性能数据和对比基线在论文中未详细给出,属于未知信息。

🎯 应用场景

IALP系统可应用于各种需要机器人进行长程移动操作的场景,例如家庭服务、仓储物流、医疗辅助等。该系统能够使机器人在非结构化环境中自主完成复杂的任务,例如整理房间、搬运物品、协助病人等。未来,通过进一步提升感知能力和规划效率,IALP系统有望在更多领域得到应用,并为人类提供更智能、更便捷的服务。

📄 摘要(原文)

Enabling humanoid robots to perform long-horizon mobile manipulation planning in real-world environments based on embodied perception and comprehension abilities has been a longstanding challenge. With the recent rise of large language models (LLMs), there has been a notable increase in the development of LLM-based planners. These approaches either utilize human-provided textual representations of the real world or heavily depend on prompt engineering to extract such representations, lacking the capability to quantitatively understand the environment, such as determining the feasibility of manipulating objects. To address these limitations, we present the Instruction-Augmented Long-Horizon Planning (IALP) system, a novel framework that employs LLMs to generate feasible and optimal actions based on real-time sensor feedback, including grounded knowledge of the environment, in a closed-loop interaction. Distinct from prior works, our approach augments user instructions into PDDL problems by leveraging both the abstract reasoning capabilities of LLMs and grounding mechanisms. By conducting various real-world long-horizon tasks, each consisting of seven distinct manipulatory skills, our results demonstrate that the IALP system can efficiently solve these tasks with an average success rate exceeding 80%. Our proposed method can operate as a high-level planner, equipping robots with substantial autonomy in unstructured environments through the utilization of multi-modal sensor inputs.