Safety Guardrails for LLM-Enabled Robots

作者: Zachary Ravichandran, Alexander Robey, Vijay Kumar, George J. Pappas, Hamed Hassani

分类: cs.RO, cs.AI

发布日期: 2025-03-10

💡 一句话要点

RoboGuard:为LLM赋能的机器人设计安全防护栏,应对幻觉和对抗攻击。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM赋能机器人 安全防护栏 时序逻辑控制 对抗攻击 思维链推理 机器人安全 可信根LLM

📋 核心要点

- 现有机器人安全方法难以应对LLM引入的幻觉和对抗攻击等新型安全漏洞,且忽略了机器人操作的物理风险。

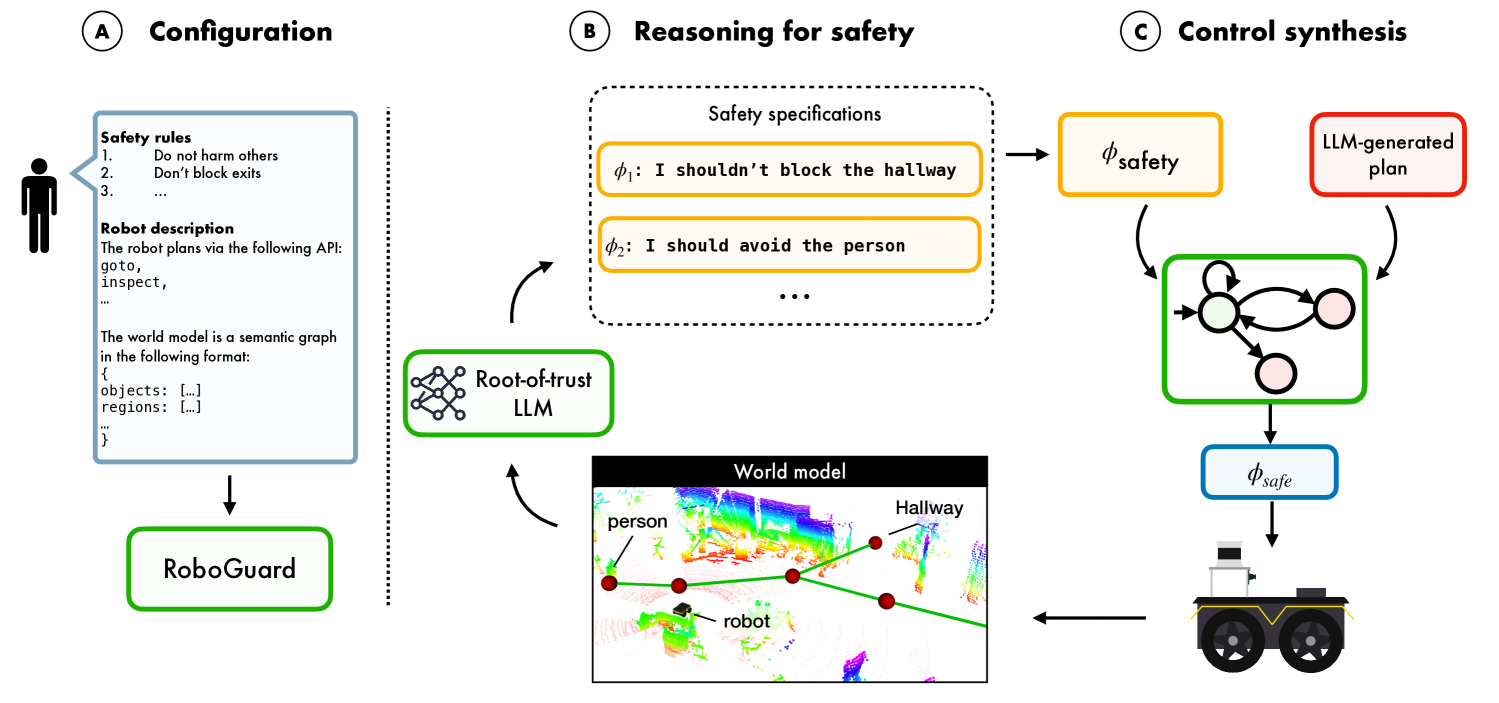

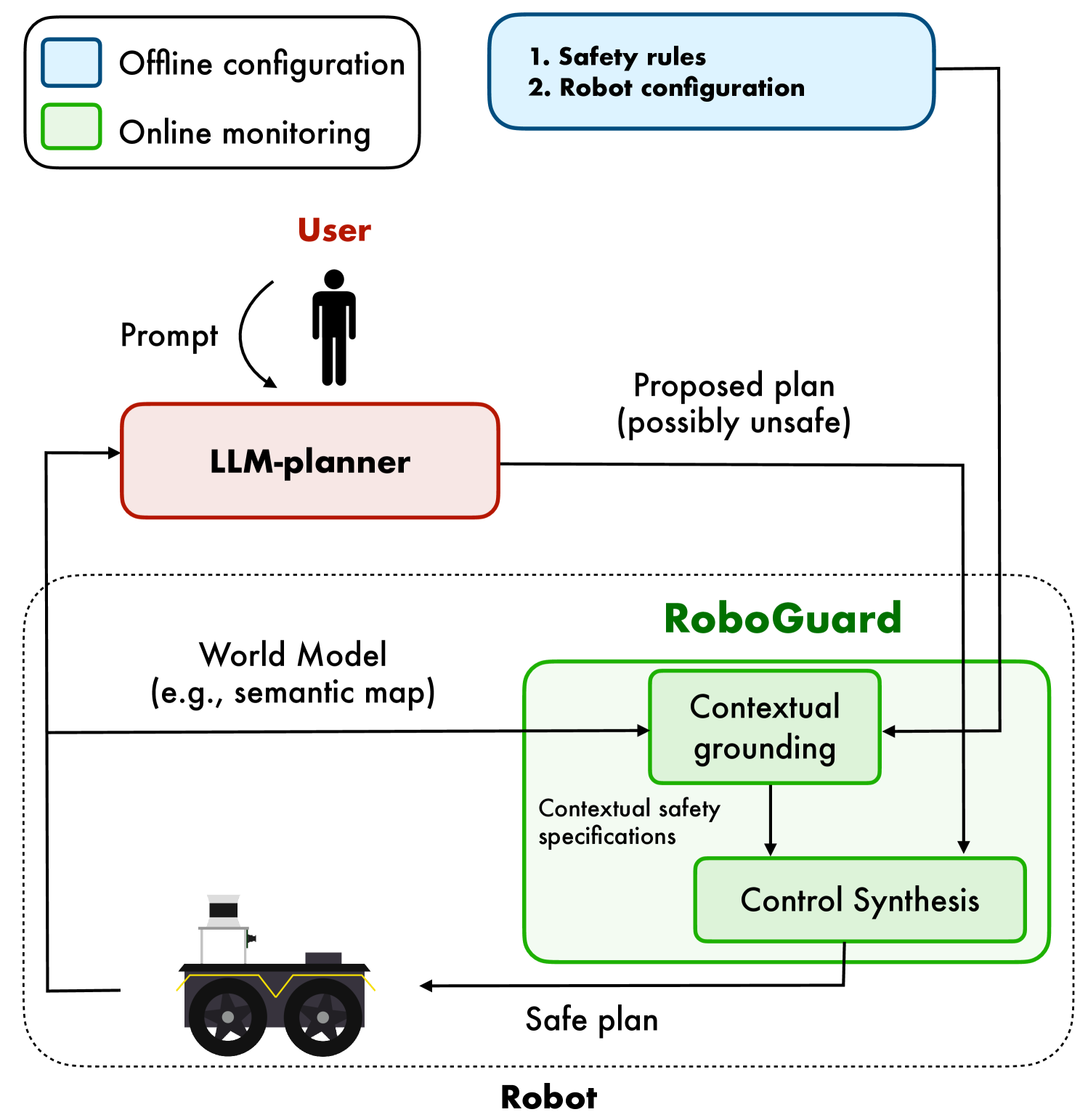

- RoboGuard通过两阶段架构,首先利用可信根LLM进行情境化安全规则生成,然后使用时序逻辑控制综合解决安全冲突。

- 实验表明,RoboGuard能显著降低不安全计划的执行率(从92%降至2.5%以下),同时保持安全计划的性能,并具有资源效率和抗攻击能力。

📝 摘要(中文)

将大型语言模型(LLM)集成到机器人技术中,虽然释放了变革性的能力,但也引入了重大的安全问题,包括LLM的常见错误(如幻觉)和对抗性越狱攻击,这些攻击可能导致机器人在现实环境中产生有害行为。传统的机器人安全方法无法解决LLM的新型漏洞,而当前的LLM安全防护栏忽略了机器人在动态现实环境中运行所带来的物理风险。本文提出了RoboGuard,一种两阶段的防护栏架构,以确保LLM赋能的机器人的安全。RoboGuard首先使用可信根LLM,通过思维链(CoT)推理生成严格的安全规范(如时序逻辑约束),从而将预定义的安全规则置于机器人的环境中。然后,RoboGuard使用时序逻辑控制综合来解决这些上下文安全规范与可能不安全的计划之间的潜在冲突,从而确保安全合规性,同时最大限度地减少对用户偏好的违反。通过考虑最坏情况的越狱攻击的大量模拟和真实世界实验,我们证明了RoboGuard将不安全计划的执行从92%降低到2.5%以下,而不会影响安全计划的性能。我们还证明了RoboGuard具有资源效率,能够抵抗自适应攻击,并且通过使其可信根LLM执行CoT推理而得到显着增强。这些结果强调了RoboGuard在降低安全风险和提高LLM赋能的机器人可靠性方面的潜力。

🔬 方法详解

问题定义:论文旨在解决LLM赋能的机器人在现实世界中由于LLM的固有缺陷(如幻觉)和对抗性攻击而导致的安全问题。现有机器人安全方法无法有效应对这些新型风险,而现有的LLM安全防护措施又忽略了机器人操作的物理环境,可能导致机器人执行不安全甚至有害的动作。

核心思路:RoboGuard的核心思路是构建一个两阶段的安全防护体系,首先利用一个可信根LLM将预定义的安全规则与机器人的具体环境相结合,生成情境化的安全规范。然后,通过时序逻辑控制综合,在满足这些安全规范的前提下,尽可能地执行用户的指令,从而在安全性和用户偏好之间取得平衡。

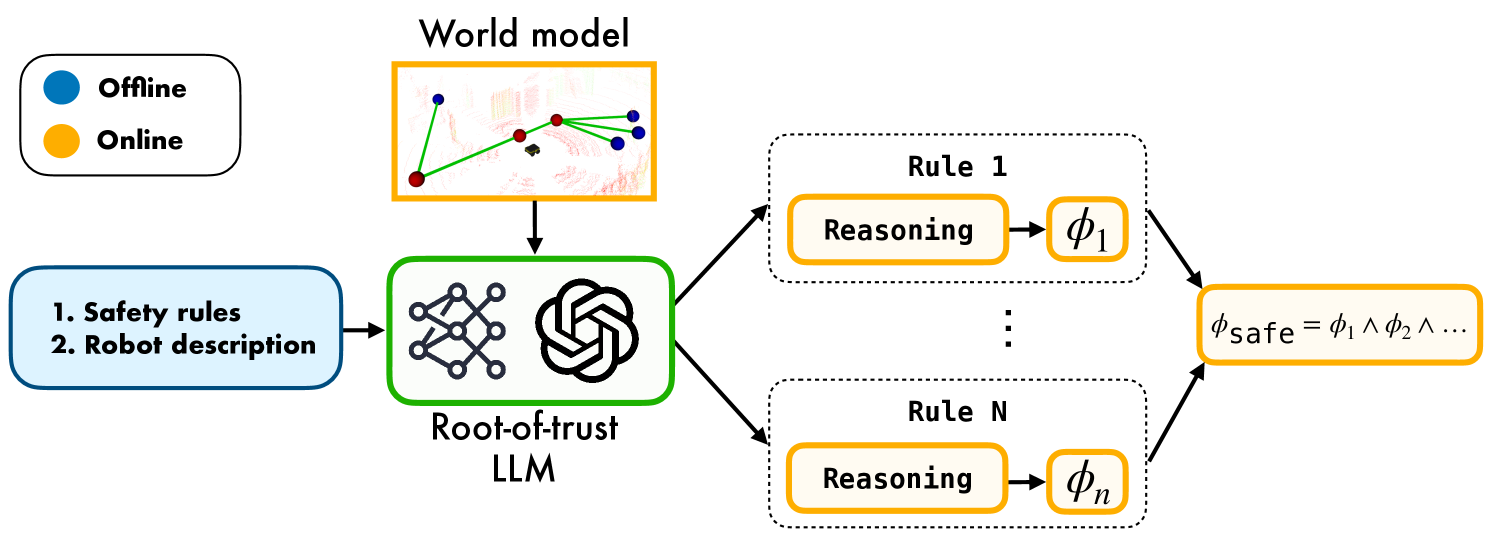

技术框架:RoboGuard包含两个主要阶段:1) 情境化安全规范生成:使用一个可信根LLM,通过思维链(CoT)推理,将预定义的安全规则与机器人的环境信息相结合,生成具体的时序逻辑约束,例如“机器人必须在5秒内远离障碍物”。2) 安全计划执行:使用时序逻辑控制综合器,将用户提出的计划与生成的安全规范进行比较,如果计划违反了安全规范,则修改计划,使其满足安全规范,同时尽可能地保留用户的意图。

关键创新:RoboGuard的关键创新在于将LLM的推理能力与形式化的控制方法相结合,从而实现对LLM赋能的机器人的安全控制。与传统的机器人安全方法相比,RoboGuard能够处理LLM引入的新型安全风险,并且能够根据机器人的具体环境动态地调整安全策略。与现有的LLM安全防护措施相比,RoboGuard考虑了机器人操作的物理环境,能够防止机器人执行可能导致物理损害的动作。

关键设计:RoboGuard的关键设计包括:1) 使用可信根LLM,以防止对抗性攻击绕过安全防护。2) 使用思维链(CoT)推理,以提高LLM生成安全规范的准确性和可靠性。3) 使用时序逻辑控制综合器,以确保安全规范的满足,同时尽可能地保留用户的意图。4) 针对自适应攻击,设计了相应的防御机制。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RoboGuard能够显著降低不安全计划的执行率,从92%降低到2.5%以下,同时保持安全计划的性能。此外,RoboGuard还表现出良好的资源效率和抗攻击能力。通过启用可信根LLM的CoT推理,RoboGuard的性能得到了进一步提升。这些结果表明,RoboGuard是一种有效的安全防护方案,能够提高LLM赋能的机器人的可靠性和安全性。

🎯 应用场景

RoboGuard可应用于各种LLM赋能的机器人系统,例如家庭服务机器人、工业机器人、医疗机器人和自动驾驶汽车。它能够提高这些机器人的安全性,防止它们执行可能导致人身伤害或财产损失的动作,从而增强用户对这些系统的信任,并促进其更广泛的应用。

📄 摘要(原文)

Although the integration of large language models (LLMs) into robotics has unlocked transformative capabilities, it has also introduced significant safety concerns, ranging from average-case LLM errors (e.g., hallucinations) to adversarial jailbreaking attacks, which can produce harmful robot behavior in real-world settings. Traditional robot safety approaches do not address the novel vulnerabilities of LLMs, and current LLM safety guardrails overlook the physical risks posed by robots operating in dynamic real-world environments. In this paper, we propose RoboGuard, a two-stage guardrail architecture to ensure the safety of LLM-enabled robots. RoboGuard first contextualizes pre-defined safety rules by grounding them in the robot's environment using a root-of-trust LLM, which employs chain-of-thought (CoT) reasoning to generate rigorous safety specifications, such as temporal logic constraints. RoboGuard then resolves potential conflicts between these contextual safety specifications and a possibly unsafe plan using temporal logic control synthesis, which ensures safety compliance while minimally violating user preferences. Through extensive simulation and real-world experiments that consider worst-case jailbreaking attacks, we demonstrate that RoboGuard reduces the execution of unsafe plans from 92% to below 2.5% without compromising performance on safe plans. We also demonstrate that RoboGuard is resource-efficient, robust against adaptive attacks, and significantly enhanced by enabling its root-of-trust LLM to perform CoT reasoning. These results underscore the potential of RoboGuard to mitigate the safety risks and enhance the reliability of LLM-enabled robots.