GAGrasp: Geometric Algebra Diffusion for Dexterous Grasping

作者: Tao Zhong, Christine Allen-Blanchette

分类: cs.RO, cs.CV, cs.LG

发布日期: 2025-03-06

备注: Accepted at ICRA 2025

💡 一句话要点

GAGrasp:利用几何代数扩散模型生成灵巧抓取

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 灵巧抓取 几何代数 扩散模型 SE(3)等变性 物理仿真

📋 核心要点

- 现有灵巧抓取生成方法在处理SE(3)变换时效率较低,且难以保证抓取的物理合理性。

- GAGrasp通过几何代数表示将SE(3)对称性约束直接编码到模型架构中,提升数据和参数效率。

- 实验结果表明,GAGrasp在泛化性、稳定性和适应性方面优于现有方法,能够生成更鲁棒和物理合理的抓取。

📝 摘要(中文)

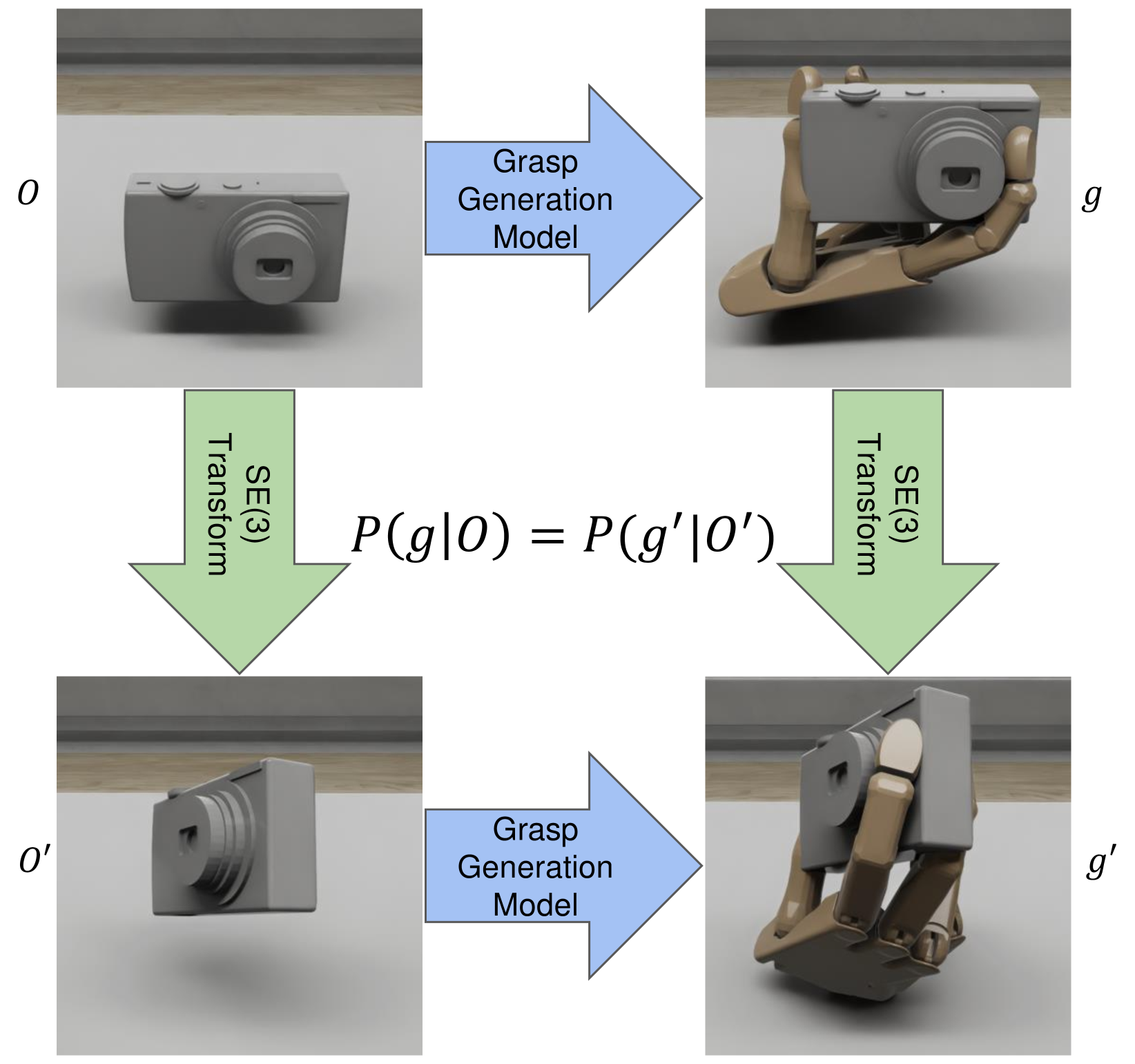

我们提出了GAGrasp,一个用于灵巧抓取生成的新框架,它利用几何代数表示来强制对SE(3)变换的等变性。通过将SE(3)对称性约束直接编码到架构中,我们的方法提高了数据和参数效率,同时实现了跨不同对象姿势的鲁棒抓取生成。此外,我们还结合了一个可微的、物理信息驱动的细化层,以确保生成的抓取在物理上是合理和稳定的。大量的实验表明,与现有方法相比,该模型在泛化性、稳定性和适应性方面表现出卓越的性能。

🔬 方法详解

问题定义:论文旨在解决灵巧抓取生成问题,特别是现有方法在处理三维空间变换(SE(3))时的效率低下以及难以保证生成抓取的物理可行性和稳定性的问题。现有方法通常需要大量数据进行训练,并且在面对新的物体姿态时泛化能力有限。

核心思路:论文的核心思路是利用几何代数(Geometric Algebra)来表示抓取姿态,并将SE(3)对称性约束直接嵌入到模型的架构设计中。通过这种方式,模型能够更好地理解和利用空间变换的性质,从而提高数据效率和泛化能力。此外,论文还引入了一个可微的物理信息细化层,以确保生成的抓取在物理上是合理和稳定的。

技术框架:GAGrasp的整体框架包含以下几个主要模块:1) 基于几何代数的抓取表示模块,用于将抓取姿态编码为几何代数形式;2) 扩散模型(Diffusion Model),用于生成初始的抓取姿态;3) SE(3)等变网络,该网络利用几何代数表示来强制模型对SE(3)变换的等变性;4) 物理信息细化层,该层利用可微的物理引擎来评估和优化抓取的稳定性。

关键创新:该论文最重要的技术创新点在于将几何代数引入到灵巧抓取生成任务中,并利用几何代数表示来构建SE(3)等变网络。与传统的欧几里得空间表示相比,几何代数能够更简洁和自然地表示空间变换,并且能够更容易地将SE(3)对称性约束嵌入到模型中。此外,物理信息细化层的引入也提高了生成抓取的物理合理性。

关键设计:在几何代数表示方面,论文采用了Clifford代数来表示抓取姿态。在扩散模型方面,论文采用了标准的扩散模型架构,并对其进行了修改以适应几何代数表示。在SE(3)等变网络方面,论文设计了一种特殊的网络结构,该结构能够保证网络的输出对SE(3)变换是等变的。在物理信息细化层方面,论文利用PyBullet等物理引擎来模拟抓取过程,并计算抓取的稳定性指标。损失函数包括扩散模型的损失、等变性损失和稳定性损失。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GAGrasp在泛化性、稳定性和适应性方面均优于现有方法。具体来说,GAGrasp在处理新的物体姿态时,能够生成更稳定和可靠的抓取姿态,并且所需的数据量更少。与基线方法相比,GAGrasp在抓取成功率方面有显著提升(具体数值未知)。

🎯 应用场景

GAGrasp在机器人灵巧操作领域具有广泛的应用前景,例如在自动化装配、物体抓取、医疗手术等场景中,可以用于生成稳定可靠的抓取姿态,提高机器人的操作效率和安全性。该研究还有助于推动机器人自主学习和人机协作技术的发展,为实现更智能、更灵活的机器人系统奠定基础。

📄 摘要(原文)

We propose GAGrasp, a novel framework for dexterous grasp generation that leverages geometric algebra representations to enforce equivariance to SE(3) transformations. By encoding the SE(3) symmetry constraint directly into the architecture, our method improves data and parameter efficiency while enabling robust grasp generation across diverse object poses. Additionally, we incorporate a differentiable physics-informed refinement layer, which ensures that generated grasps are physically plausible and stable. Extensive experiments demonstrate the model's superior performance in generalization, stability, and adaptability compared to existing methods. Additional details at https://gagrasp.github.io/