RA-DP: Rapid Adaptive Diffusion Policy for Training-Free High-frequency Robotics Replanning

作者: Xi Ye, Rui Heng Yang, Jun Jin, Yinchuan Li, Amir Rasouli

分类: cs.RO

发布日期: 2025-03-06 (更新: 2025-07-15)

备注: Accepted by IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS) 2025

💡 一句话要点

提出RA-DP,实现机器人高频自适应扩散策略,无需训练即可应对动态环境下的重规划问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting)

关键词: 扩散模型 机器人重规划 动态环境 自适应策略 无训练学习

📋 核心要点

- 现有扩散模型在机器人任务中重规划能力不足,难以适应高动态环境,限制了其应用。

- RA-DP通过集成环境引导信号和动作队列机制,在扩散采样过程中实现高频重规划,无需重新训练。

- 实验结果表明,RA-DP在重规划频率和成功率上优于现有方法,并在真实机器人任务中验证了有效性。

📝 摘要(中文)

扩散模型在机器人任务学习中展现出强大的可扩展性,但难以适应新的、高度动态的环境。这种局限性主要源于其受限的重规划能力:要么由于耗时的迭代采样过程而以低频率运行,要么在快速重规划的情况下无法适应不可预见的反馈。为了解决这些挑战,我们提出了一种新的扩散策略框架RA-DP,它具有无需训练的高频重规划能力,从而解决了适应不可预见的动态环境中的上述局限性。具体来说,我们的方法集成了在扩散采样过程中通常容易在新环境中获得的引导信号,并利用一种新颖的动作队列机制,在每个去噪步骤中生成重新规划的动作而无需重新训练,从而形成一个完整的无需训练的框架,用于机器人运动适应于未见环境。在公认的模拟基准和真实机器人任务中进行了广泛的评估。结果表明,RA-DP在重规划频率和成功率方面优于最先进的基于扩散的方法。此外,我们表明我们的框架在理论上与任何无需训练的引导信号兼容。

🔬 方法详解

问题定义:现有基于扩散模型的机器人策略学习方法,在面对动态变化的环境时,重规划能力受限。主要痛点在于,要么重规划频率低,无法及时响应环境变化;要么无法有效利用新环境中的反馈信息进行快速调整,导致任务失败。

核心思路:RA-DP的核心思路是在扩散模型的采样过程中,引入来自环境的引导信号,并结合动作队列机制,实现高频率的动作重规划。通过这种方式,机器人可以在每个去噪步骤中根据环境反馈调整动作,从而快速适应动态变化的环境。

技术框架:RA-DP框架主要包含以下几个关键模块:1) 扩散模型:用于生成初始的机器人动作序列。2) 引导信号集成模块:将来自环境的引导信号(例如,目标位置、障碍物信息等)融入到扩散模型的采样过程中。3) 动作队列机制:维护一个动作队列,并在每个去噪步骤中,根据引导信号更新队列中的动作,实现高频重规划。

关键创新:RA-DP的关键创新在于其无需训练的高频重规划能力。与需要重新训练或微调的现有方法不同,RA-DP可以在新的环境中直接利用引导信号进行动作调整,无需任何额外的训练步骤。这种设计使得RA-DP能够快速适应未知的动态环境。

关键设计:RA-DP的关键设计包括:1) 引导信号的表示和集成方式:如何有效地将环境信息编码为引导信号,并将其融入到扩散模型的采样过程中。2) 动作队列的更新策略:如何根据引导信号,高效地更新动作队列中的动作,以保证重规划的质量和效率。3) 扩散模型的选择和参数设置:选择合适的扩散模型,并对其参数进行优化,以获得更好的生成性能。

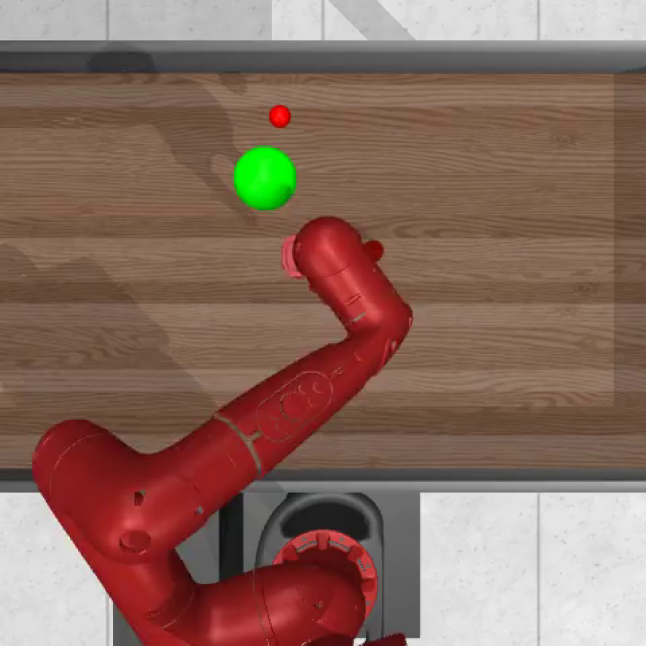

🖼️ 关键图片

📊 实验亮点

RA-DP在仿真和真实机器人实验中均取得了显著成果。在重规划频率方面,RA-DP显著优于现有基于扩散的方法。在成功率方面,RA-DP也取得了明显的提升,特别是在动态环境中,RA-DP能够更有效地适应环境变化,完成任务。实验结果表明,RA-DP是一种有效的机器人运动自适应框架。

🎯 应用场景

RA-DP具有广泛的应用前景,例如在自动驾驶、物流机器人、灾难救援等领域。它可以帮助机器人在复杂、动态的环境中自主完成任务,提高机器人的适应性和鲁棒性。未来,RA-DP可以进一步扩展到多智能体协作、人机交互等更复杂的场景。

📄 摘要(原文)

Diffusion models exhibit impressive scalability in robotic task learning, yet they struggle to adapt to novel, highly dynamic environments. This limitation primarily stems from their constrained replanning ability: they either operate at a low frequency due to a time-consuming iterative sampling process, or are unable to adapt to unforeseen feedback in case of rapid replanning. To address these challenges, we propose RA-DP, a novel diffusion policy framework with training-free high-frequency replanning ability that solves the above limitations in adapting to unforeseen dynamic environments. Specifically, our method integrates guidance signals which are often easily obtained in the new environment during the diffusion sampling process, and utilizes a novel action queue mechanism to generate replanned actions at every denoising step without retraining, thus forming a complete training-free framework for robot motion adaptation in unseen environments. Extensive evaluations have been conducted in both well-recognized simulation benchmarks and real robot tasks. Results show that RA-DP outperforms the state-of-the-art diffusion-based methods in terms of replanning frequency and success rate. Moreover, we show that our framework is theoretically compatible with any training-free guidance signal.