GraphGarment: Learning Garment Dynamics for Bimanual Cloth Manipulation Tasks

作者: Wei Chen, Kelin Li, Dongmyoung Lee, Xiaoshuai Chen, Rui Zong, Petar Kormushev

分类: cs.RO, cs.LG

发布日期: 2025-03-04 (更新: 2025-03-11)

💡 一句话要点

GraphGarment:学习服装动力学,用于双臂机器人服装操作任务

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 服装操作 机器人 图神经网络 动力学建模 模拟到真实 残差学习 柔性物体操作

📋 核心要点

- 服装操作是机器人领域的难题,现有方法难以应对织物的可变形特性,导致在家庭、医疗等场景应用受限。

- GraphGarment利用图神经网络学习服装动力学模型,预测服装状态,并结合残差模型弥补模拟与现实的差距。

- 实验表明,该方法在服装状态预测和悬挂任务中均优于现有方法,并在真实机器人实验中表现出良好的鲁棒性。

📝 摘要(中文)

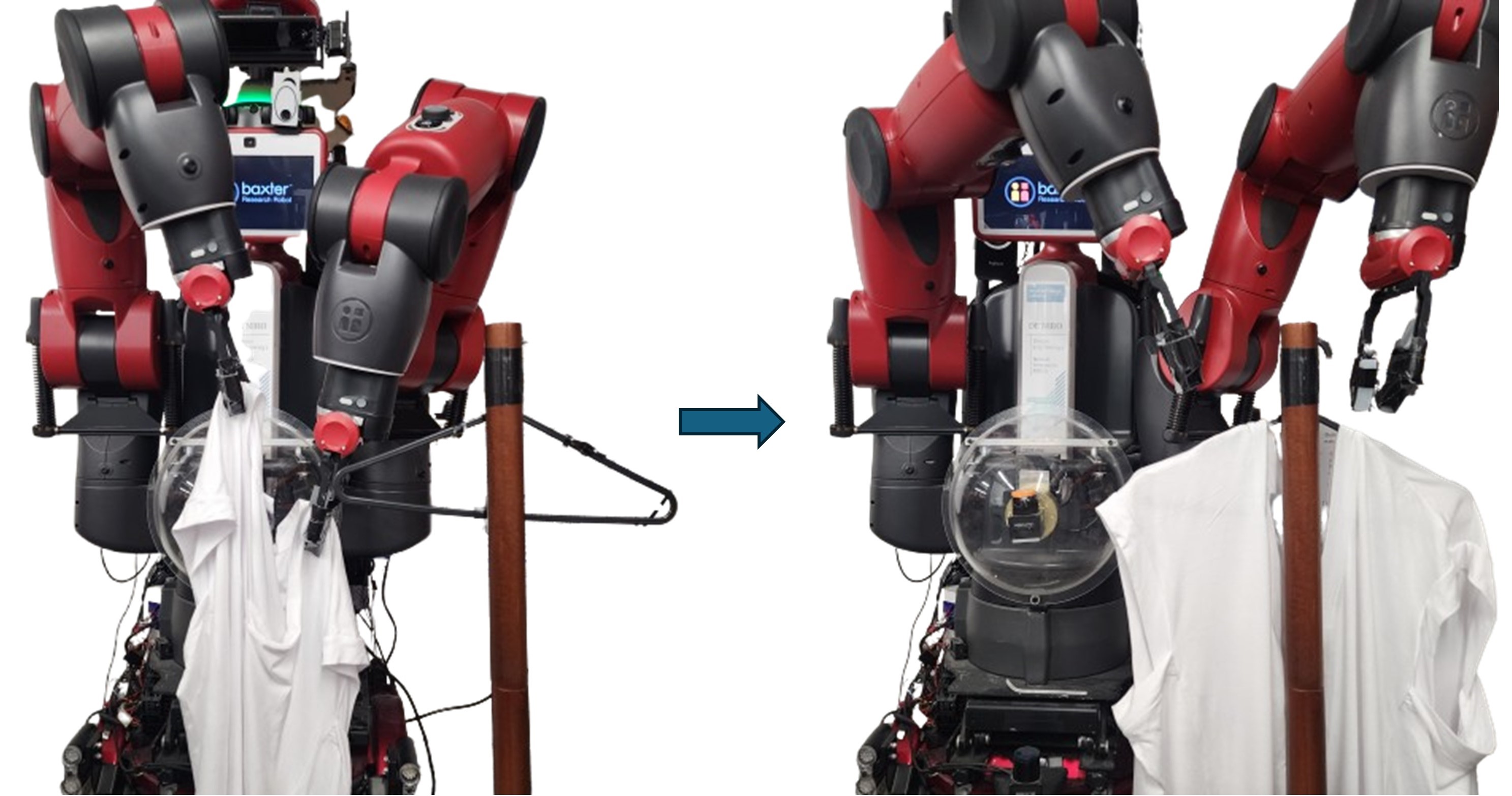

在执行诸如悬挂服装等与织物相关的任务时,对服装进行物理操作至关重要。然而,由于织物的可变形特性,这些操作对于家庭、医疗保健和工业环境中的机器人来说仍然是一个重大挑战。本文提出了一种名为GraphGarment的新方法,该方法基于机器人控制输入对服装动力学进行建模,并将学习到的动力学模型应用于服装操作任务,例如悬挂。具体来说,我们使用图来表示机器人末端执行器和服装之间的交互。GraphGarment使用图神经网络(GNN)来学习动力学模型,该模型可以预测给定当前状态和输入动作的下一个服装状态(在模拟中)。为了解决显著的模拟到真实世界的差距,我们提出了一个残差模型,该模型可以补偿服装状态预测误差,从而提高真实世界的性能。然后,将服装动力学模型应用于基于模型的动作采样策略,在该策略中,它被用于将服装操纵到用于服装悬挂任务的参考预悬挂配置。我们使用六种类型的服装进行了四个实验,以验证我们的方法在模拟和真实环境中的有效性。在模拟实验中,GraphGarment实现了更好的服装状态预测性能,预测误差比最佳基线低0.46厘米。我们的方法还在服装悬挂模拟实验中表现出改进的性能,分别提高了12%、24%和10%。此外,真实机器人实验证实了模拟到真实世界转移的鲁棒性,与模拟结果相比,误差增加了0.17厘米。

🔬 方法详解

问题定义:论文旨在解决机器人服装操作任务中,由于服装的形变特性导致的控制难题。现有方法难以准确预测服装状态,导致操作失败率高,难以在真实场景中应用。

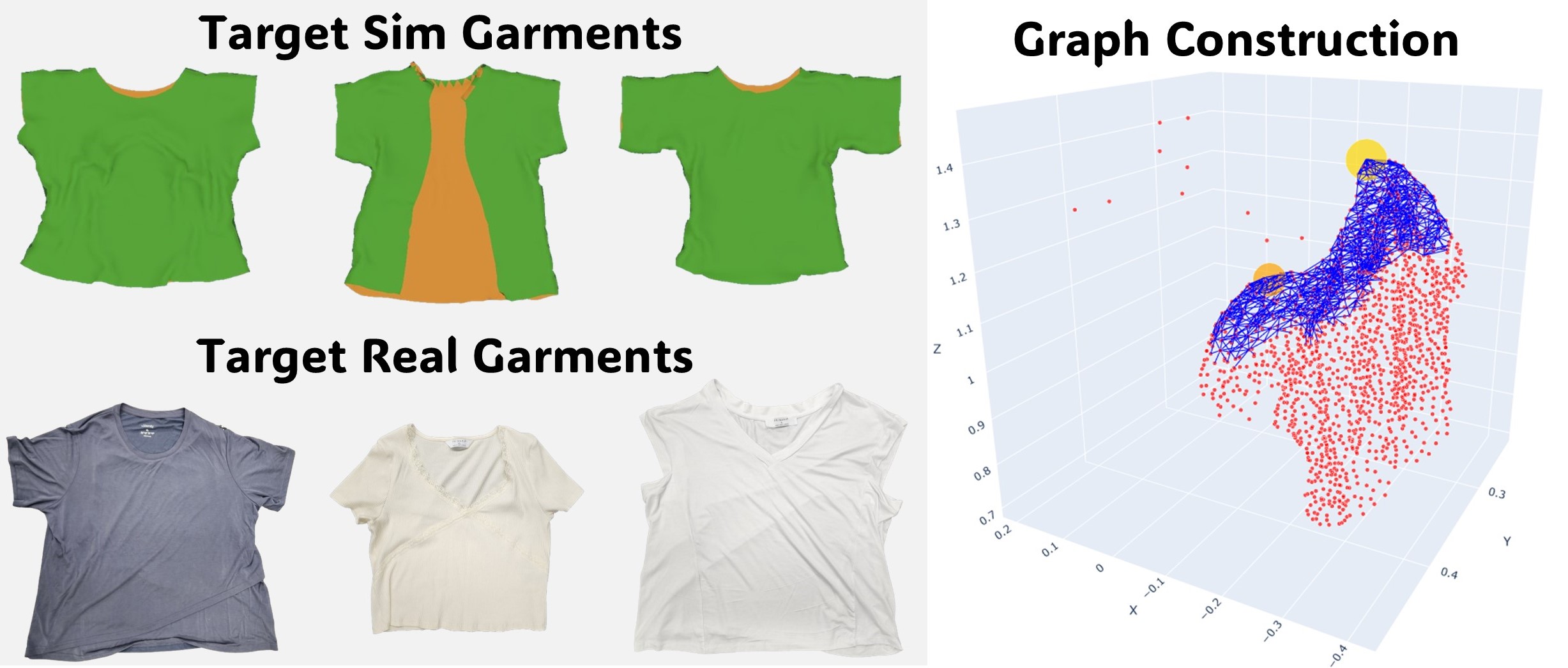

核心思路:论文的核心思路是利用图神经网络(GNN)学习服装的动力学模型。通过将服装表示为图结构,节点表示服装上的关键点,边表示点之间的连接关系,GNN可以学习到服装在不同操作下的形变规律。同时,为了解决模拟到真实的迁移问题,引入了残差模型来补偿预测误差。

技术框架:GraphGarment的整体框架包含以下几个主要模块:1) 图构建模块:将服装表示为图结构,确定节点和边的连接关系。2) GNN动力学模型:利用GNN学习服装的动力学模型,预测给定当前状态和动作的下一个服装状态。3) 残差模型:补偿GNN动力学模型的预测误差,提高真实世界的性能。4) 动作采样策略:基于学习到的动力学模型,选择合适的动作序列,完成服装操作任务。

关键创新:该论文的关键创新在于:1) 基于图的服装表示:将服装表示为图结构,能够更好地捕捉服装的形变特性。2) GNN动力学模型:利用GNN学习服装动力学模型,能够准确预测服装状态。3) 残差模型:补偿模拟到真实的差距,提高真实世界的性能。

关键设计:在图构建模块中,论文采用了一种基于关键点的图表示方法,选择服装上的关键点作为图的节点,并根据节点之间的距离确定边的连接关系。GNN动力学模型采用了一种多层感知机(MLP)结构,用于学习节点状态的更新规则。残差模型采用了一种线性回归模型,用于预测GNN动力学模型的预测误差。损失函数包括状态预测误差和动作惩罚项,用于优化GNN动力学模型和残差模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GraphGarment在服装状态预测方面优于现有方法,预测误差降低了0.46厘米。在服装悬挂模拟实验中,性能分别提高了12%、24%和10%。真实机器人实验也验证了该方法的鲁棒性,与模拟结果相比,误差仅增加了0.17厘米,表明了良好的模拟到真实迁移能力。

🎯 应用场景

该研究成果可应用于家庭服务机器人、医疗辅助机器人和工业自动化等领域。例如,可以帮助机器人完成叠衣服、挂衣服、整理床铺等任务,提高机器人在复杂环境中的适应性和操作能力。未来,该技术有望进一步扩展到其他柔性物体的操作任务中。

📄 摘要(原文)

Physical manipulation of garments is often crucial when performing fabric-related tasks, such as hanging garments. However, due to the deformable nature of fabrics, these operations remain a significant challenge for robots in household, healthcare, and industrial environments. In this paper, we propose GraphGarment, a novel approach that models garment dynamics based on robot control inputs and applies the learned dynamics model to facilitate garment manipulation tasks such as hanging. Specifically, we use graphs to represent the interactions between the robot end-effector and the garment. GraphGarment uses a graph neural network (GNN) to learn a dynamics model that can predict the next garment state given the current state and input action in simulation. To address the substantial sim-to-real gap, we propose a residual model that compensates for garment state prediction errors, thereby improving real-world performance. The garment dynamics model is then applied to a model-based action sampling strategy, where it is utilized to manipulate the garment to a reference pre-hanging configuration for garment-hanging tasks. We conducted four experiments using six types of garments to validate our approach in both simulation and real-world settings. In simulation experiments, GraphGarment achieves better garment state prediction performance, with a prediction error 0.46 cm lower than the best baseline. Our approach also demonstrates improved performance in the garment-hanging simulation experiment with enhancements of 12%, 24%, and 10%, respectively. Moreover, real-world robot experiments confirm the robustness of sim-to-real transfer, with an error increase of 0.17 cm compared to simulation results. Supplementary material is available at:https://sites.google.com/view/graphgarment.