FRMD: Fast Robot Motion Diffusion with Consistency-Distilled Movement Primitives for Smooth Action Generation

作者: Xirui Shi, Jun Jin

分类: cs.RO, cs.AI

发布日期: 2025-03-03

备注: arXiv admin note: text overlap with arXiv:2406.01586 by other authors

💡 一句话要点

提出FRMD:结合运动基元与一致性蒸馏的快速机器人运动扩散模型,实现平滑动作生成。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion)

关键词: 机器人运动规划 扩散模型 运动基元 一致性模型 轨迹生成 强化学习 机器人控制

📋 核心要点

- 现有扩散模型在机器人运动生成中存在时间一致性差,导致运动不平滑,以及迭代采样过程耗时过长的问题。

- FRMD的核心思想是将运动基元(MPs)与一致性模型相结合,利用概率流ODE和一致性蒸馏实现高效的单步轨迹生成。

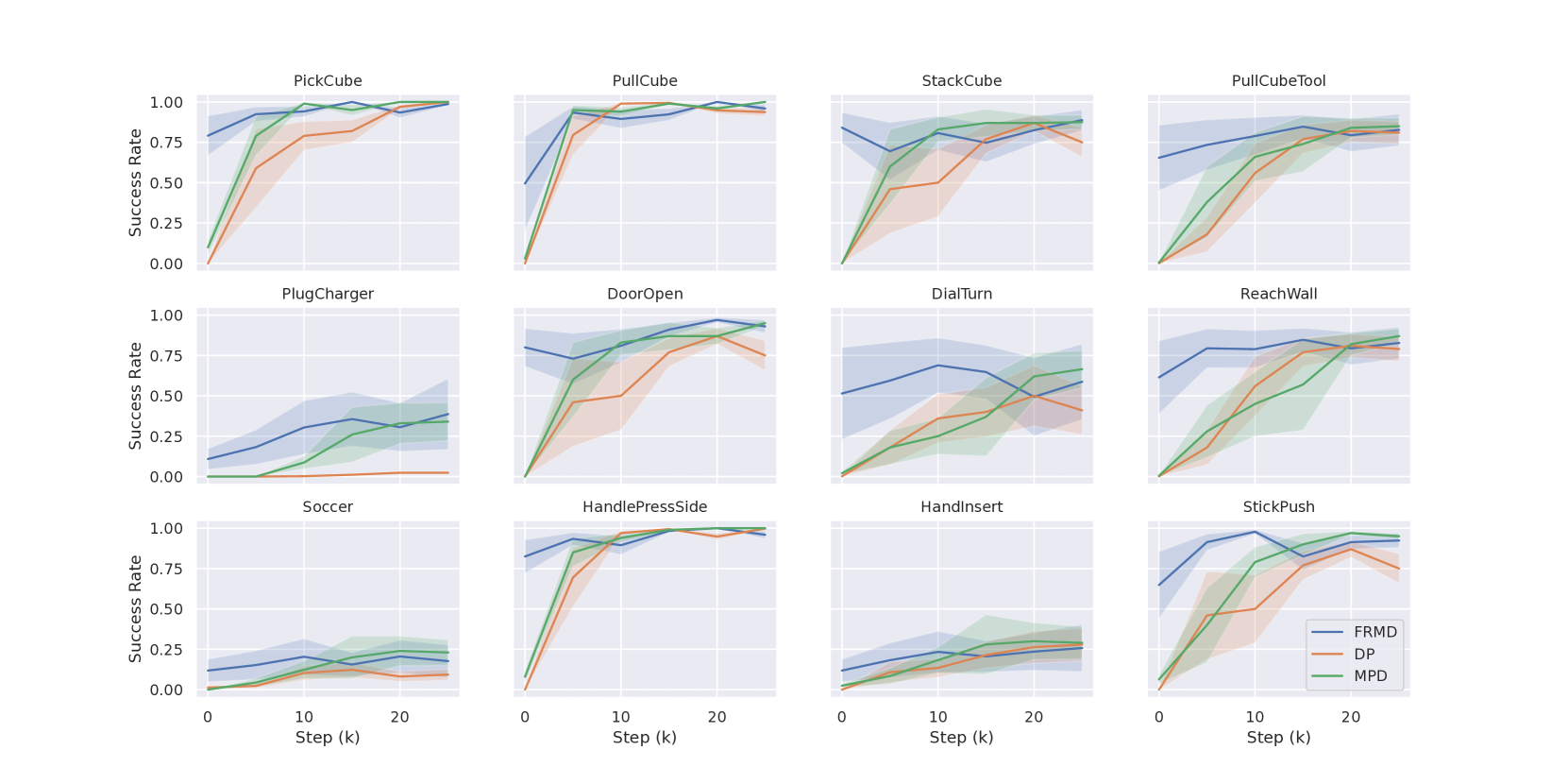

- 实验结果表明,FRMD在Meta-World和ManiSkills基准测试中,显著提升了运动生成的速度和平滑度,并提高了任务成功率。

📝 摘要(中文)

本文研究了如何使用扩散模型生成快速、平滑且时间上一致的机器人运动。尽管扩散模型在机器人学习中表现出色,但由于无法捕捉时间上一致的运动动力学,常常产生不平滑、生涩的运动,并且其迭代采样过程导致延迟过高。受经典机器人运动生成方法(如DMPs和ProMPs)的启发,以及扩散图像生成中利用一致性模型加速去噪过程的最新进展,我们提出了快速机器人运动扩散(FRMD)。FRMD独特地将运动基元(MPs)与一致性模型相结合,以实现高效的单步轨迹生成。通过利用概率流ODE和一致性蒸馏,我们的方法在编码器-解码器架构中对轨迹分布进行建模,同时学习紧凑的、时间连续的运动表示。这种统一的方法消除了传统扩散模型缓慢的多步去噪过程,从而实现高效的单步推理和平滑的机器人运动生成。我们在Meta-World和ManiSkills基准测试中对FRMD进行了广泛评估,结果表明,FRMD生成的速度更快、轨迹更平滑,同时实现了更高的成功率。

🔬 方法详解

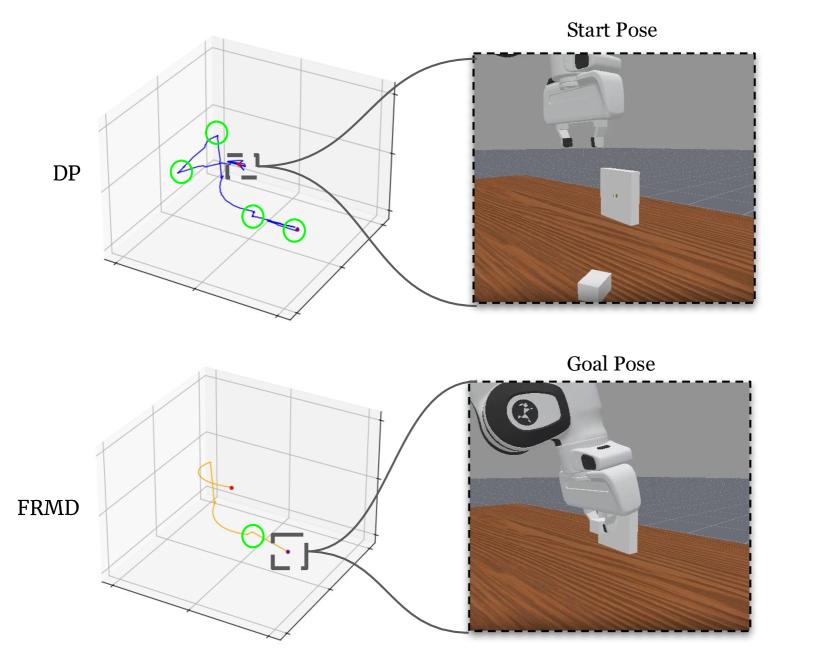

问题定义:论文旨在解决机器人运动生成中,传统扩散模型生成动作不平滑、推理速度慢的问题。现有方法难以同时保证运动的时间一致性和高效的生成速度,限制了其在实时机器人控制中的应用。

核心思路:论文的核心思路是将运动基元(Movement Primitives, MPs)的优势与一致性模型(Consistency Models)相结合。运动基元能够有效地表示时间上一致的运动轨迹,而一致性模型可以通过单步推理快速生成样本。通过结合两者,FRMD旨在实现快速且平滑的机器人运动生成。

技术框架:FRMD采用编码器-解码器架构。编码器将任务目标和环境信息编码为低维向量,解码器利用一致性模型和运动基元生成运动轨迹。具体流程包括:1) 使用编码器将任务目标编码为潜在空间向量;2) 利用一致性模型,基于潜在空间向量和时间信息,预测运动轨迹;3) 使用运动基元对预测的轨迹进行平滑和时间一致性约束。

关键创新:FRMD的关键创新在于将运动基元与一致性模型集成到一个统一的框架中。传统扩散模型需要多步迭代去噪才能生成样本,而FRMD通过一致性蒸馏学习一个单步预测模型,显著提高了生成速度。同时,运动基元的引入保证了生成轨迹的时间一致性和平滑性。

关键设计:FRMD使用概率流ODE(Probability Flow ODE)来描述轨迹分布的演化过程。一致性蒸馏用于训练单步预测模型,损失函数包括轨迹预测误差、时间一致性损失和平滑性损失。网络结构采用Transformer或MLP,具体参数设置根据任务复杂度进行调整。

🖼️ 关键图片

📊 实验亮点

FRMD在Meta-World和ManiSkills基准测试中取得了显著的性能提升。与现有方法相比,FRMD的运动生成速度提高了数倍,轨迹平滑度也得到了明显改善。在一些复杂操作任务中,FRMD的成功率也高于其他基线方法,验证了其在实际机器人应用中的潜力。

🎯 应用场景

FRMD可应用于各种机器人运动规划和控制任务,例如工业机器人装配、家庭服务机器人操作、以及自动驾驶车辆的轨迹规划。该方法能够生成快速、平滑的运动轨迹,提高机器人的工作效率和安全性,并有望推动机器人技术在实际场景中的广泛应用。

📄 摘要(原文)

We consider the problem of using diffusion models to generate fast, smooth, and temporally consistent robot motions. Although diffusion models have demonstrated superior performance in robot learning due to their task scalability and multi-modal flexibility, they suffer from two fundamental limitations: (1) they often produce non-smooth, jerky motions due to their inability to capture temporally consistent movement dynamics, and (2) their iterative sampling process incurs prohibitive latency for many robotic tasks. Inspired by classic robot motion generation methods such as DMPs and ProMPs, which capture temporally and spatially consistent dynamic of trajectories using low-dimensional vectors -- and by recent advances in diffusion-based image generation that use consistency models with probability flow ODEs to accelerate the denoising process, we propose Fast Robot Motion Diffusion (FRMD). FRMD uniquely integrates Movement Primitives (MPs) with Consistency Models to enable efficient, single-step trajectory generation. By leveraging probabilistic flow ODEs and consistency distillation, our method models trajectory distributions while learning a compact, time-continuous motion representation within an encoder-decoder architecture. This unified approach eliminates the slow, multi-step denoising process of conventional diffusion models, enabling efficient one-step inference and smooth robot motion generation. We extensively evaluated our FRMD on the well-recognized Meta-World and ManiSkills Benchmarks, ranging from simple to more complex manipulation tasks, comparing its performance against state-of-the-art baselines. Our results show that FRMD generates significantly faster, smoother trajectories while achieving higher success rates.