AVR: Active Vision-Driven Precise Robot Manipulation with Viewpoint and Focal Length Optimization

作者: Yushan Liu, Shilong Mu, Xintao Chao, Zizhen Li, Yao Mu, Tianxing Chen, Shoujie Li, Chuqiao Lyu, Xiao-Ping Zhang, Wenbo Ding

分类: cs.RO

发布日期: 2025-03-03 (更新: 2025-09-26)

备注: Project Page: https://AVR-robot.github.io

💡 一句话要点

AVR:主动视觉驱动的精确机器人操作,优化视角和焦距

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人操作 主动视觉 视角优化 焦距优化 模仿学习 遥操作 数据增强

📋 核心要点

- 复杂场景中的机器人操作需要精确感知任务相关细节,但固定或次优视角会损害精细感知并导致遮挡。

- AVR框架结合头部跟踪视角控制和电动变焦,在数据采集和部署时保持目标居中和适当比例,实现主动视觉。

- 实验表明,AVR在模拟和真实环境中均显著提升了机器人操作的成功率,并展现了良好的鲁棒性和泛化能力。

📝 摘要(中文)

本文提出AVR(Active Vision-driven Robotics),一个双臂遥操作和学习框架,它统一了头部跟踪的视角控制(HMD到2自由度万向节)与电动光学变焦,以在数据收集和部署期间保持目标居中并处于适当的比例。在模拟环境中,AVR插件通过模拟主动视觉(ROI条件下的视角变化、保持宽高比的裁剪与显式变焦比以及超分辨率)来增强RoboTwin演示,从而在各种操作中获得5-17%的任务成功率提升。在真实世界平台上,AVR改进了大多数任务的成功率,与静态视角基线相比提升超过25%,扩展研究进一步证明了其在遮挡、杂乱和光照干扰下的鲁棒性,以及对未见环境和物体的泛化能力。这些结果为未来机器人精确操作方法在追求人类水平的灵巧性和精度方面铺平了道路。

🔬 方法详解

问题定义:现有机器人操作方法在复杂场景中面临精确感知的挑战,固定视角或次优视角容易导致目标遮挡,影响机器人对关键细节的捕捉,进而限制了模仿学习策略的性能。因此,如何动态调整视角和焦距,以获得最佳的目标感知效果,是本文要解决的核心问题。

核心思路:本文的核心思路是引入主动视觉机制,通过头部跟踪控制视角和电动变焦控制焦距,使机器人能够像人一样主动调整观察角度和距离,从而获得更清晰、更全面的目标信息。这种主动调整机制能够有效减少遮挡,提高目标感知的精度,最终提升机器人操作的成功率。

技术框架:AVR框架主要包含以下几个模块:1) 头部跟踪模块:利用头戴式显示器(HMD)跟踪操作者的头部运动,并将运动信息传递给2自由度万向节,从而控制机器人的视角。2) 电动变焦模块:通过控制电机的光学变焦,调整相机的焦距,使目标始终保持在图像中心并处于合适的比例。3) 数据增强模块(仅在模拟环境中使用):通过模拟主动视觉,生成ROI条件下的视角变化、保持宽高比的裁剪与显式变焦比以及超分辨率图像,从而增强训练数据的多样性。4) 模仿学习模块:利用增强后的数据训练机器人操作策略。

关键创新:AVR框架的关键创新在于将主动视觉机制引入到机器人操作中,通过头部跟踪和电动变焦实现视角的动态调整,从而克服了传统固定视角方法的局限性。此外,AVR框架还提出了一种新的数据增强方法,通过模拟主动视觉来提高训练数据的质量和多样性。

关键设计:在真实机器人平台上,HMD的头部运动被映射到2自由度云台上,从而控制相机的方位角和俯仰角。电动变焦通过PID控制器进行控制,以保持目标在图像中心并处于合适的比例。在模拟环境中,使用了RoboTwin进行数据生成,并使用超分辨率技术来提高图像质量。损失函数使用了标准的模仿学习损失函数,例如行为克隆损失。

🖼️ 关键图片

📊 实验亮点

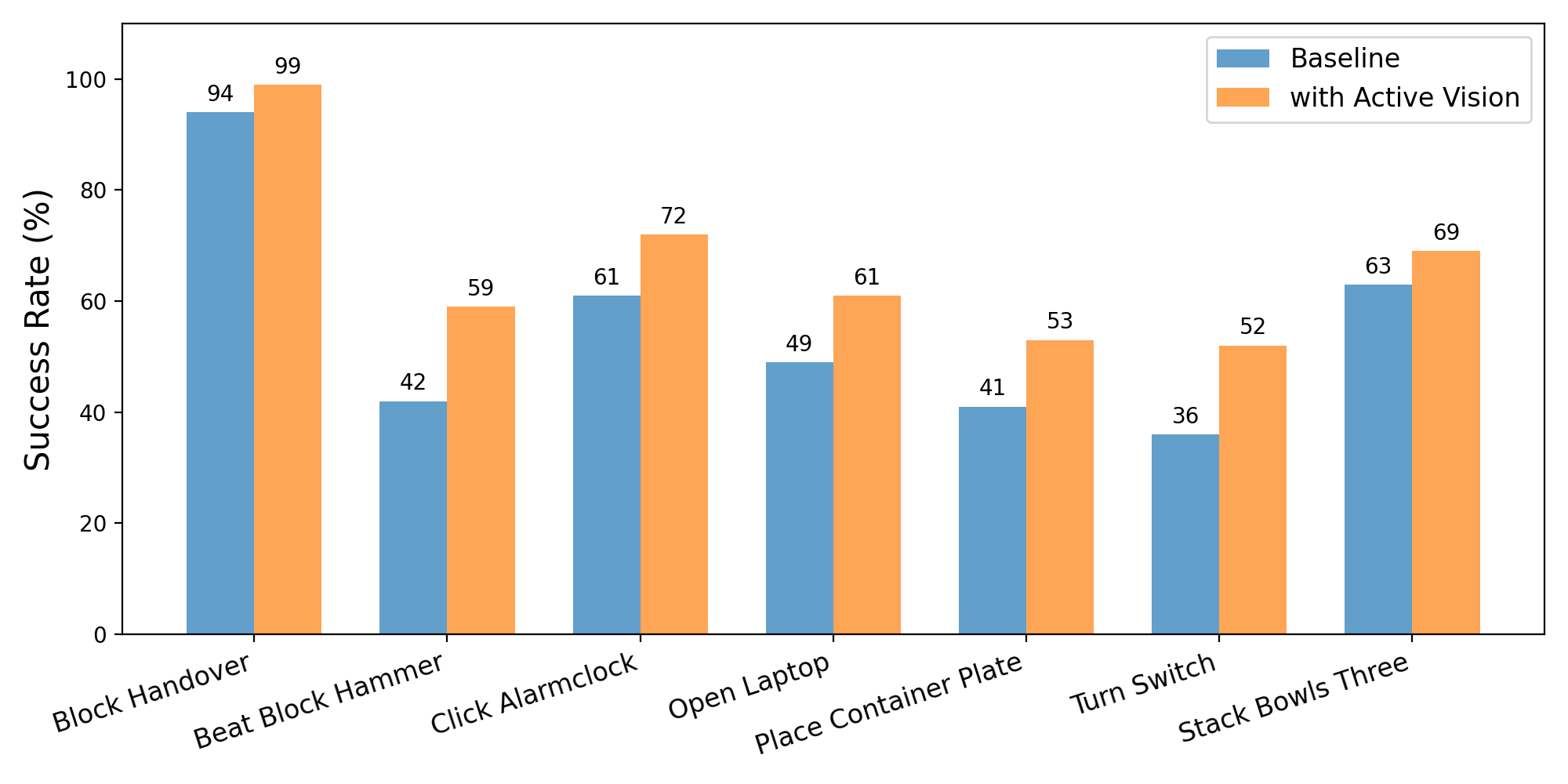

在模拟环境中,AVR插件通过模拟主动视觉,在各种操作中获得了5-17%的任务成功率提升。在真实世界平台上,AVR改进了大多数任务的成功率,与静态视角基线相比提升超过25%。扩展研究进一步证明了AVR在遮挡、杂乱和光照干扰下的鲁棒性,以及对未见环境和物体的泛化能力。

🎯 应用场景

AVR框架具有广泛的应用前景,可应用于各种需要精确操作的机器人任务中,例如医疗手术机器人、精密装配机器人、以及在复杂环境中进行操作的机器人。该研究的实际价值在于提高了机器人操作的精度和鲁棒性,使其能够更好地适应各种复杂场景。未来,AVR框架可以进一步扩展到其他类型的机器人和任务中,例如无人机巡检、自动驾驶等。

📄 摘要(原文)

Robotic manipulation in complex scenes demands precise perception of task-relevant details, yet fixed or suboptimal viewpoints often impair fine-grained perception and induce occlusions, constraining imitation-learned policies. We present AVR (Active Vision-driven Robotics), a bimanual teleoperation and learning framework that unifies head-tracked viewpoint control (HMD-to-2-DoF gimbal) with motorized optical zoom to keep targets centered at an appropriate scale during data collection and deployment. In simulation, an AVR plugin augments RoboTwin demonstrations by emulating active vision (ROI-conditioned viewpoint change, aspect-ratio-preserving crops with explicit zoom ratios, and super-resolution), yielding 5-17% gains in task success across diverse manipulations. On our real-world platform, AVR improves success on most tasks, with over 25% gains compared to the static-view baseline, and extended studies further demonstrate robustness under occlusion, clutter, and lighting disturbances, as well as generalization to unseen environments and objects. These results pave the way for future robotic precision manipulation methods in the pursuit of human-level dexterity and precision.