Close-Proximity Satellite Operations through Deep Reinforcement Learning and Terrestrial Testing Environments

作者: Henry Lei, Joshua Aurand, Zachary S. Lippay, Sean Phillips

分类: cs.RO, eess.SY

发布日期: 2025-02-27

💡 一句话要点

提出基于深度强化学习的近距离卫星自主操作方法,并进行地面环境测试。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 卫星自主控制 近距离卫星操作 多智能体系统 地面测试环境

📋 核心要点

- 太空环境日益复杂,传统卫星操作面临安全性和效率挑战,亟需自主化解决方案。

- 论文提出利用深度强化学习(DRL)方法,实现卫星在多智能体检查任务中的自主控制。

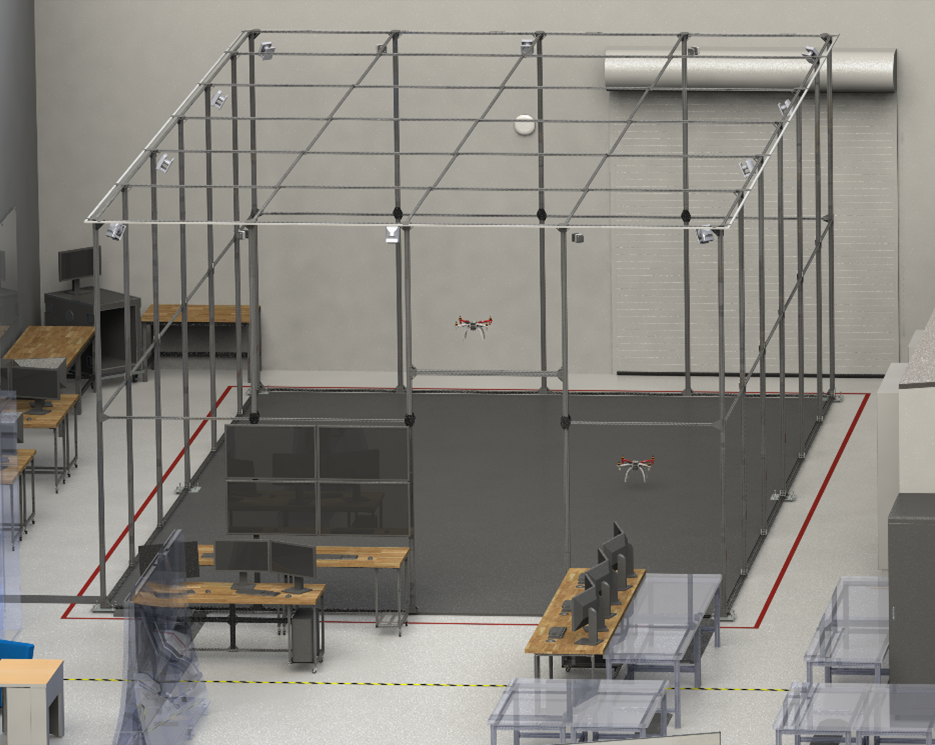

- 通过LINCS实验室,在仿真和真实四旋翼无人机平台上测试算法,评估其泛化能力。

📝 摘要(中文)

在日益拥挤和竞争激烈的太空环境中,安全有效的卫星操作变得越来越具有挑战性。因此,人们对自主卫星能力越来越感兴趣,常见的机器学习技术因其在解决太空领域复杂决策方面的潜力而受到关注。然而,许多此类方法的“黑盒”性质导致难以理解模型的输入/输出关系,更具体地说,难以理解其对环境扰动、传感器噪声和控制干预的敏感性。本文探讨了使用深度强化学习(DRL)进行多智能体检查任务中的卫星控制。利用协作卫星本地智能网络(LINCS)实验室,在不同的环境中测试这些控制算法的性能,从仿真到真实世界的四旋翼无人机硬件,特别关注理解它们在超出训练环境部署时的行为和潜在的性能下降。

🔬 方法详解

问题定义:论文旨在解决日益拥挤的太空环境中,卫星近距离操作的安全性和效率问题。现有方法,特别是依赖传统控制策略的方法,难以应对复杂环境扰动和传感器噪声,且缺乏自主性和泛化能力。同时,直接应用机器学习方法,尤其是深度学习,其“黑盒”特性使得难以理解模型行为,并难以保证在未知环境下的可靠性。

核心思路:论文的核心思路是利用深度强化学习(DRL)训练卫星控制策略,使其能够在复杂环境中自主学习并优化操作行为。通过强化学习,智能体(卫星)可以与环境交互,并根据奖励信号不断改进策略,从而适应不同的环境扰动和传感器噪声。此外,通过在不同环境中进行测试,评估算法的泛化能力和鲁棒性。

技术框架:整体框架包括以下几个主要部分:1)环境建模:构建卫星近距离操作的仿真环境,包括卫星动力学模型、传感器模型和环境扰动模型。2)DRL智能体设计:设计基于深度神经网络的DRL智能体,用于学习卫星控制策略。3)奖励函数设计:设计合适的奖励函数,引导智能体学习期望的操作行为,例如安全接近目标卫星、保持稳定姿态等。4)训练过程:使用强化学习算法(例如,DQN、PPO等)训练DRL智能体,使其能够自主学习并优化控制策略。5)测试与评估:在不同的仿真环境和真实四旋翼无人机平台上测试训练好的智能体,评估其性能和泛化能力。

关键创新:论文的关键创新在于将深度强化学习应用于卫星近距离自主操作,并结合地面测试环境进行验证。与传统的控制方法相比,DRL方法能够自主学习并适应复杂环境,具有更强的鲁棒性和泛化能力。此外,通过在真实四旋翼无人机平台上进行测试,验证了算法在实际应用中的可行性。

关键设计:论文的关键设计包括:1)状态空间设计:选择合适的状态变量,例如卫星的位置、速度、姿态等,作为DRL智能体的输入。2)动作空间设计:定义卫星的控制动作,例如推力大小和方向、姿态控制力矩等。3)奖励函数设计:设计合适的奖励函数,例如接近目标卫星的奖励、保持稳定姿态的奖励、避免碰撞的惩罚等。4)网络结构设计:选择合适的深度神经网络结构,例如卷积神经网络(CNN)或循环神经网络(RNN),用于学习卫星控制策略。5)训练参数设置:设置合适的训练参数,例如学习率、折扣因子、探索率等,以保证训练过程的稳定性和收敛性。

🖼️ 关键图片

📊 实验亮点

论文通过仿真和真实四旋翼无人机实验验证了DRL算法的有效性。实验结果表明,DRL智能体能够在复杂环境中自主学习并优化卫星控制策略,实现安全、高效的近距离操作。虽然论文中没有给出具体的性能数据和提升幅度,但强调了算法在不同环境下的泛化能力和鲁棒性。

🎯 应用场景

该研究成果可应用于多种航天任务,例如卫星在轨服务、空间碎片清除、空间态势感知等。通过自主控制,卫星能够更安全、高效地完成这些任务,降低操作成本,提高任务成功率。未来,该技术有望推动航天领域的智能化发展,实现更复杂的空间任务。

📄 摘要(原文)

With the increasingly congested and contested space environment, safe and effective satellite operation has become increasingly challenging. As a result, there is growing interest in autonomous satellite capabilities, with common machine learning techniques gaining attention for their potential to address complex decision-making in the space domain. However, the "black-box" nature of many of these methods results in difficulty understanding the model's input/output relationship and more specifically its sensitivity to environmental disturbances, sensor noise, and control intervention. This paper explores the use of Deep Reinforcement Learning (DRL) for satellite control in multi-agent inspection tasks. The Local Intelligent Network of Collaborative Satellites (LINCS) Lab is used to test the performance of these control algorithms across different environments, from simulations to real-world quadrotor UAV hardware, with a particular focus on understanding their behavior and potential degradation in performance when deployed beyond the training environment.