Stability Analysis of Deep Reinforcement Learning for Multi-Agent Inspection in a Terrestrial Testbed

作者: Henry Lei, Zachary S. Lippay, Anonto Zaman, Joshua Aurand, Amin Maghareh, Sean Phillips

分类: cs.RO, eess.SY

发布日期: 2025-02-26

DOI: 10.2514/6.2025-1146

💡 一句话要点

提出一种分层深度强化学习框架,用于多智能体卫星自主巡检任务,并在地面测试平台上验证其稳定性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 多智能体系统 卫星巡检 自主控制 分层控制 地面测试平台 空间任务

📋 核心要点

- 空间任务对自主系统有严格的可靠性、长运行时间和通信挑战要求,现有方法难以兼顾。

- 论文提出分层深度强化学习框架,高层策略负责任务分配,低层控制器执行轨迹,实现高效巡检。

- 在LINCS测试台上,该框架在模拟和真实环境中均表现出鲁棒性,验证了其在复杂环境中的适应能力。

📝 摘要(中文)

本研究评估了一种分层深度强化学习(DRL)框架在多智能体卫星巡检任务中的稳定性和性能。该框架集成了高层引导策略和低层运动控制器,实现了可扩展的任务分配和高效的轨迹执行。在本地智能协作卫星网络(LINCS)测试平台上进行的实验,评估了该框架在不同保真度水平下的性能,从模拟环境到赛博物理测试平台。关键指标,包括任务完成率、行驶距离和燃料消耗,突出了该框架的鲁棒性和适应性,即使在传感器噪声、动态扰动和运行时保障(RTA)约束等实际不确定性下也能保持良好性能。结果表明,分层控制器有效地弥合了从模拟到真实的差距,在适应真实环境复杂性的同时,保持了较高的任务完成率。这些发现验证了该框架在未来太空任务中实现自主卫星运行的潜力。

🔬 方法详解

问题定义:论文旨在解决多智能体卫星在复杂环境中进行自主巡检的问题。现有方法在面对传感器噪声、动态扰动和运行时保障约束等实际不确定性时,难以保证任务完成率和资源利用率。此外,如何有效地进行任务分配和轨迹规划,以实现多智能体之间的协同,也是一个挑战。

核心思路:论文的核心思路是采用分层深度强化学习框架,将任务分解为高层引导策略和低层运动控制两个层次。高层策略负责任务分配和目标选择,低层控制器负责生成具体的运动轨迹。这种分层结构可以有效地解耦任务,提高系统的鲁棒性和适应性。

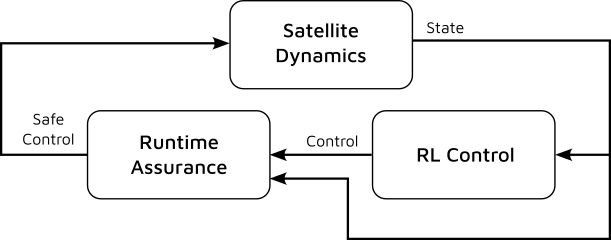

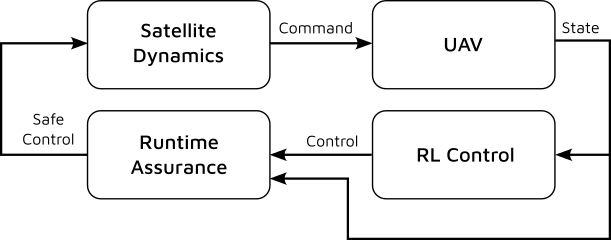

技术框架:整体框架包含以下几个主要模块:1) 环境模型:模拟卫星的运动学和动力学特性,以及传感器噪声和动态扰动等因素。2) 高层策略:使用深度强化学习算法(具体算法未知)训练一个策略网络,用于根据当前状态选择下一个要巡检的目标。3) 低层控制器:使用PID或其他控制算法,根据高层策略设定的目标,生成具体的运动轨迹。4) 运行时保障(RTA)模块:用于监控系统的运行状态,并在出现异常情况时进行干预。

关键创新:该论文的关键创新在于将分层深度强化学习框架应用于多智能体卫星巡检任务,并验证了其在真实环境中的可行性。与传统的集中式控制方法相比,该框架具有更好的可扩展性和鲁棒性。此外,通过结合高层策略和低层控制器,可以有效地解决任务分配和轨迹规划问题。

关键设计:论文中没有详细说明具体的参数设置、损失函数和网络结构等技术细节。但是,可以推测,高层策略可能使用Actor-Critic算法进行训练,损失函数可能包括任务完成率、行驶距离和燃料消耗等因素。低层控制器可能使用PID控制或其他基于模型的控制方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该分层深度强化学习框架在LINCS测试平台上表现出良好的性能。即使在存在传感器噪声、动态扰动和运行时保障约束等实际不确定性的情况下,该框架仍然能够保持较高的任务完成率。具体的数据和对比基线未知,但摘要强调了该框架有效地弥合了从模拟到真实的差距。

🎯 应用场景

该研究成果可应用于未来的空间任务,例如自主卫星维护、空间碎片清理、行星探测等。通过提高卫星的自主性和智能化水平,可以降低任务成本、提高任务效率,并减少人为干预的风险。此外,该框架还可以推广到其他多智能体系统,例如无人机集群、自动驾驶车辆等。

📄 摘要(原文)

The design and deployment of autonomous systems for space missions require robust solutions to navigate strict reliability constraints, extended operational duration, and communication challenges. This study evaluates the stability and performance of a hierarchical deep reinforcement learning (DRL) framework designed for multi-agent satellite inspection tasks. The proposed framework integrates a high-level guidance policy with a low-level motion controller, enabling scalable task allocation and efficient trajectory execution. Experiments conducted on the Local Intelligent Network of Collaborative Satellites (LINCS) testbed assess the framework's performance under varying levels of fidelity, from simulated environments to a cyber-physical testbed. Key metrics, including task completion rate, distance traveled, and fuel consumption, highlight the framework's robustness and adaptability despite real-world uncertainties such as sensor noise, dynamic perturbations, and runtime assurance (RTA) constraints. The results demonstrate that the hierarchical controller effectively bridges the sim-to-real gap, maintaining high task completion rates while adapting to the complexities of real-world environments. These findings validate the framework's potential for enabling autonomous satellite operations in future space missions.