V-HOP: Visuo-Haptic 6D Object Pose Tracking

作者: Hongyu Li, Mingxi Jia, Tuluhan Akbulut, Yu Xiang, George Konidaris, Srinath Sridhar

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-02-24 (更新: 2025-09-11)

备注: Accepted by RSS 2025

DOI: 10.15607/RSS.2025.XXI.037

💡 一句话要点

V-HOP:提出基于Transformer的视觉-触觉融合6D物体姿态跟踪方法,提升操作任务的鲁棒性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 视觉-触觉融合 6D物体姿态跟踪 Transformer 机器人操作 多模态学习

📋 核心要点

- 现有方法在真实场景中,由于夹爪、传感器布局多样性以及模拟到真实环境的差异,视觉-触觉融合的物体姿态估计泛化性较差。

- 提出一种统一的触觉表示方法,并构建基于Transformer的视觉-触觉物体姿态跟踪器,实现视觉和触觉信息的无缝融合。

- 实验结果表明,该方法在泛化性、鲁棒性和性能上均有显著提升,并在真实操作任务中优于现有视觉跟踪器。

📝 摘要(中文)

本文提出了一种新的视觉-触觉融合的6D物体姿态跟踪方法,旨在解决仅依赖视觉信息在复杂操作任务中鲁棒性不足的问题。受人类多感官融合的启发,该方法利用视觉和触觉信息进行物体姿态估计。为了解决不同夹爪、传感器布局以及模拟到真实环境泛化性差的问题,本文引入了一种统一的触觉表示方法,并构建了一个基于Transformer的视觉-触觉物体姿态跟踪器,能够无缝集成视觉和触觉输入。在自建数据集和Feelsight数据集上的实验结果表明,该方法在具有挑战性的序列上表现出显著的性能提升,并在新的物体、传感器类型和夹爪上具有更好的泛化性和鲁棒性。真实世界的实验表明,该方法优于最先进的视觉跟踪器,并可以通过将实时物体跟踪结果融入运动规划中,实现精确的操作任务。

🔬 方法详解

问题定义:现有基于视觉和触觉的物体姿态估计方法在真实场景中表现不佳,主要痛点在于对不同夹爪、传感器布局的泛化能力不足,以及模拟到真实环境的迁移困难。此外,现有方法通常独立估计每一帧的物体姿态,缺乏时间上的连贯性,导致跟踪效果不稳定。

核心思路:本文的核心思路是利用Transformer架构,将视觉和触觉信息进行有效融合,并引入一种统一的触觉表示方法,以提高模型对不同夹爪和传感器类型的泛化能力。通过Transformer的自注意力机制,模型可以学习到视觉和触觉特征之间的复杂关系,从而更准确地估计物体姿态。

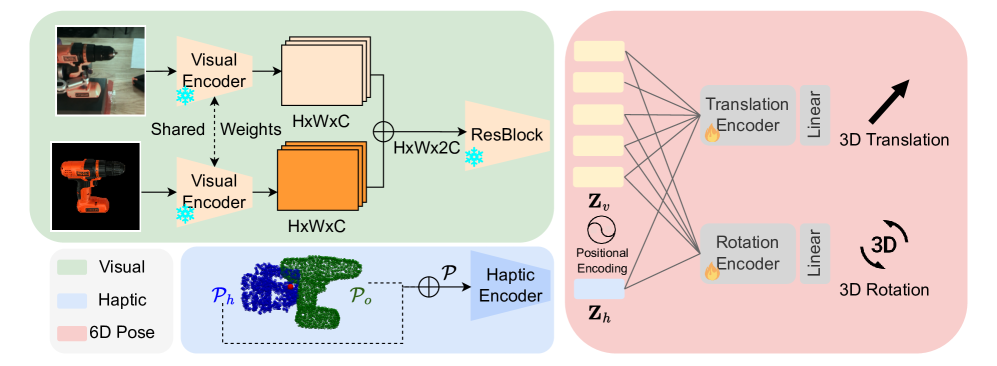

技术框架:该方法主要包含以下几个模块:1) 视觉特征提取模块,用于提取图像中的视觉特征;2) 触觉特征提取模块,用于提取触觉传感器的触觉信息;3) 统一触觉表示模块,将不同类型的触觉传感器数据转换为统一的表示形式;4) 基于Transformer的融合模块,将视觉和触觉特征进行融合,并预测物体姿态;5) 姿态跟踪模块,利用卡尔曼滤波等方法对物体姿态进行平滑处理,提高跟踪的稳定性。

关键创新:该方法最重要的技术创新点在于提出了一种统一的触觉表示方法,能够有效地处理来自不同类型触觉传感器的数据,从而提高了模型对不同夹爪和传感器类型的泛化能力。此外,利用Transformer架构进行视觉和触觉信息的融合,能够更好地学习到两种模态之间的关系,从而提高姿态估计的准确性。与现有方法相比,该方法能够更好地处理真实场景中的复杂情况,并具有更强的鲁棒性和泛化能力。

关键设计:在统一触觉表示方面,具体实现方式未知,论文中可能使用了某种嵌入方法或者特征工程手段。Transformer的具体结构未知,可能采用了标准的Transformer encoder-decoder结构,或者针对视觉-触觉融合任务进行了定制化的修改。损失函数的设计未知,可能包括姿态估计的回归损失和分类损失,以及一些正则化项,以提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在自建数据集和Feelsight数据集上均取得了显著的性能提升。在具有挑战性的序列上,该方法优于现有的视觉跟踪器,并在新的物体、传感器类型和夹爪上具有更好的泛化性和鲁棒性。在真实世界的实验中,该方法能够实现精确的操作任务,验证了视觉-触觉融合在机器人操作中的优势。

🎯 应用场景

该研究成果可应用于机器人操作、自动化装配、医疗手术等领域。通过结合视觉和触觉信息,机器人可以更准确地感知周围环境,从而完成更复杂、更精细的操作任务。例如,在自动化装配线上,机器人可以利用该方法准确地抓取和装配零件;在医疗手术中,医生可以通过触觉反馈更精确地控制手术器械。

📄 摘要(原文)

Humans naturally integrate vision and haptics for robust object perception during manipulation. The loss of either modality significantly degrades performance. Inspired by this multisensory integration, prior object pose estimation research has attempted to combine visual and haptic/tactile feedback. Although these works demonstrate improvements in controlled environments or synthetic datasets, they often underperform vision-only approaches in real-world settings due to poor generalization across diverse grippers, sensor layouts, or sim-to-real environments. Furthermore, they typically estimate the object pose for each frame independently, resulting in less coherent tracking over sequences in real-world deployments. To address these limitations, we introduce a novel unified haptic representation that effectively handles multiple gripper embodiments. Building on this representation, we introduce a new visuo-haptic transformer-based object pose tracker that seamlessly integrates visual and haptic input. We validate our framework in our dataset and the Feelsight dataset, demonstrating significant performance improvement on challenging sequences. Notably, our method achieves superior generalization and robustness across novel embodiments, objects, and sensor types (both taxel-based and vision-based tactile sensors). In real-world experiments, we demonstrate that our approach outperforms state-of-the-art visual trackers by a large margin. We further show that we can achieve precise manipulation tasks by incorporating our real-time object tracking result into motion plans, underscoring the advantages of visuo-haptic perception. Project website: https://ivl.cs.brown.edu/research/v-hop