Learning Dexterous Bimanual Catch Skills through Adversarial-Cooperative Heterogeneous-Agent Reinforcement Learning

作者: Taewoo Kim, Youngwoo Yoon, Jaehong Kim

分类: cs.RO, cs.AI

发布日期: 2025-02-17

备注: ICRA 2025 Accepted

💡 一句话要点

提出对抗-合作异构智能体强化学习框架,提升灵巧双臂抓取能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 双臂抓取 强化学习 异构智能体 对抗学习 机器人控制

📋 核心要点

- 单手抓取系统在处理大型或复杂物体时存在局限性,而双臂抓取在灵活性和物体处理方面具有显著潜力,但也带来了协调和控制方面的新挑战。

- 论文提出一种对抗-合作的异构智能体强化学习框架,通过投掷智能体增加难度,抓取智能体学习双手协调,从而提升双臂抓取技能。

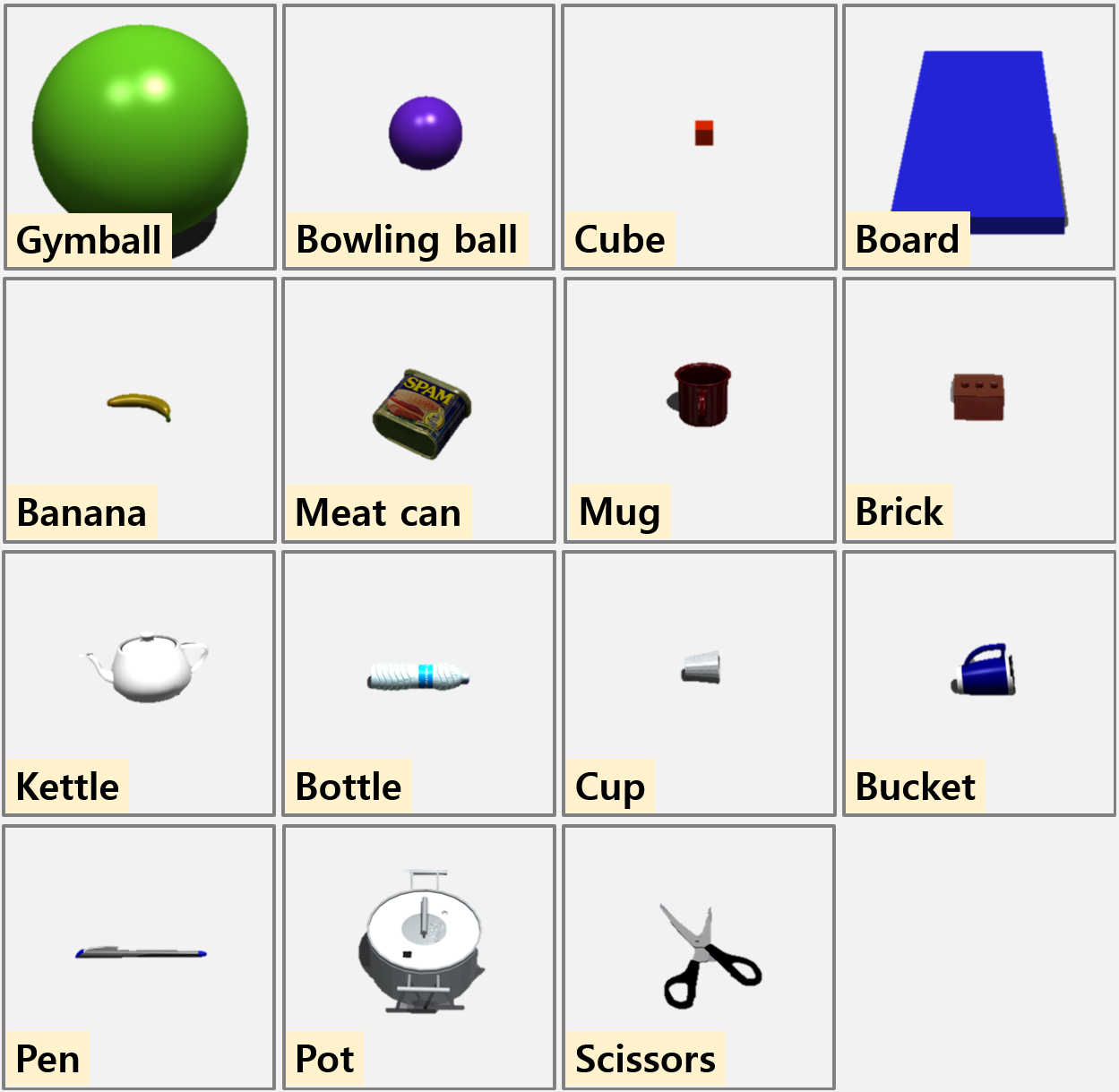

- 在模拟环境中,使用15种不同物体进行评估,结果表明该方法具有鲁棒性和通用性,抓取奖励相比单智能体基线提升约2倍。

📝 摘要(中文)

本文提出了一种新颖的框架,利用异构智能体强化学习(HARL)来学习灵巧的双臂抓取技能。该方法引入了一种对抗性奖励机制,其中投掷智能体通过调整速度来增加投掷的难度,而抓取智能体学习协调双手,在不断变化的条件下抓取物体。我们在模拟环境中评估了该框架,使用了15种不同的物体,证明了其在处理各种物体时的鲁棒性和通用性。与单智能体基线相比,我们的方法在15种不同的物体上实现了大约2倍的抓取奖励提升。

🔬 方法详解

问题定义:论文旨在解决机器人双臂灵巧抓取问题。现有单臂抓取系统难以处理较大或复杂的物体,而双臂抓取虽然潜力巨大,但其协调控制非常复杂,现有的强化学习方法难以有效训练出鲁棒的双臂抓取策略。

核心思路:论文的核心思路是利用对抗性训练的思想,设计一个异构智能体强化学习框架。其中,一个智能体(投掷智能体)负责生成具有挑战性的投掷轨迹,另一个智能体(抓取智能体)负责学习如何在这种动态变化的环境下进行双臂抓取。通过这种对抗训练,抓取智能体能够学习到更鲁棒、更适应性强的抓取策略。

技术框架:整体框架包含两个智能体:投掷智能体和抓取智能体。投掷智能体通过强化学习不断调整投掷速度等参数,以最大化抓取智能体的抓取难度。抓取智能体也通过强化学习,学习如何协调双手,在不同速度和轨迹下成功抓取物体。两个智能体在一个循环中不断迭代训练,最终提高抓取智能体的抓取能力。

关键创新:该方法最重要的创新点在于引入了对抗性奖励机制,将抓取任务建模成一个双智能体的对抗博弈过程。这种对抗训练的方式能够有效地探索抓取策略空间,使抓取智能体能够学习到更鲁棒的策略,从而更好地适应不同的物体和投掷条件。

关键设计:论文中,投掷智能体的目标是最大化抓取智能体的负奖励,而抓取智能体的目标是最大化抓取奖励。奖励函数的设计至关重要,需要平衡抓取的成功率和抓取的难度。具体的网络结构和参数设置在论文中进行了详细描述,但具体数值未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在模拟环境中取得了显著的性能提升。与单智能体基线相比,该方法在15种不同的物体上实现了大约2倍的抓取奖励提升,证明了其在处理各种物体时的鲁棒性和通用性。这些结果表明,对抗-合作的异构智能体强化学习框架能够有效地学习灵巧的双臂抓取技能。

🎯 应用场景

该研究成果可应用于工业自动化、物流分拣、医疗康复等领域。例如,在工业自动化中,双臂机器人可以用于抓取和组装各种形状和大小的零件;在物流分拣中,可以用于快速准确地分拣包裹;在医疗康复中,可以辅助患者进行精细动作训练。该研究为开发更智能、更灵活的机器人系统奠定了基础。

📄 摘要(原文)

Robotic catching has traditionally focused on single-handed systems, which are limited in their ability to handle larger or more complex objects. In contrast, bimanual catching offers significant potential for improved dexterity and object handling but introduces new challenges in coordination and control. In this paper, we propose a novel framework for learning dexterous bimanual catching skills using Heterogeneous-Agent Reinforcement Learning (HARL). Our approach introduces an adversarial reward scheme, where a throw agent increases the difficulty of throws-adjusting speed-while a catch agent learns to coordinate both hands to catch objects under these evolving conditions. We evaluate the framework in simulated environments using 15 different objects, demonstrating robustness and versatility in handling diverse objects. Our method achieved approximately a 2x increase in catching reward compared to single-agent baselines across 15 diverse objects.