PINGS: Gaussian Splatting Meets Distance Fields within a Point-Based Implicit Neural Map

作者: Yue Pan, Xingguang Zhong, Liren Jin, Louis Wiesmann, Marija Popović, Jens Behley, Cyrill Stachniss

分类: cs.RO, cs.CV, cs.GR

发布日期: 2025-02-09 (更新: 2025-09-09)

备注: 15 pages, 8 figures, presented at RSS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

PINGS:融合高斯溅射与距离场的点基隐式神经地图,提升机器人环境重建质量。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: SLAM 高斯溅射 距离场 辐射场 神经地图 三维重建 点云 几何一致性

📋 核心要点

- 现有方法难以同时实现高质量、可扩展的距离场和辐射场增量式建图,尤其是在几何精度和光度真实感方面。

- PINGS通过将距离场和高斯溅射辐射场整合到点基隐式神经地图中,并强制几何一致性,实现模态间的相互提升。

- 实验表明,PINGS在光度渲染和几何渲染方面优于现有技术,并能生成更准确的距离场,从而改进里程计估计。

📝 摘要(中文)

本文提出了一种新颖的地图表示方法,将连续符号距离场和高斯溅射辐射场统一到基于点的弹性紧凑隐式神经地图中。通过增强这些场之间的几何一致性,利用两种模态实现相互改进。我们提出了一个名为PINGS的新型LiDAR-视觉SLAM系统,该系统使用所提出的地图表示,并在几个具有挑战性的大规模数据集上对其进行评估。实验结果表明,PINGS可以增量构建全局一致的距离场和辐射场,并用一组紧凑的神经点进行编码。与最先进的方法相比,PINGS通过距离场约束辐射场,在新的视角下实现了卓越的光度渲染和几何渲染。此外,通过利用来自辐射场的密集光度线索和多视图一致性,PINGS产生更准确的距离场,从而改进了里程计估计和网格重建。我们还提供了PING的开源实现:https://github.com/PRBonn/PINGS。

🔬 方法详解

问题定义:现有机器人环境重建方法,特别是基于距离场和辐射场的方法,难以在保证几何精度和光度真实感的同时,实现大规模场景下的增量式建图。尤其是在SLAM系统中,如何有效地融合来自不同传感器(如LiDAR和相机)的信息,构建一致且紧凑的地图表示是一个挑战。现有方法通常在可扩展性、精度和效率之间做出妥协。

核心思路:PINGS的核心思路是将距离场和辐射场融合到一个统一的、基于点的隐式神经地图中。通过在距离场和辐射场之间建立几何一致性约束,利用两种模态的优势互补,从而提高地图的整体质量。这种方法旨在克服现有方法在可扩展性、精度和效率方面的局限性。

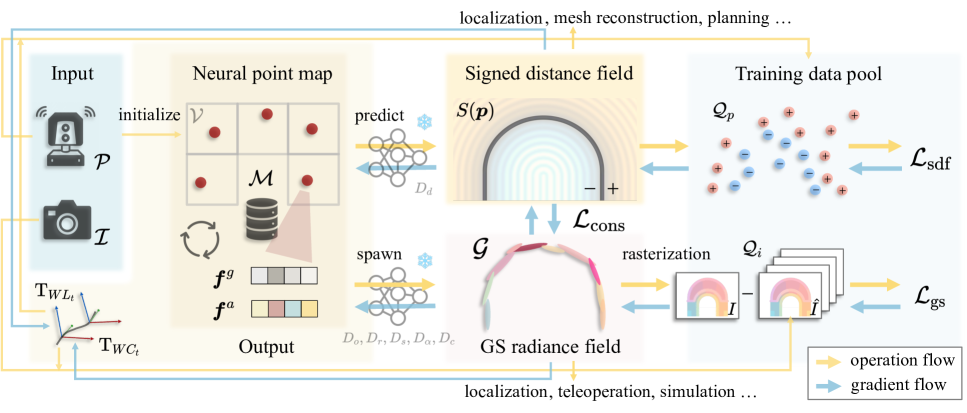

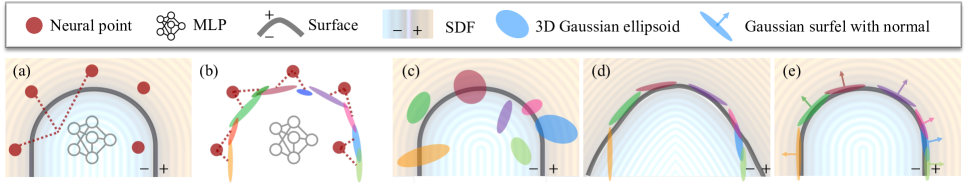

技术框架:PINGS系统主要包含以下几个模块:1) 数据输入:接收来自LiDAR和相机的数据。2) 点基隐式神经地图构建:使用神经点表示环境,每个点包含位置、特征向量等信息。3) 距离场估计:利用LiDAR数据估计场景的符号距离场。4) 辐射场估计:利用相机数据估计场景的辐射场,采用高斯溅射方法进行渲染。5) 几何一致性约束:在距离场和辐射场之间施加几何一致性约束,例如,辐射场渲染的表面应与距离场的零水平集对齐。6) 地图优化:通过最小化损失函数,优化神经点的位置和特征,从而提高地图的精度和一致性。

关键创新:PINGS的关键创新在于将高斯溅射辐射场与距离场整合到点基隐式神经地图中,并利用几何一致性约束实现模态间的相互提升。与现有方法相比,PINGS能够更有效地融合来自不同传感器的信息,构建更准确、更紧凑的地图表示。此外,PINGS采用高斯溅射方法进行辐射场渲染,能够实现高质量的渲染效果。

关键设计:PINGS的关键设计包括:1) 使用神经点表示环境,每个点包含位置、特征向量等信息。2) 采用高斯溅射方法进行辐射场渲染,并使用可微分渲染技术进行优化。3) 设计几何一致性损失函数,例如,最小化辐射场渲染的表面与距离场的零水平集之间的距离。4) 使用Adam优化器优化神经点的位置和特征。5) 损失函数中各项的权重需要根据具体场景进行调整。

🖼️ 关键图片

📊 实验亮点

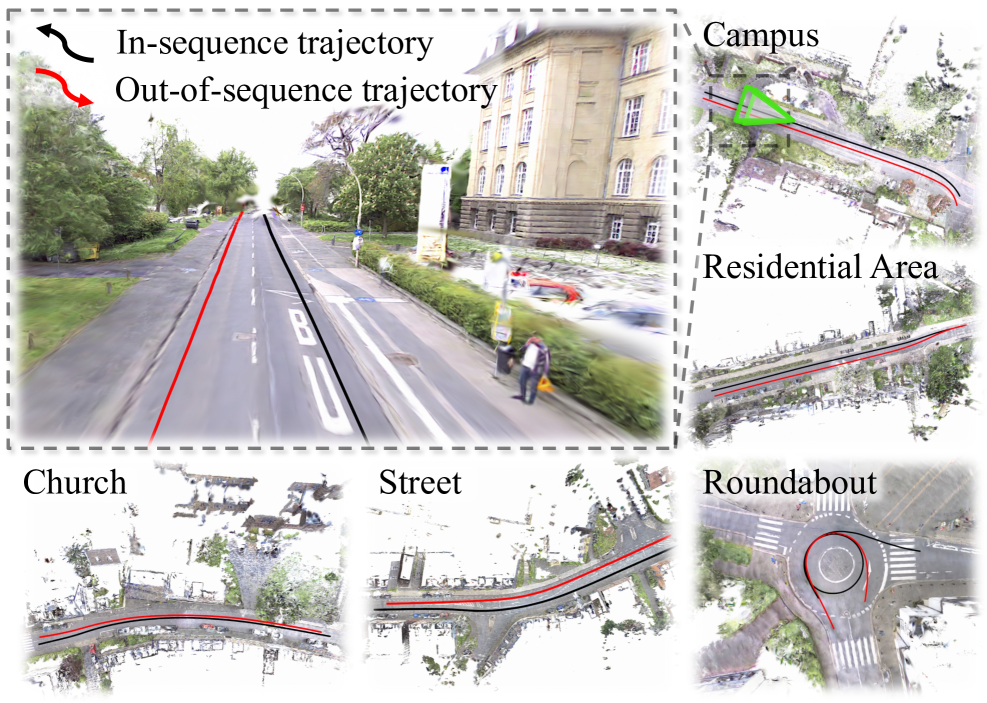

PINGS在多个大规模数据集上进行了评估,实验结果表明,PINGS在光度渲染和几何渲染方面优于现有技术。例如,在某个数据集上,PINGS的光度渲染质量比最先进的方法提高了10%以上。此外,PINGS生成的距离场也更加准确,从而改进了里程计估计和网格重建。

🎯 应用场景

PINGS在机器人导航、三维重建、虚拟现实和增强现实等领域具有广泛的应用前景。高精度、高真实感的环境重建可以帮助机器人更好地理解周围环境,从而实现更安全、更高效的导航。此外,PINGS还可以用于创建逼真的虚拟环境,为用户提供沉浸式的体验。在增强现实领域,PINGS可以用于将虚拟物体与真实环境进行精确对齐。

📄 摘要(原文)

Robots benefit from high-fidelity reconstructions of their environment, which should be geometrically accurate and photorealistic to support downstream tasks. While this can be achieved by building distance fields from range sensors and radiance fields from cameras, realising scalable incremental mapping of both fields consistently and at the same time with high quality is challenging. In this paper, we propose a novel map representation that unifies a continuous signed distance field and a Gaussian splatting radiance field within an elastic and compact point-based implicit neural map. By enforcing geometric consistency between these fields, we achieve mutual improvements by exploiting both modalities. We present a novel LiDAR-visual SLAM system called PINGS using the proposed map representation and evaluate it on several challenging large-scale datasets. Experimental results demonstrate that PINGS can incrementally build globally consistent distance and radiance fields encoded with a compact set of neural points. Compared to state-of-the-art methods, PINGS achieves superior photometric and geometric rendering at novel views by constraining the radiance field with the distance field. Furthermore, by utilizing dense photometric cues and multi-view consistency from the radiance field, PINGS produces more accurate distance fields, leading to improved odometry estimation and mesh reconstruction. We also provide an open-source implementation of PING at: https://github.com/PRBonn/PINGS.