HiLo: Learning Whole-Body Human-like Locomotion with Motion Tracking Controller

作者: Qiyuan Zhang, Chenfan Weng, Guanwu Li, Fulai He, Yusheng Cai

分类: cs.RO

发布日期: 2025-02-05

💡 一句话要点

HiLo:基于运动跟踪控制器的全身人形机器人拟人运动学习

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 人形机器人 强化学习 运动控制 运动跟踪 领域随机化

📋 核心要点

- 现有强化学习人形机器人控制器缺乏自然和敏捷的运动模式,难以应用于以人为中心的场景。

- HiLo框架通过RL运动跟踪控制器和简化的领域随机化,克服了复杂奖励工程和领域随机化问题。

- 实验表明,HiLo训练的控制器能实现自然敏捷的类人运动,并对外部干扰具有鲁棒性,且能快速调整运动模式。

📝 摘要(中文)

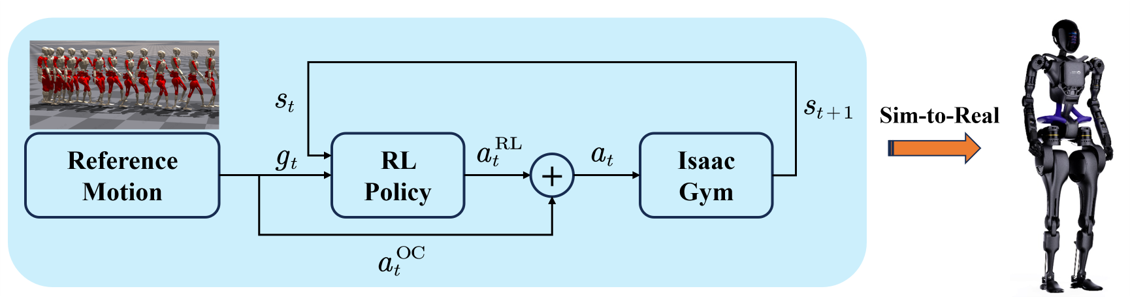

深度强化学习(RL)已成为开发人形机器人运动控制器的有前景的方法。尽管先前的RL控制器展示了鲁棒和稳定的运动,但它们的行为通常缺乏以人为中心的场景所需的自然和敏捷的运动模式。本文提出了HiLo(human-like locomotion with motion tracking),一个旨在学习执行类人运动的RL策略的有效框架。类人运动的主要挑战是复杂的奖励工程和领域随机化。HiLo通过开发基于RL的运动跟踪控制器和通过随机力注入和动作延迟实现的简单领域随机化来克服这些问题。在HiLo框架内,全身控制问题可以分解为两个部分:一部分使用开环控制方法解决,而剩余部分则使用RL策略解决。还实现了一个分布值函数,通过改进对扰动动力学下累积奖励的估计来稳定训练过程。实验表明,使用HiLo训练的运动跟踪控制器可以执行自然而敏捷的类人运动,同时在真实世界的系统中表现出对外部干扰的弹性。此外,我们表明,人形机器人的运动模式可以通过残差机制进行调整,而无需进行微调,从而可以快速调整任务要求。

🔬 方法详解

问题定义:论文旨在解决人形机器人运动控制中,现有强化学习方法生成的运动不够自然、敏捷,难以适应以人为中心的复杂场景的问题。现有方法在奖励函数设计和领域随机化方面存在挑战,导致训练出的策略泛化能力不足,难以在真实环境中应用。

核心思路:论文的核心思路是将全身控制问题分解为两部分:一部分使用开环控制方法,另一部分使用强化学习策略。通过运动跟踪控制器学习模仿人类运动,并利用残差机制进行微调,从而实现自然、敏捷且适应性强的运动控制。

技术框架:HiLo框架包含以下主要模块:1) 运动跟踪控制器:使用强化学习训练,目标是模仿人类运动数据。2) 开环控制器:处理一部分控制任务,例如维持平衡。3) 残差控制:强化学习策略学习控制器的残差部分,用于调整和优化整体运动。4) 领域随机化:通过随机力注入和动作延迟来增强策略的鲁棒性。5) 分布式价值函数:用于稳定训练过程,提高累积奖励的估计精度。

关键创新:论文的关键创新在于将全身控制问题分解为开环控制和残差控制两部分,并使用强化学习训练运动跟踪控制器。这种分解方式简化了奖励函数的设计,并提高了策略的泛化能力。此外,使用分布式价值函数稳定了训练过程。

关键设计:论文使用基于Actor-Critic的强化学习算法训练运动跟踪控制器。奖励函数的设计包括模仿人类运动的奖励、平衡奖励和能量消耗惩罚。领域随机化通过随机改变机器人的质量、摩擦系数和环境参数来实现。分布式价值函数使用C51算法进行实现,将价值分布离散化为多个原子,并学习每个原子的概率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HiLo框架训练的运动跟踪控制器能够生成自然、敏捷的类人运动,并且对外部干扰具有较强的鲁棒性。与传统的强化学习方法相比,HiLo在运动质量和泛化能力方面均有显著提升。此外,通过残差机制,可以快速调整机器人的运动模式,适应不同的任务需求。

🎯 应用场景

该研究成果可应用于人形机器人在复杂环境中的运动控制,例如家庭服务、医疗辅助、灾难救援等。通过学习人类运动模式,机器人可以更自然、安全地与人类互动,完成各种任务。此外,该方法还可以应用于虚拟角色的动画制作,提高动画的真实感和表现力。

📄 摘要(原文)

Deep Reinforcement Learning (RL) has emerged as a promising method to develop humanoid robot locomotion controllers. Despite the robust and stable locomotion demonstrated by previous RL controllers, their behavior often lacks the natural and agile motion patterns necessary for human-centric scenarios. In this work, we propose HiLo (human-like locomotion with motion tracking), an effective framework designed to learn RL policies that perform human-like locomotion. The primary challenges of human-like locomotion are complex reward engineering and domain randomization. HiLo overcomes these issues by developing an RL-based motion tracking controller and simple domain randomization through random force injection and action delay. Within the framework of HiLo, the whole-body control problem can be decomposed into two components: One part is solved using an open-loop control method, while the residual part is addressed with RL policies. A distributional value function is also implemented to stabilize the training process by improving the estimation of cumulative rewards under perturbed dynamics. Our experiments demonstrate that the motion tracking controller trained using HiLo can perform natural and agile human-like locomotion while exhibiting resilience to external disturbances in real-world systems. Furthermore, we show that the motion patterns of humanoid robots can be adapted through the residual mechanism without fine-tuning, allowing quick adjustments to task requirements.