Differentiable Composite Neural Signed Distance Fields for Robot Navigation in Dynamic Indoor Environments

作者: S. Talha Bukhari, Daniel Lawson, Ahmed H. Qureshi

分类: cs.RO

发布日期: 2025-02-04 (更新: 2025-03-06)

💡 一句话要点

提出可微组合神经SDF,用于动态室内环境机器人导航

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人导航 神经符号距离场 动态环境 轨迹优化 环境表示

📋 核心要点

- 现有神经SDF方法在动态环境中更新需要重新训练,计算成本高,不适用于实时机器人导航。

- 论文提出一种组合神经SDF框架,通过对齐和组合场景组成部分的SDF表示,实现动态环境下的快速更新。

- 实验表明,该方法在iGibson 2.0中导航成功率达到98%,比基线提升14.4%,并在真实场景中验证了有效性。

📝 摘要(中文)

神经符号距离场(SDFs)提供了一种可微的环境表示,可以方便地获得碰撞检查和明确定义的梯度,用于机器人导航任务。然而,随着场景的演变更新神经SDFs需要重新训练,这是繁琐、耗时和低效的,使其不适合在动态环境中视野有限的机器人导航。为了实现这一目标,我们提出了一个神经SDFs的组合框架,仅使用板载RGB-D传感器来解决室内环境中的机器人导航问题。我们的框架包含一个用于轨迹优化的双模程序,不同的模式使用互补的方法来建模碰撞成本和避碰梯度。主要阶段在障碍物点云处查询沿目标路线扫过的机器人本体的SDF,从而能够快速局部优化轨迹。第二阶段通过对齐和组合其组成部分的SDF表示来推断可见场景的SDF,从而为轨迹优化提供更好的成本和梯度。双模程序结合了两个阶段的优点,在iGibson 2.0上实现了98%的成功率,比基线高14.4%,且具有相当的摊销计划时间。我们还在实际室内场景中证明了其有效性。

🔬 方法详解

问题定义:论文旨在解决动态室内环境中机器人导航的问题。现有的神经SDF方法虽然能提供可微的环境表示,但当环境发生变化时,需要重新训练整个网络,这在计算上是昂贵的,并且不适用于需要快速响应的动态环境。尤其是在机器人视野有限的情况下,无法一次性获取完整的环境信息,使得重新训练变得更加频繁和低效。

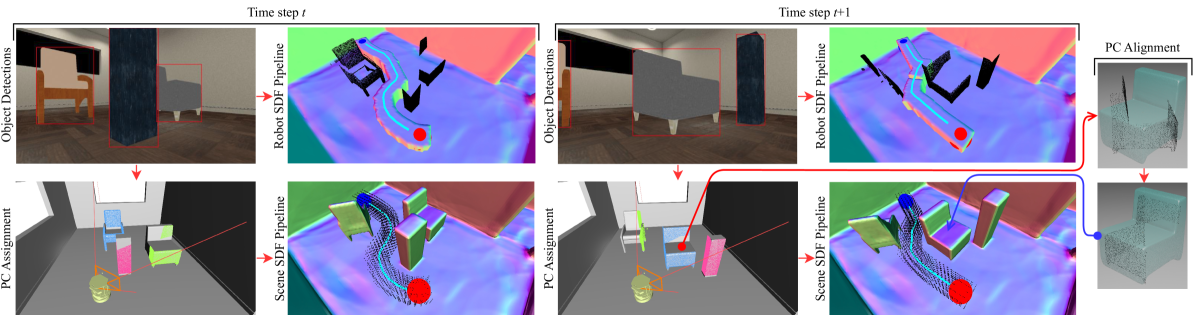

核心思路:论文的核心思路是将整个场景的SDF表示分解为多个组成部分的SDF表示,然后通过对齐和组合这些组成部分的SDF来构建整个场景的SDF。这样,当场景发生变化时,只需要更新发生变化的组成部分的SDF,而不需要重新训练整个网络。这种组合的方式能够显著提高更新效率,从而适用于动态环境下的机器人导航。

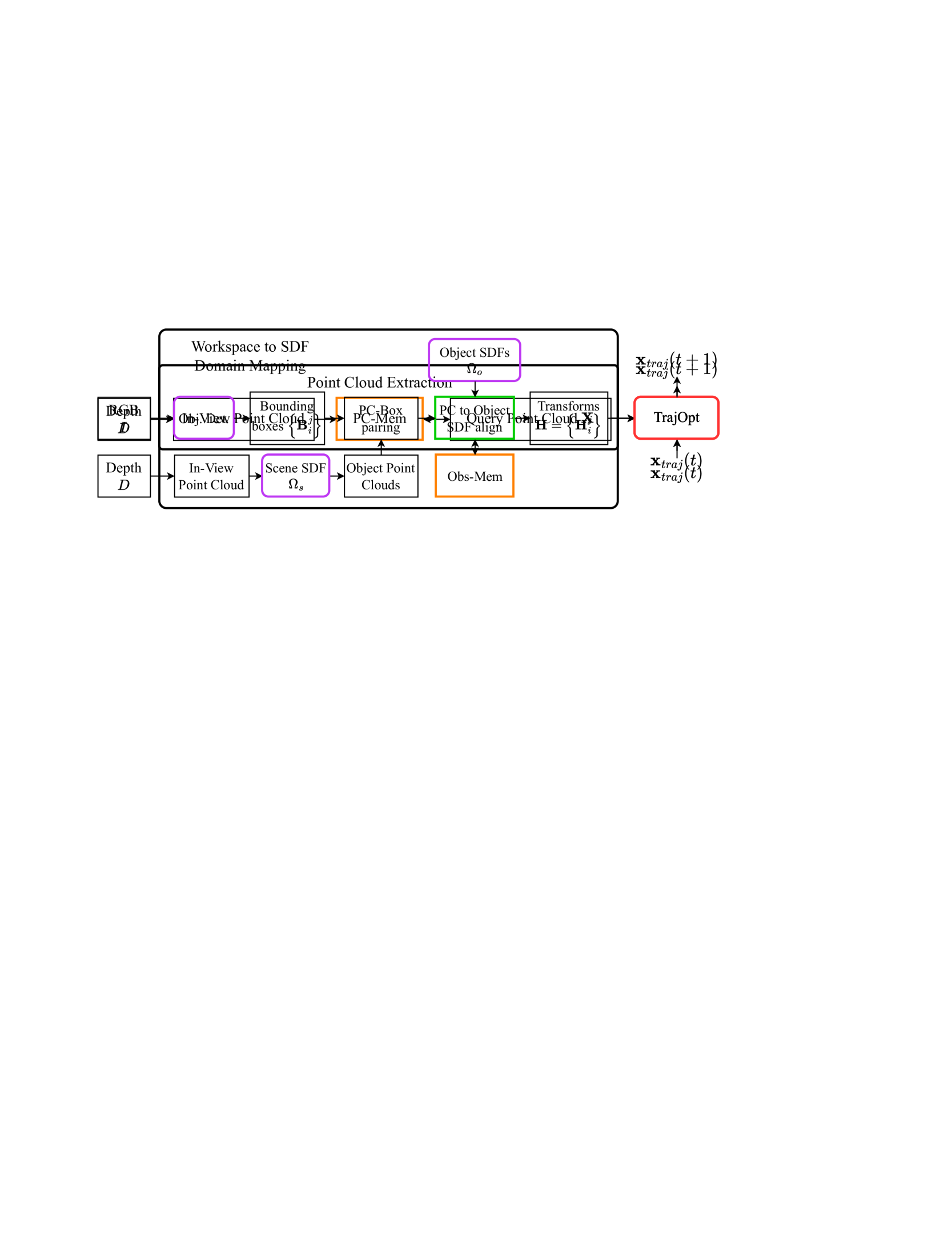

技术框架:该框架包含一个双模轨迹优化程序。第一阶段,利用机器人本体的SDF在障碍物点云处进行查询,实现轨迹的快速局部优化。第二阶段,通过对齐和组合可见场景中各个组成部分的SDF表示,推断出整个可见场景的SDF,从而为轨迹优化提供更准确的成本和梯度信息。这两个阶段相互补充,共同完成轨迹优化任务。

关键创新:该论文的关键创新在于提出了可微分的组合神经SDF,它允许在动态环境中快速更新环境表示,而无需重新训练整个网络。这种组合的方式使得SDF能够适应环境的变化,从而提高了机器人导航的效率和鲁棒性。

关键设计:该框架的关键设计包括:1) 使用神经SDF来表示环境,从而获得可微的碰撞成本和梯度;2) 采用双模轨迹优化程序,结合了局部快速优化和全局精确优化的优点;3) 通过对齐和组合场景组成部分的SDF表示,实现动态环境下的快速更新。具体的网络结构和损失函数等细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在iGibson 2.0模拟环境中实现了98%的导航成功率,相比于基线方法提高了14.4%。同时,该方法在摊销计划时间上与基线方法相当,表明其在保证导航性能的同时,具有较高的计算效率。此外,该方法还在真实室内场景中进行了验证,证明了其在实际应用中的有效性。

🎯 应用场景

该研究成果可应用于各种需要在动态室内环境中进行导航的机器人,例如服务机器人、清洁机器人、巡逻机器人等。通过快速更新环境表示,机器人能够更好地适应环境变化,提高导航的效率和安全性。此外,该方法还可以扩展到其他需要实时环境感知的应用领域,例如增强现实、虚拟现实等。

📄 摘要(原文)

Neural Signed Distance Fields (SDFs) provide a differentiable environment representation to readily obtain collision checks and well-defined gradients for robot navigation tasks. However, updating neural SDFs as the scene evolves entails re-training, which is tedious, time consuming, and inefficient, making it unsuitable for robot navigation with limited field-of-view in dynamic environments. Towards this objective, we propose a compositional framework of neural SDFs to solve robot navigation in indoor environments using only an onboard RGB-D sensor. Our framework embodies a dual mode procedure for trajectory optimization, with different modes using complementary methods of modeling collision costs and collision avoidance gradients. The primary stage queries the robot body's SDF, swept along the route to goal, at the obstacle point cloud, enabling swift local optimization of trajectories. The secondary stage infers the visible scene's SDF by aligning and composing the SDF representations of its constituents, providing better informed costs and gradients for trajectory optimization. The dual mode procedure combines the best of both stages, achieving a success rate of 98%, 14.4% higher than baseline with comparable amortized plan time on iGibson 2.0. We also demonstrate its effectiveness in adapting to real-world indoor scenarios.