Real-Time Operator Takeover for Visuomotor Diffusion Policy Training

作者: Nils Ingelhag, Jesper Munkeby, Michael C. Welle, Marco Moletta, Danica Kragic

分类: cs.RO, cs.LG

发布日期: 2025-02-04 (更新: 2025-02-13)

💡 一句话要点

提出实时操作员接管方法,用于视觉运动扩散策略训练。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 实时操作员接管 视觉运动策略 扩散策略 马氏距离 人机协作

📋 核心要点

- 现有视觉运动策略训练方法在复杂任务中易出错,需要人工干预。

- 提出实时操作员接管(RTOT)框架,允许操作员无缝介入并纠正策略行为。

- 实验表明,RTOT显著提升策略性能,优于仅使用初始演示的训练方式。

📝 摘要(中文)

本文提出了一种实时操作员接管(RTOT)范式,使操作员能够无缝地控制实时的视觉运动扩散策略,引导系统回到期望的状态或强化特定的演示。我们提出了使用马氏距离自动识别不良状态的新见解。一旦操作员介入并重定向系统,控制权将无缝地返回给策略,该策略将继续生成动作,直到需要进一步干预。我们证明,与仅使用等量但更长的初始演示进行训练相比,结合有针对性的接管演示可以显著提高策略性能。我们深入分析了使用马氏距离检测异常状态,说明了其在执行期间识别关键故障点的效用。包括初始和接管演示视频以及所有舀米实验在内的支持材料可在项目网站上找到:https://operator-takeover.github.io/

🔬 方法详解

问题定义:现有的视觉运动策略,特别是扩散策略,在复杂任务中容易遇到意外情况或进入不良状态,导致任务失败。单纯依赖初始演示数据训练难以覆盖所有可能的状态空间,且长时间的自主探索可能效率低下。因此,如何有效地利用人工干预来指导策略学习,使其更快地适应复杂环境,是一个关键问题。

核心思路:本文的核心思路是允许操作员在策略执行过程中实时接管控制,当策略进入不良状态时,操作员可以介入并引导系统回到期望的状态。操作员的干预被视为额外的训练数据,用于改进策略。这种方法结合了自主探索和人工指导的优点,可以更有效地学习复杂的视觉运动策略。

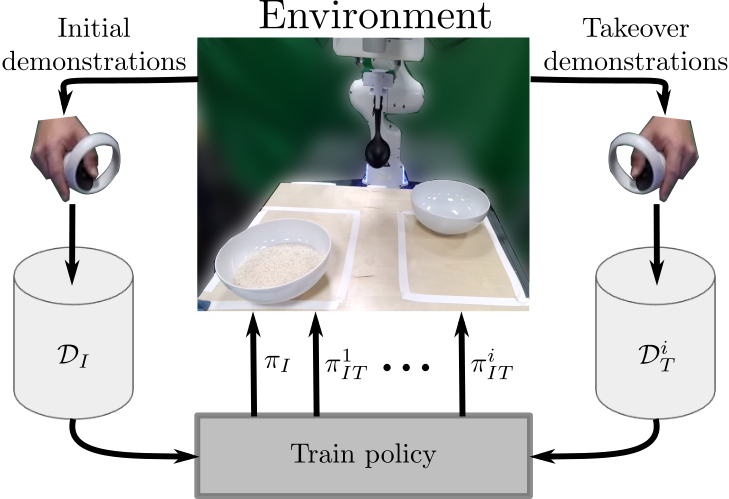

技术框架:RTOT框架包含以下几个主要模块:1) 视觉运动扩散策略:负责生成机器人的动作。2) 状态监测器:使用马氏距离来检测当前状态是否偏离正常状态分布。3) 操作员接管机制:当状态监测器检测到不良状态时,允许操作员接管控制。4) 数据记录与策略更新:记录操作员的干预数据,并将其用于更新扩散策略。整个流程是:策略自主执行 -> 状态监测 -> (若异常)操作员接管 -> 策略恢复 -> 数据记录与更新。

关键创新:该方法最重要的创新点在于实时操作员接管机制,它允许在策略执行过程中动态地引入人工指导。与传统的离线数据增强或模仿学习方法不同,RTOT能够根据策略的实际表现进行针对性的干预,从而更有效地利用人工指导。此外,使用马氏距离自动检测不良状态也减少了对人工干预的依赖。

关键设计:马氏距离被用于衡量当前状态与训练数据分布的偏离程度。具体来说,首先计算训练数据的均值和协方差矩阵,然后使用马氏距离公式计算当前状态与均值的距离。当马氏距离超过预设阈值时,系统判定当前状态为不良状态,并触发操作员接管。扩散策略的具体网络结构和训练细节(如损失函数、优化器等)未知,但RTOT框架可以与不同的扩散策略相结合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与仅使用初始演示数据训练的策略相比,结合RTOT的策略在舀米任务中表现出显著的性能提升。具体来说,使用RTOT训练的策略能够更快地学会舀米,并且在面对干扰时表现出更强的鲁棒性。论文还分析了马氏距离在检测异常状态方面的有效性,结果表明马氏距离能够准确地识别出策略执行过程中的关键失败点。

🎯 应用场景

该研究成果可应用于各种需要机器人与环境交互的复杂任务,例如家庭服务机器人、工业装配、医疗手术等。通过实时操作员接管,机器人能够更快地适应新的环境和任务,提高任务完成的成功率和效率。此外,该方法还可以用于训练更安全可靠的自主系统,减少意外事故的发生。

📄 摘要(原文)

We present a Real-Time Operator Takeover (RTOT) paradigm enabling operators to seamlessly take control of a live visuomotor diffusion policy, guiding the system back into desirable states or reinforcing specific demonstrations. We present new insights in using the Mahalonobis distance to automatically identify undesirable states. Once the operator has intervened and redirected the system, the control is seamlessly returned to the policy, which resumes generating actions until further intervention is required. We demonstrate that incorporating the targeted takeover demonstrations significantly improves policy performance compared to training solely with an equivalent number of, but longer, initial demonstrations. We provide an in-depth analysis of using the Mahalanobis distance to detect out-of-distribution states, illustrating its utility for identifying critical failure points during execution. Supporting materials, including videos of initial and takeover demonstrations and all rice scooping experiments, are available on the project website: https://operator-takeover.github.io/