Digital Twin Synchronization: Bridging the Sim-RL Agent to a Real-Time Robotic Additive Manufacturing Control

作者: Matsive Ali, Sandesh Giri, Sen Liu, Qin Yang

分类: cs.RO, cs.AI, cs.LG, eess.SY

发布日期: 2025-01-29 (更新: 2025-06-09)

备注: This paper had been accepted by the 2025 IEEE International Conference on Engineering Reliable Autonomous Systems (ERAS)

💡 一句话要点

提出基于数字孪生与SAC的机器人增材制造实时自适应控制框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 数字孪生 强化学习 机器人控制 增材制造 SAC算法 迁移学习 ROS2

📋 核心要点

- 现有智能制造中,动态自适应控制机制在优化复杂流程方面仍有不足,深度强化学习的应用潜力尚未充分挖掘。

- 论文核心在于构建基于数字孪生的强化学习框架,利用Unity和ROS2实现模拟环境与真实机器人控制的无缝衔接。

- 实验表明,该方法在模拟和物理环境中均能实现快速策略收敛和稳健的任务执行,验证了其有效性。

📝 摘要(中文)

本研究旨在推进深度强化学习技术在工业机器人领域的应用,特别是在智能制造中动态自适应控制机制优化复杂流程方面。论文提出了一种将软演员-评论家(SAC)算法与数字孪生技术相结合的框架,用于增强智能增材制造过程的实时自适应控制。该系统架构结合了Unity的仿真环境和ROS2,实现了无缝的数字孪生同步。同时,利用迁移学习有效地将训练好的模型应用于不同的任务。通过Viper X300s机器人手臂,并结合提出的分层奖励结构,解决了强化学习中常见的挑战,并在两个不同的控制场景中验证了该方法的有效性。实验结果表明,在模拟和物理环境中,策略均能快速收敛并实现稳健的任务执行。

🔬 方法详解

问题定义:论文旨在解决智能增材制造过程中,机器人实时自适应控制的问题。现有方法难以应对复杂动态环境,缺乏有效的策略学习和迁移能力,导致控制精度和效率受限。

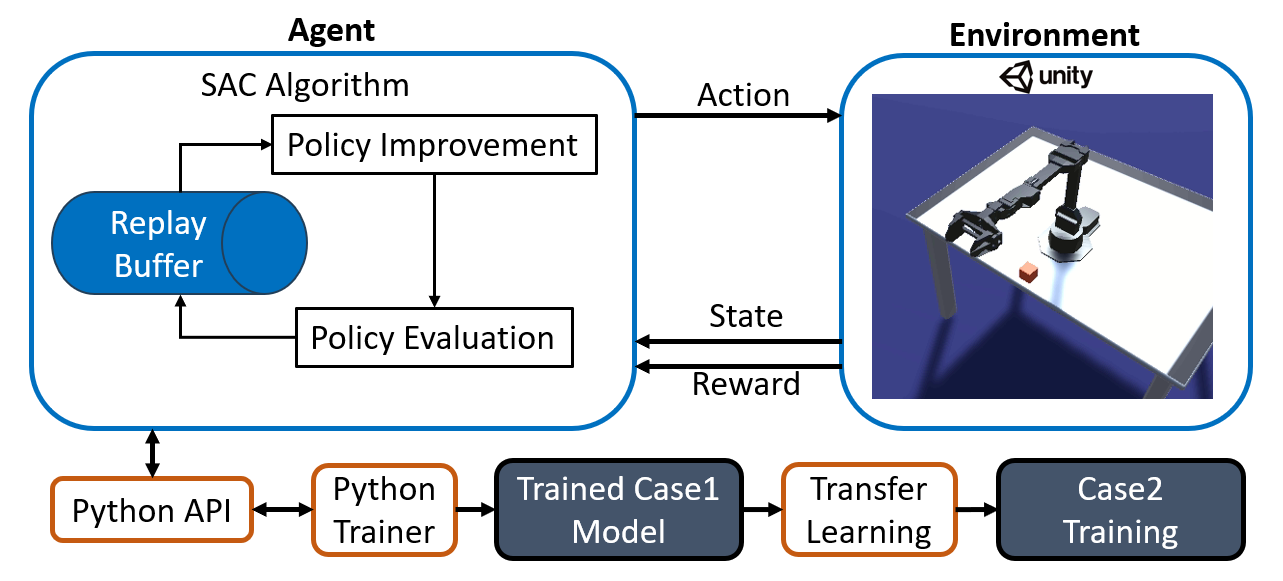

核心思路:论文的核心思路是利用数字孪生技术构建与真实机器人系统高度一致的虚拟环境,并在该环境中训练强化学习智能体。通过迁移学习,将训练好的策略迁移到真实机器人系统,实现实时自适应控制。数字孪生提供安全高效的训练环境,强化学习算法则负责学习最优控制策略。

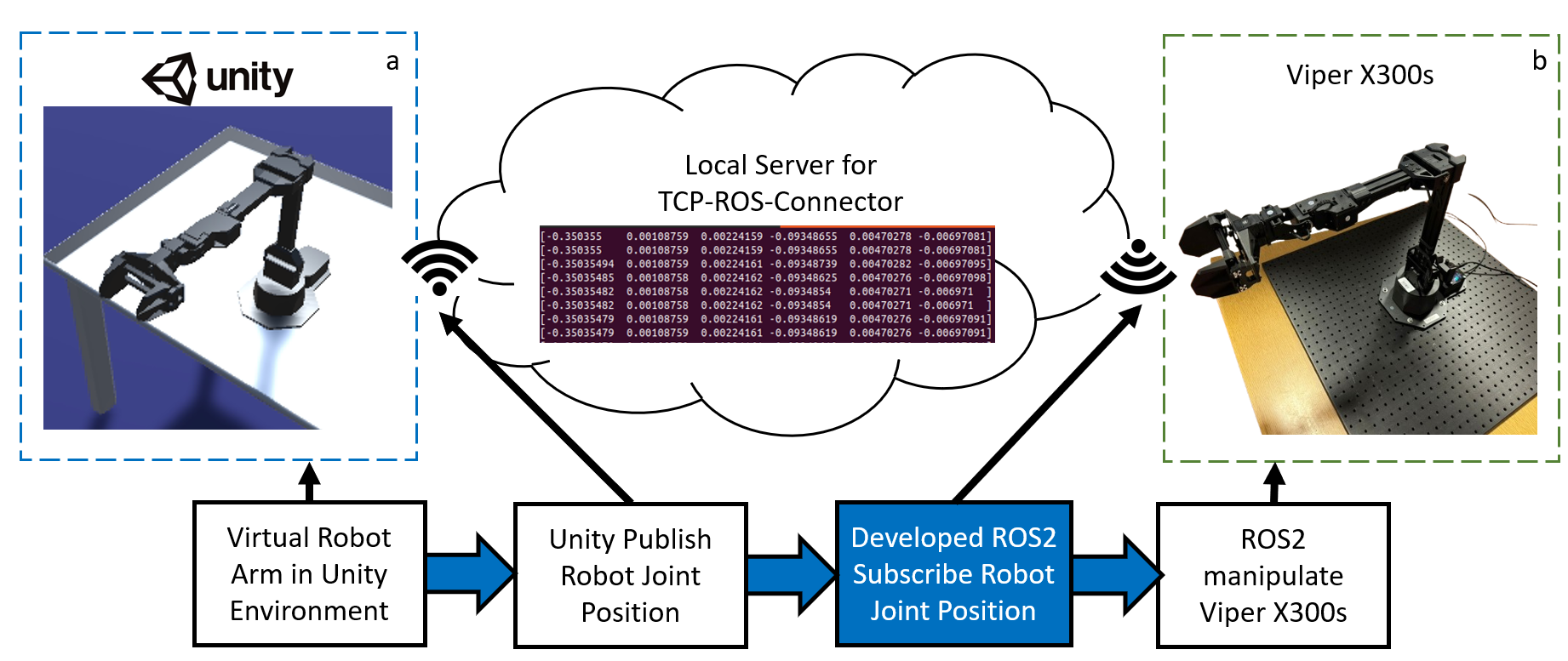

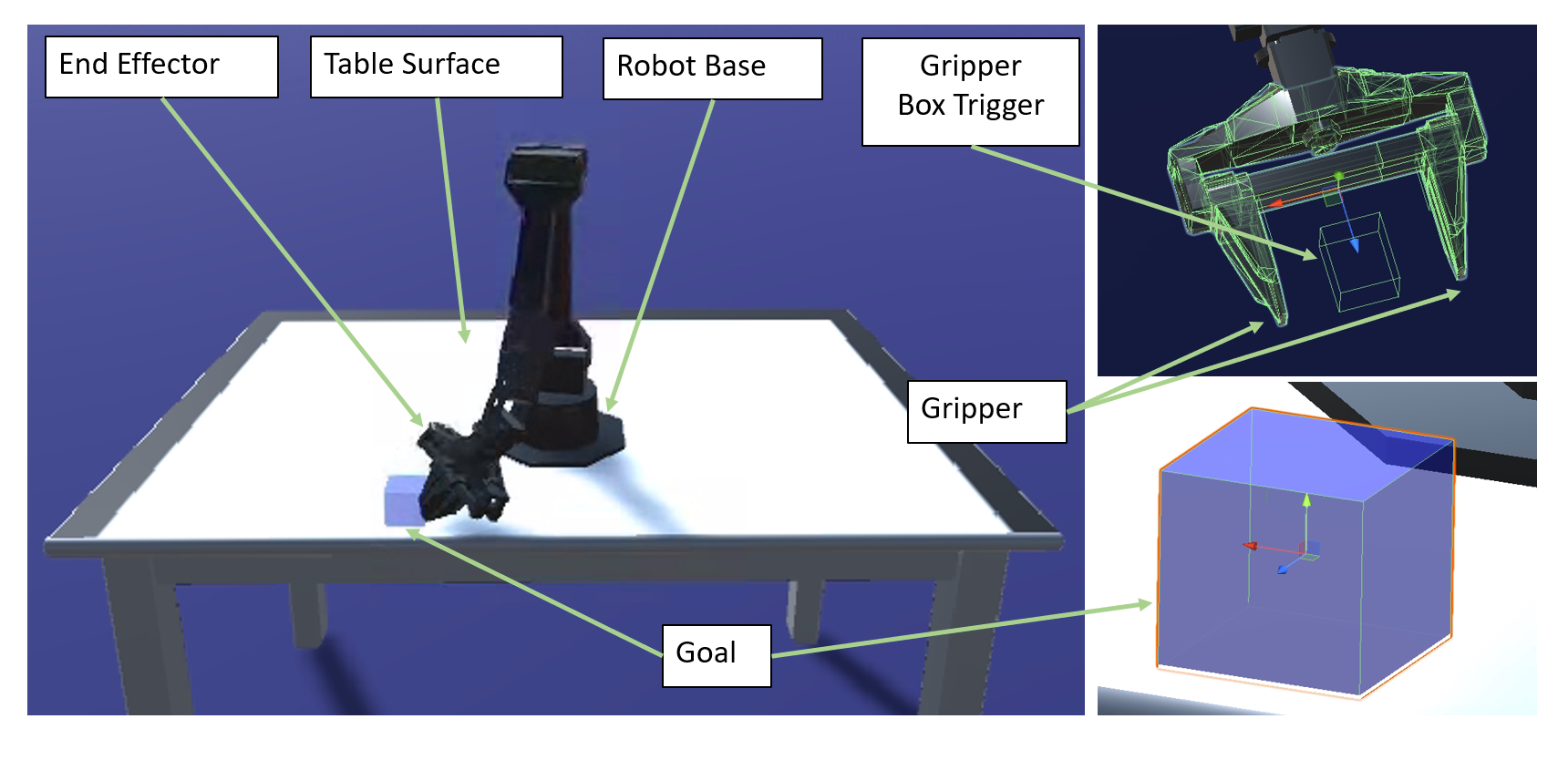

技术框架:整体架构包含三个主要模块:1) 基于Unity的数字孪生环境,模拟真实机器人和增材制造过程;2) 基于ROS2的机器人控制系统,负责与真实机器人进行通信和控制;3) 基于SAC算法的强化学习智能体,在数字孪生环境中学习控制策略。通过ROS2实现数字孪生环境与机器人控制系统的数据同步。

关键创新:论文的关键创新在于将数字孪生技术与SAC算法相结合,构建了一个完整的机器人增材制造实时自适应控制框架。该框架能够有效地解决强化学习在真实机器人系统中训练样本效率低、安全性差等问题。同时,利用迁移学习实现了策略从仿真环境到真实环境的有效迁移。

关键设计:论文采用分层奖励结构来引导强化学习智能体学习。具体来说,将任务分解为多个子任务,并为每个子任务设计相应的奖励函数。此外,论文还对SAC算法的超参数进行了优化,以提高策略学习的效率和稳定性。例如,探索温度参数的调整,以及Actor和Critic网络的结构设计。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的方法在模拟和物理环境中均能实现快速策略收敛和稳健的任务执行。具体来说,在两个不同的控制场景中,机器人手臂能够准确地完成预定的增材制造任务。与传统的控制方法相比,该方法能够显著提高控制精度和效率,并具有更强的鲁棒性和自适应性。

🎯 应用场景

该研究成果可广泛应用于智能制造领域,例如3D打印、焊接、喷涂等。通过数字孪生和强化学习,可以实现机器人系统的自动化、智能化和自适应控制,提高生产效率和产品质量,降低生产成本。未来,该技术有望应用于更复杂的工业场景,例如柔性制造、定制化生产等。

📄 摘要(原文)

With the rapid development of deep reinforcement learning technology, it gradually demonstrates excellent potential and is becoming the most promising solution in the robotics. However, in the smart manufacturing domain, there is still not too much research involved in dynamic adaptive control mechanisms optimizing complex processes. This research advances the integration of Soft Actor-Critic (SAC) with digital twins for industrial robotics applications, providing a framework for enhanced adaptive real-time control for smart additive manufacturing processing. The system architecture combines Unity's simulation environment with ROS2 for seamless digital twin synchronization, while leveraging transfer learning to efficiently adapt trained models across tasks. We demonstrate our methodology using a Viper X300s robot arm with the proposed hierarchical reward structure to address the common reinforcement learning challenges in two distinct control scenarios. The results show rapid policy convergence and robust task execution in both simulated and physical environments demonstrating the effectiveness of our approach.