SSF-PAN: Semantic Scene Flow-Based Perception for Autonomous Navigation in Traffic Scenarios

作者: Yinqi Chen, Meiying Zhang, Qi Hao, Guang Zhou

分类: cs.RO, cs.CV

发布日期: 2025-01-28

💡 一句话要点

提出SSF-PAN,利用语义场景流实现交通场景下自主导航

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 语义场景流 自主导航 目标检测 点云处理 深度学习

📋 核心要点

- 复杂交通场景中,移动物体的干扰给车辆检测和定位带来挑战,传统方法效率和精度不足。

- SSF-PAN利用语义场景流分割静态和动态物体,并通过迭代框架优化场景流质量和分割结果。

- 实验表明,SSF-PAN在场景流计算、移动物体检测、计算效率和自主导航方面优于传统方法。

📝 摘要(中文)

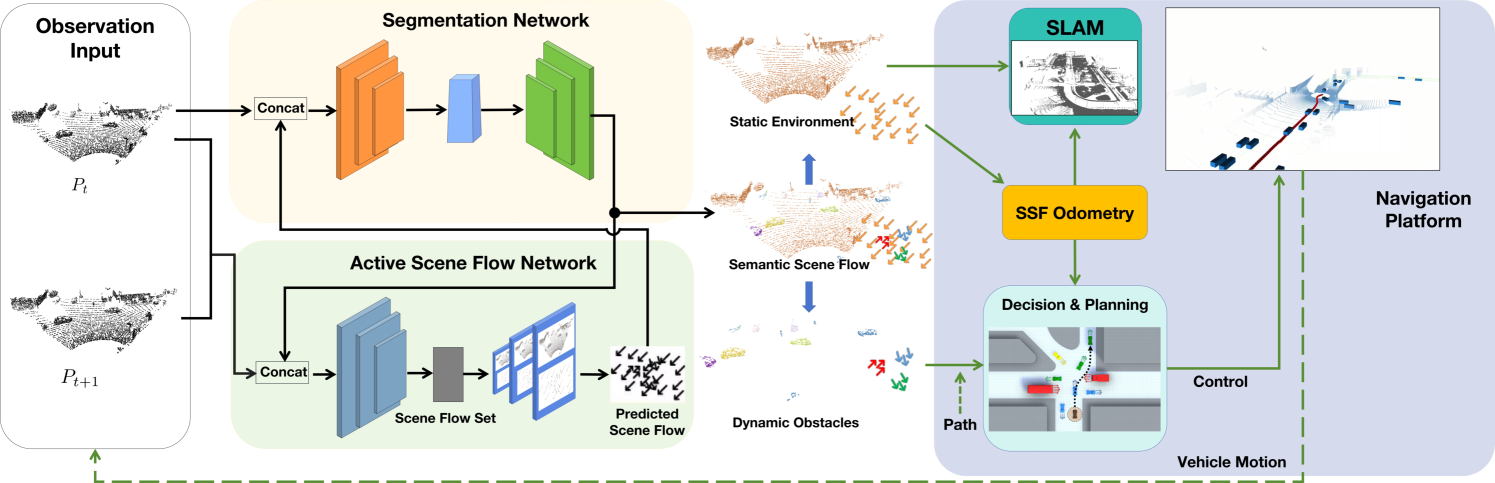

本文提出了一种名为SSF-PAN的方法,用于解决复杂交通场景中移动物体干扰下的车辆检测与定位问题。传统方法依赖于异常值排除或语义分割,计算效率和精度较低。SSF-PAN能够高效且精确地实现基于激光雷达点云的目标检测/定位和SLAM,从而实现无需地图的导航框架。该工作的主要创新点包括:1) 开发了一个神经网络,能够根据不同运动特征对场景流中的静态和动态物体进行分割,即语义场景流(SSF);2) 开发了一个迭代框架,进一步优化输入场景流的质量和输出分割结果;3) 开发了一个基于场景流的导航平台,用于在仿真环境中测试SSF感知系统的性能。在SUScape-CARLA、KITTI数据集和CARLA仿真器上的实验结果表明,所提出的方法在场景流计算精度、移动物体检测精度、计算效率和自主导航有效性方面均优于传统方法。

🔬 方法详解

问题定义:论文旨在解决复杂交通场景下,由于移动物体干扰导致的车辆检测与定位精度不高的问题。现有方法,如基于异常值排除或语义分割的方法,在计算效率和精度上存在瓶颈,难以满足自主导航的需求。

核心思路:论文的核心思路是利用语义场景流(Semantic Scene Flow,SSF)来区分场景中的静态和动态物体。通过分析场景中物体的运动特征,将场景流分割成不同的语义类别,从而提高目标检测和定位的精度。同时,采用迭代框架来优化场景流的质量,进一步提升分割效果。

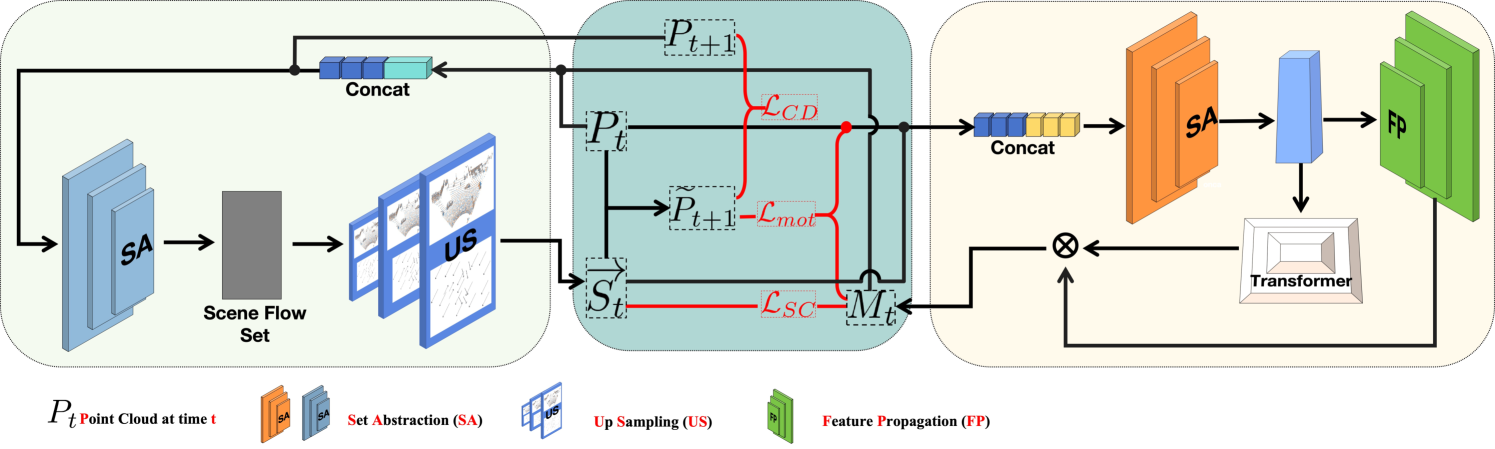

技术框架:SSF-PAN的整体框架包含以下几个主要模块:1) 场景流估计模块:用于估计场景中每个点的运动矢量;2) 语义场景流分割模块:利用神经网络对场景流进行分割,区分静态和动态物体;3) 迭代优化模块:通过迭代的方式优化场景流和分割结果,提高精度;4) 导航模块:利用分割后的场景信息进行自主导航。整个流程首先估计场景流,然后进行语义分割,再通过迭代优化提高精度,最后用于导航。

关键创新:该方法最重要的创新点在于将语义信息融入到场景流中,提出了语义场景流(SSF)的概念。通过神经网络学习不同运动特征的物体类别,实现了对场景流的语义分割。与传统的场景流方法相比,SSF能够更准确地识别和区分场景中的静态和动态物体,从而提高目标检测和定位的精度。此外,迭代优化框架也是一个重要的创新,它能够进一步提高场景流的质量和分割结果。

关键设计:论文中神经网络的具体结构未知,但可以推测其输入为场景流,输出为每个点的语义类别(例如,静态、车辆、行人等)。损失函数的设计可能包括交叉熵损失,用于衡量分割结果的准确性。迭代优化模块的具体实现方式未知,但可能涉及到对场景流进行平滑处理,或者利用分割结果反过来优化场景流的估计。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SSF-PAN在场景流计算精度、移动物体检测精度、计算效率和自主导航有效性方面均优于传统方法。具体性能提升数据未知,但摘要强调了在SUScape-CARLA、KITTI数据集和CARLA仿真器上的验证,表明该方法具有良好的泛化能力和实际应用潜力。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、智能交通等领域。通过提高在复杂交通场景下的目标检测和定位精度,可以提升自动驾驶系统的安全性和可靠性。此外,该方法还可以用于构建高精度地图,为自动驾驶提供更准确的环境信息。未来,该技术有望在物流配送、公共交通等领域发挥重要作用。

📄 摘要(原文)

Vehicle detection and localization in complex traffic scenarios pose significant challenges due to the interference of moving objects. Traditional methods often rely on outlier exclusions or semantic segmentations, which suffer from low computational efficiency and accuracy. The proposed SSF-PAN can achieve the functionalities of LiDAR point cloud based object detection/localization and SLAM (Simultaneous Localization and Mapping) with high computational efficiency and accuracy, enabling map-free navigation frameworks. The novelty of this work is threefold: 1) developing a neural network which can achieve segmentation among static and dynamic objects within the scene flows with different motion features, that is, semantic scene flow (SSF); 2) developing an iterative framework which can further optimize the quality of input scene flows and output segmentation results; 3) developing a scene flow-based navigation platform which can test the performance of the SSF perception system in the simulation environment. The proposed SSF-PAN method is validated using the SUScape-CARLA and the KITTI datasets, as well as on the CARLA simulator. Experimental results demonstrate that the proposed approach outperforms traditional methods in terms of scene flow computation accuracy, moving object detection accuracy, computational efficiency, and autonomous navigation effectiveness.