AdaWM: Adaptive World Model based Planning for Autonomous Driving

作者: Hang Wang, Xin Ye, Feng Tao, Chenbin Pan, Abhirup Mallik, Burhaneddin Yaman, Liu Ren, Junshan Zhang

分类: cs.RO, cs.AI

发布日期: 2025-01-22 (更新: 2025-01-23)

备注: ICLR 2025

💡 一句话要点

AdaWM:基于自适应世界模型的自动驾驶规划方法,提升微调效率和鲁棒性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自动驾驶 世界模型 强化学习 模型微调 自适应学习

📋 核心要点

- 现有基于世界模型的强化学习方法在自动驾驶中面临预训练模型与新任务不匹配导致的性能下降问题。

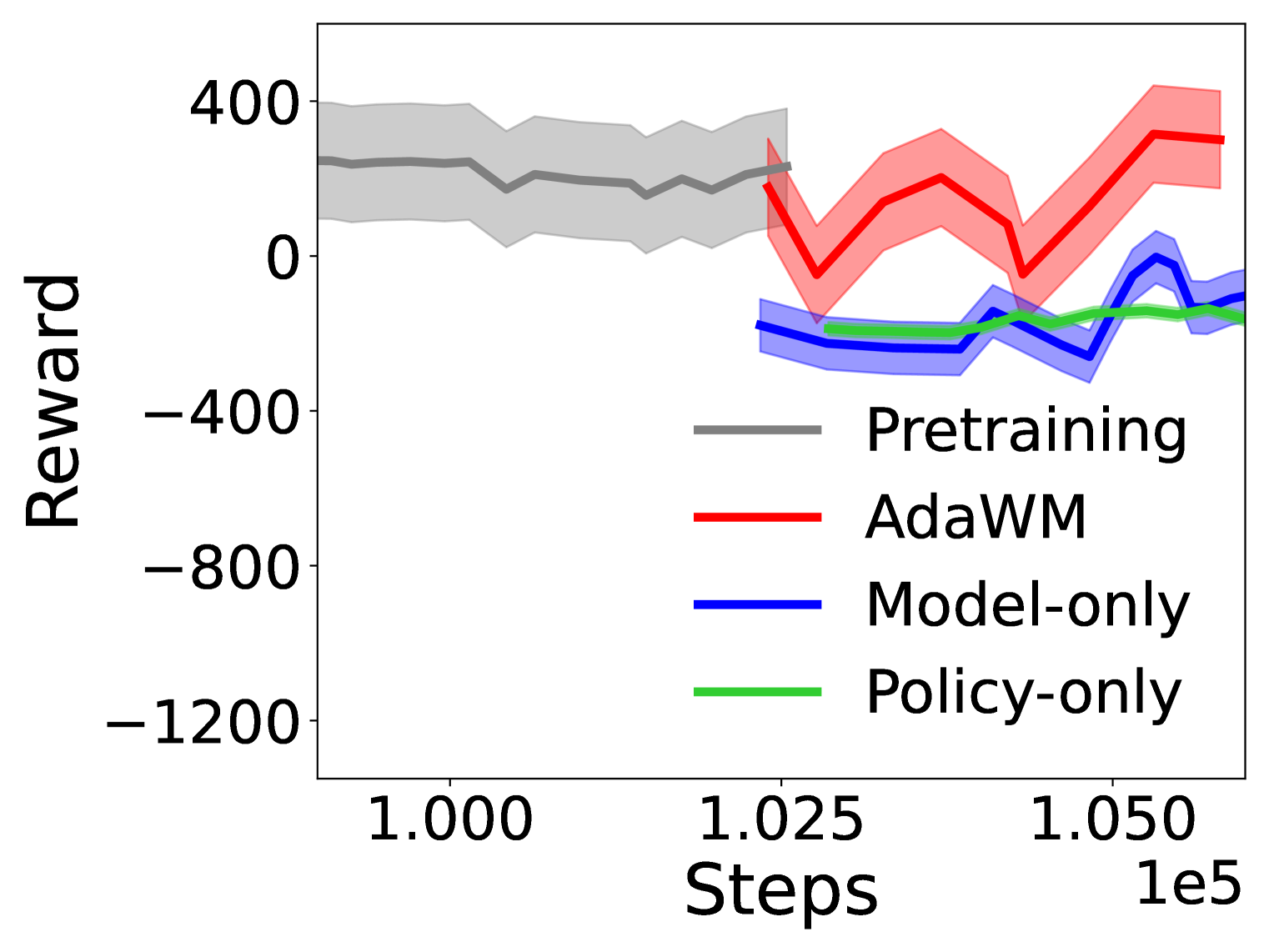

- AdaWM通过量化策略和模型的不匹配程度,自适应地选择性更新策略或模型,实现高效微调。

- 在CARLA上的实验表明,AdaWM能显著提升微调过程的效率和鲁棒性,改善自动驾驶性能。

📝 摘要(中文)

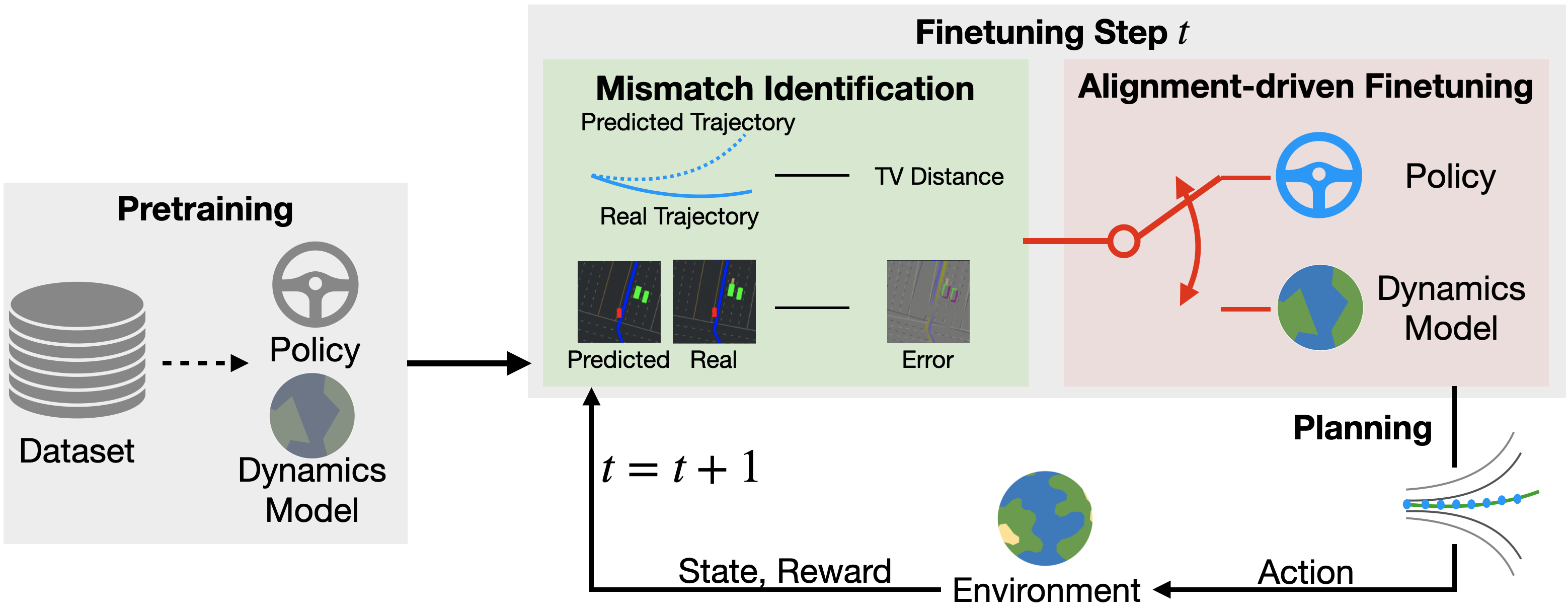

本文提出了一种基于世界模型的自适应规划方法AdaWM,用于解决自动驾驶中预训练-微调范式下,在线强化学习性能下降的问题。通过分析性能下降的原因,发现规划策略和动力学模型的不匹配是主要因素。AdaWM包含两个关键步骤:(a) 不匹配识别,量化不匹配程度并指导微调策略;(b) 对齐驱动的微调,根据需要选择性地更新策略或模型,并使用高效的低秩更新。在CARLA驾驶任务上的大量实验表明,AdaWM显著改善了微调过程,从而在自动驾驶系统中实现了更鲁棒和高效的性能。

🔬 方法详解

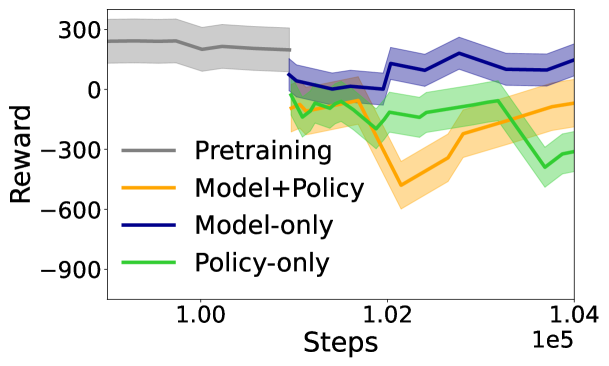

问题定义:在自动驾驶领域,基于世界模型的强化学习方法通常采用预训练-微调的范式。然而,直接将预训练模型应用于新的在线强化学习任务时,由于环境分布的差异,会导致规划策略和动力学模型与新任务不匹配,从而引起性能显著下降。现有方法缺乏对这种不匹配的有效识别和自适应调整机制,导致微调效率低下,甚至性能恶化。

核心思路:AdaWM的核心思路是首先量化规划策略和动力学模型与新任务之间的不匹配程度,然后根据不匹配的类型和程度,自适应地选择性地更新策略或模型。这种方法避免了盲目地同时更新所有参数,从而提高了微调效率和鲁棒性。通过低秩更新,进一步降低了计算成本。

技术框架:AdaWM的整体框架包含两个主要阶段:(1) 不匹配识别阶段:该阶段通过特定的指标来量化预训练模型和策略与新任务之间的差异,从而判断是策略不匹配还是模型不匹配,或者是两者都存在不匹配。(2) 对齐驱动的微调阶段:根据不匹配识别的结果,选择性地更新策略或模型。如果策略不匹配严重,则主要更新策略;如果模型不匹配严重,则主要更新模型;如果两者都存在不匹配,则同时更新策略和模型。

关键创新:AdaWM的关键创新在于提出了一个自适应的微调框架,能够根据任务的特点和预训练模型的不足,有针对性地进行微调。与传统的微调方法相比,AdaWM能够更有效地利用预训练模型的知识,同时避免了过度拟合新任务的风险。此外,通过低秩更新,显著降低了计算复杂度。

关键设计:在不匹配识别阶段,论文可能使用了KL散度等指标来衡量策略和模型输出分布的差异。在对齐驱动的微调阶段,可能采用了低秩适应(LoRA)等技术,通过引入少量可训练参数来更新策略或模型,从而降低计算成本。损失函数的设计可能包括强化学习的奖励函数以及用于对齐策略和模型的正则化项。具体的网络结构未知,但通常会采用循环神经网络(RNN)或Transformer等结构来建模环境动态。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AdaWM在CARLA自动驾驶任务中显著优于传统的微调方法。具体而言,AdaWM在多个指标上取得了显著提升,例如驾驶成功率、平均速度和碰撞次数等。与基线方法相比,AdaWM能够更快地适应新环境,并达到更高的性能水平。具体提升幅度未知,但摘要中提到“显著改善了微调过程”。

🎯 应用场景

AdaWM可广泛应用于各种自动驾驶场景,例如城市道路、高速公路和越野环境。该方法能够提升自动驾驶系统在不同环境下的适应性和鲁棒性,降低开发成本,加速自动驾驶技术的商业化落地。此外,该方法也可应用于其他机器人领域,例如无人机、服务机器人等。

📄 摘要(原文)

World model based reinforcement learning (RL) has emerged as a promising approach for autonomous driving, which learns a latent dynamics model and uses it to train a planning policy. To speed up the learning process, the pretrain-finetune paradigm is often used, where online RL is initialized by a pretrained model and a policy learned offline. However, naively performing such initialization in RL may result in dramatic performance degradation during the online interactions in the new task. To tackle this challenge, we first analyze the performance degradation and identify two primary root causes therein: the mismatch of the planning policy and the mismatch of the dynamics model, due to distribution shift. We further analyze the effects of these factors on performance degradation during finetuning, and our findings reveal that the choice of finetuning strategies plays a pivotal role in mitigating these effects. We then introduce AdaWM, an Adaptive World Model based planning method, featuring two key steps: (a) mismatch identification, which quantifies the mismatches and informs the finetuning strategy, and (b) alignment-driven finetuning, which selectively updates either the policy or the model as needed using efficient low-rank updates. Extensive experiments on the challenging CARLA driving tasks demonstrate that AdaWM significantly improves the finetuning process, resulting in more robust and efficient performance in autonomous driving systems.