FAST: Efficient Action Tokenization for Vision-Language-Action Models

作者: Karl Pertsch, Kyle Stachowicz, Brian Ichter, Danny Driess, Suraj Nair, Quan Vuong, Oier Mees, Chelsea Finn, Sergey Levine

分类: cs.RO, cs.LG

发布日期: 2025-01-16

备注: Website: https://www.pi.website/research/fast

💡 一句话要点

提出FAST以解决机器人动作信号离散化问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人动作离散化 自回归模型 频率空间 离散余弦变换 高频率任务 智能机器人 自动化控制

📋 核心要点

- 现有的机器人动作离散化方法在处理高频率和灵巧技能时表现不佳,限制了模型的学习能力。

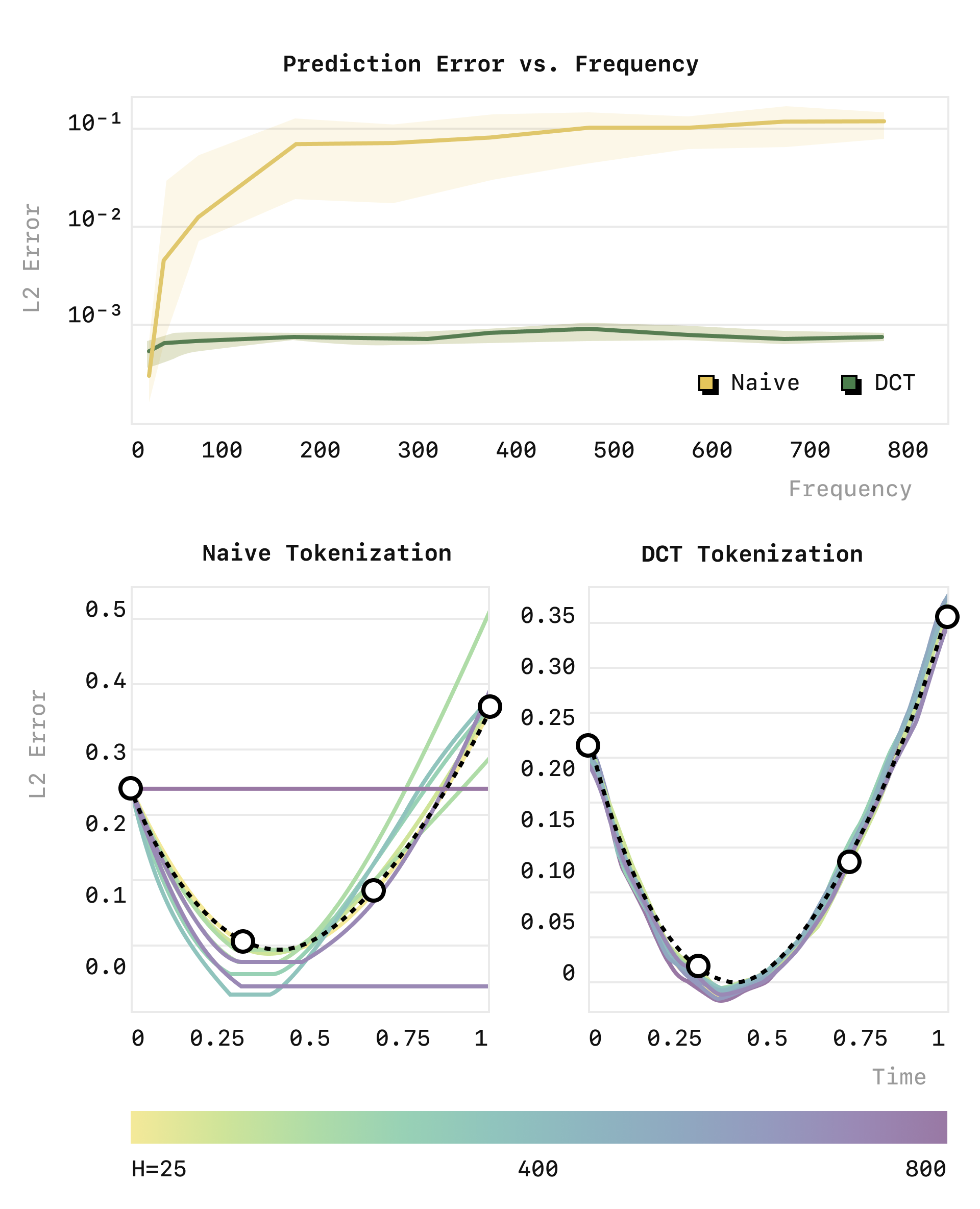

- 本文提出了一种基于离散余弦变换的压缩离散化方案,称为FAST,旨在提高动作信号的离散化效果。

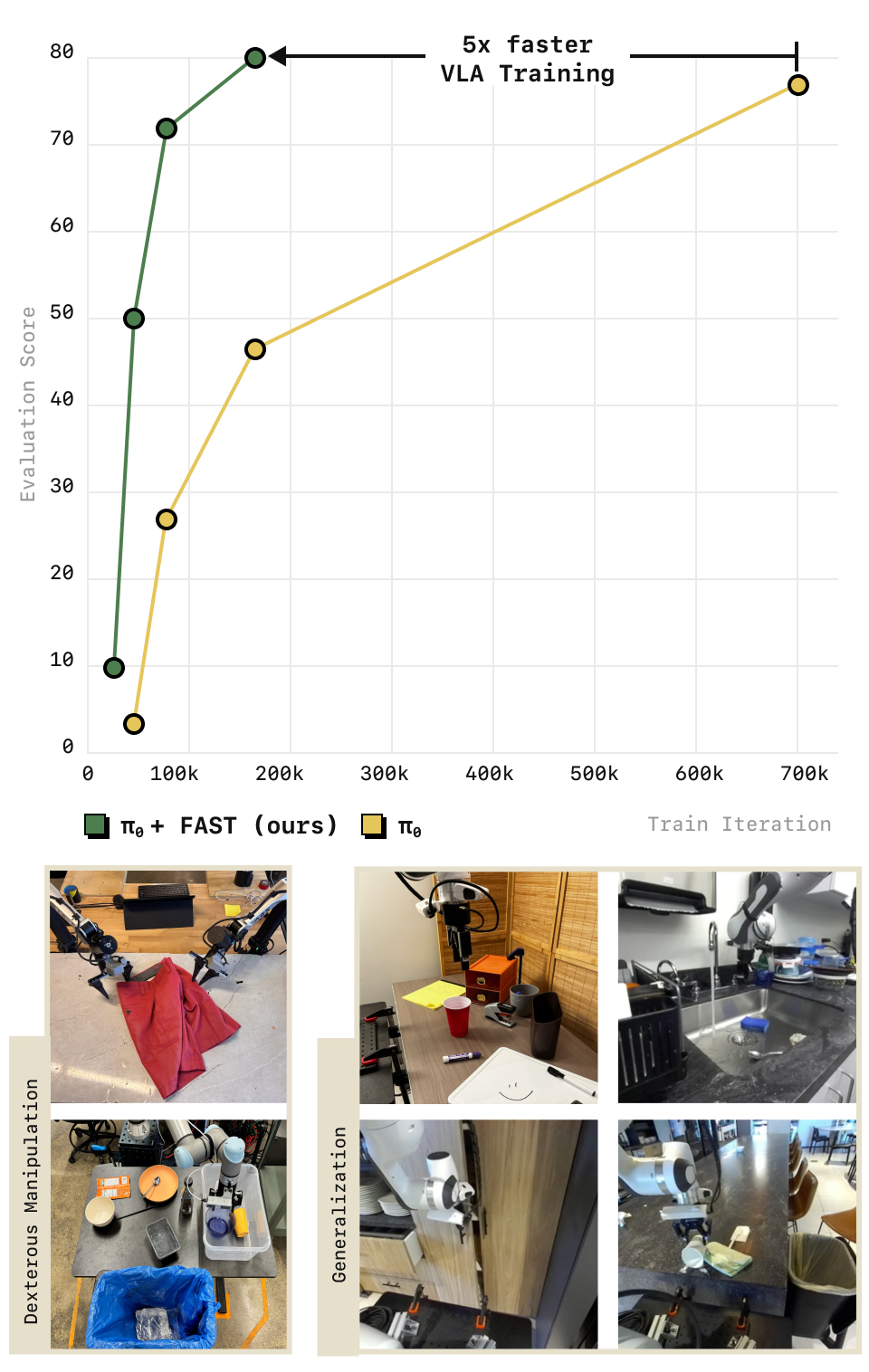

- 实验结果表明,结合pi0 VLA后,FAST能够在1万小时的训练数据上实现与扩散VLA相当的性能,同时训练时间减少了5倍。

📝 摘要(中文)

自回归序列模型,如基于Transformer的视觉-语言-动作(VLA)策略,在捕捉复杂且可推广的机器人行为方面表现出色。然而,现有的机器人动作离散化方法通常基于简单的逐维、逐时间步的分箱方案,导致在学习高频率的灵巧技能时效果不佳。为了解决这一挑战,本文提出了一种基于离散余弦变换的新型压缩离散化方案,称为频率空间动作序列离散化(FAST)。该方法使得我们能够训练自回归VLA以应对标准离散化方法完全失效的高频率灵巧任务。此外,我们发布了FAST+,一个通用的机器人动作离散化器,经过1M真实机器人动作轨迹的训练,可以作为黑箱离散化器应用于多种机器人动作序列。最后,我们展示了结合pi0 VLA后,该方法能够扩展到1万小时的机器人数据训练,并与扩散VLA的性能相匹配,同时将训练时间缩短至5倍。

🔬 方法详解

问题定义:本文旨在解决现有机器人动作离散化方法在高频率和灵巧技能学习中的不足,现有方法通常基于简单的分箱方案,导致性能低下。

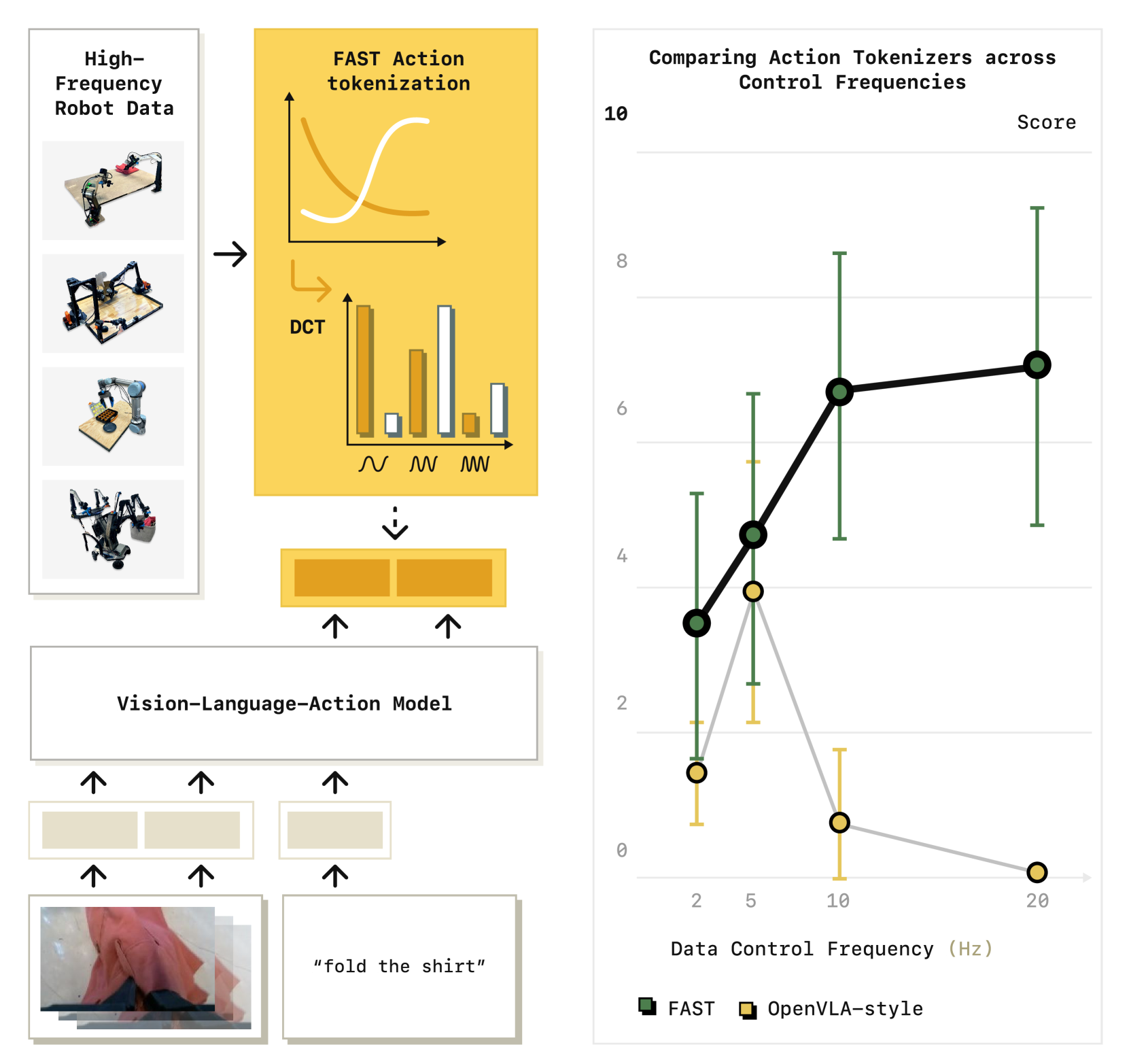

核心思路:论文提出的FAST方法利用离散余弦变换进行动作信号的压缩离散化,从而提高了动作信号的表示能力,适应复杂的机器人任务。

技术框架:整体架构包括数据采集、动作信号的离散化处理、模型训练和评估四个主要模块。首先收集高频率的机器人动作数据,然后应用FAST进行离散化,最后使用自回归VLA进行训练。

关键创新:FAST的核心创新在于其基于频率空间的动作序列离散化方法,与传统的逐维分箱方法相比,能够更有效地捕捉高频率动作的变化,提升模型的学习效果。

关键设计:在设计中,FAST采用了离散余弦变换作为核心技术,确保了动作信号的高效表示。此外,模型的损失函数和网络结构经过精心调整,以适应高频率数据的特性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,结合pi0 VLA后,FAST在1万小时的机器人数据训练中达到了与扩散VLA相当的性能,同时将训练时间缩短了5倍,展现了其在高频率任务中的优势。

🎯 应用场景

该研究具有广泛的应用潜力,尤其在机器人控制、自动化制造和人机交互等领域。通过提高机器人对复杂动作的学习能力,FAST能够推动智能机器人在实际应用中的表现,促进更高效的自动化解决方案的开发。

📄 摘要(原文)

Autoregressive sequence models, such as Transformer-based vision-language action (VLA) policies, can be tremendously effective for capturing complex and generalizable robotic behaviors. However, such models require us to choose a tokenization of our continuous action signals, which determines how the discrete symbols predicted by the model map to continuous robot actions. We find that current approaches for robot action tokenization, based on simple per-dimension, per-timestep binning schemes, typically perform poorly when learning dexterous skills from high-frequency robot data. To address this challenge, we propose a new compression-based tokenization scheme for robot actions, based on the discrete cosine transform. Our tokenization approach, Frequency-space Action Sequence Tokenization (FAST), enables us to train autoregressive VLAs for highly dexterous and high-frequency tasks where standard discretization methods fail completely. Based on FAST, we release FAST+, a universal robot action tokenizer, trained on 1M real robot action trajectories. It can be used as a black-box tokenizer for a wide range of robot action sequences, with diverse action spaces and control frequencies. Finally, we show that, when combined with the pi0 VLA, our method can scale to training on 10k hours of robot data and match the performance of diffusion VLAs, while reducing training time by up to 5x.