Learning Affordances from Interactive Exploration using an Object-level Map

作者: Paula Wulkop, Halil Umut Özdemir, Antonia Hüfner, Jen Jen Chung, Roland Siegwart, Lionel Ott

分类: cs.RO

发布日期: 2025-01-10

备注: International Symposium of Robotics Research (ISRR) 2024

💡 一句话要点

提出一种基于物体级地图的交互式探索方法,用于学习机器人操作物体的可供性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 可供性学习 交互式探索 物体级地图 机器人操作 自主探索

📋 核心要点

- 现实环境中机器人任务需要与物体交互,而现有方法在未知环境中进行可供性学习时,缺乏有效的物体跟踪和数据关联机制。

- 该论文提出一种基于物体级地图的交互式探索方法,通过地图实现物体实例的识别和跟踪,从而更有效地收集交互数据。

- 实验表明,相比于没有物体级地图的基线方法,该方法能够提高探索效率,并获得更准确的可供性预测模型。

📝 摘要(中文)

本文提出了一种交互式探索流程,用于学习机器人特定的可供性预测器。该流程允许机器人在探索未知环境的同时收集交互经验。通过在探索流程中集成物体级地图,机器人能够识别不同的物体实例,并在不同的视角下跟踪物体。与不包含地图的现有方法相比,该方法能够产生更密集、更准确的可供性标注。实验结果表明,该可供性探索方法能够提高探索效率,并产生更准确的可供性预测模型。

🔬 方法详解

问题定义:机器人需要在未知环境中学习与物体的交互方式(可供性),例如拿起或推动物体。现有方法在探索过程中,难以有效地识别和跟踪物体,导致可供性标注稀疏且不准确,影响学习效果。现有方法没有充分利用环境中的物体信息,导致探索效率低下。

核心思路:利用物体级地图来解决物体识别和跟踪问题。通过构建环境的物体级地图,机器人可以识别不同的物体实例,并在不同的视角下跟踪这些物体。这样可以更密集地收集与特定物体的交互数据,从而提高可供性标注的准确性。

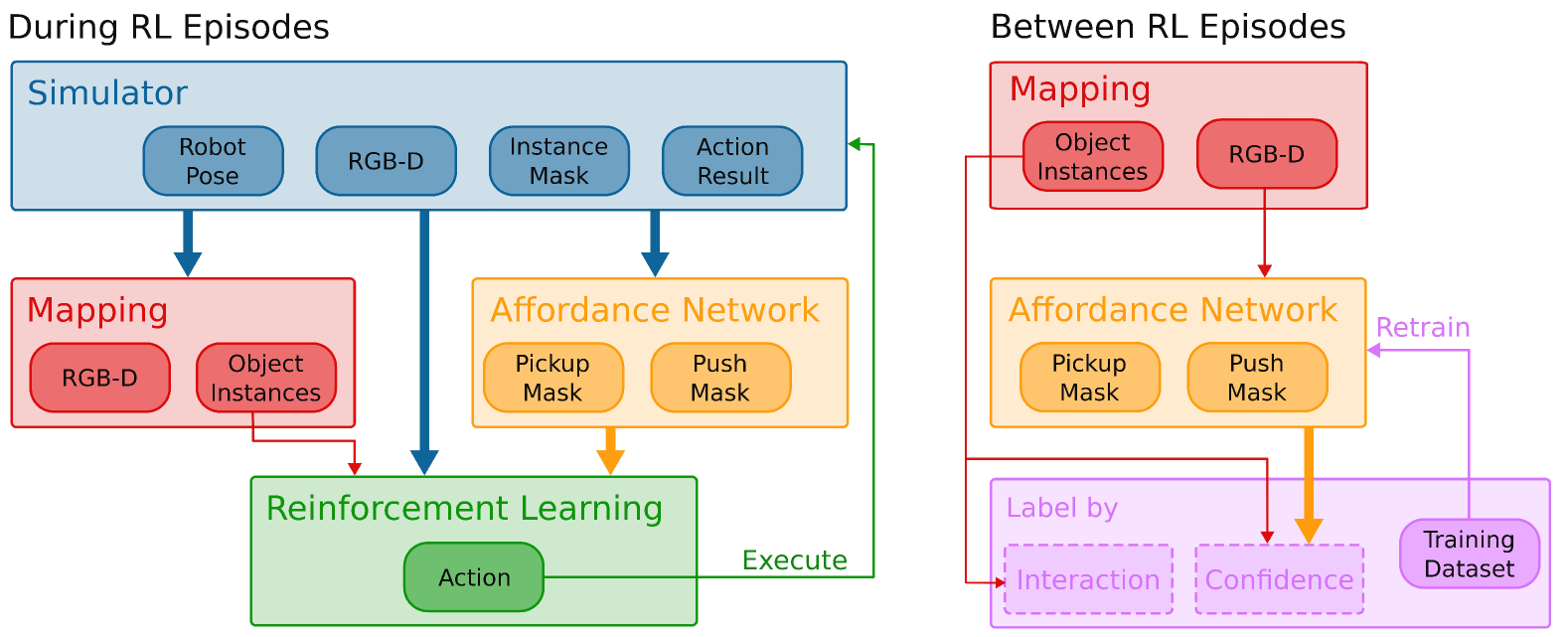

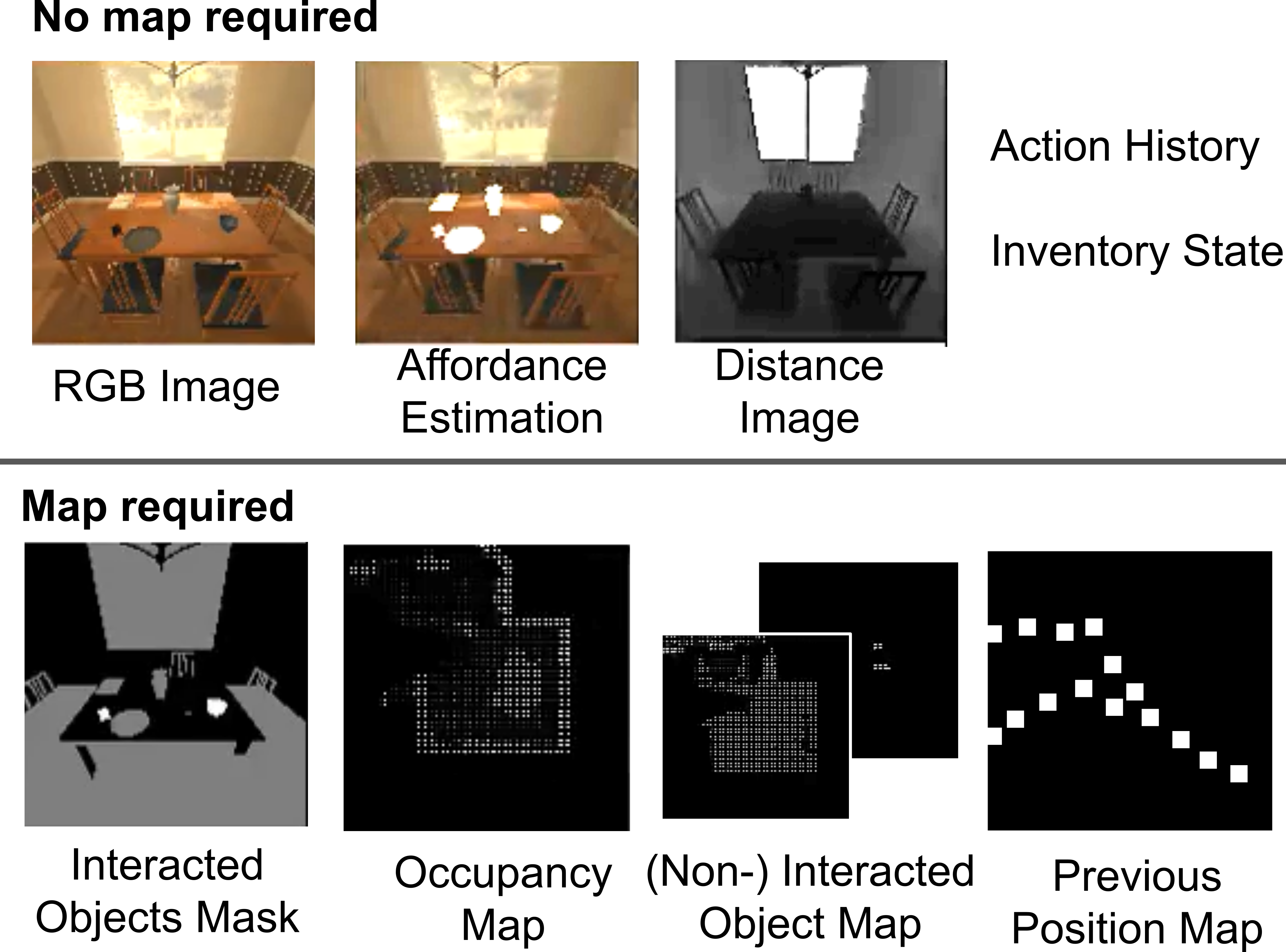

技术框架:该方法包含一个交互式探索流程,主要包括以下几个阶段:1) 机器人自主探索环境,构建物体级地图;2) 机器人与环境中识别出的物体进行交互,例如尝试抓取或推动;3) 记录交互数据,包括机器人状态、物体状态和交互结果;4) 使用收集到的交互数据训练可供性预测模型。物体级地图用于在探索过程中识别和跟踪物体,并将不同视角的交互数据关联到同一物体实例。

关键创新:该方法的核心创新在于将物体级地图集成到交互式可供性学习流程中。与现有方法相比,该方法能够更有效地利用环境中的物体信息,从而提高可供性标注的密度和准确性。通过物体级地图,机器人可以更好地理解环境,并更有效地进行探索。

关键设计:物体级地图的构建和维护是关键。具体实现细节未知,但可能涉及SLAM技术、物体检测和识别算法。可供性预测模型的具体结构未知,但可能采用深度学习方法,例如卷积神经网络或循环神经网络。损失函数的设计需要考虑交互结果的正确性,例如是否成功抓取或推动物体。

🖼️ 关键图片

📊 实验亮点

论文重点在于将物体级地图融入交互式探索流程,从而提升可供性学习的效率和准确性。实验结果表明,相比于没有物体级地图的基线方法,该方法能够产生更密集、更准确的可供性标注,并获得更准确的可供性预测模型。具体的性能数据和提升幅度在摘要中未明确给出,属于未知信息。

🎯 应用场景

该研究成果可应用于各种需要机器人与物体交互的场景,例如家庭服务机器人、工业自动化、仓储物流等。通过学习物体的可供性,机器人可以更智能地执行各种任务,例如物品整理、装配、搬运等。该研究有助于提高机器人的自主性和适应性,使其能够更好地适应复杂多变的环境。

📄 摘要(原文)

Many robotic tasks in real-world environments require physical interactions with an object such as pick up or push. For successful interactions, the robot needs to know the object's affordances, which are defined as the potential actions the robot can perform with the object. In order to learn a robot-specific affordance predictor, we propose an interactive exploration pipeline which allows the robot to collect interaction experiences while exploring an unknown environment. We integrate an object-level map in the exploration pipeline such that the robot can identify different object instances and track objects across diverse viewpoints. This results in denser and more accurate affordance annotations compared to state-of-the-art methods, which do not incorporate a map. We show that our affordance exploration approach makes exploration more efficient and results in more accurate affordance prediction models compared to baseline methods.