LearningFlow: Automated Policy Learning Workflow for Urban Driving with Large Language Models

作者: Zengqi Peng, Yubin Wang, Xu Han, Lei Zheng, Jun Ma

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-01-09

💡 一句话要点

LearningFlow:利用大语言模型实现城市自动驾驶策略的自动化学习

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 强化学习 大语言模型 策略学习 课程学习

📋 核心要点

- 现有自动驾驶强化学习方法依赖手动设计的奖励函数,且在复杂环境中样本效率低,限制了其发展。

- LearningFlow利用多个LLM智能体协作,自动生成训练课程和奖励函数,指导强化学习策略。

- 实验表明LearningFlow在奖励和课程生成方面表现出色,提升了驾驶任务的性能和泛化能力。

📝 摘要(中文)

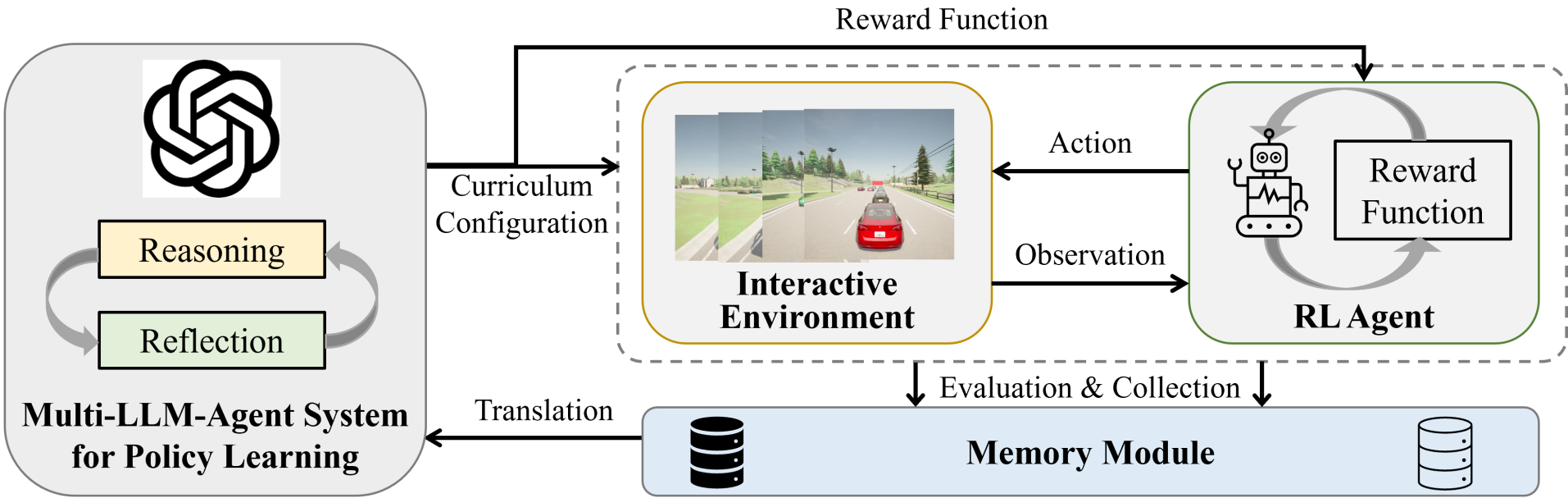

本文提出了一种名为LearningFlow的创新型自动化策略学习工作流,专门针对城市驾驶场景。该框架利用多个大型语言模型(LLM)智能体在强化学习(RL)训练过程中进行协作。LearningFlow包含课程序列生成过程和奖励生成过程,通过生成定制化的训练课程和奖励函数来指导RL策略。每个过程都由一个分析智能体支持,该智能体评估训练进度,并为生成智能体提供关键见解。通过这些LLM智能体的协同努力,LearningFlow自动完成了一系列复杂驾驶任务的策略学习,显著减少了对人工奖励函数设计的依赖,同时提高了样本效率。在CARLA高保真模拟器中进行了全面的实验,并与其他现有方法进行了比较,证明了该方法的有效性。结果表明,LearningFlow在生成奖励和课程方面表现出色,并在各种驾驶任务中实现了卓越的性能和强大的泛化能力,以及对不同RL算法的良好适应性。

🔬 方法详解

问题定义:现有自动驾驶强化学习方法在复杂城市环境中面临两大挑战:一是需要人工设计奖励函数,这既耗时又需要专业知识;二是样本效率低,难以在真实环境中进行充分训练。这些问题阻碍了安全有效的驾驶策略的开发。

核心思路:LearningFlow的核心思路是利用大型语言模型(LLM)的强大能力,自动化生成强化学习训练所需的课程和奖励函数。通过多个LLM智能体的协作,模拟人类专家设计课程和奖励的过程,从而降低对人工干预的依赖,并提高样本效率。

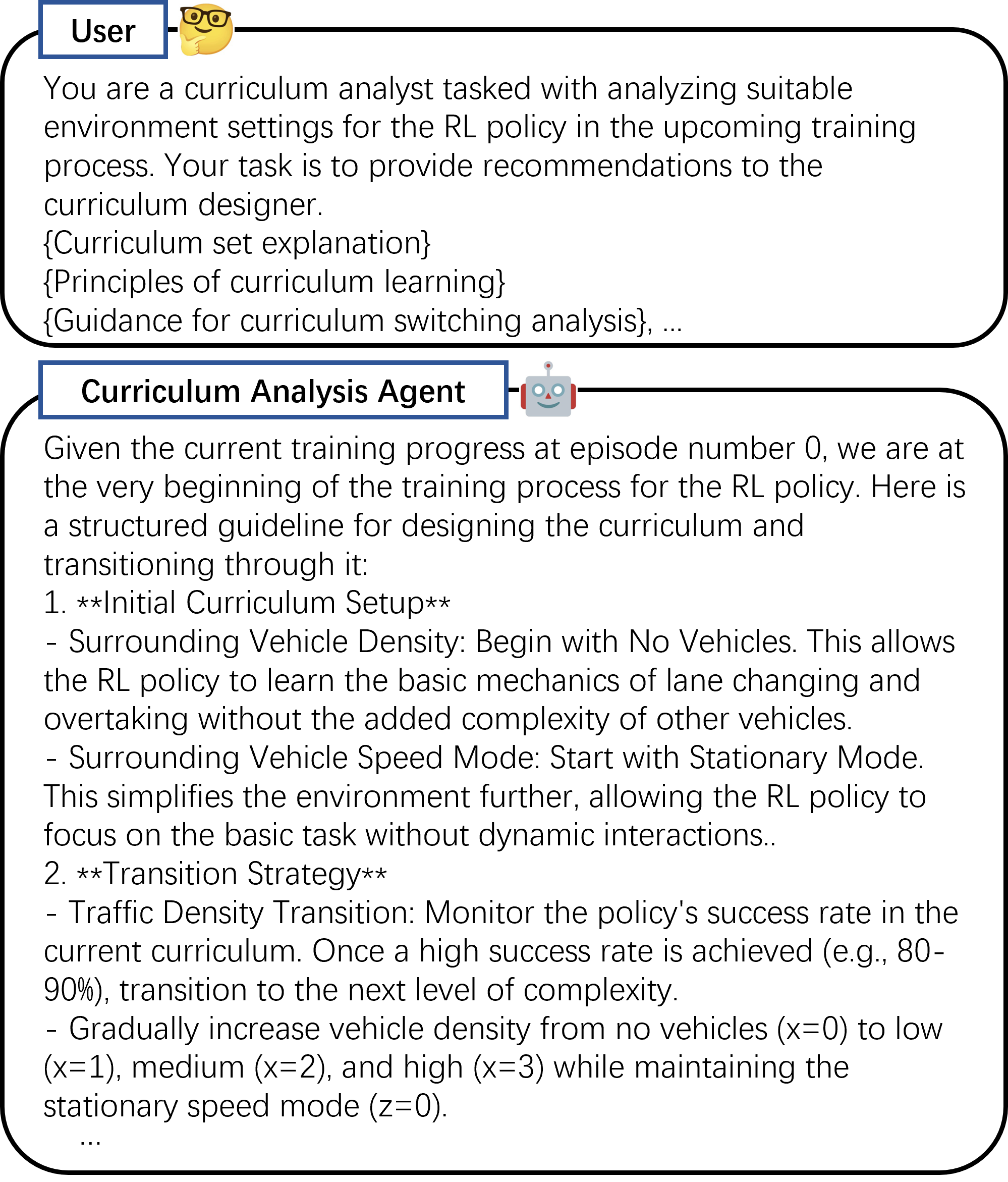

技术框架:LearningFlow包含两个主要过程:课程序列生成和奖励生成。每个过程都由一个生成智能体和一个分析智能体组成。生成智能体负责生成训练课程或奖励函数,而分析智能体则负责评估训练进度,并为生成智能体提供反馈。整个框架通过迭代优化,不断改进课程和奖励函数,最终训练出高性能的驾驶策略。

关键创新:LearningFlow的关键创新在于利用LLM智能体自动化生成课程和奖励函数。与传统方法相比,LearningFlow无需人工设计,可以根据训练进度动态调整课程和奖励,从而提高样本效率和策略性能。此外,通过分析智能体的反馈,可以更好地理解训练过程,并为策略优化提供指导。

关键设计:LearningFlow的具体实现细节包括:LLM智能体的选择和训练方式,课程和奖励的表示方法,以及分析智能体的评估指标。例如,可以使用预训练的LLM模型,并通过微调使其适应自动驾驶任务。课程可以表示为一系列驾驶场景,奖励可以表示为与驾驶行为相关的数值。分析智能体可以使用各种指标来评估训练进度,例如成功率、碰撞率等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LearningFlow在CARLA模拟器中表现出色,能够生成有效的奖励和课程,并在各种驾驶任务中实现卓越的性能和强大的泛化能力。与其他现有方法相比,LearningFlow显著提高了样本效率和策略性能,并且能够很好地适应不同的强化学习算法。具体性能数据未知,但论文强调了其优越性和鲁棒性。

🎯 应用场景

LearningFlow具有广泛的应用前景,可用于自动驾驶汽车的策略训练、机器人导航、游戏AI等领域。该研究成果有助于降低自动驾驶技术的开发成本,提高驾驶策略的安全性和可靠性,加速自动驾驶技术的商业化进程。未来,该方法还可以扩展到其他复杂任务中,实现更广泛的自动化策略学习。

📄 摘要(原文)

Recent advancements in reinforcement learning (RL) demonstrate the significant potential in autonomous driving. Despite this promise, challenges such as the manual design of reward functions and low sample efficiency in complex environments continue to impede the development of safe and effective driving policies. To tackle these issues, we introduce LearningFlow, an innovative automated policy learning workflow tailored to urban driving. This framework leverages the collaboration of multiple large language model (LLM) agents throughout the RL training process. LearningFlow includes a curriculum sequence generation process and a reward generation process, which work in tandem to guide the RL policy by generating tailored training curricula and reward functions. Particularly, each process is supported by an analysis agent that evaluates training progress and provides critical insights to the generation agent. Through the collaborative efforts of these LLM agents, LearningFlow automates policy learning across a series of complex driving tasks, and it significantly reduces the reliance on manual reward function design while enhancing sample efficiency. Comprehensive experiments are conducted in the high-fidelity CARLA simulator, along with comparisons with other existing methods, to demonstrate the efficacy of our proposed approach. The results demonstrate that LearningFlow excels in generating rewards and curricula. It also achieves superior performance and robust generalization across various driving tasks, as well as commendable adaptation to different RL algorithms.